Pinakamahusay na Antidetect Browser para sa Web Scraping sa 2026

Tingnan ang Mabilis

Tuklasin ang pinakamahusay na mga antidetect browser para sa web scraping sa 2026, pagbutihin ang stability, iwasan ang detection, at mahusay na mag-scale—magbasa pa upang mahanap ang tamang tool para sa iyong workflow ngayon.

Malaki ang ipinagbago ng web scraping. Hindi pa katagalan, maaari kang magpatakbo ng isang pangunahing script at mangolekta ng data nang walang gaanong abala. Ngayon, karamihan sa mga platform ay nagmomonitor ng mas maraming signal sa likod ng mga eksena, mula sa fingerprint ng iyong browser hanggang sa kung paano ka nakikipag-ugnayan sa isang pahina, kahit ang tiyempo sa pagitan ng mga aksyon. Kapag ang isang bagay ay hindi mukhang natural, ang mga paghihigpit o pagharang ay maaaring mangyari halos kaagad, kaya naman maraming developer ang nagsisimulang maghanap ng mga paraan upang gumawa ng web scraping nang hindi naharangan sa halip na umasa sa mga pangunahing script.

Dito pumapasok ang mga antidetect browser. Sa halip na patuloy na ayusin ang mga isyu sa pagtukoy pagkatapos lumitaw ang mga ito, hinahayaan ka nitong magsimula sa isang mas makatotohanang setup, gamit ang magkakahiwalay na pagkakakilanlan, matatag na mga sesyon, at gawi na mas malapit sa hitsura ng mga totoong gumagamit. Sa gabay na ito, susuriin natin kung paano sila gumagana at kung aling mga tool ang talagang sulit na isaalang-alang sa 2026.

Bakit Nangangailangan ng Antidetect Browser ang Modernong Web Scraping

Ang talagang nagbago sa web scraping ay hindi ang mga tool na ginagamit ng mga tao, kundi kung paano sumusulong ang mga website.

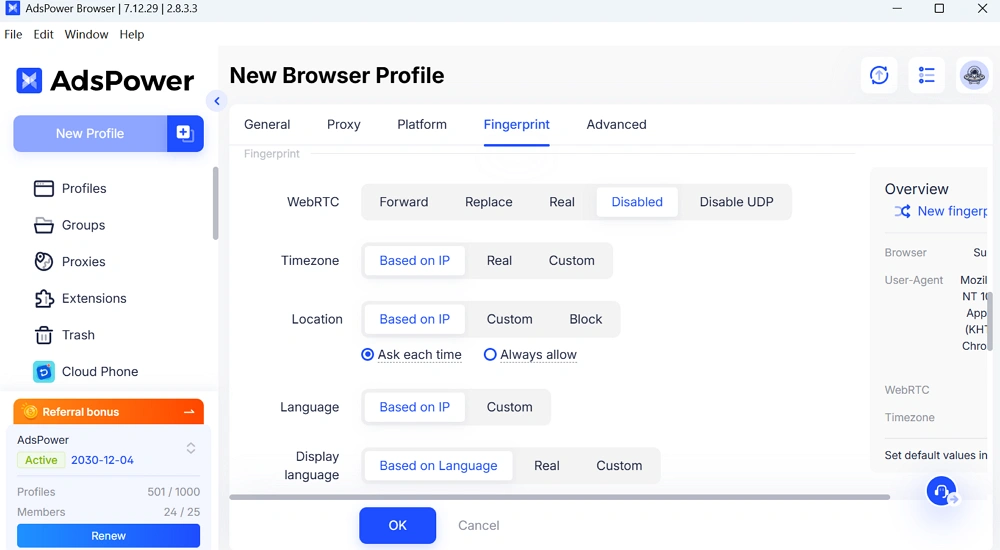

Karamihan sa mga platform ngayon ay pinagsasama ang ilang patong ng pagtuklas nang sabay-sabay. Sa halip na suriin lamang ang mga kahilingan, tinitingnan nila ang pangkalahatang konteksto ng iyong aktibidad, kabilang ang:

- Mga detalye ng fingerprint ng browser tulad ng canvas, WebGL, mga font, at mga detalye ng device

- Mga senyales ng pag-uugali tulad ng paggalaw ng mouse at mga pattern ng pag-scroll

- Reputasyon ng IP at dalas ng kahilingan

- Pagpapatuloy ng sesyon, kabilang ang mga cookies at pagkakapare-pareho ng header

Ang problema ay kailangang maayos ang lahat. Maaari kang magpadala ng mga ganap na balidong kahilingan, ngunit kung may kakaiba sa iyong setup, ito ay mapapansin. Ang isang simpleng hindi pagkakatugma sa pagitan ng iyong user agent at WebGL fingerprint ay maaari nang magdulot ng mga problema. Kung mangyari iyon habang gumagawa ka ng paulit-ulit na mga kahilingan mula sa parehong IP, karaniwang mabilis na sumusunod ang mga pagharang.

Dito nakakaapekto ang mga anti-detect browser . Binabawasan nila ang mga hindi pagkakapare-parehong iyon sa pamamagitan ng pagbibigay sa iyo ng higit na kontrol sa kapaligiran:

- Ang bawat profile ng browser ay may sariling fingerprint

- Nananatiling pare-pareho ang mga sesyon sa iba't ibang cookies, storage, at header

- Ang pangkalahatang setup ay mas malapit sa isang totoong kapaligiran ng gumagamit

Sa huli, ang layunin ay diretso. Sa halip na magmukhang isang script na tumatakbo sa background, ang iyong setup ay humahalo bilang normal na aktibidad ng user, na siyang eksaktong dahilan kung bakit mas matagal ang pagtakbo ng mga scraping workflow.

Ano ang isang Antidetect Browser para sa Web Scraping?

Ang isang antidetect browser ay isang browser na nagbibigay-daan sa iyong magpatakbo ng maraming nakahiwalay na profile, bawat isa ay may sarili nitong fingerprint at session data, kaya ang iyong aktibidad ay tila nagmumula sa iba't ibang totoong user.

Paano Ito Naiiba sa mga Karaniwang Browser

Ang isang regular na browser ay hindi ginawa para sa paghihiwalay ng pagkakakilanlan. Kahit na magpalit ka ng account o mag-clear ng cookies, maraming pinagbabatayan na signal ang nananatiling pareho, na nagpapadali sa mga website na magkonekta ng mga session.

- Nagbabahagi ng pare-parehong fingerprint sa mga tab at session

- Limitadong kontrol sa mga elemento ng fingerprint tulad ng WebGL, mga font, o mga detalye ng device

- Maaaring i-reset ang cookies at storage, ngunit mananatili ang mas malalalim na identifier

- Hindi idinisenyo para sa pagpapatakbo ng maraming independiyenteng pagkakakilanlan nang malawakan

Binabago ito ng isang anti-detect browser sa pamamagitan ng paghihiwalay ng lahat ng bagay sa antas ng profile, na ginagawang magmukhang walang kaugnayan ang bawat sesyon.

Paano Ito Naiiba sa mga Headless Scraping Tools

Ang mga headless tool ay nakatuon sa automation at bilis, hindi sa kung gaano "totoo" ang hitsura ng browser environment. Makapangyarihan ang mga ito, ngunit bilang default ay maaari pa rin silang mag-iwan ng mga nakikitang pattern.

- Na-optimize para sa mga automation workflow at scripting

- Mas mabilis at mas magaan para sa malawakang gawain ng pag-scrape

- Mas madaling matukoy nang walang karagdagang stealth configuration

- Limitadong built-in na kontrol sa makatotohanang mga fingerprint ng browser

Ang mga antidetect browser ay nakatuon sa kabilang panig ng problema, na ginagawang mas pare-pareho at mas mahirap pag-ugnayin ang mga kapaligiran.

Kaya naman sa maraming totoong setup, ginagamit ang mga ito nang magkasama. Ang isa ay humahawak sa automation, ang isa naman ay humahawak sa identity at stealth.

Mga Pangunahing Tampok sa isang Web Scraping Browser

Hindi lahat ng antidetect browser ay talagang angkop para sa scraping. Ang ilan ay ginawa para sa pamamahala ng account, ang iba naman ay para sa mga daloy ng trabaho sa marketing. Kung ang iyong pangunahing layunin ay ang scraping, may ilang feature na mas mahalaga kaysa sa iba.

- Kontrol sa fingerprint na talagang may katuturan

Hindi lang basta-basta fingerprint ang gusto mo. Gusto mo ng mga kombinasyon na mukhang makatotohanan. Kasama rito ang pagtutugma ng user agent sa OS, GPU, mga font, timezone, at maging sa mga setting ng wika.

- Malinis na paghihiwalay ng profile

Ang bawat profile ay dapat kumilos na parang isang ganap na hiwalay na user. Walang shared cookies, walang overlap sa storage, walang leaking data sa pagitan ng mga session.

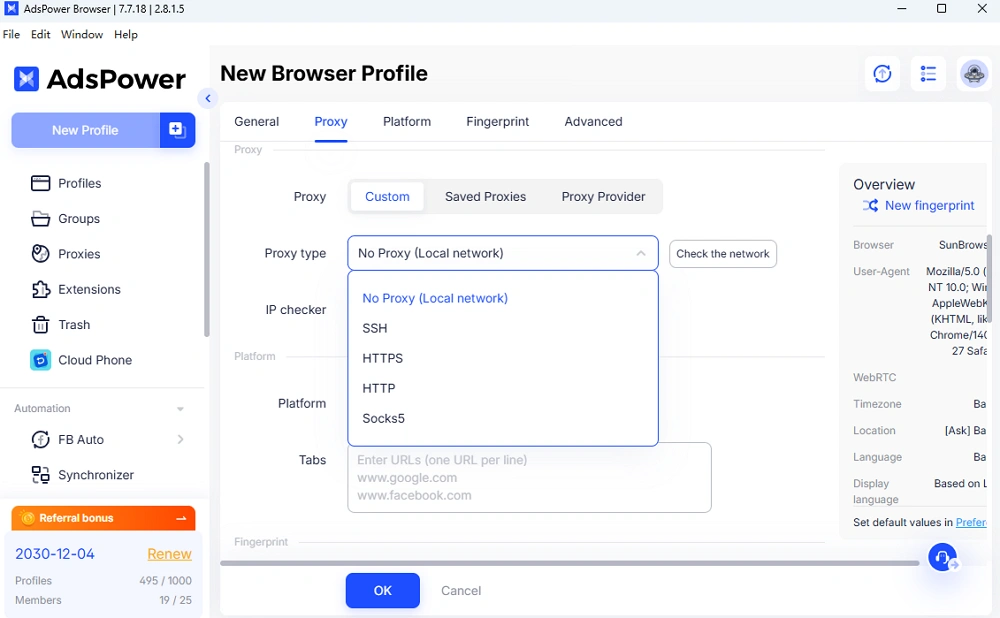

- Suporta sa proxy (at kakayahang umangkop)

Sa pinakamababa, kakailanganin mo ng suporta para sa mga proxy ng HTTP, HTTPS, at SOCKS5. Mas mainam pa kung maaari kang magtalaga ng mga proxy bawat profile at madaling i-rotate ang mga ito.

- Pagkakatugma sa automation

Ang isang mahusay na scraping browser ay dapat gumana gamit ang mga automation tool, alinman sa pamamagitan ng mga API o direktang integrasyon sa mga framework tulad ng Puppeteer o Playwright.

- Katatagan kapag nag-i-scale

Madali lang ang pagpapatakbo ng ilang profile. Ang pagpapatakbo ng dose-dosenang o daan-daan nang walang mga pag-crash o problema sa memorya ang siyang nagiging realidad.

- Pagtitiyaga ng sesyon

Napakahalaga ng kakayahang i-save at muling gamitin ang mga sesyon, lalo na para sa mga site na nangangailangan ng pag-login o pangmatagalang interaksyon.

Kung ang isang kagamitan ay kulang ng dalawa o tatlo sa mga ito, malamang na madarama mo ito kapag sinubukan mong mag-scale.

Pinakamahusay na Antidetect Browser para sa Web Scraping (2026 na Pinili)

Walang iisang "pinakamahusay" na kagamitan para sa lahat. Depende talaga ito sa kung paano ka mag-scrape at kung gaano karami ang kailangan mong i-scale. Gayunpaman, may ilang pangalan na patuloy na lumalabas dahil sa isang dahilan.

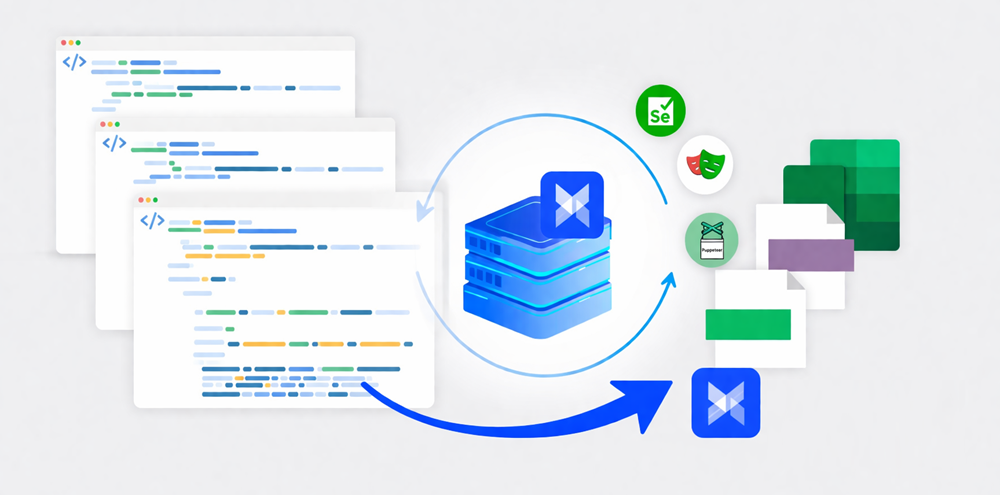

AdsPower Browser

Ang AdsPower ay nasa pagitan ng kadalian ng paggamit, pagkakapare-pareho ng profile, at kakayahang umangkop.

Ang nagpapaganda rito para sa scraping ay hindi ka nito pinipilit na pumili sa pagitan ng mga UI-based workflow at automation. Maaari mong biswal na buuin ang mga bagay-bagay, subukan ang mga ito, at pagkatapos ay lumipat sa automation mamaya.

- Malakas na pamamahala ng fingerprint na may higit sa 50 na mga parameter

- Madaling pag-setup ng proxy bawat profile

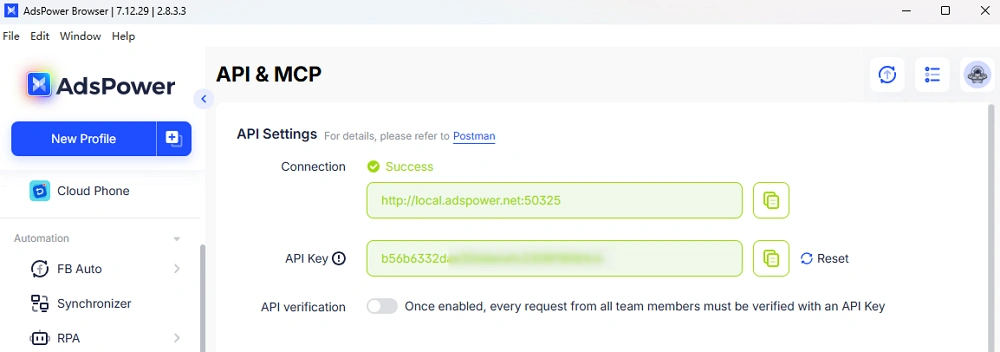

- Suporta sa API para sa automation

- May kasamang headless mode, na kapaki-pakinabang kapag gusto mong mag-scale nang hindi nagpapatakbo ng mga kumpletong browser instance

Mahalagang tandaan ang huling puntong iyan. Hindi maraming antidetect browser ang nag-aalok ng mga kakayahan na walang ulo sa paraang nagpapanatili pa rin ng pagkakapare-pareho ng fingerprint.

Para sa mga proyekto sa web scraping na nangangailangan ng parehong kontrol at scalability, ang AdsPower ay isang praktikal na pagpipilian.

Incogniton

Mas simple ang Incogniton. Hindi ito masyadong nag-a-abala, na mainam naman kung kailangan mo lang ng simpleng i-set up.

- Simpleng interface

- Maaasahang paghihiwalay ng profile

- Gumagana nang maayos para sa maliliit hanggang katamtamang laki ng mga setup

Maaaring hindi ito kasing lalim ng mas advanced na mga kagamitan, ngunit nagagawa nito ang trabaho nang walang gaanong alitan.

Mag-login

Mas nakadepende ang GoLogin sa mga cloud-based na workflow.

Kung nagpapatakbo ka ng mahahabang sesyon o namamahala ng mga pagkakakilanlan sa paglipas ng panahon, mahusay itong gumagana sa pagpapanatiling matatag ng mga bagay-bagay.

- Imbakan ng profile sa cloud

- Pare-parehong pagbuo ng fingerprint

- Gumagana sa iba't ibang makina

Para sa mga gawain sa pag-scrape kung saan mahalaga ang kasaysayan ng sesyon, maaaring maging kapaki-pakinabang ang pagkakapare-parehong iyon.

Pag-login nang maramihan

Ang multilogin ay karaniwang nakaposisyon bilang isang mas advanced na opsyon. Ito ay may mas mataas na gastos kumpara sa ilang alternatibo at karaniwang ginagamit ng mga pangkat na namamahala ng mas malalaking operasyon.

- Nag-aalok ng web-based browser

- Humahawak ng mataas na bilang ng mga profile ng browser na may pare-parehong pagganap

- Ito ay isang matagal nang antidetect browser

Kung gusto mong pamahalaan ang kapaligiran ng iyong account sa web, maaari mong isaalang-alang ang Multilogin browser.

Mga Browser na Walang Ulo (Mamamahayag / Manunulat ng Dula)

Kahit hindi sila mga antidetect browser, ang mga tool tulad ng Puppeteer at Playwright ay pangunahing bahagi pa rin ng karamihan sa mga scraping stack.

- Mabilis at mahusay

- Lubos na napapasadyang

- Mainam para sa malawakang pagkuha ng datos

Halata ang downside. Kung kusa lang, mas madali silang matukoy. Kung walang karagdagang pagsisikap, hindi nila malulutas ang mga problema sa fingerprint.

Kaya naman maraming setup ang pinagsasama ang mga ito sa mga antidetect browser sa halip na pumili ng isa kaysa sa isa.

Hindi pa rin sigurado kung ang AdsPower ay tama para sa iyo?

Magtanong sa mga nangungunang AI tool para makakuha ng agarang personalized na mga sagot para sa iyong mga pangangailangan

Antidetect Browser vs Headless Browser para sa Pag-scrape

Kung nakatrabaho mo na ang pareho, alam mo nang iba't ibang problema ang nalulutas nila.

Ang mga antidetect browser ay tungkol sa pagkakakilanlan, habang ang mga headless browser ay tungkol sa automation.

Browser na may Anti-detect:

- Mas mahusay sa pag-iwas sa pagtuklas

- Mas mabagal at mas mabigat

- Mas madaling mapanatili ang mahahabang sesyon

- Mas mabilis at mas malawak ang saklaw

- Nangangailangan ng karagdagang trabaho para sa nakatagong impormasyon

- Mas mainam para sa pagkuha ng hilaw na datos

Sa pagsasagawa, bihirang gamitin ng mga tao ang isa lamang. Ganito ang karaniwang pagkakaayos:

--Gamitin ang antidetect browser upang lumikha at magpanatili ng mga sesyon

--Gumamit ng mga headless tool para kumuha ng data kapag stable na ang mga session

Ang kombinasyong iyan ay may posibilidad na maging mas maaasahan kaysa sa pagsisikap na pilitin ang isang tool na gawin ang lahat.

AdsPower + AI Agents: Ang Kinabukasan ng Web Scraping

Isang bagay na magsisimulang magbago sa 2026 ay kung paano binubuo ang mga scraping workflow.

Sa halip na mga hardcoded script, mas maraming team ang nag-eeksperimento sa mga AI agent na mas flexible na makakapag-navigate sa mga website. Hindi sila lubos na umaasa sa mga fixed selector o rigid flow.

Kapag isinama sa AdsPower, nagiging mas kawili-wili ito:

- Ang bawat ahente ay tumatakbo sa loob ng sarili nitong profile sa browser

- Nananatiling pare-pareho ang mga fingerprint

- Ang pag-uugali ay mukhang hindi gaanong nakabalangkas at mas natural

Binabawasan nito ang maintenance. Kapag nagbago ang layout ng isang site, hindi mo laging kailangang isulat muli ang lahat mula sa simula.

Ito ay patuloy pa ring nagbabago, ngunit medyo malinaw ang direksyon. Ang scraping ay patungo sa mga sistemang umaangkop, hindi lamang basta nagsasagawa.

Paano Gumamit ng Antidetect Browser para sa Web Scraping

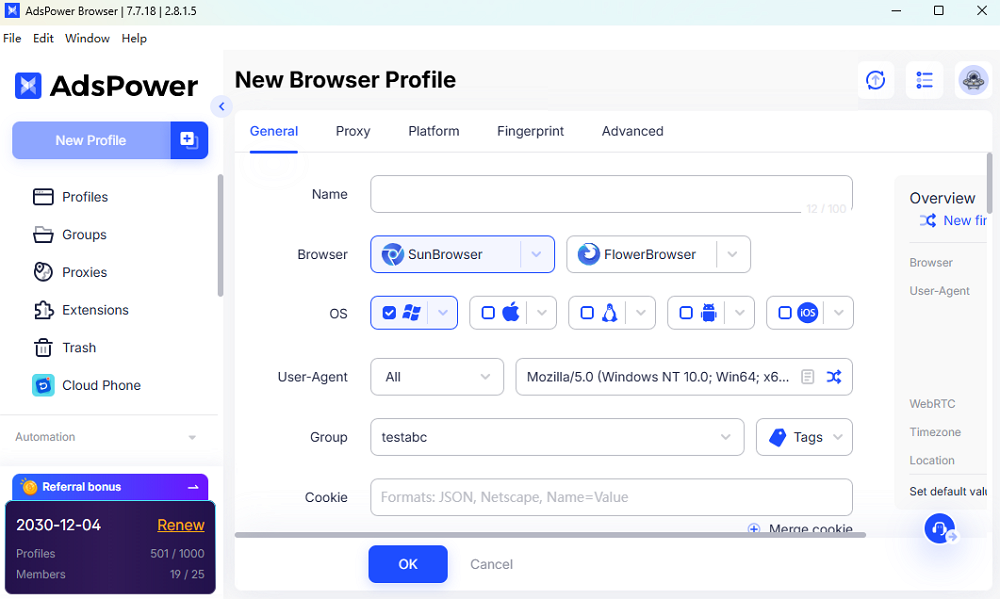

Hindi kailangang maging kumplikado ang isang karaniwang pag-setup. Sundin ang mga hakbang para mag-set up para sa ligtas na web scraping.

● Gumawa ng maraming profile sa browser

Mag-set up ng platform at magtalaga ng iba't ibang fingerprint. Kung hindi mo alam kung paano ito i-set up, maaari mo itong panatilihin sa default o makipag-ugnayan sa amin.

● Mag-set up ng mga proxy

Karaniwang mas mahusay ang paggana ng mga residential o mobile proxy

● Mag-log in kung kinakailangan

I-save ang mga sesyon para hindi mo na ulitin ang parehong mga aksyon

● Awtomasyon sa pagkonekta

Gumamit ng API o mga panlabas na tool tulad ng Puppeteer

● Dahan-dahang i-scale

Huwag lumipat mula 1 hanggang 100 sesyon sa magdamag

● Subaybayan ang mga resulta

Magbantay para sa mga bloke, error, o hindi pangkaraniwang mga pattern

Karamihan sa mga isyu ay nagmumula sa napakabilis na pag-scale, hindi sa mismong tool.

Konklusyon

Ang web scraping noong 2026 ay ibang-iba na ngayon kumpara noong ilang taon na ang nakalilipas. Hindi na lamang ito tungkol sa mahusay na pagkolekta ng datos, kundi tungkol din sa pagpapanatili ng matatag at kapani-paniwalang mga sesyon sa paglipas ng panahon. Ang pagbabagong ito ang dahilan kung bakit naging mas karaniwan ang mga antidetect browser sa mga totoong daloy ng trabaho. Hindi nila mahiwagang nilulutas ang bawat problema, ngunit binabawasan din nila ang maraming alitan na nagmumula sa mga hindi pagkakatugma ng fingerprint, mga pag-reset ng sesyon, at paulit-ulit na pagharang. Kapag isinama sa mga proxy at mga tool sa automation, ginagawa nitong mas matatag at mas madaling unti-unting i-scale ang mga scraping setup.

Ang mga antidetect browser ay naging isang praktikal na layer sa pagkamit ng katatagang iyon, lalo na kapag ipinares sa mga proxy at automation. Kasabay nito, ang mga headless solution ay nananatiling mahalaga para sa mga gawaing may mataas na volume kung saan pinakamahalaga ang kahusayan. Sa halip na umasa sa iisang diskarte, ang pagsasama-sama ng parehong estratehiya ay kadalasang naghahatid ng mas mahusay na mga resulta. Ang pagbuo ng isang scraping system ngayon ay nangangahulugan ng pag-iisip nang higit pa sa mga script—ito ay tungkol sa pamamahala ng mga kapaligiran na maaaring tumakbo nang maayos, unti-unting lumawak, at manatili sa ilalim ng radar.

Mga Madalas Itanong

Kailangan ba ng antidetect browser para sa web scraping?

Hindi palagi. Para sa maliitan o pampublikong pagkuha ng datos, kadalasan ay nakakaraos ka nang wala ito. Ngunit kapag humawak ka na ng mga account, paulit-ulit na sesyon, o mas maraming volume, nagiging mas mahirap nang maiwasan ang mga pagharang nang walang anumang uri ng pamamahala ng pagkakakilanlan.

Ano ang pinakamahusay na browser para sa pag-scrape?

Walang iisang sagot na akma sa lahat, ngunit ang AdsPower ay namumukod-tangi bilang isang matibay na pagpipilian para sa maraming gumagamit. Pinagsasama nito ang fingerprint isolation, flexible proxy management, at mga feature ng automation, kaya naman angkop ito para sa scalable at stable na web scraping workflows.

Pwede ko bang gamitin ang headless browser nang mag-isa?

Oo, pero may mga limitasyon ito. Mabilis at flexible ang mga headless browser, pero mas madaling matukoy nang walang karagdagang configuration. Para sa mas matatag na resulta, madalas itong pinagsama sa mga antidetect browser at wastong proxy setup. Bukod dito, ang ilang browser tulad ng AdsPower ay nagbibigay din ng headless mode para sa scraping.

Binabasa din ng mga tao

- Paliwanag sa Browser Polygraph: Bakit Nalampasan ng AdsPower ang mga Modernong Sistema ng Pagtuklas

Paliwanag sa Browser Polygraph: Bakit Nalampasan ng AdsPower ang mga Modernong Sistema ng Pagtuklas

Tuklasin kung paano pinapatunayan ng pag-aaral ng pananaliksik ng IMC '24 ng ASU at Amazon ang pagkakapare-pareho sa antas ng kernel ng AdsPower. Alamin kung bakit ang AdsPower lamang ang browser na nag-pa

- Pinakamahusay na Mga Agentic Browser sa 2026: Mga Tampok, Presyo at Paghahambing

Pinakamahusay na Mga Agentic Browser sa 2026: Mga Tampok, Presyo at Paghahambing

Kapag naghahanap ka ng pinakamahusay na agentic browser para sa automation workflow, tingnan ang review na ito ng agentic AI browser at subukan ang mga ito bago ka magsimula.

- Pinakamahusay na Mga Tool sa Pag-scrape ng Web para sa 2026: Isang Gabay sa Pagkuha ng Mataas na Dami ng Data

Pinakamahusay na Mga Tool sa Pag-scrape ng Web para sa 2026: Isang Gabay sa Pagkuha ng Mataas na Dami ng Data

Tuklasin ang pinakamahusay na mga web scraping tool para sa 2026, kabilang ang mga API, browser, at AI tool, kasama ang mga tip para mapalawak ang pagkuha ng data nang hindi naharang.

- AI Agentic Browser vs Tradisyonal na Awtomasyon ng Browser: Alin ang Dapat Mong Gamitin?

AI Agentic Browser vs Tradisyonal na Awtomasyon ng Browser: Alin ang Dapat Mong Gamitin?

AI agentic browser vs tradisyonal na automation: paghambingin ang mga feature, use case, at scalability. Alamin kung kailan gagamitin ang bawat isa at kung paano bumuo ng mas matalinong mga workflow

- Ang 9 na Pinakamahusay na Ahente ng AI sa 2026 at Paano Ligtas na Patakbuhin ang Automation

Ang 9 na Pinakamahusay na Ahente ng AI sa 2026 at Paano Ligtas na Patakbuhin ang Automation

Tuklasin ang 9 na pinakamahusay na AI agent sa 2026 at alamin kung paano ligtas na mag-automate gamit ang AdsPower. Paghambingin ang mga tool, mga pagkakataon ng paggamit, at palakihin nang walang mga pagbabawal sa account.