2026 के लिए सर्वश्रेष्ठ वेब स्क्रैपिंग उपकरण: उच्च मात्रा में डेटा निष्कर्षण के लिए एक मार्गदर्शिका

एक त्वरित नज़र डालें

बड़े पैमाने पर डेटा स्क्रैपिंग शुरू करते ही सब कुछ अप्रत्याशित हो जाता है। अनुरोध ब्लॉक होने लगते हैं, सेशन टिकते नहीं हैं, और वेब स्क्रैपिंग में CAPTCHA से बचने का तरीका एक गंभीर समस्या बन जाता है, न कि कोई अपवाद। जो तरीका छोटे स्तर पर ठीक काम करता था, वह धीमा पड़ने लगता है या पूरी तरह से काम करना बंद कर देता है। उस समय, स्क्रैपिंग का मतलब सिर्फ HTML डेटा निकालना नहीं रह जाता, बल्कि इसमें पहचान प्रबंधित करना, गतिशील पेजों को संभालना और लगातार दबाव में भी अपने सिस्टम को स्थिर रखना शामिल हो जाता है। यह गाइड इस बात पर केंद्रित है कि इन परिस्थितियों में वास्तव में क्या काम करता है, और क्यों कई सेटअप इस स्तर तक पहुंचने से पहले ही विफल हो जाते हैं।

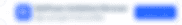

वेब स्क्रैपिंग टूल्स का बड़े पैमाने पर उपयोग करने में विफल होने का कारण क्या है?

वेब स्क्रैपिंग में सबसे बड़ी गलतफहमी यह है कि छोटे पैमाने पर मिली सफलता बड़े पैमाने पर विश्वसनीयता की गारंटी देती है। ऐसा नहीं है।

आमतौर पर यहीं से चीजें बिगड़ने लगती हैं:

- आईपी ब्लॉकिंग तेजी से बढ़ रही है

प्रति मिनट कुछ अनुरोध? ठीक है। प्रति घंटे हजारों अनुरोध? आपको तुरंत चेतावनी मिल जाएगी।

- फिंगरप्रिंट डिटेक्शन आईपी आईडी से कहीं आगे तक जाता है।

आधुनिक वेबसाइटें न केवल आपके आईपी पते को ट्रैक करती हैं, बल्कि वे ब्राउज़र फ़िंगरप्रिंट, व्यवहार पैटर्न और सत्र की स्थिरता का विश्लेषण भी करती हैं।

- गतिशील सामग्री से सब कुछ जटिल हो जाता है।

जावास्क्रिप्ट पर आधारित वेबसाइटों के लिए ब्राउज़र में पूरी तरह से रेंडरिंग की आवश्यकता होती है। साधारण HTTP अनुरोध अब काम नहीं आएंगे।

- कैप्चा पाइपलाइन को बाधित करते हैं

बड़े पैमाने पर, कैप्चा चुनौतियां कभी-कभार नहीं होतीं, बल्कि निरंतर होती हैं।

- रखरखाव का काम पूर्णकालिक नौकरी बन जाता है

लेआउट में बदलाव, एंटी-बॉट अपडेट और दर सीमाएं निरंतर समायोजन को बाध्य करती हैं।

संक्षेप में कहें तो, बड़े पैमाने पर डेटा स्क्रैप करना केवल कोडिंग की समस्या नहीं है। यह बुनियादी ढांचे और गोपनीयता की समस्या है।

वेब स्क्रैपिंग टूल्स के प्रकार

सही उपकरण का चुनाव आपकी तकनीकी कुशलता, मात्रा संबंधी आवश्यकताओं और रखरखाव की सहनशीलता पर निर्भर करता है। आइए मुख्य श्रेणियों को विस्तार से समझते हैं।

1. कोड-आधारित फ्रेमवर्क

यह मूल रूप से स्वयं बनाने का तरीका है। यदि आपने कभी भी स्क्रैपर को शुरू से बनाया है, तो संभवतः आपने यहीं से शुरुआत की होगी। यह आपको पूर्ण नियंत्रण देता है, लेकिन इसका मतलब यह भी है कि हर चीज की जिम्मेदारी आपकी ही होगी।

इसके लिए सर्वोत्तम:

- वे डेवलपर जो हर छोटी-बड़ी बात पर नियंत्रण रखना चाहते हैं

- ऐसे प्रोजेक्ट जो तैयार उपकरणों में फिट नहीं होते

- अधिक जटिल स्क्रैपिंग लॉजिक

फायदे:

- आप लगभग हर चीज को अपनी पसंद के अनुसार अनुकूलित कर सकते हैं।

- अपने सिस्टम में आसानी से प्लग इन करें

- डेटा को एकत्र करने और संसाधित करने के तरीके पर पूर्ण नियंत्रण।

दोष:

- कोडिंग की आवश्यकता है (स्पष्टतः)।

- समय के साथ रखरखाव का काम मुश्किल हो सकता है।

- आपको प्रॉक्सी, कैप्चा आदि के लिए अतिरिक्त टूल की आवश्यकता पड़ सकती है।

2. नो-कोड / विज़ुअल स्क्रैपर्स (शुरुआती लोगों के लिए सर्वश्रेष्ठ)

ये उपकरण गति और सरलता पर अधिक केंद्रित हैं। आपको कोड लिखने की आवश्यकता नहीं है, बस क्लिक करके यह परिभाषित करें कि आप क्या निकालना चाहते हैं।

इसके लिए सर्वोत्तम:

- तकनीकी पृष्ठभूमि के बिना लोग

- छोटे या त्वरित स्क्रैपिंग कार्य

- विचारों का तेजी से परीक्षण करना

फायदे:

- उठाना आसान है

- किसी चीज को जल्दी से चालू कर देना

- कोडिंग की आवश्यकता नहीं है

दोष:

- बहुत लचीला नहीं

- जटिल या गतिशील साइटों पर आसानी से टूट जाता है

- यह अच्छी तरह से स्केल नहीं होता है

3. एपीआई स्क्रैपिंग (बिना रखरखाव के स्केल करने के लिए सर्वोत्तम)

स्क्रैपिंग API अधिकांश कठिन कार्यों को संभाल लेते हैं। आप एक अनुरोध भेजते हैं, और वे प्रॉक्सी, पुनः प्रयास और कभी-कभी पर्दे के पीछे रेंडरिंग का भी प्रबंधन करते हैं। यदि आप यह समझना चाहते हैं कि यह व्यवहार में कैसे काम करता है, विशेष रूप से बड़े पैमाने पर, तो बिना अवरुद्ध हुए वेब स्क्रैपिंग के लिए प्रॉक्सी का उपयोग करने के बारे में जानना उपयोगी होगा।

इसके लिए सर्वोत्तम:

- वे टीमें जो बुनियादी ढांचे का प्रबंधन नहीं करना चाहतीं

- उच्च मात्रा में खुरचनी

- तेज़ तैनाती

फायदे:

- आईपी रोटेशन स्वचालित रूप से नियंत्रित होता है।

- अंतर्निर्मित पुनः प्रयास तर्क

- अक्सर हेडलेस ब्राउज़र को सपोर्ट करता है

दोष:

- खर्चे बढ़ते जा सकते हैं

- प्रक्रिया पर कम नियंत्रण

- आप किसी तृतीय-पक्ष सेवा से जुड़े हुए हैं।

4. एआई वेब स्क्रैपिंग टूल्स (उभरता हुआ चलन)

यह एक नया तरीका है। इसमें सेलेक्टर लिखने के बजाय, आपको बस यह बताना होता है कि आपको कौन सा डेटा चाहिए, और टूल उसे ढूंढने की कोशिश करता है।

इसके लिए सर्वोत्तम:

- त्वरित प्रयोग

- अव्यवस्थित या बार-बार बदलते लेआउट

- सेटअप में लगने वाले समय की बचत

फायदे:

- पेज संरचनाओं में बदलाव होने पर यह अनुकूलित हो सकता है।

- कम मैन्युअल समायोजन

- शुरुआत करना तेज़ है

दोष:

- हमेशा सटीक नहीं

- अभी भी विकास जारी है

- एंटी-बॉट सिस्टम के साथ समस्या हो सकती है

5. ब्राउज़र स्क्रैप करना

यहीं से चीजें अधिक "वास्तविक दुनिया" जैसी लगने लगती हैं। केवल अनुरोध भेजने के बजाय, ये उपकरण वास्तविक उपयोगकर्ताओं की तरह काम करने की कोशिश करते हैं।

वे फिंगरप्रिंट, कुकीज़, सेशन, मूल रूप से वह सब कुछ प्रबंधित करते हैं जो एक सामान्य ब्राउज़र करता है।

इसके लिए सर्वोत्तम:

- पकड़े जाने से बचना

- एकाधिक खाते चलाना

- संरक्षित प्लेटफार्मों से सामग्री निकालना

फायदे:

- यह असली उपयोगकर्ता की तरह व्यवहार करता है।

- सत्रों को सुसंगत रखता है

- ब्लॉक और प्रतिबंध कम करने में मदद करता है

दोष:

- इसे ठीक से स्थापित करने में समय लगता है

- आमतौर पर अन्य उपकरणों के साथ मिलकर उपयोग किया जाता है

वेब स्क्रैपिंग के लिए आपको जिन बेहतरीन टूल्स का इस्तेमाल करना चाहिए

जब आप भारी मात्रा में डेटा प्रोसेसिंग शुरू करते हैं, तो हर स्क्रैपिंग टूल अच्छा प्रदर्शन नहीं करता। कुछ टूल देखने में तो अच्छे लगते हैं, लेकिन दबाव पड़ने पर नाकाम हो जाते हैं। नीचे दिए गए टूल वे हैं जिन पर लोग लगातार और बड़े पैमाने पर काम करने के लिए भरोसा करते हैं।

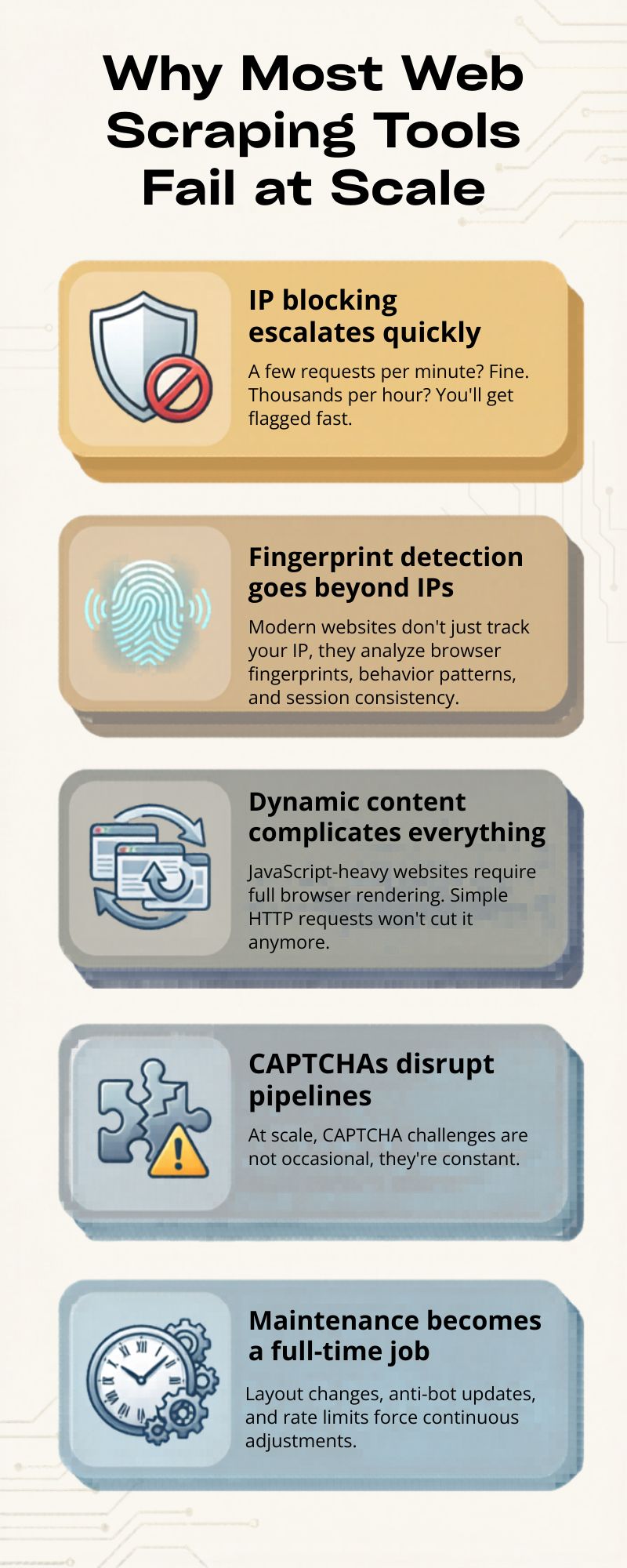

1. विज्ञापन शक्ति

जब आप मजबूत एंटी-बॉट सिस्टम वाले प्लेटफॉर्म से डेटा स्क्रैप कर रहे होते हैं, तो AdsPower जैसे टूल लगभग आवश्यक हो जाते हैं।

यह सामान्य अर्थों में सिर्फ एक ब्राउज़र नहीं है; इसे वास्तविक उपयोगकर्ता वातावरण का अनुकरण करने के लिए बनाया गया है, जो तब बहुत मायने रखता है जब आप किसी की नज़र में आए बिना काम करने की कोशिश कर रहे हों।

जानने योग्य मुख्य बातें:

- प्रत्येक प्रोफ़ाइल की अपनी अलग पहचान होती है।

- प्रोफाइल अलग-अलग भौतिक उपकरणों की तरह व्यवहार करते हैं।

- वर्कफ़्लो को स्वचालित करने के लिए RPA का समर्थन करता है

- कैप्चा सॉल्वर को एकीकृत कर सकता है

- कुकीज़ और स्थानीय संग्रहण के साथ सत्रों को स्थिर रखता है

अधिक मात्रा में डेटा आने पर, अनुरोध की गति बढ़ाने की तुलना में यह तरीका बेहतर काम करता है। आप जबरदस्ती आगे नहीं बढ़ रहे हैं; आप सहजता से घुलमिल रहे हैं। ई-कॉमर्स, सोशल मीडिया या मार्केटप्लेस स्क्रैपिंग के लिए, इसका अक्सर मतलब होता है कम प्रतिबंध और कम डाउनटाइम।

2. खुरचने वाला कुत्ता

Scrapingdog चीजों को सरल रखता है, और यही कारण है कि कुछ टीमें इसे पसंद करती हैं।

यह किन चीजों में अच्छा है:

- यह पर्दे के पीछे प्रॉक्सी और रेंडरिंग का प्रबंधन करता है।

- संरचित डेटा निष्कर्षण के लिए विश्वसनीय रूप से कार्य करता है

- साफ़ और सरल एपीआई

यदि आप बुनियादी ढांचे की स्थापना के झंझट में नहीं पड़ना चाहते और केवल एक ऐसी चीज चाहते हैं जो काम करे, तो यह एक उचित विकल्प है।

3. स्क्रैपर एपीआई

ScraperAPI का मुख्य ध्यान स्थिरता पर है, बाकी किसी भी चीज़ से ज़्यादा।

मुख्य विशेषताएं:

- स्वचालित आईपी रोटेशन

- CAPTCHA को संभालने की अंतर्निहित सुविधा

- बड़े पैमाने पर उच्च सफलता दर के लिए डिज़ाइन किया गया

यह उन निरंतर स्क्रैपिंग कार्यों के लिए उपयुक्त है जहां अनुकूलन की तुलना में निरंतरता अधिक मायने रखती है।

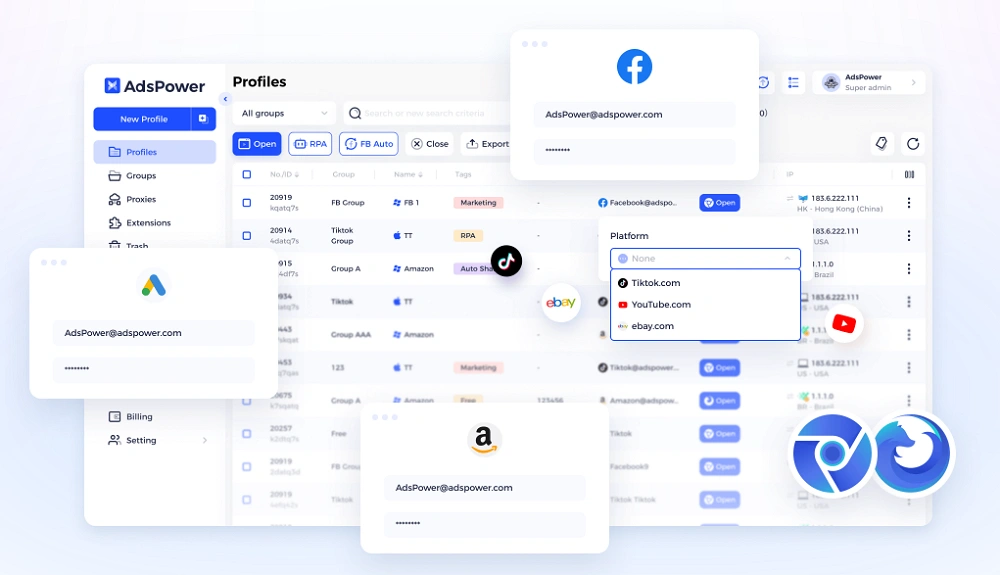

4. ब्राइट डेटा

ब्राइट डेटा उन्नत श्रेणी की कंपनियों में से एक है।

आपको क्या मिलता है:

- बड़ा प्रॉक्सी नेटवर्क (आवासीय, मोबाइल, डेटासेंटर)

- बारीक लक्ष्यीकरण विकल्प

- अतिरिक्त डेटा संग्रह सेवाएं

इसे स्थापित करना सबसे आसान उपकरण नहीं है, और इसकी कीमत भी इसी के अनुरूप है। लेकिन बड़े व्यवसायों के लिए, यह बेजोड़ कवरेज प्रदान करता है।

5. एपिफाई

Apify एक ऐसा टूल है जिसे लोग अक्सर सरल विकल्पों को आजमाने के बाद इस्तेमाल करना शुरू कर देते हैं। यह समय बचाता है, लेकिन फिर भी जरूरत पड़ने पर आपको इसमें बदलाव करने की सुविधा देता है।

- सामान्य स्क्रैपिंग कार्यों के लिए तैयार "एक्टर" उपलब्ध हैं।

- यह सब कुछ क्लाउड पर चलाता है, इसलिए आपको सर्वर प्रबंधित करने की आवश्यकता नहीं है।

- कार्यभार बढ़ने पर इसे आसानी से बढ़ाया जा सकता है।

- साझा उपकरणों और टेम्पलेट्स के साथ एक अच्छा इकोसिस्टम।

यह बहुत जटिल नहीं है, लेकिन पूरी तरह से प्लग-एंड-प्ले भी नहीं है, बल्कि इन दोनों के बीच की स्थिति में है, जो कई टीमों के लिए अच्छी तरह से काम करती है।

6. नाटककार

प्लेराइट एक डेवलपर टूल है, और यह बात स्पष्ट है। इसका व्यापक रूप से उपयोग इसलिए किया जाता है क्योंकि यह आधुनिक वेबसाइटों के साथ विश्वसनीय रूप से काम करता है।

- क्रोमियम, फ़ायरफ़ॉक्स और वेबकिट को सपोर्ट करता है

- यह डायनामिक पेजों और भारी जावास्क्रिप्ट को काफी अच्छे से संभालता है।

- लंबे समय तक चलने वाले स्वचालन के लिए पर्याप्त रूप से स्थिर

- व्यवहार को अनुकूलित करने की आवश्यकता होने पर यह लचीला है।

अधिकांश कस्टम स्क्रैपिंग सेटअप अंततः आंतरिक रूप से कुछ इसी तरह की चीज़ का उपयोग करते हैं।

7. ऑक्टोपार्स

जब लोग कोड से बिल्कुल भी निपटना नहीं चाहते हैं, तो वे आमतौर पर ऑक्टोपार्स का उपयोग करने का विकल्प चुनते हैं।

- दृश्य इंटरफ़ेस, मुख्यतः पॉइंट-एंड-क्लिक आधारित

- बुनियादी स्क्रैपिंग कार्यों को जल्दी से शुरू किया जा सकता है

- छोटे प्रोजेक्ट या एक बार के कामों के लिए उपयुक्त।

- इसमें सामान्य वेबसाइटों के लिए टेम्पलेट शामिल हैं।

शुरुआत में यह सुविधाजनक होता है, लेकिन जब चीजें अधिक जटिल या अधिक मात्रा में हो जाती हैं, तो यह सीमित महसूस हो सकता है।

त्वरित तुलना तालिका

इस स्तर पर, यह स्पष्ट है कि ऐसा कोई एक उपकरण नहीं है जो हर काम पूरी तरह से कर सके। कुछ उपयोग में आसान हैं, कुछ अधिक नियंत्रण प्रदान करते हैं, और कुछ विशेष रूप से स्केलिंग के लिए बनाए गए हैं।

इस बारे में ज्यादा सोचने के बजाय, इनकी तुलना साथ-साथ करना मददगार होता है, खासकर जब वेब स्क्रैपिंग के लिए सबसे अच्छे एंटी-डिटेक्ट ब्राउज़र जैसे टूल की तुलना कर रहे हों। नीचे दी गई तालिका से आपको यह समझने में आसानी होगी कि इनमें से प्रत्येक टूल किस श्रेणी में आता है और आमतौर पर इसका उपयोग किस लिए किया जाता है।

औजार | प्रकार | के लिए सर्वश्रेष्ठ | ताकत |

विज्ञापन शक्ति | स्क्रैपिंग ब्राउज़र | एंटी-डिटेक्शन और स्केलिंग | फिंगरप्रिंट अलगाव |

स्क्रैपिंगडॉग | एपीआई | सरल स्क्रैपिंग कार्य | उपयोग में आसानी |

स्क्रैपरएपीआई | एपीआई | बड़े पैमाने पर पाइपलाइन | विश्वसनीयता |

ब्राइट डेटा | एपीआई / प्रॉक्सी नेटवर्क | एंटरप्राइज स्क्रैपिंग | कवरेज |

एपीफाई | प्लैटफ़ॉर्म | स्वचालन + स्क्रैपिंग | FLEXIBILITY |

नाटककार | रूपरेखा | अनुकूलित समाधान | नियंत्रण |

ऑक्टोपार्स | नो-कोड | शुरुआती | सादगी |

अंतिम विचार

अब तक यह बात काफी हद तक स्पष्ट हो चुकी है कि 2026 में वेब स्क्रैपिंग का मतलब सिर्फ एक बेहतरीन टूल ढूंढकर काम खत्म कर देना नहीं है। असल में, व्यवहार में जो तरीका कारगर साबित होता है, वह है कई टूल्स का संयोजन, जिनमें से प्रत्येक प्रक्रिया के एक अलग हिस्से को संभालता है। एक लेयर ऑटोमेशन को संभाल सकती है, दूसरी प्रॉक्सी और रिक्वेस्ट को, और तीसरी सेशन और आइडेंटिटी मैनेजमेंट को। आमतौर पर, एक सामान्य सेटअप में ब्राउज़र को नियंत्रित करने के लिए Playwright जैसा कोई टूल, इंफ्रास्ट्रक्चर को संभालने के लिए ScraperAPI या Bright Data जैसी स्क्रैपिंग API, और फिंगरप्रिंट को मैनेज करने और सेशन को स्थिर रखने के लिए AdsPower जैसा कोई टूल शामिल होता है। इनमें से कोई भी टूल दूसरे का विकल्प नहीं है; ये सभी मिलकर काम करते हैं।

अगर कोई एक बात याद रखने लायक है, तो वो ये है कि पकड़े न जाने की क्षमता गति से ज़्यादा ज़रूरी है। अगर बीच में ही रुकावट आ जाए तो ज़्यादा रिक्वेस्ट भेजने से कोई फ़ायदा नहीं। धीमा लेकिन ज़्यादा स्थिर सिस्टम लगभग हमेशा ही तेज़ सिस्टम से बेहतर प्रदर्शन करेगा। स्थिरता पर ध्यान दें, और समय के साथ स्केलिंग बहुत आसान हो जाएगी।

पूछे जाने वाले प्रश्न

स्क्रैपिंग वर्कफ़्लो में CAPTCHA को कैसे हैंडल करें?

बड़े पैमाने पर, CAPTCHA अपरिहार्य हैं, इसलिए लक्ष्य उन्हें पूरी तरह से खत्म करने के बजाय उनका प्रबंधन करना है। अधिकांश सेटअप अनुरोध दरों को धीमा करके, सत्रों का पुन: उपयोग करके और वास्तविक उपयोगकर्ता व्यवहार की नकल करके CAPTCHA ट्रिगर्स को कम करते हैं। इसके अलावा, कई टीमें मैन्युअल इनपुट के बिना वर्कफ़्लो को सुचारू रूप से चलाने के लिए CAPTCHA-समाधान सेवाओं को एकीकृत करती हैं। व्यवहार में, किसी एक समाधान पर निर्भर रहने के बजाय, प्रॉक्सी, समय और व्यवहार जैसी तकनीकों का मिश्रण चीजों को स्थिर रखने में मदद करता है।

बड़े पैमाने पर CAPTCHA अधिक बार क्यों दिखाई देता है?

जब डेटा स्क्रैपिंग की मात्रा बढ़ती है, तो वेबसाइटों के लिए पैटर्न का पता लगाना आसान हो जाता है। बार-बार होने वाली गतिविधियाँ, एक जैसे अनुरोध या असामान्य समय तुरंत संदेह पैदा कर सकते हैं। CAPTCHA का उपयोग यह सत्यापित करने के लिए किया जाता है कि ट्रैफ़िक मानव द्वारा भेजा गया है या नहीं, इसलिए आपका व्यवहार जितना अधिक "बॉट जैसा" दिखेगा, CAPTCHA उतनी ही अधिक बार दिखाई देगा। यही कारण है कि स्केलिंग का मतलब केवल अधिक अनुरोध भेजना नहीं है, बल्कि उन अनुरोधों को कम अनुमानित और वास्तविक उपयोगकर्ताओं के समान बनाना है।

आपके स्क्रैपिंग स्टैक को फिंगरप्रिंट सुरक्षा की आवश्यकता क्यों है?

अब सिर्फ प्रॉक्सी ही काफी नहीं हैं। वेबसाइटें अब बॉट्स का पता लगाने के लिए ब्राउज़र फ़िंगरप्रिंट , डिवाइस सेटिंग्स और व्यवहार पैटर्न का विश्लेषण करती हैं। फ़िंगरप्रिंट सुरक्षा के बिना, बदलते आईपी पते भी पकड़े जा सकते हैं। अलग-अलग ब्राउज़र वातावरण बनाकर, फ़िंगरप्रिंट टूल हर सेशन को ज़्यादा वास्तविक और सुसंगत बनाते हैं। इससे ब्लॉक कम होते हैं और स्क्रैपिंग वर्कफ़्लो सुचारू रूप से चलता रहता है, खासकर ज़्यादा मात्रा में डेटा ट्रांसफर होने पर।

लोग यह भी पढ़ें

- ब्राउजर पॉलीग्राफ की व्याख्या: एड्सपावर आधुनिक पहचान प्रणालियों को कैसे पार करता है?

ब्राउजर पॉलीग्राफ की व्याख्या: एड्सपावर आधुनिक पहचान प्रणालियों को कैसे पार करता है?

जानिए कैसे ASU और Amazon द्वारा किए गए IMC '24 शोध अध्ययन से AdsPower की कर्नेल-स्तरीय स्थिरता प्रमाणित होती है। जानिए क्यों AdsPower एकमात्र ऐसा ब्राउज़र था जिसने इसे प्रमाणित किया।

- 2026 के सर्वश्रेष्ठ एजेंटिक ब्राउज़र: विशेषताएं, मूल्य निर्धारण और तुलना

2026 के सर्वश्रेष्ठ एजेंटिक ब्राउज़र: विशेषताएं, मूल्य निर्धारण और तुलना

जब आप ऑटोमेशन वर्कफ़्लो के लिए सर्वश्रेष्ठ एजेंटिक ब्राउज़र की तलाश कर रहे हों, तो इस एजेंटिक एआई ब्राउज़र समीक्षा को देखें और शुरू करने से पहले उनका परीक्षण करें।

- 2026 में वेब स्क्रैपिंग के लिए सर्वश्रेष्ठ एंटीडिटेक्ट ब्राउज़र

2026 में वेब स्क्रैपिंग के लिए सर्वश्रेष्ठ एंटीडिटेक्ट ब्राउज़र

2026 में वेब स्क्रैपिंग के लिए सर्वश्रेष्ठ एंटीडिटेक्ट ब्राउज़र खोजें। शीर्ष टूल, प्रमुख विशेषताओं की तुलना करें और जानें कि कैसे पकड़े जाने से बचा जाए और अपनी स्क्रैपिंग को बढ़ाया जाए।

- एआई एजेंटिक ब्राउज़र बनाम पारंपरिक ब्राउज़र स्वचालन: आपको किसका उपयोग करना चाहिए?

एआई एजेंटिक ब्राउज़र बनाम पारंपरिक ब्राउज़र स्वचालन: आपको किसका उपयोग करना चाहिए?

एआई एजेंटिक ब्राउज़र बनाम पारंपरिक स्वचालन: विशेषताओं, उपयोग के मामलों और स्केलेबिलिटी की तुलना करें। जानें कि प्रत्येक का उपयोग कब करना है और बेहतर वर्कफ़्लो कैसे बनाना है।

- 2026 के 9 सर्वश्रेष्ठ एआई एजेंट और सुरक्षित रूप से स्वचालन चलाने के तरीके

2026 के 9 सर्वश्रेष्ठ एआई एजेंट और सुरक्षित रूप से स्वचालन चलाने के तरीके

2026 के 9 सर्वश्रेष्ठ AI एजेंटों को जानें और AdsPower के साथ सुरक्षित रूप से स्वचालन करना सीखें। उपकरणों, उपयोग के मामलों की तुलना करें और खाता प्रतिबंधित किए बिना विस्तार करें।