Beste browser met antidetectie voor webscraping in 2026

Neem een snelle blik

Ontdek de beste browsers met antidetecteerfunctie voor webscraping in 2026, verbeter de stabiliteit, voorkom detectie en schaal efficiënt... lees verder om vandaag nog de juiste tool voor jouw workflow te vinden.

Web scraping is enorm veranderd. Nog niet zo lang geleden kon je met een eenvoudig script gegevens verzamelen zonder veel moeite. Nu monitoren de meeste platforms veel meer signalen achter de schermen, van je browserfingerprint tot hoe je met een pagina interacteert, zelfs de timing tussen acties. Wanneer iets niet natuurlijk aanvoelt, kunnen er bijna onmiddellijk beperkingen of blokkeringen optreden. Daarom zoeken veel ontwikkelaars naar manieren om web scraping te doen zonder geblokkeerd te worden in plaats van te vertrouwen op eenvoudige scripts.

Hier komen antidetect-browsers in beeld. In plaats van detectieproblemen constant op te lossen nadat ze zich voordoen, stellen ze je in staat om te beginnen met een realistischer configuratie, met behulp van aparte identiteiten, stabiele sessies en gedrag dat meer lijkt op dat van echte gebruikers. In deze gids leggen we uit hoe ze werken en welke tools in 2026 daadwerkelijk de moeite waard zijn om te overwegen.

Waarom modern webscrapen een browser met antidetectie vereist

Wat er echt veranderd is in web scraping, zijn niet de tools die mensen gebruiken, maar de manier waarop websites zich daartegen verzetten.

De meeste platforms combineren tegenwoordig meerdere detectielagen tegelijk. In plaats van alleen verzoeken te controleren, kijken ze naar de algehele context van uw activiteit, waaronder:

- Browser-fingerprintgegevens zoals canvas, WebGL, lettertypen en apparaatspecificaties.

- Gedragssignalen zoals muisbewegingen en scrollpatronen

- IP-reputatie en aanvraagfrequentie

- Sessiecontinuïteit, inclusief cookies en consistentie van de header

Het probleem is dat alles perfect op elkaar moet aansluiten. Je kunt volkomen geldige verzoeken versturen, maar als er iets niet klopt aan je configuratie, valt dat op. Een simpele discrepantie tussen je user agent en WebGL-fingerprint kan al argwaan wekken. Als dat gebeurt terwijl je herhaaldelijk verzoeken vanaf hetzelfde IP-adres verstuurt, volgen blokkeringen meestal vrij snel.

Dit is waar browsers met anti-detectiefuncties het verschil maken. Ze verminderen die inconsistenties door je meer controle over de omgeving te geven:

- Elk browserprofiel werkt met zijn eigen vingerafdruk.

- Sessies blijven consistent, ongeacht cookies, opslag of headers.

- De algehele configuratie gedraagt zich meer als een echte gebruikersomgeving.

Uiteindelijk is het doel simpel. In plaats van eruit te zien als een script dat op de achtergrond draait, moet je configuratie opgaan in de normale gebruikersactiviteit, en dat is precies wat ervoor zorgt dat scraping-workflows langer blijven draaien.

Wat is een antidetect-browser voor webscraping?

Een antidetect-browser is een browser waarmee je meerdere geïsoleerde profielen kunt gebruiken, elk met een eigen vingerafdruk en sessiegegevens, waardoor het lijkt alsof je activiteiten afkomstig zijn van verschillende echte gebruikers.

Hoe het verschilt van standaardbrowsers

Een gewone browser is niet ontworpen voor het scheiden van identiteiten. Zelfs als je van account wisselt of cookies verwijdert, blijven veel onderliggende signalen hetzelfde, waardoor het voor websites gemakkelijker is om sessies aan elkaar te koppelen.

- Deelt een consistente vingerafdruk over tabbladen en sessies heen.

- Beperkte controle over elementen van de vingerafdruk, zoals WebGL, lettertypen of apparaatspecificaties.

- Cookies en opslag kunnen worden gereset, maar dieperliggende identificatiegegevens blijven behouden.

- Niet ontworpen voor het uitvoeren van meerdere onafhankelijke identiteiten op grote schaal.

Een browser met anti-detectie verandert dat door alles op profielniveau te isoleren, waardoor elke sessie los van elkaar lijkt te staan.

Het verschil met koploze schraapgereedschappen

Headless tools richten zich op automatisering en snelheid, niet op hoe "realistisch" de browseromgeving eruitziet. Ze zijn krachtig, maar kunnen standaard nog steeds herkenbare patronen achterlaten.

- Geoptimaliseerd voor automatiseringsworkflows en scripting.

- Sneller en lichter voor grootschalige schraapwerkzaamheden.

- Gemakkelijker te detecteren zonder extra stealth-configuratie

- Beperkte ingebouwde controle over realistische browserfingerprints

Browsers die antidetecteren richten zich op de andere kant van het probleem: ze maken omgevingen consistenter en moeilijker aan elkaar te koppelen.

Daarom worden ze in veel praktijksituaties samen gebruikt. De ene regelt de automatisering, de andere de identiteitsverificatie en onzichtbaarheid.

Belangrijkste kenmerken van een browser voor webscraping

Niet elke browser met antidetector is geschikt voor webscraping. Sommige zijn meer ontworpen voor accountbeheer, andere voor marketingworkflows. Als webscraping je hoofddoel is, zijn een paar functies belangrijker dan de rest.

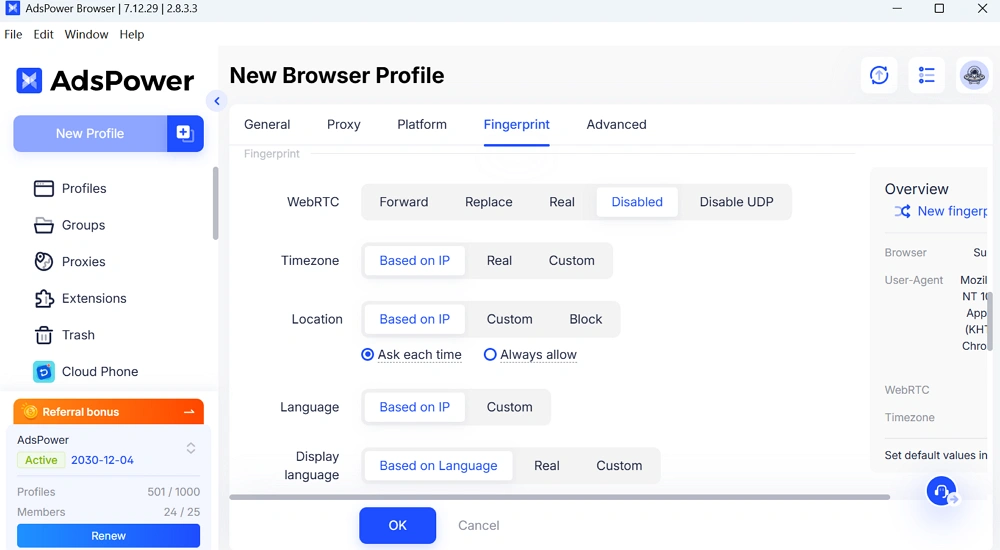

- Vingerafdrukbesturing die daadwerkelijk zinvol is.

Je wilt niet zomaar willekeurige vingerafdrukken. Je wilt combinaties die er realistisch uitzien. Dat houdt in dat de user agent moet overeenkomen met het besturingssysteem, de GPU, lettertypen, tijdzone en zelfs taalinstellingen.

- Schone profielisolatie

Elk profiel moet zich gedragen als een volledig aparte gebruiker. Geen gedeelde cookies, geen overlap in opslagruimte, geen gegevenslekkage tussen sessies.

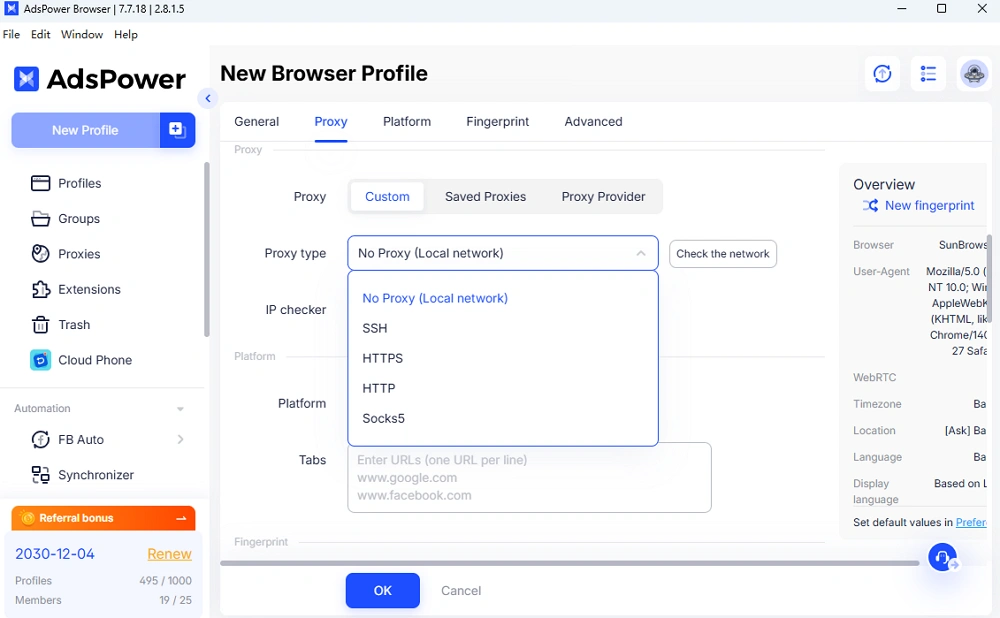

- Proxy-ondersteuning (en flexibiliteit)

Je hebt minimaal ondersteuning nodig voor HTTP-, HTTPS- en SOCKS5-proxies. Nog beter is het als je proxies per profiel kunt toewijzen en ze eenvoudig kunt wisselen.

- Automatiseringscompatibiliteit

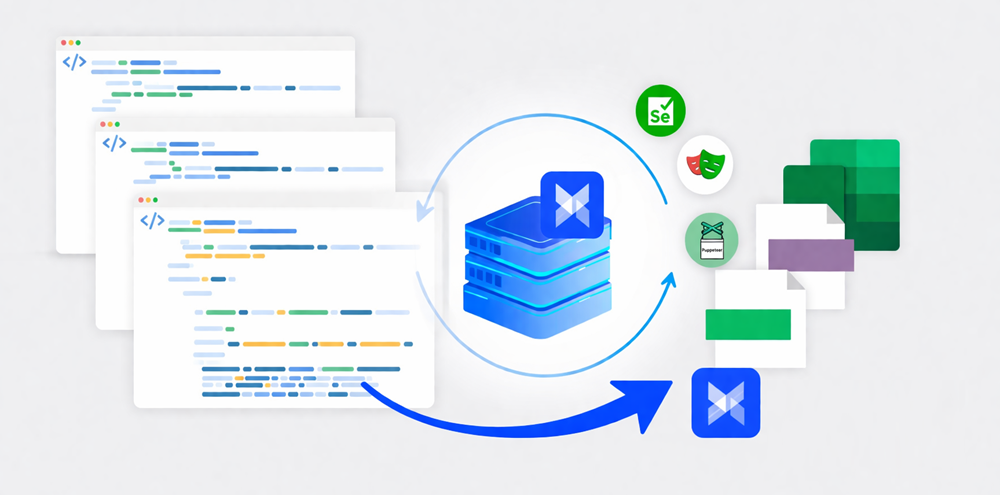

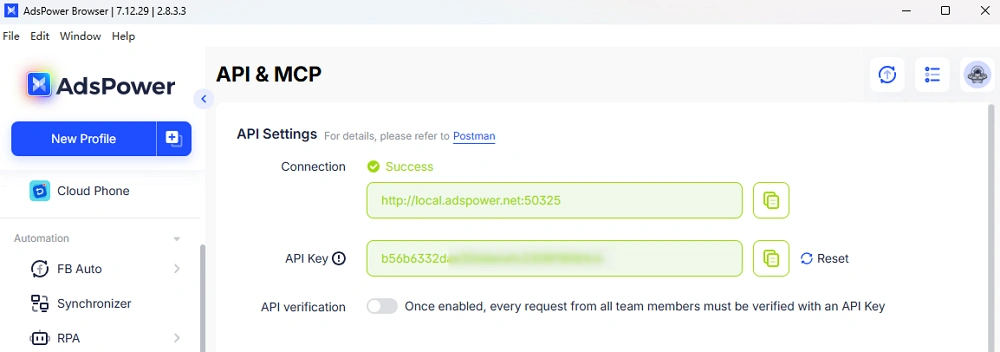

Een goede webscrapingbrowser moet samenwerken met automatiseringstools, via API's of directe integratie met frameworks zoals Puppeteer of Playwright.

- Stabiliteit bij schaling

Een paar profielen draaien is eenvoudig. Maar tientallen of honderden profielen draaien zonder vast te lopen of geheugenproblemen te veroorzaken, dat is waar het echt om draait.

- Sessiepersistentie

De mogelijkheid om sessies op te slaan en opnieuw te gebruiken is erg belangrijk, vooral voor websites die een login of langdurige interactie vereisen.

Als een tool twee of drie van deze eigenschappen mist, zul je dat waarschijnlijk merken zodra je probeert te schalen.

Beste browsers met antidetecteerfunctie voor webscraping (selectie van 2026)

Er bestaat niet één "beste" tool voor iedereen. Het hangt er echt vanaf hoe je gegevens verzamelt en hoe groot je schaalbaarheid nodig hebt. Toch duiken een paar namen niet voor niets steeds weer op.

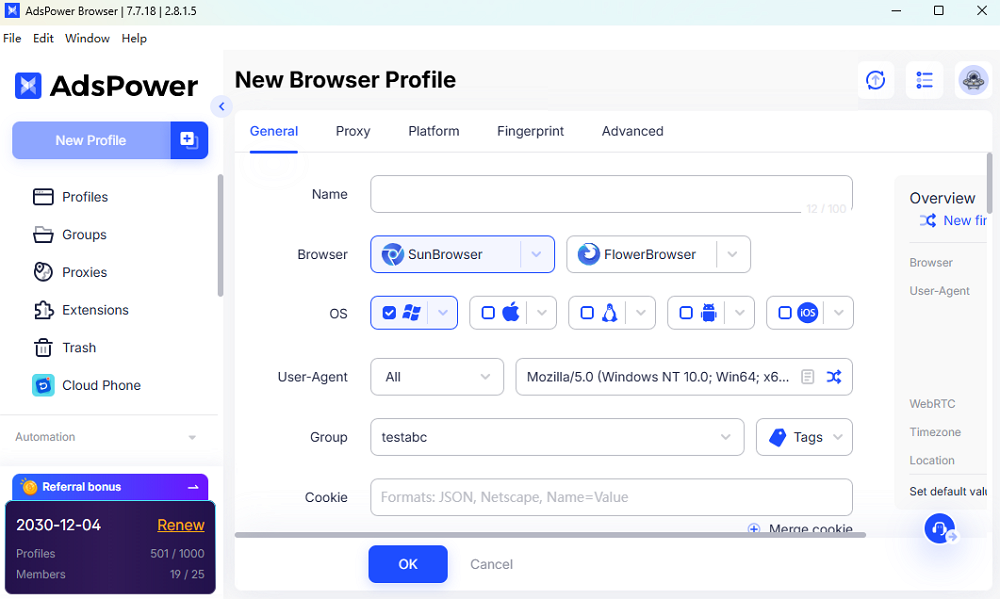

AdsPower Browser

AdsPower bevindt zich ergens in het beste segment qua gebruiksgemak, profielconsistentie en flexibiliteit.

Wat het zo geschikt maakt voor webscraping, is dat je niet hoeft te kiezen tussen workflows op basis van een gebruikersinterface en automatisering. Je kunt dingen visueel bouwen, testen en later overstappen op automatisering.

- Geavanceerd vingerafdrukbeheer met meer dan 50 parameters.

- Eenvoudige proxy-instellingen per profiel

- API-ondersteuning voor automatisering

- Inclusief headless-modus, wat handig is als je wilt schalen zonder volledige browserinstanties te draaien.

Dat laatste punt is het vermelden waard. Niet veel browsers die antidetecteren bieden een headless-functionaliteit die de consistentie van de fingerprint behoudt.

Voor webscrapingprojecten die zowel controle als schaalbaarheid vereisen, is AdsPower een zeer praktische keuze.

Incognito

Incogniton is eenvoudiger. Het probeert niet te veel te doen, wat eigenlijk een voordeel is als je gewoon iets nodig hebt dat makkelijk te installeren is.

- Eenvoudige interface

- Betrouwbare profielisolatie

- Werkt prima voor kleine tot middelgrote opstellingen.

Het heeft misschien niet de diepgang van meer geavanceerde tools, maar het klaart de klus zonder veel problemen.

Ga inloggen

GoLogin is meer gericht op cloudgebaseerde workflows.

Als je lange sessies uitvoert of identiteiten over een langere periode beheert, doet het prima werk om de boel stabiel te houden.

- Cloudprofielopslag

- Consistente generatie van vingerafdrukken

- Werkt op verschillende machines.

Voor webscrapingtaken waarbij de sessiegeschiedenis van belang is, kan die consistentie nuttig zijn.

Meerdere inloggegevens

Multilogin wordt over het algemeen gezien als een geavanceerdere optie. Het is duurder dan sommige alternatieven en wordt doorgaans gebruikt door teams die grootschalige operaties beheren.

- Biedt een webgebaseerde browser aan.

- Kan een groot aantal browserprofielen met consistente prestaties verwerken.

- Het is een al lang bestaande anti-detectiebrowser.

Als u uw accountomgeving via het web wilt beheren, kunt u Multilogin Browser overwegen.

Headless Browsers (Poppenspeler / Toneelschrijver)

Hoewel het geen browsers zijn die detectie tegengaan, vormen tools zoals Puppeteer en Playwright nog steeds een essentieel onderdeel van de meeste scraping-stacks.

- Snel en efficiënt

- Zeer aanpasbaar

- Ideaal voor grootschalige data-extractie.

Het nadeel is duidelijk. Op zichzelf zijn ze makkelijker te detecteren. Zonder extra inspanningen lossen ze het probleem van vingerafdrukken niet op.

Daarom combineren veel systemen ze met browsers die detectie tegengaan, in plaats van voor de een of de ander te kiezen.

Twijfel je nog steeds of AdsPower de juiste keuze voor jou is?

Gebruik geavanceerde AI-tools om direct gepersonaliseerde antwoorden op uw vragen te krijgen.

Browser met antidetector versus headless browser voor webscraping

Als je met beide hebt gewerkt, weet je al dat ze verschillende problemen oplossen.

Browsers met antidetectie gaan over identiteit, terwijl headless browsers over automatisering gaan.

Browser met antidetectiefunctie:

- Beter in het vermijden van detectie.

- Langzamer en zwaarder

- Het is makkelijker om lange sessies vol te houden.

- Sneller en beter schaalbaar

- Vereist extra werk voor onopvallendheid.

- Beter geschikt voor het extraheren van ruwe data.

In de praktijk gebruiken mensen er zelden maar één. Een veelvoorkomende configuratie ziet er als volgt uit:

--Gebruik een browser met antidetectie om sessies te creëren en te behouden

--Gebruik tools zonder grafische interface om gegevens te extraheren zodra de sessies stabiel zijn.

Die combinatie is doorgaans betrouwbaarder dan proberen één tool alles te laten doen.

AdsPower + AI-agenten: de toekomst van webscraping

Een van de dingen die in 2026 begint te veranderen, is de manier waarop scraping-workflows worden opgebouwd.

In plaats van vastgelegde scripts experimenteren steeds meer teams met AI-agenten die flexibeler door websites kunnen navigeren. Ze zijn niet volledig afhankelijk van vaste selectors of rigide workflows.

In combinatie met AdsPower wordt het nog interessanter:

- Elke agent draait in zijn eigen browserprofiel.

- Vingerafdrukken blijven consistent

- Het gedrag oogt minder ingestudeerd en natuurlijker.

Dit vermindert de onderhoudskosten. Wanneer de lay-out van een website verandert, hoeft u niet altijd alles helemaal opnieuw te schrijven.

Het is nog in ontwikkeling, maar de richting is vrij duidelijk. Webscraping evolueert naar systemen die zich aanpassen, in plaats van alleen maar taken uit te voeren.

Hoe gebruik je een browser met antidetectie voor webscraping?

Een standaard configuratie hoeft niet ingewikkeld te zijn. Volg de stappen om een veilige webscraping-omgeving in te stellen.

● Maak meerdere browserprofielen aan

Stel het platform in en wijs verschillende vingerafdrukken toe. Als u niet weet hoe u dit moet doen, kunt u de standaardinstellingen behouden of contact met ons opnemen.

● Proxy's instellen

Residentiële of mobiele proxy's werken meestal beter.

● Log in indien nodig

Sla sessies op, zodat je niet dezelfde acties herhaalt.

● Verbind automatisering

Gebruik de API of externe tools zoals Puppeteer.

● Langzaam afschalen

Spring niet van 1 naar 100 sessies in één nacht.

● Resultaten monitoren

Let op blokkades, fouten of ongebruikelijke patronen.

De meeste problemen ontstaan door te snel opschalen, niet door de tool zelf.

Conclusie

Webscraping in 2026 voelt heel anders aan dan een paar jaar geleden. Het gaat niet langer alleen om het efficiënt verzamelen van data, maar ook om het behouden van stabiele, geloofwaardige sessies gedurende langere tijd. Die verschuiving is precies de reden waarom browsers die detectie blokkeren steeds vaker worden gebruikt in de praktijk. Ze lossen niet alle problemen op, maar ze verminderen wel veel van de wrijving die ontstaat door verkeerde vingerafdrukken, sessieresets en herhaalde blokkeringen. In combinatie met proxies en automatiseringstools maken ze scraping-systemen robuuster en gemakkelijker geleidelijk op te schalen.

Browsers die malware detecteren zijn een praktische manier geworden om die stabiliteit te bereiken, vooral in combinatie met proxies en automatisering. Tegelijkertijd blijven headless oplossingen waardevol voor taken met een hoog volume waarbij efficiëntie het belangrijkst is. In plaats van te vertrouwen op één enkele aanpak, levert een combinatie van beide strategieën vaak betere resultaten op. Het bouwen van een scraping-systeem betekent tegenwoordig verder denken dan scripts – het gaat erom omgevingen te beheren die soepel draaien, geleidelijk schalen en onopgemerkt blijven.

Veelgestelde vragen

Is een browser met antidetectie nodig voor webscraping?

Niet altijd. Voor kleinschalige of openbare data-scraping kun je er vaak zonder. Maar zodra je te maken krijgt met accounts, herhaalde sessies of grotere volumes, wordt het veel moeilijker om blokkeringen te voorkomen zonder een vorm van identiteitsbeheer.

Wat is de beste browser voor webscraping?

Er bestaat geen pasklare oplossing, maar AdsPower is voor veel gebruikers een sterke keuze. Het combineert fingerprint-isolatie, flexibel proxybeheer en automatiseringsfuncties, waardoor het zeer geschikt is voor schaalbare en stabiele webscraping-workflows.

Kan ik een headless browser zelfstandig gebruiken?

Ja, maar er zijn beperkingen. Headless browsers zijn snel en flexibel, maar makkelijker te detecteren zonder extra configuratie. Voor stabielere resultaten worden ze vaak gecombineerd met antidetect-browsers en een goede proxy-instelling. Bovendien bieden sommige browsers, zoals AdsPower, ook een headless-modus voor webscraping.

Mensen lezen ook

- Browser-polygraph uitgelegd: waarom AdsPower moderne detectiesystemen doorstaat

Browser-polygraph uitgelegd: waarom AdsPower moderne detectiesystemen doorstaat

Ontdek hoe het IMC '24-onderzoek van ASU en Amazon de consistentie van AdsPower op kernelniveau bevestigt. Leer waarom AdsPower de enige browser was die...

- Beste Agentic-browsers in 2026: functies, prijzen en vergelijking

Beste Agentic-browsers in 2026: functies, prijzen en vergelijking

Als je op zoek bent naar de beste agentische browser voor automatiseringsworkflows, bekijk dan deze review van agentische AI-browsers en test ze voordat je begint.

- Beste webscrapingtools voor 2026: een gids voor het extraheren van grote hoeveelheden data.

Beste webscrapingtools voor 2026: een gids voor het extraheren van grote hoeveelheden data.

Ontdek de beste web scraping tools voor 2026, waaronder API's, browsers en AI-tools, plus tips om data-extractie op te schalen zonder geblokkeerd te worden.

- AI-gestuurde browser versus traditionele browserautomatisering: welke moet je gebruiken?

AI-gestuurde browser versus traditionele browserautomatisering: welke moet je gebruiken?

AI-gestuurde browsers versus traditionele automatisering: vergelijk functies, toepassingsmogelijkheden en schaalbaarheid. Leer wanneer je welke het beste kunt gebruiken en hoe je slimmere workflows kunt bouwen.

- De 9 beste AI-agenten in 2026 en hoe je automatisering veilig kunt uitvoeren

De 9 beste AI-agenten in 2026 en hoe je automatisering veilig kunt uitvoeren

Ontdek de 9 beste AI-agents van 2026 en leer hoe je veilig kunt automatiseren met AdsPower. Vergelijk tools, gebruiksscenario's en schaal op zonder accountblokkeringen.