2026最佳網頁爬蟲工具推薦:大規模資料擷取指南

如果您之前只抓取過幾個網頁,可能會覺得出奇地簡單。寫個簡單的腳本,或許再掛個代理 IP,資料就能順利取得,不會遇到什麼阻礙。對於小規模的任務,一切運作得如此順暢,幾乎毫不費力。但一旦您開始嘗試大規模抓取,這種掌控感很快就會消失。

當您開始進行大規模的網頁爬取時,一切都會變得難以預測。請求開始被封鎖、工作階段(Session)失效,而如何在網頁爬蟲中避免驗證碼(CAPTCHA)不再只是偶發狀況,而是必須嚴肅面對的現實挑戰。原本在小規模抓取時運作順暢的方法,開始變得緩慢甚至完全崩潰。到了這個階段,爬蟲就不僅僅是抓取 HTML 這麼簡單了,它更關乎身分管理、處理動態頁面,以及在持續高壓下保持系統穩定。本指南將帶您探討在這些嚴苛條件下真正能穩定運作的解決方案,以及為什麼有這麼多爬蟲架構在達到一定規模前就先敗下陣來。

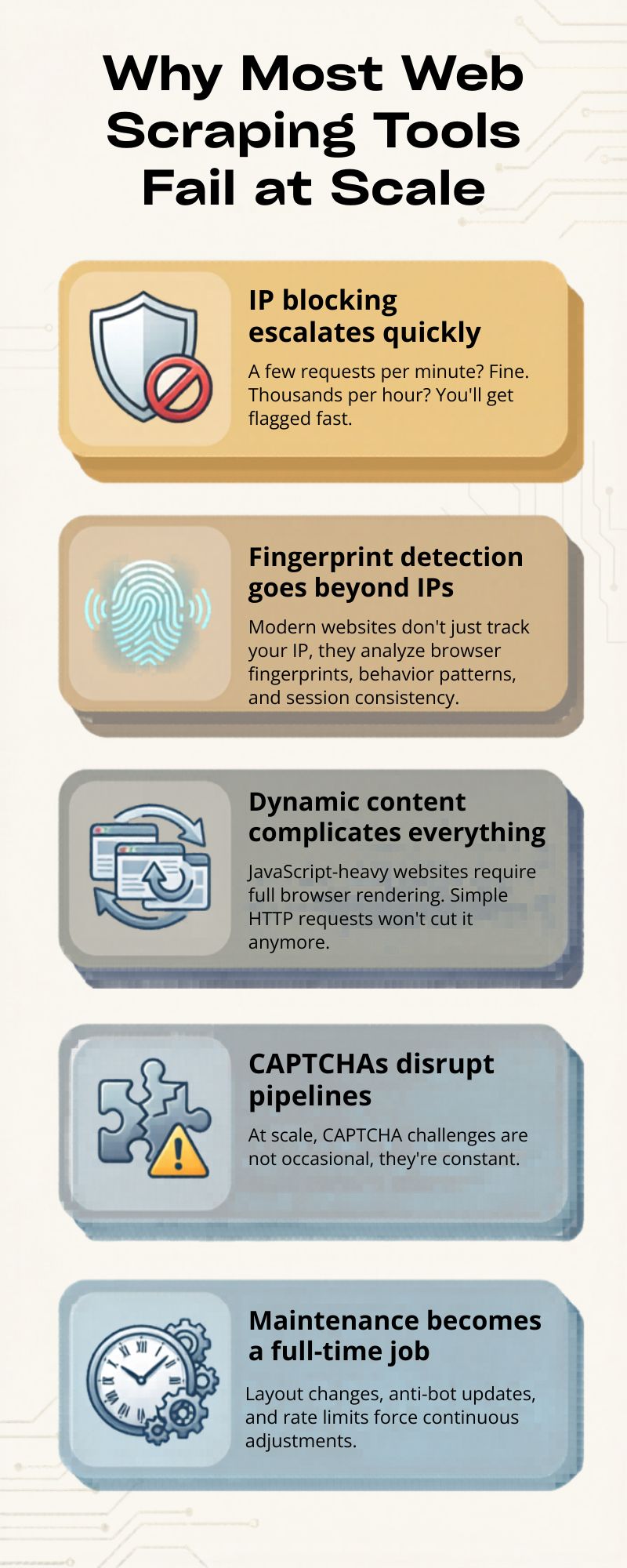

為什麼多數網頁爬蟲工具在擴充規模後會失效?

關於網頁爬蟲,最大的迷思就是認為小規模的成功可以原封不動地複製到大規模應用上,事實上並非如此。

以下是系統通常會出現崩潰的幾個環節:

- IP 封鎖率急遽上升

每分鐘幾個請求?沒問題。但如果是一小時幾千個請求?您很快就會被標記。

- 指紋偵測不僅限於 IP

現代網站不只會追蹤您的 IP,它們還會分析瀏覽器指紋、行為模式以及工作階段的一致性。

- 動態內容讓一切變得更複雜

大量使用 JavaScript 的網站需要完整的瀏覽器渲染,單純的 HTTP 請求已經無法應付了。

- 驗證碼中斷了資料管線

在大規模作業下,驗證碼不再是偶爾出現的挑戰,而是持續不斷的干擾。

- 維護變成了一份全職工作

網頁排版改變、反爬蟲機制更新以及速率限制,迫使您必須不斷進行調整。

簡而言之,大規模爬取不再只是一個寫程式的問題,這是一個基礎設施與隱蔽技術的挑戰。

網頁爬蟲工具的常見類型

選擇正確的工具取決於您的技術能力、資料量需求以及對維護工作的容忍度。讓我們來看看幾個主要類別。

1. 程式碼框架 (Code-Based Frameworks)

這基本上是 DIY 路線。如果您曾經從零開始寫過爬蟲,您大概就是從這裡起步的。它賦予您完全的控制權,但也意味著您必須為所有細節負責。

最適合:

- 希望控制每一個細節的開發人員

- 無法使用現成工具套用的特殊專案

- 較複雜的爬蟲邏輯

優點:

- 幾乎可以自訂所有功能

- 容易整合進您自有的系統中

- 對資料收集和處理流程有完整的控制力

缺點:

- 需要寫程式能力(理所當然)

- 長期的維護可能會變得非常繁瑣

- 您可能會需要額外的工具來處理 Proxy、驗證碼等問題

2. 無程式碼 / 視覺化爬蟲 (最適合初學者)

這類工具主打速度和簡單易用。您不需寫任何程式碼,只要點擊畫面並定義您想要提取的資料即可。

最適合:

- 沒有程式技術背景的使用者

- 小規模或短期的快速抓取任務

- 快速驗證點子

優點:

- 容易上手

- 能快速做出成果

- 不需寫程式

缺點:

- 彈性較差

- 在複雜或動態網站上容易失效

- 擴充性不佳

3. 爬蟲 API (最適合免維護的規模化擴充)

爬蟲 API 能幫您處理大部分的苦差事。您只需發送一個請求,它們就會在後台處理代理、重試,甚至是網頁渲染。如果您想了解這在實際應用中如何運作,特別是在大規模作業時,強烈建議您研究如何使用代理伺服器進行爬取以避免被封鎖。

最適合:

- 不想管理基礎設施的團隊

- 高流量的大規模抓取

- 需要快速部署的專案

優點:

- 自動處理 IP 輪換

- 內建重試邏輯

- 通常支援無頭瀏覽器 (Headless browsers)

缺點:

- 成本可能會逐漸墊高

- 對過程的掌控度較低

- 必須依賴第三方服務

4. AI 網頁爬蟲工具 (新興趨勢)

這是一種較新的方法。您不再需要編寫選擇器 (Selectors),只要描述您需要的資料,工具就會自動嘗試解析和提取。

最適合:

- 快速實驗與測試

- 排版混亂或頻繁更改的網站

- 節省初始設定的時間

優點:

- 能在網頁結構改變時自動適應

- 減少手動調整的次數

- 上線速度更快

缺點:

- 準確度不一定完美

- 技術仍在持續發展中

- 在面對複雜的反爬蟲系統時可能會遇到困難

5. 爬蟲瀏覽器 (Scraping Browsers)

這是讓一切感覺更「真實」的關鍵。與其只是發送單純的請求,這些工具會模擬真實使用者的操作行為。

它們會管理指紋、Cookie、Session——基本上涵蓋了正常瀏覽器會做的所有事情。

最適合:

- 規避機器人偵測

- 營運多個帳號

- 抓取防護等級較高的平台

優點:

- 行為更貼近真實人類

- 保持 Session 的一致性

- 有助於減少封鎖與帳號停權

缺點:

- 需要花費較多時間進行正確設定

- 通常需要與其他工具搭配使用

您應該使用的最佳網頁爬蟲工具推薦

並非每款爬蟲工具在面對巨大流量時都能表現優異。有些工具表面上看起來不錯,但在高壓環境下就會崩潰。以下介紹的,都是在需要持續、大規模運作時,大家真正仰賴的工具。

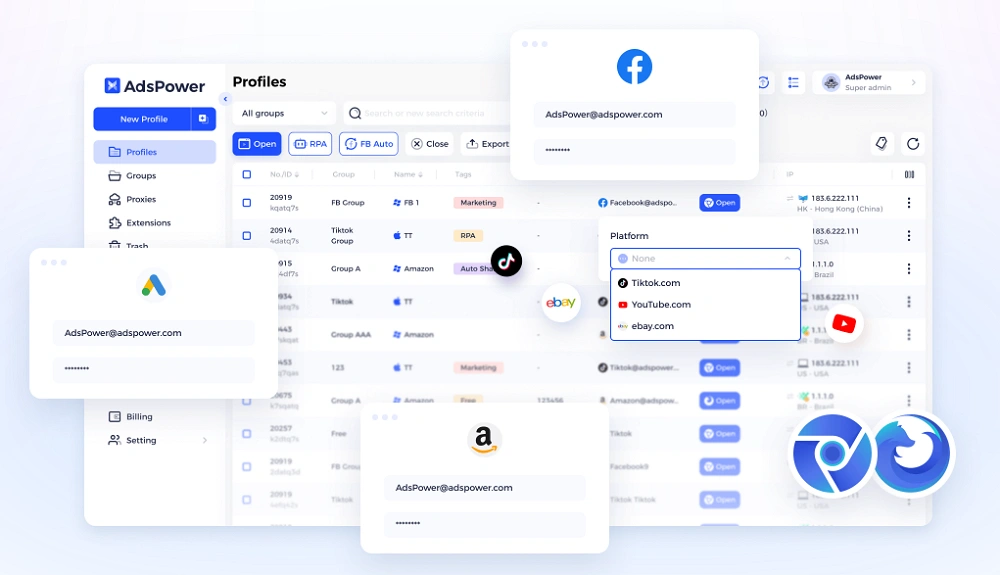

1. AdsPower

當您在抓取具備強大反爬蟲系統的平台時,像 AdsPower 這樣的工具幾乎是不可或缺的。

它不是傳統意義上的一般瀏覽器;它專為模擬真實使用者環境而生,當您試圖隱蔽行蹤時,這會發揮極大的作用。

您應該了解的重點功能:

- 每個設定檔 (Profile) 都擁有獨立的隔離指紋

- 設定檔表現得就像各自獨立的實體裝置

- 支援 RPA 以自動化日常工作流程

- 可整合多種驗證碼解決服務

- 透過 Cookie 和本地儲存保持 Session 穩定

在應對龐大流量時,這種方法往往比單純提高請求速度更有效。您不是在強行突破,而是在融入其中。對於電商、社群媒體或商城爬蟲來說,這通常意味著更少的封號與更少的停機時間。

2. Scrapingdog

Scrapingdog 保持了極高的簡單性,這正是部分團隊偏愛它的原因。

它的強項:

- 在後台完善管理 Proxy 與渲染工作

- 在結構化資料萃取上運作相當可靠

- 乾淨且簡單明瞭的 API 介面

如果您不想處理繁雜的基礎架構設定,只需要一個「能夠運作」的工具,這是一個非常合理的選擇。

3. ScraperAPI

ScraperAPI 最大的焦點就在於它的系統穩定度。

主要功能:

- 自動 IP 輪換

- 內建驗證碼處理機制

- 專為大規模環境下的高成功率而設計

它非常適合用於持續運作的爬蟲任務,在這些情境下,一致性往往比高度客製化更重要。

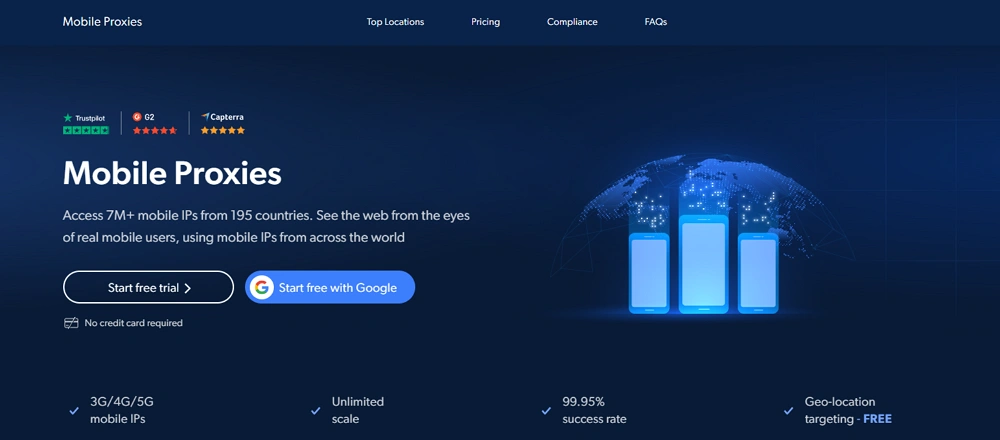

4. Bright Data

Bright Data 處於整個技術光譜中較為進階的一端。

您將獲得的優勢:

- 龐大的 Proxy 網路(涵蓋住宅、行動網路及資料中心代理)

- 精細的地理定位選項

- 豐富的額外資料收集服務

這不是一款容易設定的工具,其價格也反映了這一點。但對於大型企業的營運來說,它所提供的覆蓋範圍幾乎無可匹敵。

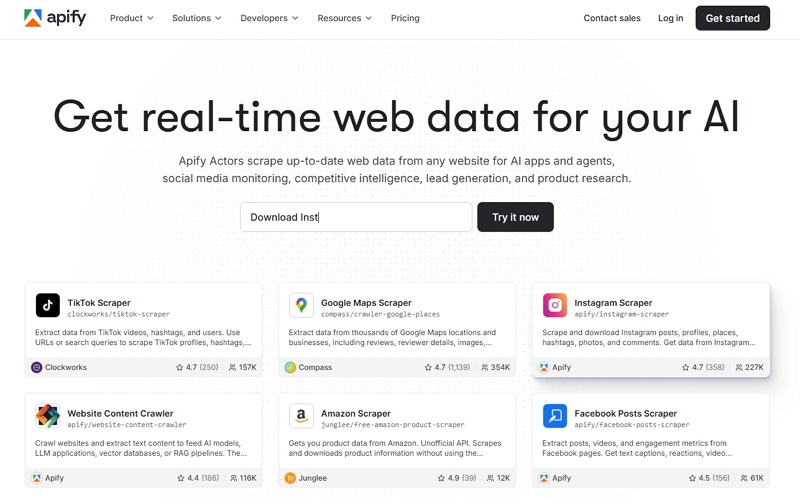

5. Apify

Apify 是人們在嘗試過簡單方案後經常轉向的工具。它能幫您節省時間,但同時又允許您在需要時微調細節。

- 提供針對常見爬蟲任務的即用型「Actors」

- 一切都在雲端運行,您無需管理伺服器

- 當工作量增加時容易橫向擴充

- 擁有良好的生態系,提供共享工具與範本

它不過度複雜,但也非完全的隨插即用,這兩者之間的平衡,正巧符合許多團隊的需求。

6. Playwright

Playwright 更加偏向開發者工具,這點毋庸置疑。它之所以被廣泛使用,是因為它在面對現代網站時非常可靠。

- 支援 Chromium、Firefox 和 WebKit

- 能出色地處理動態網頁和重度依賴 JavaScript 的網站

- 穩定性足以應付長時間運行的自動化任務

- 需要自訂行為時極具彈性

幾乎絕大多數客製化的爬蟲專案,底層最終都會使用類似這樣的技術。

7. Octoparse

當人們完全不想碰到任何程式碼時,通常會嘗試使用 Octoparse。

- 視覺化操作介面,以點擊為主

- 能快速展開基本的爬蟲任務

- 適合小型專案或一次性工作

- 內建針對常見熱門網站的範本

在初期它非常方便,但一旦任務變得複雜或資料量變大,您就會開始感到受限。

爬蟲工具快速比較表

到了這個階段,很明顯沒有任何一款單一工具能完美處理所有事。有些比較容易上手,有些賦予您更多控制權,有些則是專為擴大規模而設計。

與其想破頭,不如將它們並列比較,特別是在挑選如 最佳防關聯爬蟲瀏覽器 時更是如此。下方表格能讓您快速了解每套工具的定位及典型用途。

|

工具 |

類型 |

最適合 |

核心優勢 |

|

AdsPower |

爬蟲瀏覽器 |

防偵測與規模化擴充 |

瀏覽器指紋隔離 |

|

Scrapingdog |

API |

簡易爬取任務 |

簡單易用 |

|

ScraperAPI |

API |

大型數據管線 |

穩定可靠 |

|

Bright Data |

API / Proxy 網路 |

企業級資料擷取 |

涵蓋範圍廣 |

|

Apify |

雲端平台 |

自動化與爬蟲整合 |

高彈性 |

|

Playwright |

框架 |

客製化解決方案 |

高度掌控 |

|

Octoparse |

無程式碼 |

初學者 |

直觀操作 |

總結

現在已經很清楚了,在 2026 年進行網頁爬蟲,絕對不是找一個完美的工具就能一勞永逸。實務上真正有效的,是將不同工具組合起來,讓它們各自處理流程中的不同部分。某個層級可能負責自動化,另一層處理 Proxy 與請求,還有一層負責管理 Session 與身分。一個常見且穩健的架構,通常會使用像 Playwright 來控制瀏覽器,搭配 ScraperAPI 或 Bright Data 等爬蟲 API 來處理基礎設施,並利用 AdsPower 這樣的工具來管理指紋和保持 Session 一致。這些工具沒有誰取代誰的問題,它們相輔相成。

如果只有一件事值得記住,那就是:保持隱蔽不被發現,遠比抓取速度重要。如果您在半途就被封鎖,發出再多請求也無濟於事。一個運作緩慢但穩定的系統,幾乎總是勝過一個過於激進的系統。把焦點放在一致性上,隨著時間推移,擴展規模就會變得簡單許多。

常見問題 (FAQs)

如何在爬蟲工作流程中處理驗證碼 (CAPTCHA)?

在大規模抓取時,驗證碼是不可避免的,因此我們的目標是「管理」它們,而不是試圖完全消除它們。多數成熟的架構會透過放慢請求頻率、重複使用 Session 以及模仿真實使用者行為來減少觸發驗證碼的機會。除此之外,許多團隊會整合驗證碼打碼服務,以保持工作流程自動運行,無需人工介入。實務上,這是結合了 Proxy、時序控制和行為模擬等多種技術,共同維持系統穩定,而不是單單依賴某一個解決方案。

為什麼擴充規模後,驗證碼出現得更頻繁?

當爬蟲的請求量增加時,行為模式就更容易被網站偵測到。重複的動作、完全相同的請求參數,或是極不自然的時序,都會迅速觸發警報。驗證碼的作用在於驗證流量是否為真人,所以您的行為看起來越像「機器人」,驗證碼就出現得越頻繁。這就是為什麼擴充規模不單純只是發送更多請求,而是要讓這些請求看起來不再那麼好預測,並且更像真實使用者。

為什麼您的爬蟲架構需要指紋防護?

現在只靠 Proxy 已經不夠了。各大網站都會分析瀏覽器指紋、裝置設定以及行為模式來偵測機器人。如果沒有指紋防護機制,即使不斷輪換 IP 也同樣會被標記。透過建立隔離的瀏覽器環境,指紋工具能讓每一次的 Session 看起來都更真實、更具一致性。這有助於大幅減少封鎖機率,讓爬蟲工作流運作得更加順暢,特別是在處理高流量資料擷取時更是關鍵。

人們也讀過

- 2026 年最佳可造訪 YouTube 網站及方法:終極指南

2026 年最佳可造訪 YouTube 網站及方法:終極指南

探索 2026 年最佳的未封鎖 YouTube 網站,並學習如何使用代理商、鏡像網站和 AdsPower 安全地觀看影片。

- 深入解析「瀏覽器測謊儀」:為何 AdsPower 能通過最先進的偵測系統?

深入解析「瀏覽器測謊儀」:為何 AdsPower 能通過最先進的偵測系統?

探索亞利桑那州立大學 (ASU) 與亞馬遜在 IMC '24 發表的聯合研究,如何證實 AdsPower 的「內核級一致性」。瞭解為何 AdsPower 是唯一通過「測謊」測試的指紋瀏覽器。

- 2026 年最佳 AI 代理瀏覽器推薦:功能、價格與評比

2026 年最佳 AI 代理瀏覽器推薦:功能、價格與評比

正在尋找適合自動化工作流程的最佳 AI 代理瀏覽器?請參考這篇 AI 代理瀏覽器評測,並在正式開始前親自測試。

- 2026 年最佳網頁爬蟲防偵測瀏覽器推薦

2026 年最佳網頁爬蟲防偵測瀏覽器推薦

尋找 2026 年最適合網頁爬蟲的防偵測瀏覽器。比較頂級工具、核心功能,並學習如何避開偵測、安全地擴展您的爬蟲專案。

- AI 代理瀏覽器 vs 傳統瀏覽器自動化:你該選擇哪一種?

AI 代理瀏覽器 vs 傳統瀏覽器自動化:你該選擇哪一種?

AI 代理瀏覽器與傳統自動化:比較核心功能、使用情境與擴展性。了解何時該使用它們,以及如何建立更聰明的工作流程。