Найкращі інструменти для веб-скрейпінгу на 2026 рік: посібник з вилучення великих обсягів даних

Швидко подивіться

Масштабування веб-скрейпінгу призводить до блокування, капч та нестабільності. Успіх вимагає керування відбитками пальців, сеансами та інфраструктурою за допомогою правильного поєднання інструментів для надійного та непомітного вилучення даних. Підпишіться на нас, щоб спробувати!

Якщо ви раніше обробили лише кілька сторінок, це може здатися напрочуд простим. Простий скрипт, можливо, проксі-сервер, і дані надходять без особливого опору. Для невеликих завдань все зазвичай відбувається настільки гладко, що здається майже без зусиль. Але це відчуття контролю триває недовго, як тільки ви починаєте працювати над більшим обсягом.

Щойно ви переходите до масштабного парсингу, все стає менш передбачуваним. Запити починають блокуватися, сесії не тривають, і те, як уникнути CAPTCHA під час парсингу веб-сторінок, швидко стає справжньою проблемою, а не крайнім випадком. Те, що добре працювало на невеликій партії, починає сповільнюватися або повністю ламатися. У цей момент парсинг — це вже не просто вилучення HTML, а керування ідентифікаторами, обробка динамічних сторінок та підтримка стабільності вашої системи під постійним навантаженням. Цей посібник зосереджується на тому, що насправді працює в таких умовах, і чому так багато налаштувань руйнуються, не досягнувши цього рівня.

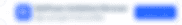

Чому більшість інструментів для веб-скрейпінгу не працюють у великих масштабах

Найбільша помилка у веб-скрейпінгу полягає в тому, що успіх у малому масштабі означає надійність у великому масштабі. Це не так.

Ось де зазвичай все ламається:

- Блокування IP-адрес швидко посилюється

Кілька запитів на хвилину? Добре. Тисячі на годину? Вас швидко помітять.

- Розпізнавання відбитків пальців виходить за рамки IP-адрес

Сучасні вебсайти не просто відстежують вашу IP-адресу, вони аналізують відбитки браузера, моделі поведінки та узгодженість сеансів.

- Динамічний контент ускладнює все

Вебсайти з великим навантаженням на JavaScript вимагають повного рендерингу в браузері. Простих HTTP-запитів більше не вистачить.

- CAPTCHA порушують роботу трубопроводів

У великих масштабах, перевірки CAPTCHA не є випадковими, вони постійні.

- Технічне обслуговування стає роботою на повний робочий день

Зміни макета, оновлення антиботів та обмеження швидкості вимагають постійного налаштування.

Коротше кажучи, парсинг у великих масштабах — це не просто проблема кодування. Це проблема інфраструктури та прихованості.

Типи інструментів для веб-скрейпінгу

Вибір правильного інструменту залежить від ваших технічних навичок, вимог до обсягу та допустимої тривалості обслуговування. Давайте розглянемо основні категорії.

1. Фреймворки на основі коду

Це, по суті, шлях «зроби сам». Якщо ви коли-небудь створювали скрепер з нуля, то, ймовірно, саме з цього ви починали. Це дає вам повний контроль, але також означає, що ви несете відповідальність за все.

Найкраще для:

- Розробники, які хочуть контролювати кожну деталь

- Проєкти, які не вписуються в готові інструменти

- Складніша логіка парсингу

Плюси:

- Ви можете налаштувати практично все

- Легко підключається до власних систем

- Повний контроль над тим, як збираються та обробляються дані

Мінуси:

- Потрібне кодування (звичайно)

- Технічне обслуговування може з часом стати складним

- Вам, ймовірно, знадобляться додаткові інструменти для проксі-серверів, CAPTCHA тощо.

2. Візуальні парсери без коду (найкраще для початківців)

Ці інструменти радше про швидкість та простоту. Ви не пишете код, а просто клацаєте мишкою та визначаєте, що хочете витягти.

Найкраще для:

- Люди без технічної освіти

- Невеликі або швидкі завдання зі скребкування

- Швидке тестування ідей

Плюси:

- Легко підібрати

- Швидко змусити щось працювати

- Кодування не потрібне

Мінуси:

- Не дуже гнучкий

- Легко переривається на складних або динамічних сайтах

- Не масштабується добре

3. API для парсингу (найкраще для масштабування без обслуговування)

API парсингу виконують більшу частину важкої роботи. Ви надсилаєте запит, а вони обробляють проксі-сервери, повторні спроби та іноді навіть рендеринг за лаштунками. Якщо ви хочете зрозуміти, як це працює на практиці, особливо у великих масштабах, варто розглянути використання проксі-серверів для парсингу веб-сайтів без блокування.

Найкраще для:

- Команди, які не хочуть керувати інфраструктурою

- Високий обсяг зіскрібання

- Швидше розгортання

Плюси:

- Ротація IP-адрес виконується автоматично

- Вбудована логіка повторних спроб

- Часто підтримує браузери без графічного інтерфейсу

Мінуси:

- Витрати можуть зростати

- Менший контроль над процесом

- Ви прив'язані до стороннього сервісу

4. Інструменти для веб-скрейпінгу на основі штучного інтелекту (новітня тенденція)

Це новіший підхід. Замість написання селекторів ви просто описуєте, які дані вам потрібні, а інструмент намагається їх розібратися.

Найкраще для:

- Швидкі експерименти

- Неохайні або часто змінювані макети

- Економія часу на налаштування

Плюси:

- Може адаптуватися до змін структури сторінок

- Менше ручного налаштування

- Швидше почати

Мінуси:

- Не завжди точно

- Все ще розвивається

- Може мати проблеми з антибот-системами

5. Парсинг браузерів

Саме тут все починає здаватися більш «реальним». Замість того, щоб просто надсилати запити, ці інструменти намагаються діяти як справжні користувачі.

Вони керують відбитками пальців, файлами cookie, сесіями, фактично всім, що робить звичайний браузер.

Найкраще для:

- Уникнення виявлення

- Ведення кількох облікових записів

- Скрейпінг захищених платформ

Плюси:

- Поводиться більше як справжній користувач

- Забезпечує послідовність сеансів

- Допомагає зменшити кількість блокувань та заборон

Мінуси:

- Потрібен час для правильного налаштування

- Зазвичай використовується разом з іншими інструментами

Найкращі інструменти для веб-скрейпінгу, які вам варто використовувати

Не кожен інструмент для парсингу добре працює, коли ви починаєте працювати над серйозними обсягами. Деякі виглядають добре на папері, але руйнуються під тиском. Ті, що наведені нижче, – це інструменти, на які люди насправді покладаються, коли потрібно, щоб все працювало безперервно та масштабно.

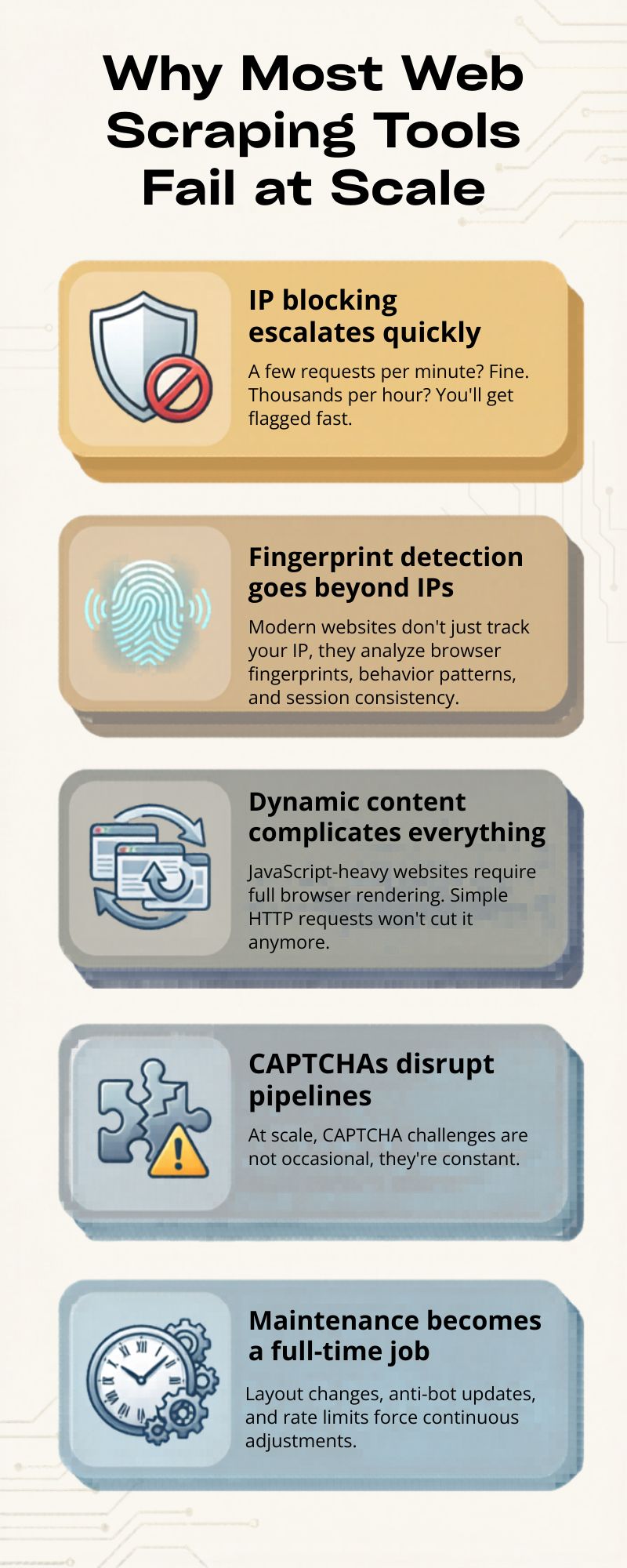

1. Сила реклами

Коли ви парсите платформи з потужними антибот-системами, такі інструменти, як AdsPower, стають майже необхідними.

Це не просто браузер у звичному розумінні; він створений для імітації реального середовища користувача, що має велике значення, коли ви намагаєтеся залишатися непоміченим.

Ключові речі, які потрібно знати:

- Кожен профіль має свій власний ізольований відбиток пальця

- Профілі поводяться як окремі фізичні пристрої

- Підтримує RPA для автоматизації робочих процесів

- Можна інтегрувати розв'язувачі CAPTCHA

- Зберігає стабільність сесій за допомогою файлів cookie та локального сховища

За більших обсягів цей підхід, як правило, працює краще, ніж просте збільшення швидкості запитів. Ви не проштовхуєтесь, а зливаєтеся з натовпом. Для електронної комерції, соціальних мереж або парсингу торговельних майданчиків це часто означає менше блокувань та менше простоїв.

2. Скребкий пес

Scrapingdog спрощує все, саме тому деякі команди надають йому перевагу.

Що в нього добре виходить:

- Керує проксі-серверами та рендерингом за лаштунками

- Надійно працює для вилучення структурованих даних

- Чистий та зрозумілий API

Якщо ви не хочете займатися налаштуванням інфраструктури та вам просто потрібно щось робоче, це розумний варіант.

3. API скрепера

ScraperAPI більше зосереджений на стабільності, ніж на чомусь іншому.

Основні характеристики:

- Автоматична ротація IP-адрес

- Вбудована обробка CAPTCHA

- Розроблено для високих показників успіху у великих масштабах

Це добре підходить для постійних завдань зі збору даних, де послідовність важливіша за налаштування.

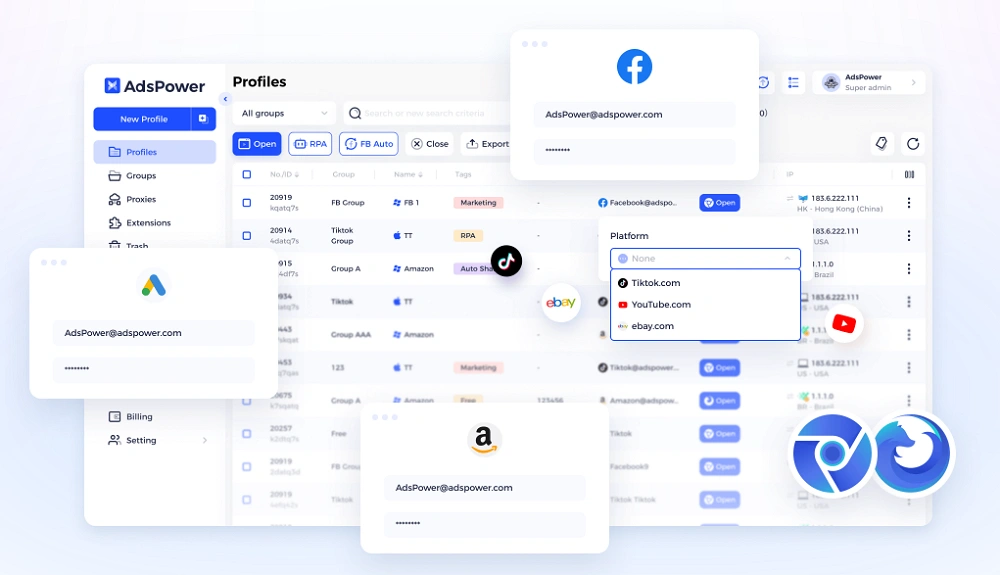

4. Яскраві дані

Bright Data знаходиться на більш просунутому кінці спектра.

Що ви отримуєте:

- Велика проксі-мережа (житлова, мобільна, центр обробки даних)

- Детальні параметри таргетування

- Додаткові послуги зі збору даних

Це не найпростіший інструмент для налаштування, і ціна це відображає. Але для великих операцій він пропонує рівень покриття, який важко перевершити.

5. Апіфай

Apify – це той інструмент, до якого люди часто переходять після спроби простіших варіантів. Він економить час, але водночас дозволяє налаштовувати параметри за потреби.

- Має готові до використання "актори" для поширених завдань парсингу

- Запускає все в хмарі, тому вам не потрібно керувати серверами

- Легко масштабується, коли ваше робоче навантаження збільшується

- Гідна екосистема зі спільними інструментами та шаблонами

Він не надто складний, але й не повністю plug-and-play, щось посередині, що добре працює для багатьох команд.

6. Драматург

Playwright — це радше інструмент для розробників, і це помітно. Він широко використовується, оскільки надійно працює із сучасними вебсайтами.

- Підтримує Chromium, Firefox та WebKit

- Досить добре обробляє динамічні сторінки та важкий JavaScript

- Достатньо стабільний для тривалої автоматизації

- Гнучкий, якщо вам потрібно налаштувати поведінку

Більшість користувацьких налаштувань парсингу зрештою використовують щось подібне "під капотом".

7. Восьминіг

Octoparse зазвичай намагаються використовувати люди, коли взагалі не хочуть мати справу з кодом.

- Візуальний інтерфейс, переважно вказівник миші

- Швидкий початок роботи з основними завданнями парсингу

- Добре підходить для невеликих проектів або разових робіт

- Включає шаблони для поширених сайтів

Це зручно на початку, але як тільки речі стають складнішими або обсяг збільшується, це може здаватися обмежувальним.

Таблиця швидкого порівняння

На цьому етапі цілком очевидно, що не існує єдиного інструменту, який би робив усе ідеально. Деякі простіші у використанні, деякі дають більше контролю, а інші створені спеціально для масштабування.

Замість того, щоб надто багато про це думати, корисно розглянути їх поруч, особливо порівнюючи такі інструменти, як найкращий браузер із захистом від виявлення для веб-скрейпінгу . Таблиця нижче дає коротке уявлення про те, де кожен з них підходить і для чого він зазвичай використовується.

Інструмент | Тип | Найкраще для | Сила |

Потужність реклами | Браузер для парсингу | Захист від виявлення та масштабування | Ізоляція відбитків пальців |

Скребкий пес | API | Прості завдання зі скребкування | Простота використання |

API скрепера | API | Великомасштабні трубопроводи | Надійність |

Яскраві дані | API / Проксі-мережа | Корпоративне парсингування даних | Покриття |

Апіфай | Платформа | Автоматизація + парсинг | Гнучкість |

Драматург | Рамка | Індивідуальні рішення | КОНТРОЛЬ |

Восьминіг | Без коду | Початківці | Простота |

Заключні думки

Наразі цілком очевидно, що веб-скрейпінг у 2026 році не полягає в тому, щоб знайти один ідеальний інструмент і завершити його. На практиці працює комбінація інструментів, кожен з яких обробляє різну частину процесу. Один рівень може займатися автоматизацією, інший — проксі-серверами та запитами, а ще один — керуванням сеансами та ідентифікаторами. Загальна схема зазвичай включає щось на кшталт Playwright для керування браузером, API скрейпінгу, такий як ScraperAPI або Bright Data, для керування інфраструктурою, та інструмент, такий як AdsPower, для керування відбитками пальців і забезпечення узгодженості сеансів. Жоден з цих інструментів не замінює інші; вони працюють разом.

Якщо й варто пам’ятати щось одне, то це те, що залишатися непоміченим важливіше за швидкість. Надсилання більшої кількості запитів не допоможе, якщо вас заблокують на півдорозі. Повільніша, але стабільніша система майже завжди перевершить агресивну. Зосередьтеся на послідовності, і з часом масштабування стане набагато легшим.

Найчастіші запитання

Як обробляти CAPTCHA в робочих процесах парсингу?

У великих масштабах CAPTCHA неминучі, тому метою є керування ними, а не їх повне усунення. Більшість систем зменшують кількість тригерів, уповільнюючи частоту запитів, повторно використовуючи сеанси та імітуючи поведінку реальних користувачів. Крім того, багато команд інтегрують сервіси розв'язання CAPTCHA , щоб забезпечити роботу робочих процесів без ручного введення. На практиці це поєднання методів (проксі), часу та поведінки, що допомагає підтримувати стабільність, замість того, щоб покладатися на одне рішення.

Чому CAPTCHA з'являється частіше у великих масштабах?

Коли обсяг парсингу збільшується, веб-сайтам легше виявляти закономірності. Повторювані дії, ідентичні запити або неприродний час можуть швидко викликати тривогу. CAPTCHA використовуються для перевірки того, чи трафік належить людині, тому чим більше ваша поведінка виглядає «схожою на ботів», тим частіше вони з’являються. Ось чому масштабування полягає не лише в надсиланні більшої кількості запитів, а й у тому, щоб зробити ці запити менш передбачуваними та більш схожими на запити реальних користувачів.

Чому ваш стек парсингу потребує захисту від відбитків пальців?

Одних лише проксі-серверів вже недостатньо. Вебсайти тепер аналізують відбитки браузера , налаштування пристрою та моделі поведінки для виявлення ботів. Без захисту відбитків пальців навіть змінні IP-адреси все одно можуть бути позначені. Створюючи ізольовані середовища браузера, інструменти для роботи з відбитками пальців роблять кожен сеанс більш реалістичним та послідовним. Це допомагає зменшити блокування та забезпечує більш плавну роботу процесів парсингу, особливо за великих обсягів.

Люди також читають

- Пояснення роботи браузерного поліграфа: чому AdsPower проходить випробування сучасними системами виявлення

Пояснення роботи браузерного поліграфа: чому AdsPower проходить випробування сучасними системами виявлення

Дізнайтеся, як дослідження IMC '24, проведене ASU та Amazon, підтверджує узгодженість AdsPower на рівні ядра. Дізнайтеся, чому AdsPower був єдиним браузером, який...

- Найкращі браузери з ШІ-агентами у 2026 році: функції, ціни та порівняння

Найкращі браузери з ШІ-агентами у 2026 році: функції, ціни та порівняння

Якщо ви шукаєте найкращий агентний браузер для автоматизації робочих процесів, перегляньте цей огляд браузерів зі штучним інтелектом та протестуйте їх перед початком роботи.

- Найкращий браузер Antidetect для веб-скрапінгу у 2026 році

Найкращий браузер Antidetect для веб-скрапінгу у 2026 році

Знайдіть найкращі браузери з антидетекторами для веб-скрапінгу у 2026 році. Порівняйте найкращі інструменти, ключові функції та дізнайтеся, як уникнути виявлення та масштабувати скрапінг.

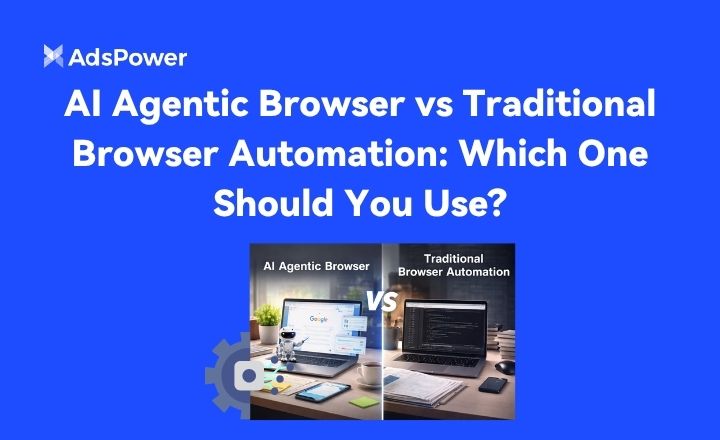

- Браузер ШІ-агента проти традиційної автоматизації браузера: який з них слід використовувати?

Браузер ШІ-агента проти традиційної автоматизації браузера: який з них слід використовувати?

ШІ-агентський браузер проти традиційної автоматизації: порівняння функцій, варіантів використання та масштабованості. Дізнайтеся, коли використовувати кожну з них та як створювати розумніші робочі процеси.

- 9 найкращих агентів зі штучним інтелектом у 2026 році та як безпечно запускати автоматизацію

9 найкращих агентів зі штучним інтелектом у 2026 році та як безпечно запускати автоматизацію

Відкрийте для себе 9 найкращих агентів зі штучним інтелектом у 2026 році та дізнайтеся, як безпечно автоматизувати за допомогою AdsPower. Порівняйте інструменти, варіанти використання та масштабуйте без блокування облікових записів.