Mejor navegador antidetect para web scraping en 2026

Eche un vistazo rápido

Descubre los mejores navegadores antidetect para web scraping en 2026, mejora la estabilidad, evita la detección y escala eficientemente. ¡Sigue leyendo para encontrar la herramienta ideal hoy!

El web scraping ha cambiado mucho. No hace mucho tiempo, podías ejecutar un script básico y recopilar datos sin demasiados problemas. Ahora, la mayoría de las plataformas monitorizan muchas más señales en segundo plano, desde la huella digital de tu navegador hasta la forma en que interactúas con una página web, e incluso el tiempo que pasa entre cada acción. Cuando algo no parece natural, las restricciones o los bloqueos pueden ocurrir casi de inmediato; por eso, muchos desarrolladores buscan la manera de hacer web scraping sin ser bloqueados, en lugar de seguir dependiendo de scripts anticuados.

Aquí es donde entran en juego los navegadores antidetect. En lugar de estar solucionando problemas de detección constantemente una vez que aparecen, te permiten comenzar con una configuración mucho más realista, utilizando identidades separadas, sesiones estables y un comportamiento que se asemeja al de usuarios reales. En esta guía, desglosaremos cómo funcionan y qué herramientas realmente vale la pena considerar en 2026.

Por qué el web scraping moderno requiere un navegador antidetect

Lo que realmente ha cambiado en el web scraping no son las herramientas que utiliza la gente, sino cómo se defienden los sitios web.

La mayoría de las plataformas ahora combinan varias capas de detección al mismo tiempo. En lugar de solo verificar las solicitudes, analizan el contexto general de tu actividad, lo que incluye:

- Detalles de la huella digital del navegador (fingerprint), como canvas, WebGL, fuentes y especificaciones del dispositivo

- Señales de comportamiento, como el movimiento del ratón y los patrones de desplazamiento (scrolling)

- Reputación de la IP y frecuencia de las solicitudes

- Continuidad de la sesión, incluyendo cookies y coherencia en los encabezados (headers)

El problema es que todo tiene que coincidir a la perfección. Puedes enviar solicitudes perfectamente válidas, pero si algo no cuadra en tu configuración, destacarás. Una simple discrepancia entre tu user agent y el fingerprint de WebGL ya puede levantar sospechas. Si eso ocurre mientras realizas solicitudes repetidas desde la misma IP, los bloqueos suelen llegar bastante rápido.

Aquí es donde los navegadores antidetect marcan la diferencia. Reducen esas inconsistencias al darte un mayor control sobre el entorno:

- Cada perfil de navegador se ejecuta con su propia huella digital

- Las sesiones mantienen la coherencia en cookies, almacenamiento y encabezados

- La configuración general se comporta de manera más cercana a un entorno de usuario real

Al final del día, el objetivo es sencillo: en lugar de parecer un script ejecutándose en segundo plano, tu configuración se camufla como la actividad normal de un usuario, que es exactamente lo que permite que los flujos de scraping funcionen por más tiempo.

¿Qué es un navegador antidetect para web scraping?

Un navegador antidetect es un software que te permite ejecutar múltiples perfiles aislados, cada uno con su propia huella digital y datos de sesión, para que tu actividad parezca provenir de diferentes usuarios reales.

Diferencias con los navegadores estándar

Un navegador normal no está diseñado para separar identidades. Incluso si cambias de cuenta o borras las cookies, muchas señales subyacentes siguen siendo las mismas, lo que facilita que los sitios web vinculen tus sesiones.

- Comparte una huella digital constante en todas las pestañas y sesiones

- Control limitado sobre elementos de la huella digital como WebGL, fuentes o especificaciones del dispositivo

- Las cookies y el almacenamiento pueden restablecerse, pero persisten identificadores más profundos

- No está diseñado para gestionar múltiples identidades independientes a gran escala

Un navegador antidetect cambia esto aislando todo a nivel de perfil, haciendo que cada sesión parezca completamente independiente.

Diferencias con las herramientas de scraping headless

Las herramientas headless (sin interfaz gráfica) se centran en la automatización y la velocidad, no en lo "real" que parece el entorno del navegador. Son muy potentes, pero por defecto pueden dejar patrones fácilmente detectables.

- Optimizadas para flujos de automatización y scripting

- Más rápidas y ligeras para tareas de scraping masivo

- Más fáciles de detectar si no tienen configuraciones adicionales de camuflaje (stealth)

- Control integrado limitado sobre la creación de huellas digitales realistas

Los navegadores antidetect atacan el lado opuesto del problema, haciendo que los entornos sean consistentes y más difíciles de relacionar entre sí.

Por eso, en muchas configuraciones profesionales, se usan juntos. Uno se encarga de la automatización y el otro de la identidad y el anonimato.

Funciones clave en un navegador para web scraping

No todos los navegadores antidetect son adecuados para el scraping. Algunos están pensados más para la gestión de cuentas en redes sociales o marketing. Si tu objetivo principal es el scraping, hay algunas características que importan más que el resto.

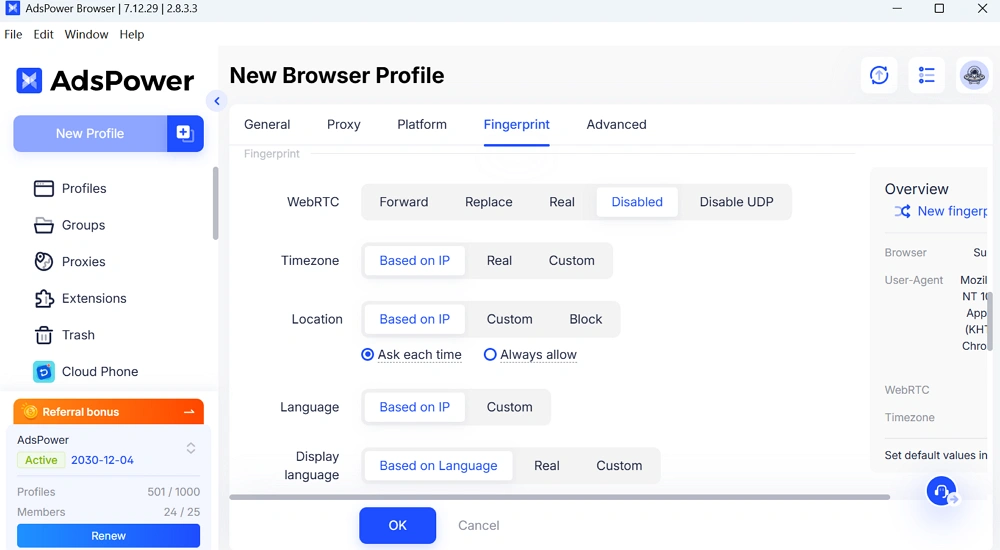

- Control de la huella digital que tenga sentido

No basta con tener fingerprints aleatorios; necesitas combinaciones que parezcan realistas. Esto incluye que el user agent coincida con el sistema operativo, la GPU, las fuentes, la zona horaria e incluso la configuración de idioma.

- Aislamiento impecable de perfiles

Cada perfil debe comportarse como un usuario completamente distinto. Sin compartir cookies, sin solapamientos en el almacenamiento local y sin filtración de datos entre sesiones.

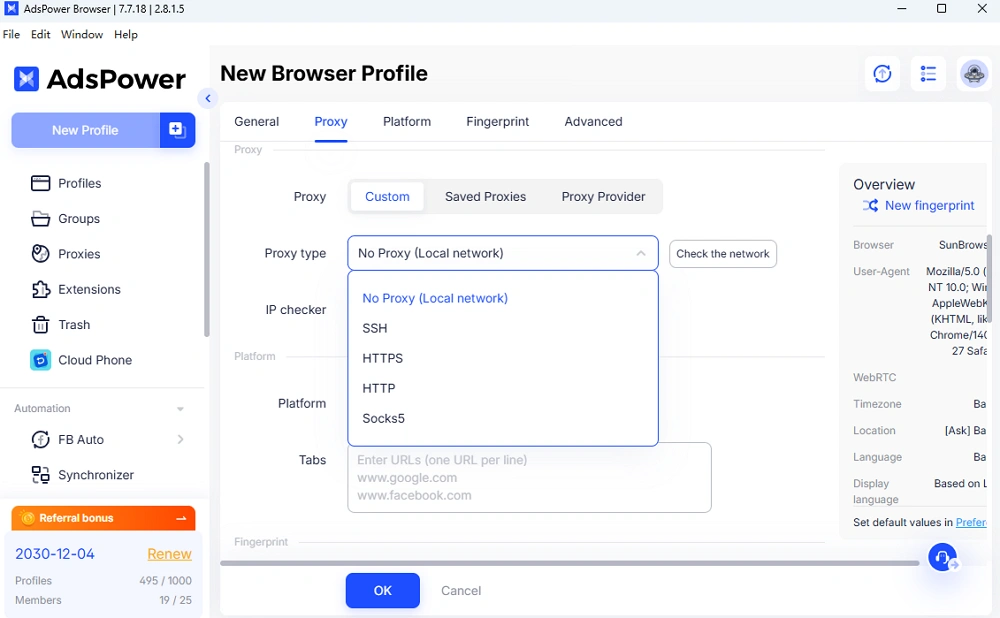

- Soporte para proxies (y flexibilidad)

Como mínimo, necesitarás soporte para proxies HTTP, HTTPS y SOCKS5. Es aún mejor si puedes asignar proxies por perfil y rotarlos con facilidad.

- Compatibilidad con automatización

Un buen navegador para scraping debe funcionar sin problemas con herramientas de automatización, ya sea a través de APIs o con integración directa con frameworks como Puppeteer o Playwright.

- Estabilidad al escalar

Ejecutar unos cuantos perfiles es fácil. Mantener docenas o cientos sin que el navegador se congele o consuma toda la memoria RAM es donde se ve la verdadera calidad.

- Persistencia de la sesión

Poder guardar y reutilizar sesiones es crucial, especialmente para sitios web que requieren inicio de sesión o interacciones prolongadas.

Si a una herramienta le faltan dos o tres de estos puntos, probablemente lo notarás en cuanto intentes escalar tu operación.

Mejores navegadores antidetect para web scraping (Selección 2026)

No existe una herramienta "perfecta" para todo el mundo. Todo depende de cómo extraigas los datos y de cuánto necesites escalar. Aun así, hay varios nombres que destacan constantemente por buenas razones.

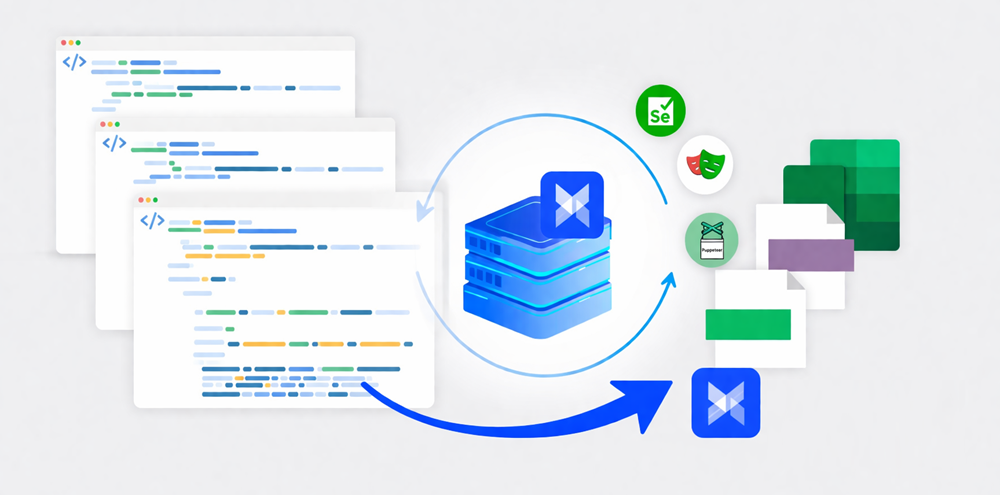

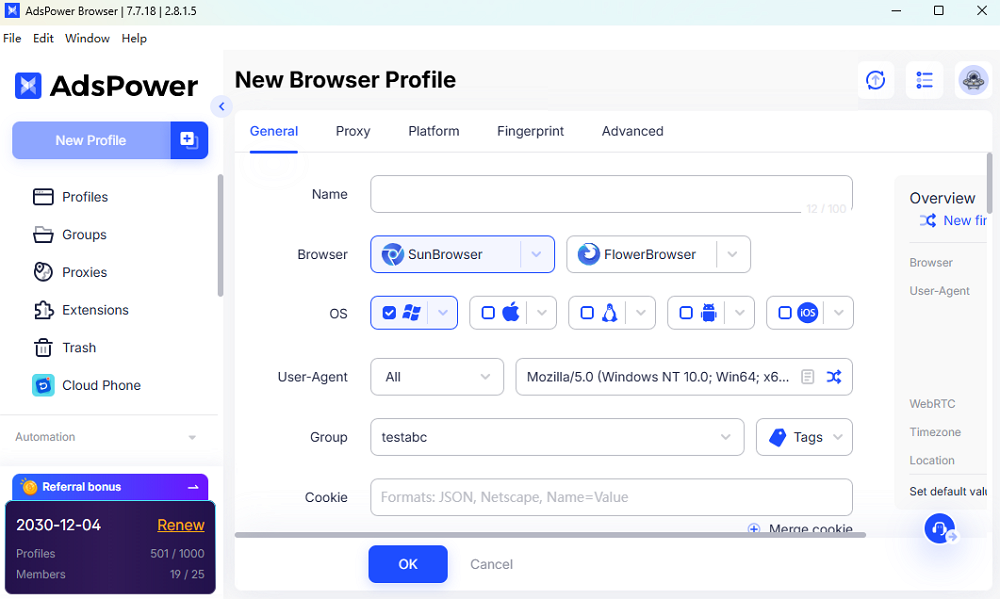

Navegador AdsPower

AdsPower encuentra un gran equilibrio entre facilidad de uso, consistencia de perfiles y flexibilidad.

Lo que lo hace excelente para el scraping es que no te obliga a elegir entre flujos de trabajo basados en la interfaz de usuario y la automatización pura. Puedes construir las cosas visualmente, probarlas y luego pasar a la automatización más tarde.

- Robusta gestión de huellas digitales con más de 50 parámetros configurables

- Fácil configuración de proxies por perfil

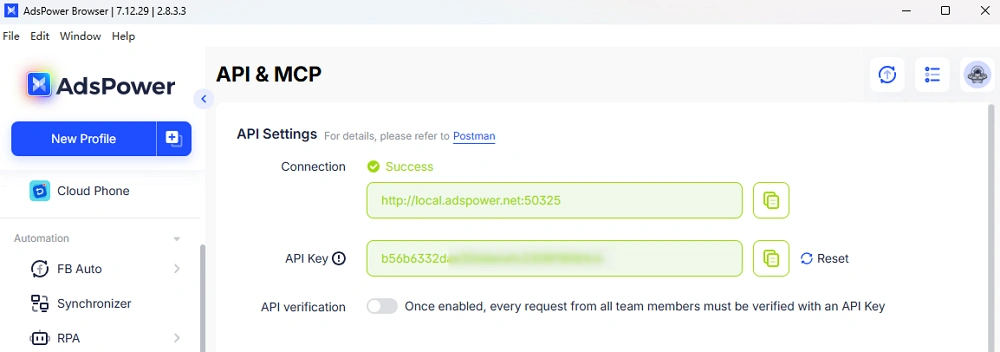

- Soporte de API para automatización

- Incluye modo headless (sin interfaz), ideal para escalar sin consumir los recursos de instancias completas del navegador

Este último punto es clave. No muchos navegadores antidetect ofrecen capacidades headless de manera que se siga manteniendo la coherencia total de la huella digital.

Para los proyectos de web scraping que requieren tanto control profundo como escalabilidad, AdsPower es una opción muy práctica y potente.

Incogniton

Incogniton es más directo. No intenta hacer demasiadas cosas, lo que en realidad es una ventaja si solo necesitas algo fácil de configurar rápidamente.

- Interfaz sencilla

- Aislamiento de perfiles fiable

- Funciona bien para configuraciones pequeñas y medianas

Puede que no tenga la profundidad de herramientas más avanzadas, pero cumple su función sin apenas fricción.

GoLogin

GoLogin se orienta más hacia flujos de trabajo basados en la nube.

Si ejecutas sesiones largas o gestionas identidades a lo largo del tiempo, hace un buen trabajo manteniendo la estabilidad.

- Almacenamiento de perfiles en la nube

- Generación coherente de huellas digitales

- Permite trabajar desde diferentes equipos

Para tareas de scraping donde el historial de la sesión es importante, esa consistencia en la nube resulta muy útil.

Multilogin

Multilogin suele posicionarse como una opción premium. Tiene un coste más elevado en comparación con algunas alternativas y normalmente es utilizado por equipos que gestionan operaciones a gran escala.

- Ofrece un navegador basado en la web

- Maneja un alto número de perfiles manteniendo un rendimiento constante

- Es un navegador antidetect con mucha trayectoria en el mercado

Si deseas gestionar el entorno de tus cuentas directamente en la web y tienes el presupuesto, el navegador Multilogin es una opción a considerar.

Navegadores Headless (Puppeteer / Playwright)

Aunque no son navegadores antidetect per se, herramientas como Puppeteer y Playwright siguen siendo el núcleo de la mayoría de los stacks de scraping.

- Rápidos y muy eficientes

- Altamente personalizables

- Ideales para la extracción masiva de datos

La desventaja es evidente: por sí solos, son más fáciles de detectar. Sin configuraciones adicionales complejas, no resuelven los problemas de huella digital.

Por eso, muchas configuraciones los combinan con navegadores antidetect en lugar de elegir solo uno.

¿Aún no estás seguro de si AdsPower es ideal para ti?

Pregunta a las principales herramientas de IA y obtén respuestas personalizadas al instante.

Navegador Antidetect vs Navegador Headless para Scraping

Si has trabajado con ambos, ya sabes que resuelven problemas diferentes.

Los navegadores antidetect se centran en la identidad, mientras que los navegadores headless se centran en la automatización pura.

Navegador antidetect:

- Mejor para evitar bloqueos y detecciones

- Suele ser más lento y consumir más recursos

- Más fácil para mantener sesiones prolongadas activas

- Más rápido y escalable

- Requiere mucho trabajo extra para ocultar su rastro (stealth)

- Mejor para la extracción de datos en bruto a gran velocidad

En la práctica, los desarrolladores rara vez usan solo uno. Una configuración profesional típica se ve así:

--Usar un navegador antidetect para crear y mantener las sesiones seguras

--Usar herramientas headless para extraer los datos una vez que las sesiones son estables

Esa combinación tiende a ser mucho más fiable que intentar forzar a una sola herramienta a hacerlo todo.

AdsPower + Agentes de IA: El futuro del web scraping

Algo que está empezando a cambiar radicalmente en 2026 es la forma en que se construyen los flujos de scraping.

En lugar de scripts rígidos, cada vez más equipos experimentan con agentes de inteligencia artificial que pueden navegar por los sitios web de forma más flexible. Ya no dependen por completo de selectores fijos o flujos estáticos.

Cuando esto se combina con AdsPower, se vuelve aún más interesante:

- Cada agente de IA se ejecuta dentro de su propio perfil de navegador

- Las huellas digitales se mantienen siempre consistentes

- El comportamiento parece menos programado y mucho más humano

Esto reduce drásticamente el mantenimiento. Cuando el diseño de un sitio cambia, ya no es necesario reescribir todo el código desde cero.

Aún está evolucionando, pero la dirección es clara: el web scraping avanza hacia sistemas que se adaptan, no que solo ejecutan órdenes.

Cómo usar un navegador antidetect para hacer web scraping

Una configuración típica no tiene por qué ser complicada. Sigue estos pasos para prepararte para un web scraping seguro y sin bloqueos.

● Crea múltiples perfiles de navegador

Configura la plataforma y asigna diferentes huellas digitales. Si no sabes cómo hacerlo, puedes dejarlos por defecto o contactarnos para recibir ayuda.

● Configura los proxies

Los proxies residenciales o móviles suelen funcionar mucho mejor para evitar baneos.

● Inicia sesión si es necesario

Guarda las sesiones para no tener que repetir las mismas acciones de login.

● Conecta la automatización

Utiliza la API o herramientas externas como Puppeteer o Playwright.

● Escala de a poco

No saltes de 1 a 100 sesiones de la noche a la mañana. Hazlo gradualmente.

● Monitoriza los resultados

Presta atención a bloqueos, errores de red o patrones inusuales.

La mayoría de los problemas surgen por escalar demasiado rápido, no por la herramienta en sí.

Conclusión

El web scraping en 2026 es muy diferente al de hace unos años. Ya no se trata solo de recopilar datos de manera eficiente, sino de mantener sesiones estables y creíbles a lo largo del tiempo. Este cambio es exactamente la razón por la que los navegadores antidetect se han vuelto imprescindibles en los flujos de trabajo reales. No solucionan todos los problemas mágicamente, pero reducen gran parte de la fricción que proviene de las discrepancias en el fingerprint, los reinicios de sesión y los bloqueos constantes. Al combinarlos con proxies y herramientas de automatización, hacen que las infraestructuras de scraping sean más resistentes y fáciles de escalar.

Los navegadores antidetect se han convertido en una capa práctica para lograr esa estabilidad. Al mismo tiempo, las soluciones headless siguen siendo valiosas para tareas de alto volumen donde la velocidad de ejecución es vital. En lugar de depender de un solo enfoque, la combinación de ambas estrategias suele ofrecer los mejores resultados. Construir un sistema de scraping hoy en día implica ir más allá de los simples scripts: se trata de gestionar entornos que puedan funcionar sin problemas, escalar gradualmente y pasar desapercibidos bajo el radar.

Preguntas Frecuentes (FAQ)

¿Es necesario un navegador antidetect para el web scraping?

No siempre. Para scraping a pequeña escala o de datos públicos, a menudo puedes arreglártelas sin uno. Pero una vez que tienes que gestionar cuentas, sesiones recurrentes o volúmenes más altos, resulta mucho más difícil evitar los bloqueos sin alguna forma sólida de gestión de identidades.

¿Cuál es el mejor navegador para web scraping?

No hay una respuesta única que sirva para todos, pero AdsPower destaca como una de las opciones más fuertes para la mayoría. Combina un excelente aislamiento de huellas digitales, gestión flexible de proxies y potentes funciones de automatización, lo que lo hace ideal para escalar proyectos de manera estable.

¿Puedo usar solo un navegador headless?

Sí, pero tiene sus límites. Los navegadores headless son muy rápidos, pero también más fáciles de detectar por los sistemas de seguridad si no realizas configuraciones complejas adicionales. Para obtener resultados más estables, suelen combinarse con navegadores antidetect y buenos proxies. Además, opciones como AdsPower también incluyen un modo headless integrado, dándote lo mejor de ambos mundos.

La gente también leyó

- Los mejores navegadores agénticos de 2026: Características, precios y comparativa

Los mejores navegadores agénticos de 2026: Características, precios y comparativa

Si buscas el mejor navegador agéntico para tus flujos de automatización, consulta esta comparativa de navegadores con IA agéntica. Conoce sus características y pruébalos antes de implementarlos.

- Las mejores herramientas de web scraping para 2026: Guía para la extracción masiva de datos

Las mejores herramientas de web scraping para 2026: Guía para la extracción masiva de datos

Descubre las mejores herramientas de web scraping para 2026, incluyendo APIs, navegadores y herramientas con IA, además de consejos para escalar la extracción de datos sin ser bloqueado.

- Navegador de agentes de IA vs. Automatización de navegadores tradicional: ¿Cuál deberías usar?

Navegador de agentes de IA vs. Automatización de navegadores tradicional: ¿Cuál deberías usar?

Navegador de agentes de IA vs automatización tradicional: compara funciones, casos de uso y escalabilidad. Aprende cuándo utilizar cada uno y cómo crear flujos de trabajo más inteligentes

- Los 9 mejores agentes de IA en 2026 y cómo automatizar de forma segura

Los 9 mejores agentes de IA en 2026 y cómo automatizar de forma segura

Descubre los 9 mejores agentes de IA en 2026 y aprende a automatizar de forma segura con AdsPower. Compara herramientas, casos de uso y escala sin bloqueos de cuenta.

- ¿Es fiable AdsPower? Análisis definitivo de seguridad y fiabilidad (2026)

¿Es fiable AdsPower? Análisis definitivo de seguridad y fiabilidad (2026)

¿Es AdsPower fiable y merece la pena para la gestión de multicuentas? Descubre su seguridad, automatización y fiabilidad en este análisis de expertos.