Las mejores herramientas de web scraping para 2026: Guía para la extracción masiva de datos

Eche un vistazo rápido

Escalar el web scraping conlleva enfrentarse a bloqueos, CAPTCHAs e inestabilidad. Para tener éxito, es vital gestionar huellas digitales, sesiones y la infraestructura con la combinación adecuada de herramientas para una extracción de datos fiable e indetectable. ¡Síguenos para probarlo!

Si solo has extraído datos de un par de páginas, puede parecer sorprendentemente fácil. Un script sencillo, quizás un proxy, y los datos fluyen sin mucha resistencia. En tareas pequeñas, todo funciona con tanta fluidez que casi parece no requerir esfuerzo. Sin embargo, esa sensación de control desaparece rápidamente en cuanto intentas escalar a grandes volúmenes.

En cuanto pasas al scraping a gran escala, todo se vuelve menos predecible. Las peticiones empiezan a bloquearse, las sesiones se caen y cómo evitar los CAPTCHA en el web scraping se convierte rápidamente en una preocupación real, no en un caso aislado. Lo que funcionaba bien con un lote pequeño empieza a ralentizarse o se rompe por completo. Llegados a este punto, el scraping ya no consiste solo en extraer código HTML, sino en gestionar identidades, lidiar con páginas dinámicas y mantener tu sistema estable bajo presión constante. Esta guía se centra en lo que realmente funciona en esas condiciones y por qué tantas configuraciones fracasan antes de llegar a ese nivel.

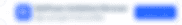

Por qué fallan la mayoría de las herramientas de web scraping a gran escala

El mayor error de concepto en el web scraping es pensar que el éxito a pequeña escala se traduce en fiabilidad a gran escala. No es así.

Aquí es donde las cosas suelen fallar:

- El bloqueo de IPs aumenta rápidamente

¿Unas pocas peticiones por minuto? Bien. ¿Miles por hora? Te detectarán muy rápido.

- La detección de huellas digitales va más allá de las IPs

Las webs modernas ya no solo rastrean tu IP; analizan la huella digital del navegador, patrones de comportamiento y la consistencia de la sesión.

- El contenido dinámico lo complica todo

Las páginas con mucho JavaScript requieren el renderizado completo del navegador. Las peticiones HTTP simples ya no son suficientes.

- Los CAPTCHA interrumpen los flujos de trabajo

A gran escala, los desafíos CAPTCHA no son ocasionales, son constantes.

- El mantenimiento se convierte en un trabajo a tiempo completo

Los cambios en el diseño web, las actualizaciones antibot y los límites de peticiones obligan a realizar ajustes continuamente.

En resumen, el scraping a gran escala no es solo un problema de programación. Es un problema de infraestructura y sigilo.

Tipos de herramientas para web scraping

Elegir la herramienta adecuada depende de tus conocimientos técnicos, el volumen de datos que necesites y tu tolerancia al mantenimiento. Analicemos las principales categorías.

1. Frameworks basados en código

Este es básicamente el camino del "hágalo usted mismo". Si alguna vez has creado un scraper desde cero, probablemente empezaste por aquí. Te da control total, pero también significa que eres responsable de todo.

Ideal para:

- Desarrolladores que quieren controlar cada detalle

- Proyectos que no encajan en herramientas prefabricadas

- Lógicas de scraping más complejas

Ventajas:

- Puedes personalizar casi cualquier cosa

- Fácil de integrar en tus propios sistemas

- Control total sobre cómo se recopilan y procesan los datos

Inconvenientes:

- Requiere saber programar (obviamente)

- El mantenimiento puede volverse caótico con el tiempo

- Probablemente necesites herramientas adicionales para proxies, CAPTCHA, etc.

2. Scrapers visuales / Sin código (Ideales para principiantes)

Estas herramientas apuestan por la velocidad y la simplicidad. No escribes código, solo haces clic y defines lo que quieres extraer.

Ideal para:

- Personas sin perfil técnico

- Tareas de scraping pequeñas o rápidas

- Probar ideas rápidamente

Ventajas:

- Fáciles de aprender

- Rápidas para poner algo en marcha

- No requieren programación

Inconvenientes:

- Poca flexibilidad

- Se rompen fácilmente en sitios complejos o dinámicos

- No escalan bien

3. APIs de Scraping (Ideales para escalar sin mantenimiento)

Las APIs de scraping se encargan del trabajo duro. Envías una petición y ellas gestionan proxies, reintentos y, a veces, incluso el renderizado en segundo plano. Si quieres entender cómo funciona esto en la práctica, sobre todo a gran escala, merece la pena investigar sobre el uso de proxies para el web scraping sin ser bloqueado.

Ideal para:

- Equipos que no quieren gestionar infraestructuras

- Scraping de gran volumen

- Implementaciones más rápidas

Ventajas:

- La rotación de IPs se gestiona automáticamente

- Lógica de reintentos integrada

- A menudo soportan navegadores headless (sin interfaz)

Inconvenientes:

- Los costes pueden dispararse

- Menor control sobre el proceso

- Dependencia de un servicio de terceros

4. Herramientas de Web Scraping con IA (Tendencia emergente)

Se trata de un enfoque más novedoso. En lugar de escribir selectores, solo describes qué datos necesitas y la herramienta intenta descubrirlos por sí misma.

Ideal para:

- Experimentos rápidos

- Estructuras web caóticas o que cambian con frecuencia

- Ahorrar tiempo en la configuración

Ventajas:

- Se adaptan cuando las estructuras de las páginas cambian

- Menos ajustes manuales

- Más rápidas para empezar

Inconvenientes:

- No siempre son precisas

- Aún están en evolución

- Pueden tener problemas con los sistemas antibot

5. Navegadores de Scraping

Aquí es donde las cosas empiezan a parecer más "reales". En lugar de limitarse a enviar peticiones, estas herramientas intentan actuar como usuarios reales.

Gestionan huellas digitales, cookies, sesiones... básicamente todo lo que haría un navegador normal.

Ideal para:

- Evitar la detección

- Gestionar múltiples cuentas

- Extraer datos de plataformas protegidas

Ventajas:

- Se comportan como un usuario real

- Mantienen la consistencia de las sesiones

- Ayudan a reducir bloqueos y baneos

Inconvenientes:

- Lleva tiempo configurarlos correctamente

- Suelen usarse junto a otras herramientas

Las mejores herramientas de web scraping que deberías probar

No todas las herramientas de scraping rinden bien cuando empiezas a manejar grandes volúmenes. Algunas suenan muy bien en teoría, pero fracasan bajo presión. Las que presentamos a continuación son aquellas en las que confían los profesionales cuando necesitan que los sistemas funcionen de forma continua y a gran escala.

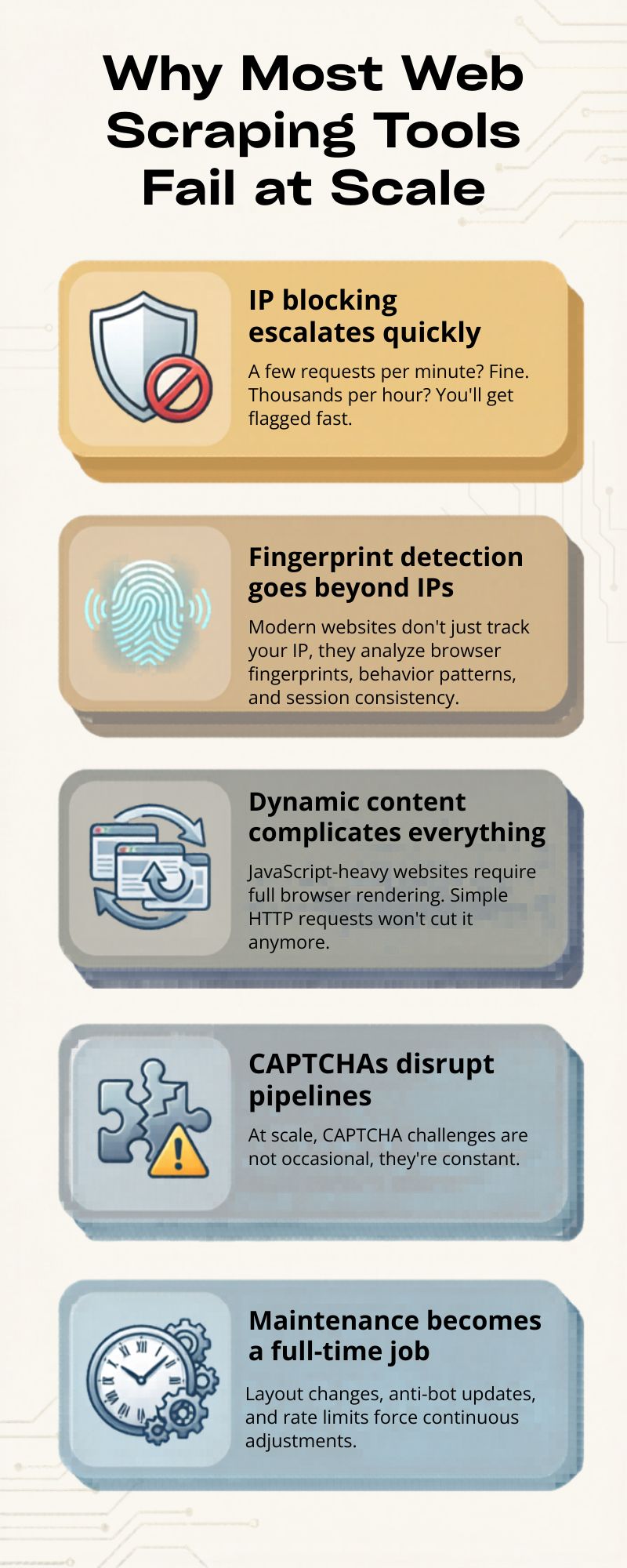

1. AdsPower

Cuando extraes datos de plataformas con potentes sistemas antibot, herramientas como AdsPower se vuelven casi indispensables.

No es solo un navegador en el sentido habitual; está diseñado para simular entornos de usuarios reales, lo que marca una gran diferencia cuando intentas pasar desapercibido.

Aspectos clave que debes conocer:

- Cada perfil tiene su propia huella digital aislada

- Los perfiles se comportan como dispositivos físicos independientes

- Soporta RPA para automatizar flujos de trabajo

- Permite integrar resolutores de CAPTCHA

- Mantiene las sesiones estables utilizando cookies y almacenamiento local

A grandes volúmenes, este enfoque suele funcionar mejor que simplemente aumentar la velocidad de las peticiones. No estás forzando el acceso; te estás camuflando. Para el scraping de comercio electrónico, redes sociales o marketplaces, esto suele traducirse en menos baneos y menos tiempo de inactividad.

2. Scrapingdog

Scrapingdog mantiene las cosas simples, que es exactamente la razón por la que algunos equipos lo prefieren.

Lo que hace bien:

- Gestiona proxies y el renderizado en segundo plano

- Funciona de forma fiable para la extracción de datos estructurados

- API limpia y sencilla

Si no quieres lidiar con la configuración de la infraestructura y solo necesitas algo que funcione, esta es una opción muy razonable.

3. ScraperAPI

ScraperAPI se centra más en la estabilidad que en cualquier otra cosa.

Características principales:

- Rotación automática de IP

- Gestión de CAPTCHAs integrada

- Diseñada para alcanzar altas tasas de éxito a gran escala

Es una buena opción para trabajos de scraping continuos en los que la consistencia importa más que la personalización.

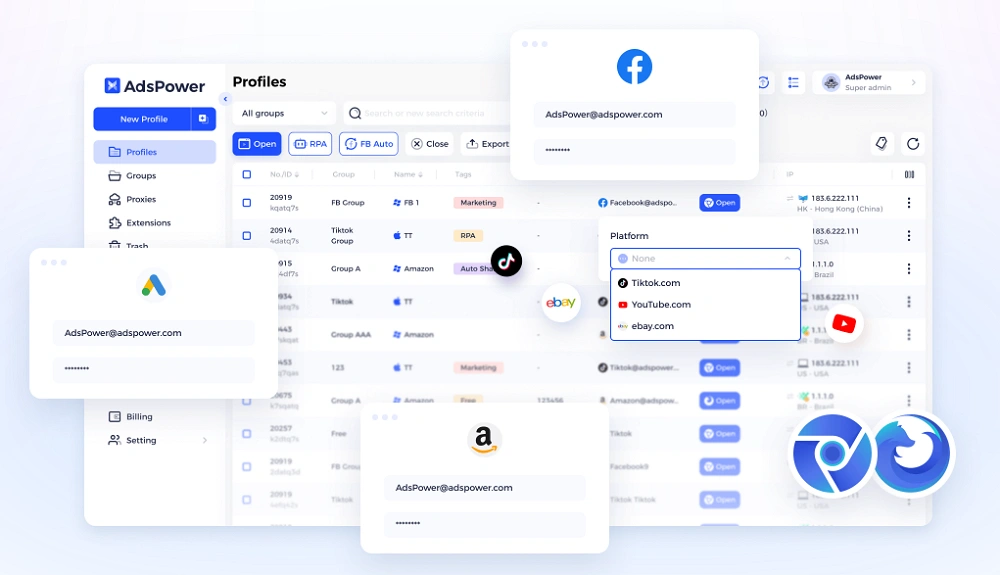

4. Bright Data

Bright Data se sitúa en el extremo más avanzado del mercado.

Lo que ofrece:

- Red masiva de proxies (residenciales, móviles y de centro de datos)

- Opciones de segmentación muy precisas

- Servicios adicionales de recopilación de datos

No es la herramienta más sencilla de configurar, y su precio lo refleja. Pero para operaciones a gran escala, ofrece un nivel de cobertura difícil de igualar.

5. Apify

Apify es el tipo de herramienta a la que la gente suele pasarse después de probar opciones más simples. Ahorra tiempo, pero te sigue permitiendo ajustar detalles cuando es necesario.

- Cuenta con "actores" listos para usar en trabajos de scraping comunes

- Ejecuta todo en la nube, por lo que no tienes que gestionar servidores

- Fácil de escalar cuando aumenta la carga de trabajo

- Ecosistema sólido con herramientas y plantillas compartidas

No es excesivamente compleja, pero tampoco es puramente "plug-and-play"; se encuentra en un punto intermedio, lo cual resulta ideal para muchos equipos.

6. Playwright

Playwright es más bien una herramienta para desarrolladores, y se nota. Se usa muchísimo porque funciona de maravilla y con total fiabilidad en webs modernas.

- Soporta Chromium, Firefox y WebKit

- Maneja muy bien las páginas dinámicas y con mucho JavaScript

- Suficientemente estable para automatizaciones de larga duración

- Flexible si necesitas personalizar el comportamiento

La mayoría de los sistemas de scraping personalizados acaban utilizando algo como esto en sus entrañas.

7. Octoparse

Octoparse suele ser la opción que prueba la gente cuando no quiere lidiar en absoluto con el código.

- Interfaz visual, basada sobre todo en apuntar y hacer clic

- Rápida para empezar con tareas básicas de scraping

- Buena para proyectos pequeños o trabajos puntuales

- Incluye plantillas para los sitios web más comunes

Resulta muy práctica al principio, pero una vez que las cosas se complican o el volumen aumenta, puede resultar algo limitante.

Tabla comparativa rápida

Llegados a este punto, está bastante claro que no existe una única herramienta que lo haga todo a la perfección. Algunas son más fáciles de usar, otras te dan más control y otras están creadas específicamente para escalar.

En lugar de darle demasiadas vueltas, resulta útil verlas unas al lado de las otras, especialmente cuando comparamos opciones como el mejor navegador antidetección para web scraping. La siguiente tabla ofrece una idea rápida de dónde encaja cada una y para qué se suelen utilizar.

|

Herramienta |

Tipo |

Ideal para |

Punto fuerte |

|

AdsPower |

Navegador de Scraping |

Antidetección y escalado |

Aislamiento de huellas digitales |

|

Scrapingdog |

API |

Tareas de scraping sencillas |

Facilidad de uso |

|

ScraperAPI |

API |

Flujos de trabajo a gran escala |

Fiabilidad |

|

Bright Data |

API / Red de proxies |

Scraping empresarial |

Cobertura |

|

Apify |

Plataforma |

Automatización + scraping |

Flexibilidad |

|

Playwright |

Framework |

Soluciones personalizadas |

Control |

|

Octoparse |

Sin código (No-code) |

Principiantes |

Simplicidad |

¿Aún no tienes claro si AdsPower es adecuado para ti?

Pregunta a las principales herramientas de IA y obtén respuestas instantáneas y personalizadas

Reflexiones finales

A estas alturas, está bastante claro que el web scraping en 2026 no consiste en encontrar la herramienta perfecta y olvidarse. Lo que realmente funciona en la práctica es una combinación de herramientas, cada una encargada de una parte diferente del proceso. Una capa puede ocuparse de la automatización, otra de los proxies y las peticiones, y otra de la gestión de sesiones e identidades. Una configuración habitual suele incluir algo como Playwright para controlar el navegador, una API de scraping como ScraperAPI o Bright Data para gestionar la infraestructura, y una herramienta como AdsPower para administrar las huellas digitales y mantener la coherencia de las sesiones. Ninguna sustituye a las demás; trabajan en equipo.

Si hay algo que merece la pena recordar, es que pasar desapercibido importa mucho más que la velocidad. Enviar más peticiones no sirve de nada si te bloquean a mitad de camino. Un sistema más lento pero estable casi siempre superará a uno agresivo. Céntrate en la consistencia y verás que escalar se vuelve mucho más fácil con el tiempo.

Preguntas Frecuentes (FAQs)

¿Cómo gestionar los CAPTCHAs en los flujos de scraping?

A gran escala, los CAPTCHAs son inevitables, por lo que el objetivo es gestionarlos en lugar de eliminarlos. La mayoría de las configuraciones reducen las alertas ralentizando la tasa de peticiones, reutilizando sesiones y simulando el comportamiento humano. Además de eso, muchos equipos integran servicios de resolución de CAPTCHAs para mantener los procesos funcionando sin intervención manual. En la práctica, es una mezcla de técnicas (proxies, tiempos de espera y comportamiento) lo que ayuda a mantener la estabilidad, en vez de depender de una única solución.

¿Por qué aparecen más CAPTCHAs al escalar?

Cuando aumenta el volumen de scraping, los patrones son más fáciles de detectar para los sitios web. Las acciones repetitivas, las peticiones idénticas o los tiempos poco naturales pueden levantar sospechas rápidamente. Los CAPTCHAs se usan para verificar si el tráfico es humano, así que cuanto más parezca tu comportamiento el de un "bot", más a menudo aparecerán. Por eso, escalar no se trata solo de enviar más peticiones, sino de hacer que esas peticiones parezcan menos predecibles y más propias de usuarios reales.

¿Por qué tu sistema de scraping necesita protección de la huella digital?

Los proxies por sí solos ya no son suficientes. Los sitios web analizan ahora las huellas digitales del navegador, la configuración del dispositivo y los patrones de comportamiento para detectar bots. Sin protección de la huella digital, hasta la rotación de IPs puede ser detectada. Al crear entornos de navegación aislados, las herramientas de huella digital hacen que cada sesión parezca más realista y coherente. Esto ayuda a reducir los bloqueos y mantiene los flujos de scraping funcionando sin problemas, sobre todo a grandes volúmenes.

La gente también leyó

- Los mejores navegadores agénticos de 2026: Características, precios y comparativa

Los mejores navegadores agénticos de 2026: Características, precios y comparativa

Si buscas el mejor navegador agéntico para tus flujos de automatización, consulta esta comparativa de navegadores con IA agéntica. Conoce sus características y pruébalos antes de implementarlos.

- Mejor navegador antidetect para web scraping en 2026

Mejor navegador antidetect para web scraping en 2026

Descubre los mejores navegadores antidetect para web scraping en 2026. Compara las principales herramientas, sus funciones clave y aprende cómo evitar bloqueos al escalar tus extracciones.

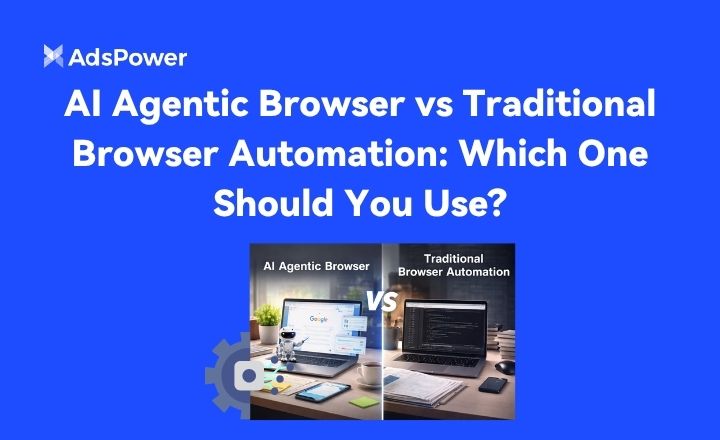

- Navegador de agentes de IA vs. Automatización de navegadores tradicional: ¿Cuál deberías usar?

Navegador de agentes de IA vs. Automatización de navegadores tradicional: ¿Cuál deberías usar?

Navegador de agentes de IA vs automatización tradicional: compara funciones, casos de uso y escalabilidad. Aprende cuándo utilizar cada uno y cómo crear flujos de trabajo más inteligentes

- Los 9 mejores agentes de IA en 2026 y cómo automatizar de forma segura

Los 9 mejores agentes de IA en 2026 y cómo automatizar de forma segura

Descubre los 9 mejores agentes de IA en 2026 y aprende a automatizar de forma segura con AdsPower. Compara herramientas, casos de uso y escala sin bloqueos de cuenta.

- ¿Es fiable AdsPower? Análisis definitivo de seguridad y fiabilidad (2026)

¿Es fiable AdsPower? Análisis definitivo de seguridad y fiabilidad (2026)

¿Es AdsPower fiable y merece la pena para la gestión de multicuentas? Descubre su seguridad, automatización y fiabilidad en este análisis de expertos.