Comment éviter les CAPTCHA lors du web scraping en 2026

Jetez un coup d'oeil rapide

Les contrôles CAPTCHA sont devenus plus stricts, notamment pour le scraping à grande échelle. Ce qui fonctionnait il y a quelques années n'est plus adapté. De nombreux scrapers rencontrent désormais des difficultés avec des interruptions fréquentes, des requêtes échouées ou des sessions bloquées.

Ne manquez pas ces méthodes pratiques pour contourner les CAPTCHA lors du web scraping . Plutôt que des astuces rapides, l'accent est mis sur la mise en place d'une configuration stable dans le temps.

Pourquoi les sites web déclenchent-ils un CAPTCHA pour les scrapers ?

Les sites web n'affichent pas de CAPTCHA au hasard. Il apparaît généralement lorsqu'une anomalie est constatée.

La plupart des déclencheurs se répartissent en quelques catégories :

Type de déclencheur | Ce qui se passe en pratique |

réputation en matière de propriété intellectuelle | Les adresses IP partagées ou signalées sont rapidement contestées. |

Comportement de la demande | Trop d'actions en peu de temps |

réutilisation des empreintes digitales | Plusieurs sessions semblent identiques |

Données de session manquantes | Aucun cookie ni historique de navigation |

Modèles d'interaction | Aucun mouvement de souris ni clic instantané |

Les plateformes comme reCAPTCHA s'appuient sur une combinaison de ces signaux. Si plusieurs d'entre eux paraissent suspects simultanément, une vérification est déclenchée.

Vous pouvez consulter ici comment Google évalue les signaux de trafic : https://developers.google.com/recaptcha

Comment fonctionne la détection CAPTCHA en 2026

Pour réduire la fréquence des CAPTCHA, il est utile de comprendre ce qui est mesuré en coulisses.

Évaluation des adresses IP et du trafic

Chaque requête est associée à une adresse IP. Les sites web consultent :

-

Que l'adresse IP appartienne à un utilisateur réel ou à un centre de données

-

À quelle fréquence envoie-t-il des requêtes

-

Si le lieu change trop souvent

Une adresse IP résidentielle propre avec un trafic modéré est beaucoup moins susceptible de déclencher un CAPTCHA.

Empreinte numérique du navigateur

C’est là que de nombreuses configurations échouent. Les sites web collectent des informations telles que :

-

Version navigateur

-

Système opérateur

-

Taille de l'écran

-

rendu graphique

-

Polices installées

Si dix sessions partagent la même empreinte numérique, elles ne ressemblent pas à dix utilisateurs. Elles ressemblent à un seul script.

Analyse comportementale

L'automatisation se comporte souvent de manière prévisible. Par exemple :

-

Cliquer sans faire défiler

-

Chargement des pages trop rapide

-

Répéter le même schéma temporel

Ces signaux sont faciles à détecter lorsqu'ils se répètent.

Confiance de session et cookies

Certains systèmes attribuent des scores de confiance en fonction de l'historique des sessions. Par exemple :

-

Les utilisateurs réguliers disposant de cookies valides rencontrent moins de difficultés.

-

Les nouvelles sessions sont testées plus fréquemment.

Google reCAPTCHA v3 repose en grande partie sur ce modèle de notation.

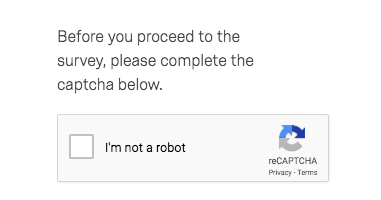

Types de CAPTCHA que vous rencontrerez

Les systèmes CAPTCHA ne fonctionnent pas tous de la même manière. Certains sites web utilisent différents niveaux de protection.

Type de CAPTCHA | Difficulté | Notes |

Basé sur le texte | Faible | Les systèmes plus anciens sont plus faciles à résoudre. |

Sélection d'images | Moyen | Courant dans reCAPTCHA |

Case à cocher (v2) | Moyen | Souvent appuyé par des contrôles plus approfondis |

Invisible (v3) | Haut | Basé sur l'évaluation du comportement |

puzzles interactifs | Haut | Curseurs, actions de glisser-déposer, etc. |

Connaître le type de problème vous aide à décider s'il faut l'éviter ou le résoudre.

CAPTCHA textuel

Lettres ou chiffres déformés. Moins courant aujourd'hui, mais encore utilisé sur les petits sites.

CAPTCHA de reconnaissance d'images

Sélectionnez des images avec des feux de circulation, des voitures ou des passages piétons. Fréquemment utilisées dans reCAPTCHA.

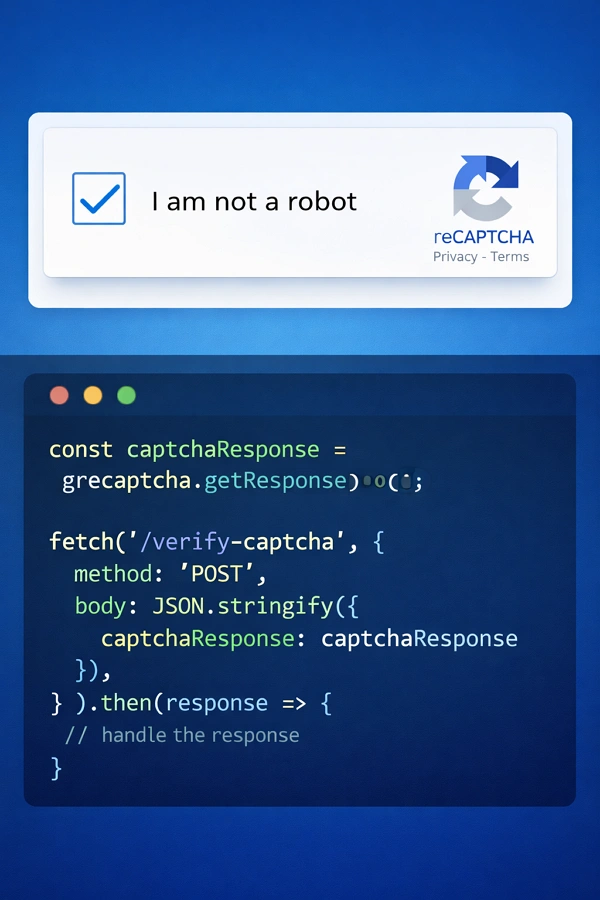

CAPTCHA à cocher (reCAPTCHA v2)

Une simple case à cocher « Je ne suis pas un robot ». Souvent complétée par des vérifications plus approfondies.

CAPTCHA invisible (reCAPTCHA v3)

Aucun défi visible. Les utilisateurs sont évalués silencieusement en fonction de leur comportement.

CAPTCHA interactif

Inclut des curseurs, des puzzles ou des tâches de type glisser-déposer. Courant chez les fournisseurs de solutions anti-bots comme hCaptcha.

Est-il possible d'éviter complètement les CAPTCHA lors du web scraping ?

En bref, non.

Même les systèmes les mieux configurés peuvent rencontrer occasionnellement des CAPTCHA. L'objectif est de réduire leur fréquence d'apparition et de prolonger la durée des sessions.

Une configuration stable remplit bien trois fonctions :

- Garantit la cohérence des identités

- Évite les pics d'activité suspects

- Instaure un climat de confiance au sein de la session au fil du temps.

Comment éviter les CAPTCHA lors du web scraping

Éviter les CAPTCHA ne se résume pas à une simple astuce. Il s'agit de réduire les signaux de risque sur l'ensemble de votre infrastructure. Les méthodes ci-dessous proposent des changements pratiques pour que votre trafic ressemble davantage à celui d'utilisateurs réels.

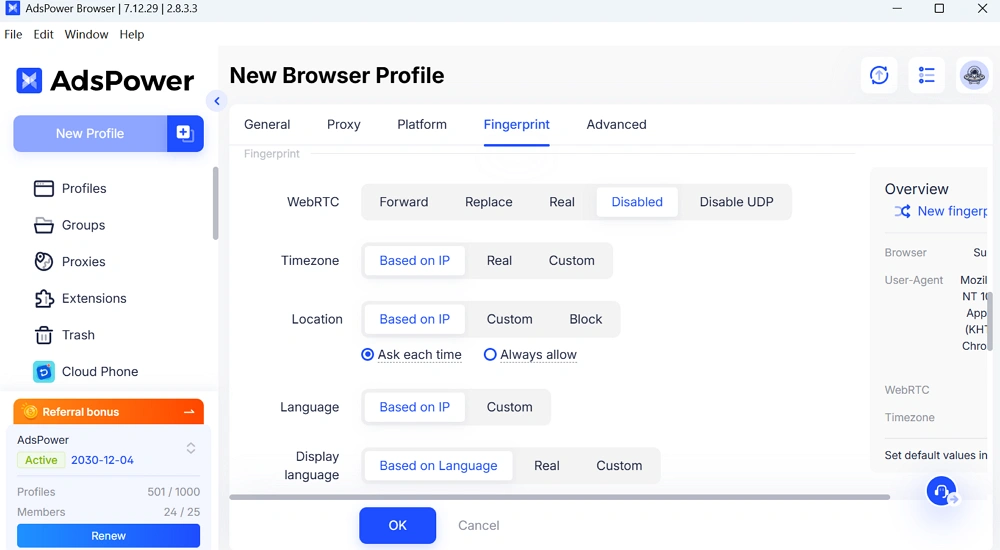

1. Établir une identité cohérente (Proxy + Empreinte digitale + Environnement de navigation)

C'est le fondement de tout.

Une session de web scraping doit se comporter comme un véritable utilisateur. Cela signifie :

- Une adresse IP par session

- Une empreinte numérique unique du navigateur

- Un profil de navigateur isolé

Si ces éléments ne correspondent pas, les sites web peuvent facilement détecter les incohérences.

L'utilisation d'un navigateur antidétection facilite la gestion à grande échelle. Au lieu de modifier manuellement les paramètres, chaque profil possède déjà une identité cohérente.

2. Utilisez des proxys résidentiels ou mobiles de haute qualité

Votre adresse IP joue un rôle majeur dans l'affichage ou non du CAPTCHA.

Voici un bref comparatif des différents types de proxys :

Type de proxy | Risque CAPTCHA | Notes |

centre de données | Haut | Rapide mais souvent signalé |

Faible | On dirait de vrais utilisateurs | |

Mobile | Très faible | Plus la confiance est élevée, plus le coût l'est aussi. |

Évitez les serveurs proxy gratuits inconnus. Ils sont souvent réutilisés et déjà bloqués.

3. Faire tourner les adresses IP en fonction des sessions, et non des requêtes.

Une rotation aléatoire peut créer des motifs artificiels.

Une meilleure approche :

-

Conserver la même adresse IP pendant une session

-

Effectuer la rotation uniquement au démarrage d'une nouvelle session

-

Associer l'emplacement IP aux paramètres du navigateur

Cela permet de maintenir un comportement cohérent et de réduire les soupçons.

4. Maintenir les sessions persistantes (cookies et stockage)

Les nouvelles séances sont traitées avec prudence.

Pour instaurer la confiance au fil du temps :

-

Enregistrer les cookies après chaque session

-

Réutilisez-les lors du retour

-

Évitez de vider votre espace de stockage trop souvent.

Une session axée sur l'histoire est moins susceptible de se heurter à des difficultés répétées.

5. Fréquence et calendrier des demandes de contrôle

La rapidité est un indice courant. Au lieu d'envoyer des requêtes rapides :

-

Ajouter des délais entre les actions

-

Répartissez les tâches dans le temps

-

Évitez les pics d'activité

Réfléchissez à la façon dont une personne réelle navigue sur Internet. Le schéma est rarement uniforme.

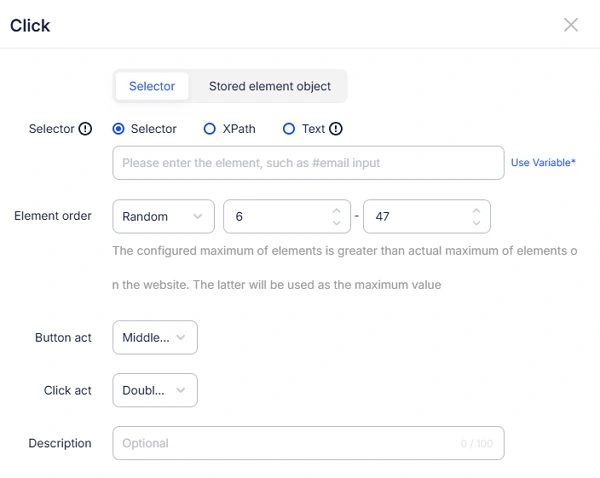

Dans le processus RPA d'AdsPower , vous pouvez configurer la position, l'ordre ou le moment des actions des éléments.

6. Simuler le comportement réel des utilisateurs

Le comportement est aussi important que la configuration technique. De petits ajustements peuvent faire la différence :

-

Défilez avant de cliquer

-

Passez d'une page à l'autre naturellement

-

Évitez les séquences de synchronisation identiques

Même une simulation d'interaction basique peut réduire les taux de détection.

7. Éviter la détection faible des navigateurs sans interface graphique

Les navigateurs sans interface graphique sont utiles, mais faciles à repérer s'ils ne sont pas modifiés.

Si vous les utilisez, assurez-vous de :

-

Les fonctionnalités du navigateur sont entièrement activées.

-

Les indicateurs d'automatisation sont masqués.

-

Le rendu semble normal.

Si vous utilisez le web scraping sans interface graphique, utilisez des configurations furtives ou passez à des environnements de navigateur complets lorsque cela est possible.

8. Gérez les CAPTCHA de manière stratégique (ne vous contentez pas de les éviter).

L'évitement fonctionne la plupart du temps, mais pas toujours.

Dans certains cas, la résolution du CAPTCHA est plus efficace :

-

Utilisez des services de résolution de problèmes basés sur l'intervention humaine pour plus de précision.

-

Utilisez des solveurs IA pour gagner en rapidité

-

Combinez les deux pour un équilibre

Cela garantit que votre flux de travail ne s'interrompt pas lors de l'affichage du CAPTCHA.

9. Évitez les pièges cachés des bots

De nombreux sites web intègrent des pièges invisibles conçus pour les robots.

Exemples :

-

Champs de formulaire cachés

-

Éléments non visibles pour les utilisateurs

-

Contrôles de détection basés sur JavaScript

Pour réduire les risques :

-

Toujours afficher les pages en entier

-

Interagir uniquement avec les éléments visibles

-

Validez la structure de la page avant d'agir

10. Alignez votre configuration avec le contexte utilisateur réel

Une erreur fréquente consiste à utiliser des signaux incompatibles.

Par exemple:

-

Adresse IP américaine avec fuseau horaire asiatique

-

IP mobile avec empreinte digitale de bureau

-

Paramètres de langue qui ne correspondent pas à l'emplacement

Ces incohérences attirent rapidement l'attention.

Assurez-vous que votre :

-

Emplacement IP

-

Fuseau horaire

-

Langue

-

Type d'appareil

Tout s'aligne naturellement.

Récapitulatif rapide

Une configuration de scraping stable combine généralement :

Couche | Sur quoi se concentrer |

Réseau | Adresses IP propres et fiables |

Environnement | Empreintes digitales uniques |

Comportement | Interaction de type humain |

Session | Cookies persistants |

Lorsque ces différents éléments fonctionnent ensemble, le CAPTCHA apparaît beaucoup moins souvent.

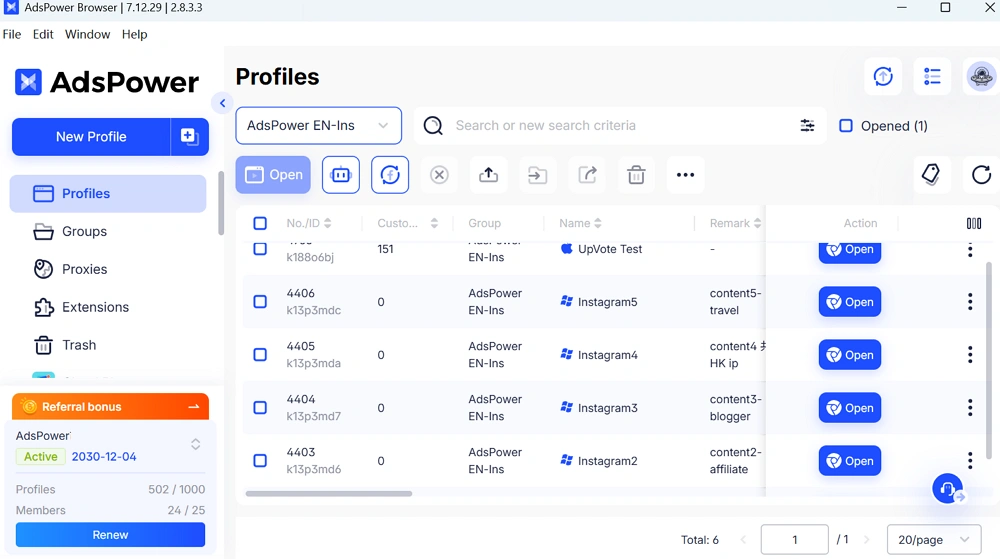

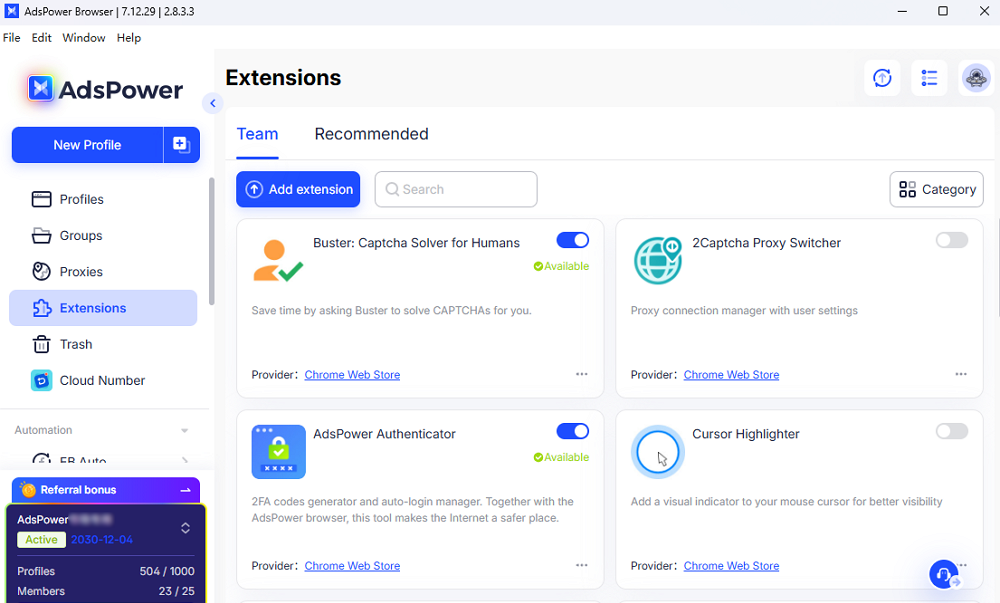

Comment AdsPower résout les CAPTCHA lors du web scraping

Lorsque vous gérez plusieurs sessions de scraping, le contrôle de l'environnement devient le principal défi. AdsPower est conçu pour y remédier.

Empreintes digitales indépendantes pour chaque profil

Chaque profil de navigateur dans AdsPower possède sa propre empreinte digitale.

Avec ces paramètres de profil, cela signifie :

- Les sessions ne se chevauchent pas.

- Les comptes restent séparés

- Le risque de détection est réduit.

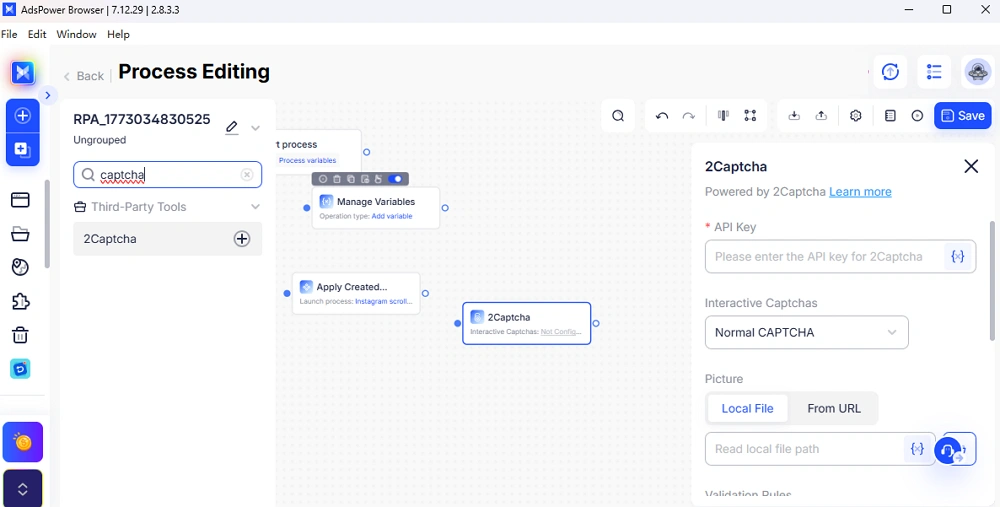

Automatisation RPA avec intégration CAPTCHA

AdsPower inclut des fonctionnalités RPA qui permettent d'automatiser les flux de travail.

Tu peux:

- Exécuter des tâches répétitives

- Intégrer des solveurs CAPTCHA tiers

- Maintenez un comportement cohérent d'une session à l'autre

Extension de prise en charge pour les solveurs CAPTCHA

AdsPower prend directement en charge les extensions de navigateur.

Vous pouvez installer des extensions populaires de résolution de CAPTCHA de Google pour automatiser vos processus.

Cela facilite la combinaison des stratégies d'évitement et de résolution.

👉 Vous pouvez explorer AdsPower et tester comment les profils de navigateur isolés améliorent la stabilité du scraping.

FAQ :

Quel est le meilleur type de proxy pour éviter les CAPTCHA ?

Les proxys résidentiels sont le choix le plus pratique dans la plupart des cas. Ils offrent une meilleure fiabilité que les adresses IP de centres de données. Les proxys mobiles peuvent être encore plus performants, mais ils sont plus coûteux.

Le web scraping headless déclenche-t-il toujours un CAPTCHA ?

Pas toujours, mais les configurations par défaut le font souvent.

Les navigateurs sans interface graphique peuvent révéler des signaux que les navigateurs classiques ne détectent pas. Sans paramétrage adéquat, la détection est rapide.

AdsPower peut-il contribuer à réduire la fréquence des CAPTCHA ?

Oui. AdsPower améliore la cohérence environnementale.

Grâce à l'identification unique des utilisateurs et à la stabilité des sessions, vos requêtes ressemblent davantage à celles de véritables utilisateurs. Cela réduit la fréquence d'affichage des CAPTCHA, notamment dans les configurations multi-comptes.

Réflexions finales

Pour éviter les CAPTCHA lors du web scraping, privilégiez la cohérence aux raccourcis.

Une configuration fiable combine :

- Adresses IP propres

- Environnements de navigateur uniques

- Modèles d'interaction réalistes

Si vous gérez plusieurs comptes ou effectuez des tâches de web scraping quotidiennement, l'utilisation d'un environnement de navigation contrôlé comme AdsPower peut rendre votre flux de travail plus stable au fil du temps.

👉 Inscrivez-vous à AdsPower pour créer votre premier profil et tester une configuration de scraping plus sûre.

Les gens lisent aussi

- Qu'est-ce qu'un numéro de téléphone cloud et comment le choisir pour votre entreprise ?

Qu'est-ce qu'un numéro de téléphone cloud et comment le choisir pour votre entreprise ?

Découvrez ce qu'est un numéro de téléphone cloud, comment il fonctionne et comment choisir le service adapté à vos besoins en matière de vérification, d'évolutivité et d'opérations commerciales.

- Carte SIM ou numéro virtuel : quelle est la différence entre une carte SIM et un numéro virtuel ?

Carte SIM ou numéro virtuel : quelle est la différence entre une carte SIM et un numéro virtuel ?

Comparez les cartes SIM et les numéros virtuels : principales différences, cas d’utilisation, avantages et inconvénients. Découvrez l’option qui correspond le mieux à vos besoins en matière de vérification et de confidentialité.

- Qu’est-ce qu’un navigateur agentique ? Définition, fonctionnement et cas d’utilisation de l’IA (Guide 2026)

Qu’est-ce qu’un navigateur agentique ? Définition, fonctionnement et cas d’utilisation de l’IA (Guide 2026)

Découvrez ce qu'est un navigateur agentique, comment il fonctionne avec les agents d'IA et pourquoi il est important pour l'automatisation, la gestion multi-comptes et les flux de travail évolutifs.

- Comment utiliser un agent IA OpenClaw pour se connecter à des comptes Google avec AdsPower

Comment utiliser un agent IA OpenClaw pour se connecter à des comptes Google avec AdsPower

Découvrez comment utiliser un agent IA OpenClaw avec AdsPower pour automatiser la connexion aux comptes Google sur un serveur via l'API et Puppeteer. Cela améliorera votre flux de travail.

- Comment les publicités vous suivent sur Internet et comment protéger votre vie privée

Comment les publicités vous suivent sur Internet et comment protéger votre vie privée

Découvrez comment les publicités vous suivent en ligne, comprenez le reciblage comportemental et protégez votre vie privée avec AdsPower.