Najlepsza przeglądarka z funkcją Anti-Detect do scrapowania stron internetowych w 2026 r.

Rzuć okiem

Odkryj najlepsze przeglądarki z funkcją Anti-Detect do web scrapingu w 2026 roku, zwiększ stabilność, unikaj wykrycia i skaluj wydajnie — czytaj dalej, aby znaleźć odpowiednie narzędzie do swojego dzisiejszego przepływu pracy.

Scraping stron internetowych bardzo się zmienił. Jeszcze niedawno można było uruchomić prosty skrypt i bez problemu zbierać dane. Teraz większość platform monitoruje znacznie więcej sygnałów w tle, od odcisku palca przeglądarki, przez interakcję ze stroną, aż po czas między kolejnymi działaniami. Gdy coś nie wygląda naturalnie, ograniczenia lub blokady mogą pojawić się niemal natychmiast, dlatego wielu programistów zaczyna szukać sposobów na scraping stron internetowych bez blokowania, zamiast polegać na podstawowych skryptach.

Tutaj właśnie pojawiają się przeglądarki z funkcją Anti-Detect. Zamiast ciągle naprawiać problemy z wykrywaniem po ich wystąpieniu, pozwalają one zacząć od bardziej realistycznej konfiguracji, wykorzystującej oddzielne tożsamości, stabilne sesje i zachowanie bliższe rzeczywistym użytkownikom. W tym przewodniku wyjaśnimy, jak działają i które narzędzia warto rozważyć w 2026 roku.

Dlaczego współczesne scrapowanie stron internetowych wymaga przeglądarki z funkcją Anti-Detect

To, co naprawdę się zmieniło w web scrapingu, to nie narzędzia, których używają ludzie, ale sposób, w jaki strony internetowe stawiają opór.

Większość platform łączy obecnie kilka poziomów detekcji jednocześnie. Zamiast tylko sprawdzać żądania, analizują one ogólny kontekst Twojej aktywności, w tym:

- Szczegóły odcisku palca przeglądarki, takie jak płótno, WebGL, czcionki i specyfikacje urządzenia

- Sygnały behawioralne, takie jak ruchy myszy i wzorce przewijania

- Reputacja IP i częstotliwość żądań

- Ciągłość sesji, w tym pliki cookie i spójność nagłówków

Problem polega na tym, że wszystko musi się zgadzać. Możesz wysyłać całkowicie poprawne żądania, ale jeśli coś jest nie tak z konfiguracją, to rzuca się to w oczy. Już sama niezgodność między agentem użytkownika a odciskiem palca WebGL może powodować podniesienie flagi. Jeśli zdarzy się to podczas powtarzania żądań z tego samego adresu IP, blokady zazwyczaj pojawiają się dość szybko.

Właśnie tutaj przeglądarki z funkcją antywykrywania robią różnicę. Zmniejszają te niespójności, dając Ci większą kontrolę nad środowiskiem:

- Każdy profil przeglądarki działa na podstawie własnego odcisku palca

- Sesje pozostają spójne w przypadku plików cookie, pamięci masowej i nagłówków

- Całkowita konfiguracja zachowuje się bardziej jak rzeczywiste środowisko użytkownika

Ostatecznie cel jest prosty. Zamiast wyglądać jak skrypt działający w tle, Twoja konfiguracja wtapia się w normalną aktywność użytkownika, co właśnie wydłuża czas działania przepływów pracy związanych ze scrapowaniem.

Czym jest przeglądarka Antidetect do web scrapingu?

Przeglądarka antywykrywcza to przeglądarka umożliwiająca uruchamianie wielu odizolowanych profili, każdy z własnym odciskiem palca i danymi sesji, dzięki czemu Twoja aktywność wydaje się pochodzić od różnych, prawdziwych użytkowników.

Czym różni się od standardowych przeglądarek

Zwykła przeglądarka nie została zaprojektowana z myślą o separacji tożsamości. Nawet jeśli zmienisz konto lub usuniesz pliki cookie, wiele ukrytych sygnałów pozostaje niezmienionych, co ułatwia stronom internetowym nawiązywanie sesji.

- Udostępnia spójny odcisk palca pomiędzy kartami i sesjami

- Ograniczona kontrola nad elementami odcisku palca, takimi jak WebGL, czcionki lub specyfikacje urządzenia

- Pliki cookie i pamięć można zresetować, ale głębsze identyfikatory pozostają

- Nie jest przeznaczony do obsługi wielu niezależnych tożsamości na dużą skalę

Przeglądarka z funkcją antywykrywczą rozwiązuje ten problem, izolując wszystko na poziomie profilu, przez co poszczególne sesje wydają się niepowiązane.

Czym różni się od narzędzi do scrapowania bezgłowego

Narzędzia headless koncentrują się na automatyzacji i szybkości, a nie na tym, jak „realistycznie” wygląda środowisko przeglądarki. Są potężne, ale domyślnie nadal mogą pozostawiać wykrywalne wzorce.

- Zoptymalizowany pod kątem automatyzacji przepływów pracy i skryptów

- Szybszy i lżejszy do zadań związanych ze skrobaniem na dużą skalę

- Łatwiejsze do wykrycia bez dodatkowej konfiguracji stealth

- Ograniczona wbudowana kontrola nad realistycznymi odciskami palców przeglądarki

Przeglądarki Antidetect skupiają się na przeciwnym aspekcie problemu, sprawiając, że środowiska są bardziej spójne i trudniej je ze sobą połączyć.

Dlatego w wielu rzeczywistych konfiguracjach są one używane razem. Jedna odpowiada za automatyzację, druga za tożsamość i ukrycie.

Kluczowe funkcje przeglądarki do scrapowania stron internetowych

Nie każda przeglądarka z funkcją Anti-Detect nadaje się do scrapowania. Niektóre są przeznaczone bardziej do zarządzania kontami, inne do procesów marketingowych. Jeśli Twoim głównym celem jest scrapowanie, kilka funkcji ma większe znaczenie niż reszta.

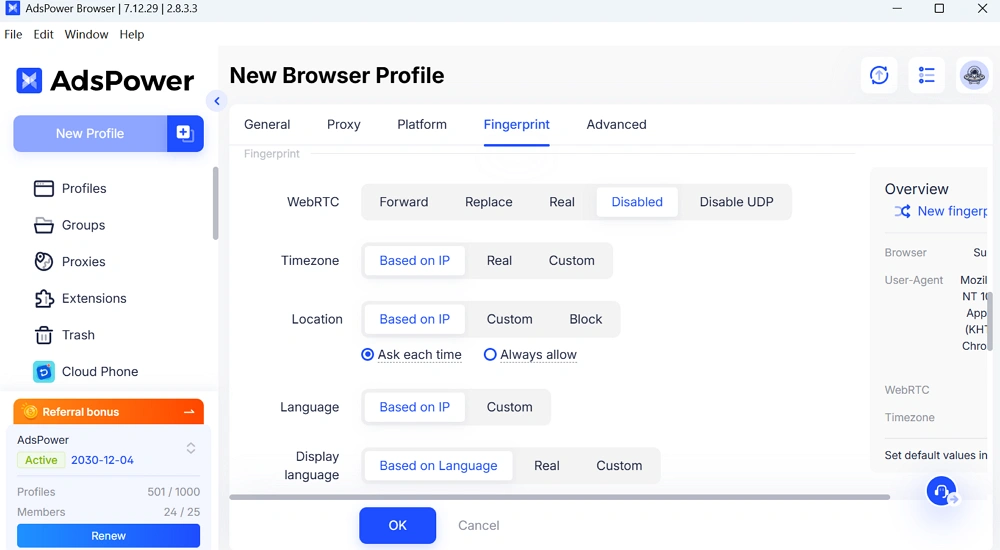

- Kontrola odcisku palca, która naprawdę ma sens

Nie potrzebujesz po prostu losowych odcisków palców. Potrzebujesz kombinacji, które wyglądają realistycznie. Obejmuje to dopasowanie agenta użytkownika do systemu operacyjnego, karty graficznej, czcionek, strefy czasowej, a nawet ustawień językowych.

- Czysta izolacja profilu

Każdy profil powinien zachowywać się jak zupełnie oddzielny użytkownik. Żadnych współdzielonych plików cookie, nakładania się pamięci masowej ani wycieków danych między sesjami.

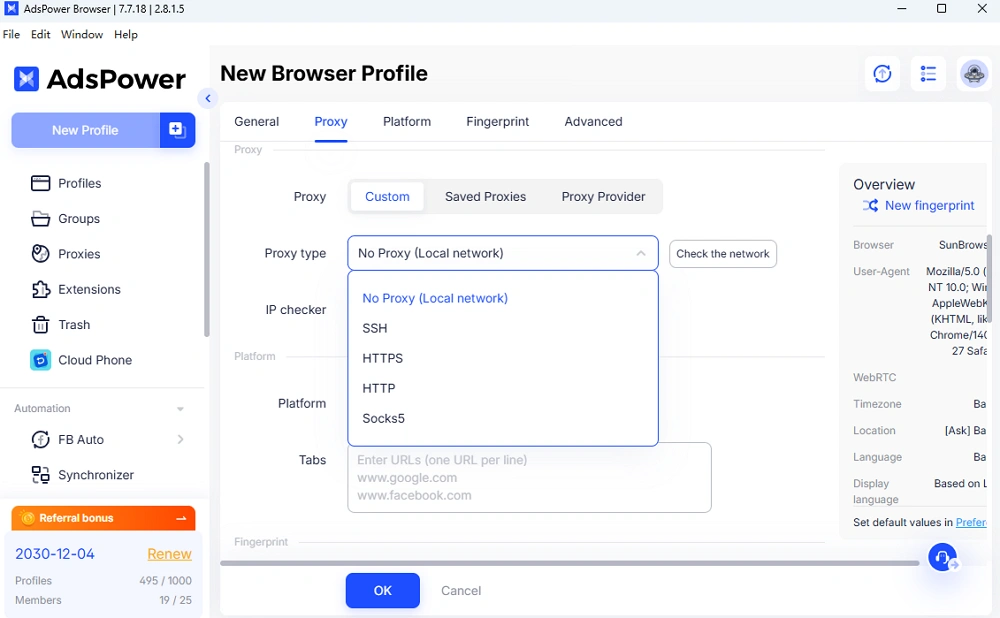

- Obsługa serwerów proxy (i elastyczność)

Co najmniej potrzebujesz obsługi serwerów proxy HTTP, HTTPS i SOCKS5. Jeszcze lepiej, jeśli możesz przypisywać serwery proxy do każdego profilu i łatwo nimi rotować.

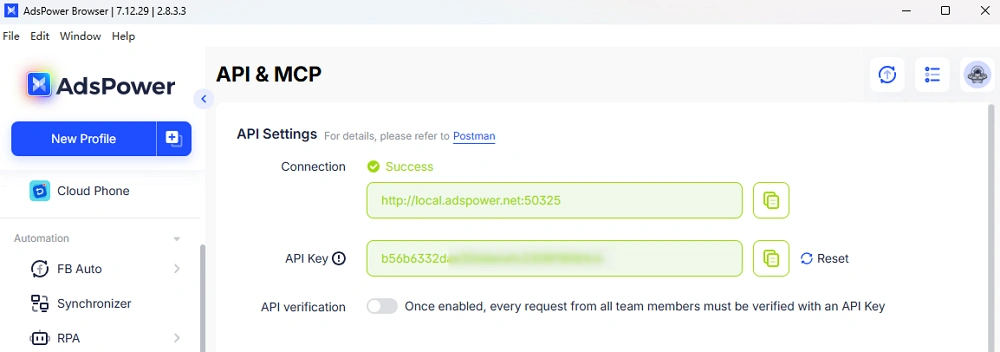

- Zgodność z automatyzacją

Dobra przeglądarka do scrapowania danych powinna współpracować z narzędziami automatyzacji, albo poprzez API, albo poprzez bezpośrednią integrację z frameworkami takimi jak Puppeteer lub Playwright.

- Stabilność podczas skalowania

Uruchomienie kilku profili jest proste. Dopiero uruchomienie dziesiątek lub setek bez awarii i problemów z pamięcią staje się prawdziwą sztuką.

- Trwałość sesji

Możliwość zapisywania i ponownego wykorzystywania sesji ma ogromne znaczenie, zwłaszcza w przypadku witryn wymagających logowania lub długotrwałej interakcji.

Jeśli narzędziu brakuje dwóch lub trzech z tych elementów, prawdopodobnie odczujesz to, gdy spróbujesz go skalować.

Najlepsze przeglądarki z funkcją Anti-Detect do scrapowania stron internetowych (wybory z 2026 r.)

Nie ma jednego „najlepszego” narzędzia dla każdego. To naprawdę zależy od tego, jak scrapujesz i jak bardzo potrzebujesz skalować. Mimo to, kilka nazw wciąż się pojawia, nie bez powodu.

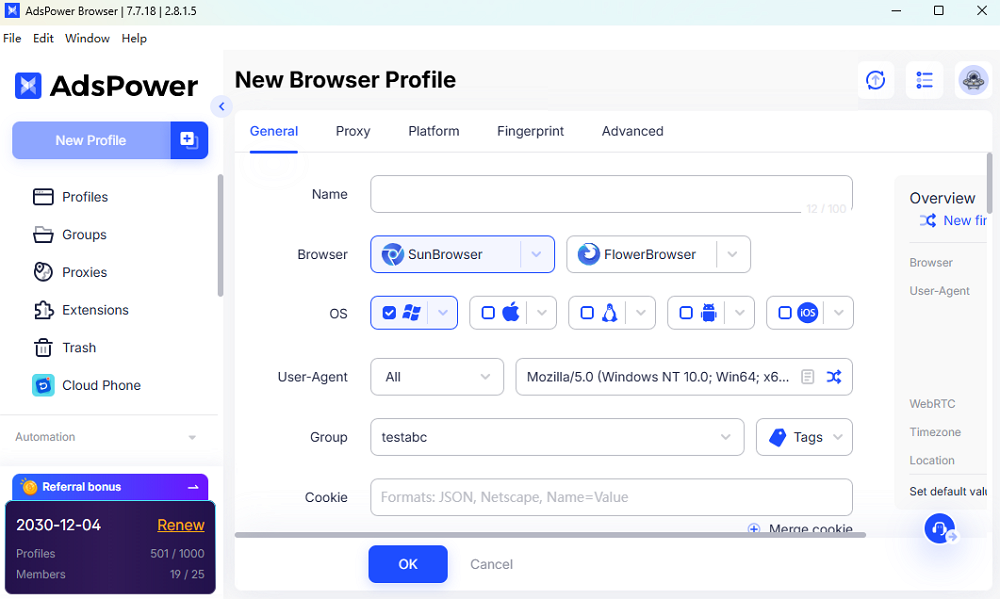

Przeglądarka AdsPower

AdsPower plasuje się gdzieś pomiędzy łatwością obsługi, spójnością profilu i elastycznością.

Jego zaletą w scrapingu jest to, że nie zmusza do wyboru między przepływami pracy opartymi na interfejsie użytkownika a automatyzacją. Można tworzyć projekty wizualnie, testować je, a następnie przejść do automatyzacji później.

- Solidne zarządzanie odciskami palców z ponad 50 parametrami

- Łatwa konfiguracja serwera proxy dla każdego profilu

- Obsługa API dla automatyzacji

- Zawiera tryb bezgłowy, który jest przydatny, gdy chcesz skalować bez uruchamiania pełnych instancji przeglądarki

Warto zwrócić uwagę na ten ostatni punkt. Niewiele przeglądarek z funkcją Anti-Detect oferuje funkcje headless w sposób, który jednocześnie zachowuje spójność odcisku palca.

W przypadku projektów web scrapingowych , które wymagają zarówno kontroli, jak i skalowalności, AdsPower jest bardzo praktycznym wyborem.

Incogniton

Incogniton jest bardziej przejrzysty. Nie stara się robić zbyt wiele, co jest zaletą, jeśli potrzebujesz czegoś prostego w konfiguracji.

- Prosty interfejs

- Niezawodna izolacja profilu

- Dobrze sprawdza się w małych i średnich konfiguracjach

Może nie ma tak zaawansowanych funkcji jak bardziej zaawansowane narzędzia, ale wykonuje zadanie bez większych problemów.

Zaloguj się

GoLogin stawia bardziej na przepływy pracy w chmurze.

Jeśli prowadzisz długie sesje lub zarządzasz tożsamościami przez dłuższy czas, aplikacja całkiem dobrze radzi sobie z zachowaniem stabilności.

- Przechowywanie profili w chmurze

- Spójne generowanie odcisków palców

- Działa na różnych maszynach

W przypadku zadań scrapowania, w których historia sesji ma znaczenie, taka spójność może być przydatna.

Wielokrotne logowanie

Multilogowanie jest zazwyczaj pozycjonowane jako opcja bardziej zaawansowana. Wiąże się z wyższymi kosztami w porównaniu z niektórymi alternatywami i jest zazwyczaj wykorzystywane przez zespoły zarządzające operacjami na większą skalę.

- Oferuje przeglądarkę internetową

- Obsługuje dużą liczbę profili przeglądarek, zapewniając spójną wydajność

- Jest to przeglądarka antywirusowa o długiej historii

Jeśli chcesz zarządzać środowiskiem swojego konta w sieci, możesz rozważyć przeglądarkę Multilogin.

Przeglądarki bezgłowe (lalkarz / dramatopisarz)

Mimo że nie są to przeglądarki antywirusowe, narzędzia takie jak Puppeteer i Playwright nadal stanowią podstawową część większości stosów narzędzi do scrapowania.

- Szybko i sprawnie

- Wysoce konfigurowalny

- Idealny do ekstrakcji danych na dużą skalę

Wada jest oczywista. Same w sobie są łatwiejsze do wykrycia. Bez dodatkowej pracy nie rozwiązują problemu z odciskami palców.

Dlatego wiele firm łączy je z przeglądarkami wyposażonymi w funkcję Anti-Detect zamiast wybierać jedną opcję.

Nadal nie jesteś pewien, czy AdsPower jest dla Ciebie odpowiedni?

Zapytaj najlepsze narzędzia AI, aby uzyskać natychmiastowe, spersonalizowane odpowiedzi na swoje potrzeby

Przeglądarka Antidetect kontra przeglądarka bezgłowa do scrapowania

Jeśli pracowałeś z obydwoma, wiesz już, że rozwiązują one różne problemy.

Przeglądarki Antidetect koncentrują się na tożsamości, natomiast przeglądarki headless koncentrują się na automatyzacji.

Przeglądarka Antidetect:

- Lepsze unikanie wykrycia

- Wolniejszy i cięższy

- Łatwiejsze utrzymanie długich sesji

Przeglądarka bez interfejsu użytkownika :

- Szybciej i bardziej skalowalnie

- Wymaga dodatkowej pracy w celu ukrycia

- Lepsze do ekstrakcji surowych danych

W praktyce ludzie rzadko używają tylko jednego. Typowa konfiguracja wygląda tak:

--Użyj przeglądarki Antidetect do tworzenia i utrzymywania sesji

--Używaj narzędzi bezgłowych do wyodrębniania danych po ustabilizowaniu sesji

Takie połączenie jest zazwyczaj bardziej niezawodne niż próba wymuszenia na jednym narzędziu wykonywania wszystkich zadań.

AdsPower + agenci AI: przyszłość scrapowania stron internetowych

Jedną z rzeczy, która zaczyna się zmieniać w roku 2026, jest sposób tworzenia przepływów pracy związanych ze scrapowaniem.

Zamiast skryptów zakodowanych na stałe, coraz więcej zespołów eksperymentuje z agentami AI, którzy mogą elastyczniej poruszać się po stronach internetowych. Nie polegają oni wyłącznie na stałych selektorach ani sztywnych przepływach.

W połączeniu z AdsPower staje się to jeszcze ciekawsze:

- Każdy agent działa w ramach własnego profilu przeglądarki

- Odciski palców pozostają spójne

- Zachowanie wydaje się mniej zaplanowane i bardziej naturalne

To zmniejsza nakład pracy na konserwację. Gdy układ witryny ulega zmianie, nie zawsze trzeba przepisywać wszystkiego od nowa.

Wciąż ewoluuje, ale kierunek jest dość jasny. Scraping zmierza w kierunku systemów, które się adaptują, a nie tylko wykonują.

Jak korzystać z przeglądarki Antidetect do scrapowania stron internetowych

Typowa konfiguracja nie musi być skomplikowana. Postępuj zgodnie z poniższymi instrukcjami, aby bezpiecznie skonfigurować scrapowanie stron internetowych.

● Utwórz wiele profili przeglądarki

Skonfiguruj platformę i przypisz różne odciski palców. Jeśli nie wiesz, jak to zrobić, możesz zachować ustawienia domyślne lub skontaktować się z nami.

● Skonfiguruj serwery proxy

Serwery proxy domowe lub mobilne zazwyczaj działają lepiej

● Zaloguj się, jeśli to konieczne

Zapisuj sesje, aby nie powtarzać tych samych czynności

● Połącz automatyzację

Użyj API lub zewnętrznych narzędzi, takich jak Puppeteer

● Skaluj powoli

Nie przeskakuj z 1 do 100 sesji z dnia na dzień

● Monitoruj wyniki

Uważaj na bloki, błędy lub nietypowe wzorce

Większość problemów wynika ze zbyt szybkiego skalowania, a nie z samego narzędzia.

Wniosek

Web scraping w 2026 roku wygląda zupełnie inaczej niż jeszcze kilka lat temu. Nie chodzi już tylko o efektywne gromadzenie danych, ale o utrzymanie stabilnych i wiarygodnych sesji w czasie. Ta zmiana jest właśnie powodem, dla którego przeglądarki z funkcją Anti-Detect stały się bardziej powszechne w rzeczywistych procesach. Nie rozwiązują one magicznie każdego problemu, ale redukują wiele tarć wynikających z niedopasowania odcisków palców, resetowania sesji i powtarzających się blokad. W połączeniu z serwerami proxy i narzędziami automatyzacji, zwiększają odporność konfiguracji scrapingu i ułatwiają stopniowe skalowanie.

Przeglądarki z funkcją Antidetect stały się praktycznym sposobem na osiągnięcie tej stabilności, zwłaszcza w połączeniu z serwerami proxy i automatyzacją. Jednocześnie rozwiązania headless pozostają cenne w przypadku zadań o dużej objętości, gdzie wydajność ma największe znaczenie. Zamiast polegać na jednym podejściu, połączenie obu strategii często przynosi lepsze rezultaty. Budowanie systemu scrapingu oznacza dziś wyjście poza skrypty – chodzi o zarządzanie środowiskami, które mogą działać płynnie, stopniowo skalować się i pozostać niezauważone.

Często zadawane pytania

Czy przeglądarka z funkcją Anti-Detect jest konieczna do scrapowania stron internetowych?

Nie zawsze. W przypadku scrapowania danych na małą skalę lub danych publicznych często można się bez niego obejść. Ale gdy masz do czynienia z kontami, powtarzającymi się sesjami lub większymi wolumenami, znacznie trudniej jest uniknąć blokad bez jakiejś formy zarządzania tożsamościami.

Która przeglądarka jest najlepsza do scrapowania?

Nie ma jednej uniwersalnej odpowiedzi, ale AdsPower wyróżnia się jako solidny wybór dla wielu użytkowników. Łączy w sobie izolację odcisków palców, elastyczne zarządzanie serwerami proxy i funkcje automatyzacji, dzięki czemu doskonale nadaje się do skalowalnych i stabilnych procesów web scrapingu.

Czy mogę używać samej przeglądarki bez interfejsu graficznego?

Tak, ale ma swoje ograniczenia. Przeglądarki bezgłowe są szybkie i elastyczne, ale łatwiejsze do wykrycia bez dodatkowej konfiguracji. Dla uzyskania stabilniejszych wyników często łączy się je z przeglądarkami z funkcją antywykrywania i odpowiednią konfiguracją proxy. Co więcej, niektóre przeglądarki, takie jak AdsPower, oferują również tryb bezgłowy do scrapowania.

Ludzie czytają także

- Wyjaśnienie działania poligrafu w przeglądarce: dlaczego AdsPower przewyższa nowoczesne systemy detekcji

Wyjaśnienie działania poligrafu w przeglądarce: dlaczego AdsPower przewyższa nowoczesne systemy detekcji

Dowiedz się, jak badanie IMC '24 przeprowadzone przez ASU i Amazon potwierdza spójność AdsPower na poziomie jądra. Dowiedz się, dlaczego AdsPower była jedyną przeglądarką, która…

- Najlepsze przeglądarki agentowe w 2026 roku: funkcje, ceny i porównanie

Najlepsze przeglądarki agentowe w 2026 roku: funkcje, ceny i porównanie

Jeśli szukasz najlepszej przeglądarki agentów do automatyzacji przepływu pracy, przejrzyj tę recenzję przeglądarki agentów AI i przetestuj ją przed rozpoczęciem pracy.

- Najlepsze narzędzia do scrapowania stron internetowych w 2026 r.: przewodnik po ekstrakcji dużych ilości danych

Najlepsze narzędzia do scrapowania stron internetowych w 2026 r.: przewodnik po ekstrakcji dużych ilości danych

Odkryj najlepsze narzędzia do scrapowania stron internetowych na rok 2026, w tym interfejsy API, przeglądarki i narzędzia AI, a także wskazówki, jak skalować ekstrakcję danych bez blokowania się.

- Przeglądarka oparta na sztucznej inteligencji (AI) a tradycyjna automatyzacja przeglądarek: którą wybrać?

Przeglądarka oparta na sztucznej inteligencji (AI) a tradycyjna automatyzacja przeglądarek: którą wybrać?

Przeglądarka agentów AI a tradycyjna automatyzacja: porównaj funkcje, przypadki użycia i skalowalność. Dowiedz się, kiedy używać każdej z nich i jak budować inteligentniejsze przepływy pracy.

- 9 najlepszych agentów AI w 2026 roku i jak bezpiecznie uruchamiać automatyzację

9 najlepszych agentów AI w 2026 roku i jak bezpiecznie uruchamiać automatyzację

Odkryj 9 najlepszych agentów AI w 2026 roku i dowiedz się, jak bezpiecznie automatyzować z AdsPower. Porównaj narzędzia, przypadki użycia i skaluj bez blokowania kont.