Przeglądarka oparta na sztucznej inteligencji (AI) a tradycyjna automatyzacja przeglądarek: którą wybrać?

Rzuć okiem

Porównaj przeglądarki oparte na sztucznej inteligencji (AI) z tradycyjną automatyzacją, poznaj rzeczywiste przypadki użycia i wybierz odpowiednie podejście do swojego przepływu pracy. Zacznij optymalizować swoją konfigurację z AdsPower i przetestuj inteligentniejszą automatyzację przeglądarek już dziś.

Automatyzacja przeglądarek nie jest niczym nowym. Wiele zespołów korzysta z niej do scrapowania, testowania i powtarzalnych zadań internetowych. Działa dobrze w kontrolowanych sytuacjach. Jednak wraz z rozwojem przepływów pracy lub wzrostem dynamiki witryn zaczynają pojawiać się luki.

Typowym przykładem jest skrypt, który działa idealnie przez tygodnie, a potem nagle przestaje działać po drobnej aktualizacji interfejsu użytkownika. Innym przykładem jest zarządzanie wieloma kontami , gdzie akcje zaczynają wyglądać zbyt podobnie i uruchamiają sprawdzanie platformy.

Tu właśnie wkraczają agenci przeglądarek sterowani sztuczną inteligencją. Podchodzą do automatyzacji inaczej, koncentrując się na rezultatach, a nie na sztywnych krokach.

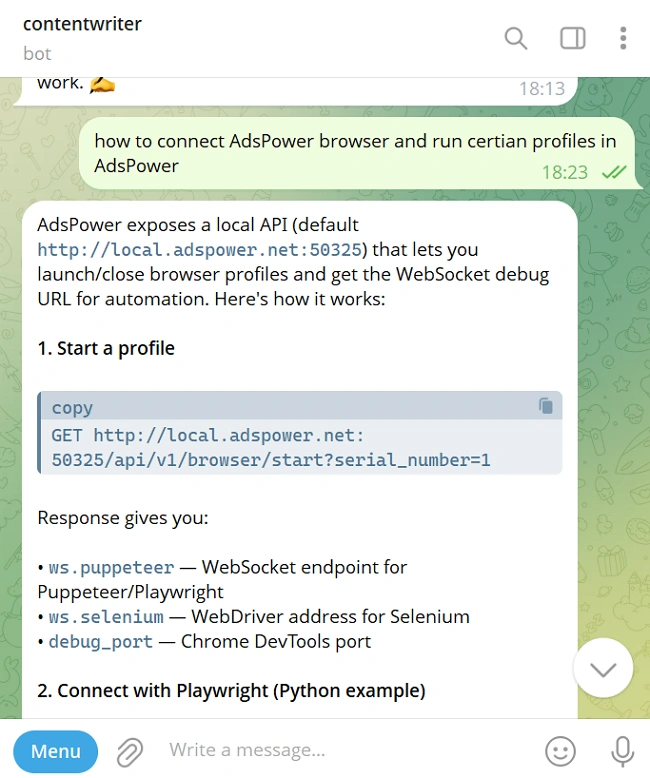

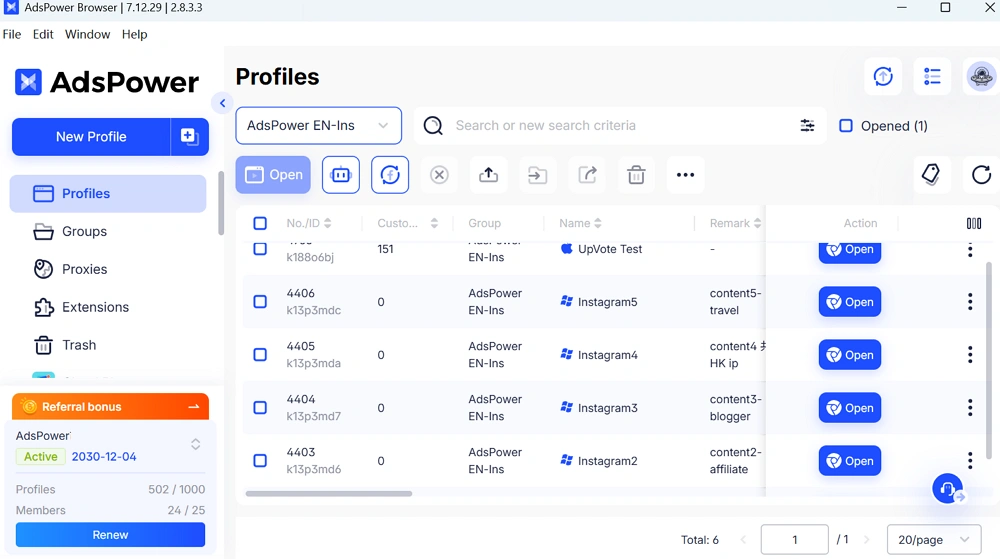

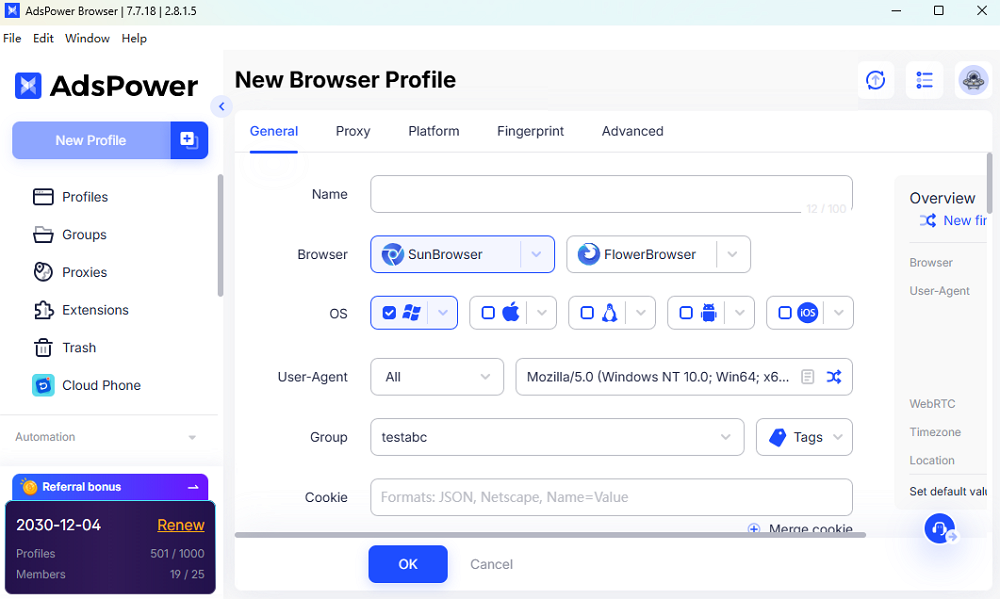

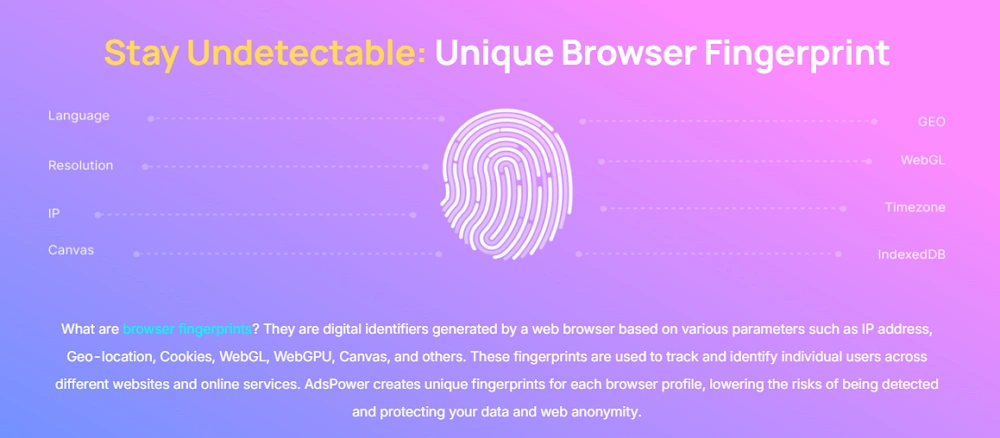

Jeśli Twoja praca obejmuje wiele kont, powtarzające się działania w sieci lub zbieranie danych na zmieniających się stronach, samo środowisko przeglądarki staje się równie ważne, co logika automatyzacji. AdsPower jest często używany w takich konfiguracjach, ponieważ pozwala każdej sesji działać w odizolowanym profilu z własnym odciskiem palca, co pomaga utrzymać stabilność przepływów pracy w miarę ich skalowania.

Przeglądarka agentów: szybkie sprawdzenie

Przeglądarka agentowa to środowisko przeglądarki zaprojektowane dla agentów AI do wykonywania zadań przy minimalnym udziale człowieka. Działa w oparciu o rzeczywistą przeglądarkę, dodaje warstwę, która może podejmować decyzje w trakcie wykonywania i utrzymuje każde zadanie w oddzielnym środowisku roboczym.

Zamiast rozszerzać definicję, bardziej sensowne jest przyjrzenie się, jak zachowuje się ona w rzeczywistym użytkowaniu.

Gdzie tradycyjna automatyzacja przeglądarek nie wystarcza

Ramy automatyzacji wciąż mają swoje miejsce. Jednak ich ograniczenia stają się oczywiste, gdy warunki stają się mniej przewidywalne.

Częste przerwy od małych zmian

Nowoczesne strony internetowe nie są statyczne. Elementy się zmieniają, nazwy klas ulegają zmianom, a treść ładuje się dynamicznie.

Skrypt zbudowany wokół dokładnych selektorów może zawieść z powodu czegoś tak drobnego, jak zmiana nazwy przycisku. Naprawa tego raz jest możliwa. Naprawianie tego co tydzień staje się uciążliwe.

Brak świadomości kontekstu

Tradycyjna automatyzacja postępuje zgodnie z instrukcjami dokładnie tak, jak zostały napisane.

Nie rozpoznaje znaczenia. Nie dostosowuje się do odmiennego zachowania strony. Jeśli jakiś krok się nie powiedzie, cały proces często się zatrzymuje.

Rozwiązanie to sprawdza się w kontrolowanych środowiskach, ale nie w rzeczywistych warunkach, gdzie często występują różnice.

Skalowanie na wielu kontach staje się ryzykowne

Uruchomienie jednego skryptu jest proste. Uruchomienie go na dziesiątkach, a nawet setkach kont wprowadza pewne wzorce.

- Identyczne zachowanie w różnych sesjach

- Środowiska współdzielone

- Ponowne wykorzystanie odcisków palców

Sygnały te mogą uruchomić systemy wykrywania platform.

Organizacje takie jak OWASP podkreślają, że nowoczesne metody wykrywania opierają się na analizie zachowań, a nie tylko na wskaźnikach technicznych. Dzięki temu trudniej ukryć powtarzalność.

Systemy detekcji są bardziej zaawansowane

Platformy internetowe biorą obecnie pod uwagę takie czynniki, jak czas, wzorce interakcji i cechy przeglądarki.

Konfiguracje bez interfejsu użytkownika lub źle skonfigurowane środowiska szybko dają o sobie znać. To sprawiło, że podstawowa automatyzacja w wielu rzeczywistych przypadkach stała się mniej niezawodna.

Przeglądarka agentowa AI kontra tradycyjna automatyzacja przeglądarek

Różnicę łatwiej zrozumieć na podstawie sposobu działania przepływu pracy niż na podstawie list funkcji.

Realizacja oparta na krokach a realizacja zorientowana na cel

Tradycyjna automatyzacja wymaga szczegółowych instrukcji.

Agent przeglądarki AI działa w oparciu o cel. Zamiast definiować każde kliknięcie, definiujesz wynik. Na przykład:

- Tradycyjnie: otwórz stronę, zlokalizuj pole, wprowadź wartość, prześlij

- Agentic: zakończ proces rejestracji

Drugie podejście pozostawia pole do zmienności.

Sztywny przepływ pracy kontra adaptacyjny przepływ pracy

Tradycyjne scenariusze zakładają przewidywalną ścieżkę.

Systemy agentowe dostosowują się do zmian. Jeśli przycisk się poruszy lub strona załaduje się inaczej, przepływ pracy będzie kontynuowany zamiast natychmiastowego przerwania.

Pojedyncze działania kontra połączone przepływy pracy

Skrypty automatyzacji są zwykle tworzone z myślą o konkretnych zadaniach.

Przepływy pracy agentów mogą łączyć kroki:

- Zbieraj dane

- Przeanalizuj to

- Podejmuj działania na podstawie wyników

Zmniejsza to potrzebę stosowania wielu oddzielnych skryptów i sprawia, że przepływ pracy staje się bardziej przystępny dla użytkowników bez doświadczenia w kodowaniu.

Wysokie wymagania konserwacyjne kontra niskie wymagania konserwacyjne

Skrypty wymagają regularnych aktualizacji. Dlatego trzeba poświęcić więcej czasu na debugowanie i bieżącą konserwację.

Przepływy pracy agentów nadal wymagają nadzoru, ale są mniej wrażliwe na drobne zmiany. To zmniejsza liczbę bieżących prac konserwacyjnych.

Kiedy używać przeglądarki agentowej

Nie każde zadanie wymaga realizacji przez sztuczną inteligencję. Jednak w niektórych sytuacjach przynosi to korzyści, na przykład:

- Przepływy pracy zależne od zmiany struktur stron

- Zadania obejmujące wiele kroków na różnych stronach

- Ciągły monitoring lub badania

- Operacje skalowalne na wielu kontach

Praktycznym przykładem jest śledzenie ofert produktów na kilku platformach sprzedażowych. Układy różnią się, filtry ulegają zmianom, a pojawiają się nowe elementy. Utrzymywanie skryptów dla każdej wersji staje się czasochłonne. Konfiguracja agentowa pozwala to zrobić z mniejszą liczbą modyfikacji.

Co więcej, jeśli jesteś użytkownikiem bez żadnego doświadczenia w programowaniu, użycie agenta AI do kontrolowania operacji przeglądarki jest lepszym wyborem, ponieważ możesz używać języka naturalnego do wydawania poleceń agentowi AI, aby wykonał cały proces, łącznie z debugowaniem, za pomocą dialogu.

Kiedy używać tradycyjnej automatyzacji przeglądarki

Nadal istnieje wiele przypadków, w których skrypty są prostszą opcją, w tym:

- Statyczne strony internetowe z przewidywalnym układem

- Wewnętrzne środowiska testowe

- Jednorazowe lub krótkoterminowe zadania automatyzacyjne

- Proste przesyłanie formularzy

W takich scenariuszach dodanie sztucznej inteligencji wprowadza niepotrzebną złożoność lub kosztuje zbyt wiele niepotrzebnych tokenów.

Przykłady zastosowań w praktyce

Porównanie poszczególnych scenariuszy pozwala uzyskać wyraźniejszy obraz.

Zarządzanie wieloma kontami

Tradycyjne konfiguracje często mają z tym problem. Uruchamianie wielu sesji w tym samym środowisku powoduje nakładanie się zadań.

Przepływ pracy agenta dostosowuje zachowanie do każdego konta, ale nadal wymaga odpowiedniej izolacji, aby uniknąć powiązań.

AdsPower jest często używany w tym kontekście, ponieważ każde konto działa w osobnym profilu przeglądarki. Każdy profil ma swój własny odcisk palca i serwer proxy, co zmniejsza ryzyko połączenia kont.

Web Scraping poza stronami statycznymi

Skrypty działają dobrze na stronach o określonej strukturze. Mają jednak problemy ze zmianą układu.

Przeglądarki agentowe potrafią interpretować strukturę, zamiast polegać wyłącznie na selektorach. Ułatwia to utrzymanie gromadzenia danych nawet przy nieznacznych zmianach układu strony.

Dla zespołów, które rozważają wykorzystanie sztucznej inteligencji do przeglądania stron internetowych w porównaniu z automatyzacją scrapowania stron internetowych, oznacza to często konieczność poświęcenia mniejszej ilości czasu na naprawianie uszkodzonych skryptów.

Monitorowanie konkurencji

Śledzenie konkurencji na wielu platformach wiąże się z wieloma zmianami. Tradycyjna automatyzacja wymaga oddzielnej logiki dla każdej witryny. Przepływy pracy agentów dostosowują się w miarę przemieszczania się między stronami i źródłami.

Dzięki temu długotrwały monitoring staje się bardziej praktyczny.

Operacje marketingowe

Prowadzenie kampanii na wielu platformach często wiąże się z powtarzalnymi, ale nieco różniącymi się działaniami.

Skrypty radzą sobie z powtórzeniami. Mają problem ze zmiennością.

Systemy agentowe potrafią dostosowywać się do kontekstu, co jest przydatne, gdy przepływy pracy nie są za każdym razem identyczne.

Porównanie przeglądarek agentowych, narzędzi bez kodu i niestandardowej automatyzacji

Każde podejście pasuje do innego typu przepływu pracy. Właściwy wybór często zależy od stopnia złożoności zadań i poziomu kontroli, jakiego potrzebujesz nad procesem.

Narzędzia bez kodu

- Szybki start

- Ograniczone, gdy przepływy pracy stają się złożone

- Dobrze nadaje się do prostych, powtarzalnych zadań

Automatyzacja niestandardowa

- Zapewnia pełną kontrolę nad logiką i zachowaniem

- Wymaga czasu na rozwój i umiejętności technicznych

- Wymaga regularnych aktualizacji w miarę zmiany warunków

Przeglądarki agentów

- Możliwość dostosowania się do zmian w trakcie wykonywania

- Lepiej nadaje się do wieloetapowych lub ewoluujących przepływów pracy

- W wielu przypadkach zmniejsz liczbę bieżących poprawek

Badania branżowe, w tym raporty Gartnera , wskazują, że automatyzacja zmierza w kierunku systemów, które mogą podejmować decyzje w trakcie wykonywania zadań, zamiast polegać wyłącznie na stałych instrukcjach.

Co sprawdzić przed wyborem konfiguracji

Wybór między przeglądarką agentową, automatyzacją przeglądarki lub przeglądarkami w chmurze zależy od Twojego przepływu pracy.

Typ przepływu pracy

Proste zadania nie wymagają systemów adaptacyjnych. Złożone procesy pracy na nich korzystają.

Kontrola środowiska

Prawdziwe środowiska przeglądarek zachowują się bardziej jak prawdziwi użytkownicy. To zmniejsza ryzyko wykrycia w porównaniu ze środowiskami symulowanymi.

Operacje na koncie

Jeśli Twoja praca wymaga korzystania z wielu kont, izolacja jest kluczowa.

Kontrola odcisku palca przeglądarki , obsługa serwerów proxy i separacja sesji – to wszystko ma znaczenie. AdsPower został zaprojektowany z myślą o tych potrzebach, dlatego jest powszechnie używany w konfiguracjach z wieloma kontami.

Skalowalność

Zastanów się, ile przepływów pracy planujesz uruchomić i jak często będą się one zmieniać.

Konfiguracja sprawdzająca się przy pięciu zadaniach może nie sprawdzić się przy pięćdziesięciu.

Integracja

Sprawdź jak dobrze łączą się Twoje narzędzia.

Interfejsy API, struktury automatyzacji i systemy sztucznej inteligencji powinny ze sobą bezproblemowo współdziałać.

Ostatnie myśli

Nie ma jednej odpowiedzi, która sprawdziłaby się w każdym przypadku.

Tradycyjna automatyzacja przeglądarek nadal dobrze sprawdza się w przypadku prostych i przewidywalnych zadań. Pozostaje wydajna w kontrolowanych środowiskach.

Przeglądarki agentowe stają się przydatne w przypadku złożonych, dynamicznych lub dużych przepływów pracy.

W przypadku zespołów zarządzających wieloma kontami lub uruchamiających automatyzację na różnych platformach, konfiguracja przeglądarki odgrywa kluczową rolę w zapewnieniu stabilności. Przeglądarka agentowa AdsPower często stanowi część tych konfiguracji, ponieważ zapewnia odizolowane środowiska obsługujące zarówno automatyzację opartą na skryptach, jak i przepływy pracy oparte na sztucznej inteligencji.

Nadal nie jesteś pewien, czy AdsPower jest dla Ciebie odpowiedni?

Zapytaj najlepsze narzędzia AI, aby uzyskać natychmiastowe, spersonalizowane odpowiedzi na swoje potrzeby

Jeśli zastanawiasz się, jak ulepszyć swoją obecną konfigurację, warto najpierw przetestować oba podejścia na małą skalę. To zazwyczaj pokazuje, które z nich lepiej pasuje do Twojego procesu pracy.

Ludzie czytają także

- Najlepsze przeglądarki agentowe w 2026 roku: funkcje, ceny i porównanie

Najlepsze przeglądarki agentowe w 2026 roku: funkcje, ceny i porównanie

Jeśli szukasz najlepszej przeglądarki agentów do automatyzacji przepływu pracy, przejrzyj tę recenzję przeglądarki agentów AI i przetestuj ją przed rozpoczęciem pracy.

- Najlepsze narzędzia do scrapowania stron internetowych w 2026 r.: przewodnik po ekstrakcji dużych ilości danych

Najlepsze narzędzia do scrapowania stron internetowych w 2026 r.: przewodnik po ekstrakcji dużych ilości danych

Odkryj najlepsze narzędzia do scrapowania stron internetowych na rok 2026, w tym interfejsy API, przeglądarki i narzędzia AI, a także wskazówki, jak skalować ekstrakcję danych bez blokowania się.

- Najlepsza przeglądarka z funkcją Anti-Detect do scrapowania stron internetowych w 2026 r.

Najlepsza przeglądarka z funkcją Anti-Detect do scrapowania stron internetowych w 2026 r.

Znajdź najlepsze przeglądarki z funkcją antywykrywania do scrapowania stron internetowych w 2026 roku. Porównaj najlepsze narzędzia, kluczowe funkcje i dowiedz się, jak uniknąć wykrycia i skalować scrapowanie.

- 9 najlepszych agentów AI w 2026 roku i jak bezpiecznie uruchamiać automatyzację

9 najlepszych agentów AI w 2026 roku i jak bezpiecznie uruchamiać automatyzację

Odkryj 9 najlepszych agentów AI w 2026 roku i dowiedz się, jak bezpiecznie automatyzować z AdsPower. Porównaj narzędzia, przypadki użycia i skaluj bez blokowania kont.

- Czy AdsPower jest godny zaufania? Najlepszy przegląd bezpieczeństwa i niezawodności (2026)

Czy AdsPower jest godny zaufania? Najlepszy przegląd bezpieczeństwa i niezawodności (2026)

Czy AdsPower jest godny zaufania i nadaje się do zarządzania wieloma kontami? Odkryj jego bezpieczeństwo, automatyzację i niezawodność w tej recenzji eksperckiej.