Jak uniknąć CAPTCHA podczas web scrapingu w 2026 roku

Rzuć okiem

Blokady CAPTCHA często wynikają ze słabych adresów IP, powtarzających się odcisków palców lub zachowań przypominających boty. Aby uniknąć CAPTCHA podczas scrapowania stron internetowych, należy skupić się na czystych serwerach proxy, spójnych środowiskach przeglądarek i realistycznych wzorcach interakcji. Narzędzia takie jak AdsPower pomagają w bardziej niezawodnym zarządzaniu odciskami palców i sesjami, co zmniejsza ryzyko wykrycia i wydłuża proces scrapowania.

Kontrole CAPTCHA stały się bardziej rygorystyczne, szczególnie w przypadku scrapowania na dużą skalę. To, co sprawdzało się kilka lat temu, już nie działa. Wiele scraperów zmaga się teraz z częstymi przerwami, nieudanymi żądaniami lub zablokowanymi sesjami.

Nie przegap praktycznych sposobów na uniknięcie CAPTCHA podczas scrapowania stron internetowych . Zamiast szybkich sztuczek, skupiamy się na stworzeniu konfiguracji, która będzie stabilna w czasie.

Dlaczego strony internetowe uruchamiają CAPTCHA dla scraperów

Strony internetowe nie wyświetlają CAPTCHA losowo. Zazwyczaj pojawia się, gdy coś wygląda podejrzanie.

Większość czynników wyzwalających można podzielić na kilka kategorii:

Typ wyzwalacza | Co dzieje się w praktyce |

Reputacja IP | Udostępniane lub oznaczone adresy IP są szybko kwestionowane |

Zachowanie żądania | Zbyt wiele działań w krótkim czasie |

Ponowne wykorzystanie odcisków palców | Wiele sesji wygląda identycznie |

Brak danych sesji | Brak plików cookie i historii przeglądania |

Wzory interakcji | Brak ruchu myszy lub natychmiastowych kliknięć |

Platformy takie jak reCAPTCHA opierają się na połączeniu tych sygnałów. Jeśli kilka z nich jednocześnie wygląda podejrzanie, uruchamiany jest test.

Możesz sprawdzić, jak Google ocenia sygnały ruchu, tutaj: https://developers.google.com/recaptcha

Jak działa wykrywanie CAPTCHA w 2026 roku

Aby ograniczyć częstotliwość występowania testów CAPTCHA, warto zrozumieć, co jest mierzone w tle.

Ocena IP i ruchu

Każde żądanie jest powiązane z adresem IP. Strony internetowe biorą pod uwagę:

-

Czy adres IP należy do rzeczywistego użytkownika czy do centrum danych

-

Jak często wysyła żądania

-

Czy lokalizacja zmienia się zbyt często

W przypadku czystego, domowego adresu IP ze średnim ruchem prawdopodobieństwo wywołania testu CAPTCHA jest znacznie mniejsze.

Odcisk palca przeglądarki

To właśnie tutaj wiele konfiguracji zawodzi. Strony internetowe gromadzą takie dane, jak:

-

Wersja przeglądarki

-

System operacyjny

-

Rozmiar ekranu

-

Renderowanie grafiki

-

Zainstalowane czcionki

Jeśli dziesięć sesji ma ten sam odcisk palca, nie wyglądają jak dziesięciu użytkowników. Wyglądają jak jeden skrypt.

Analiza zachowań

Automatyzacja często zachowuje się w przewidywalny sposób. Na przykład:

-

Kliknięcie bez przewijania

-

Zbyt szybkie ładowanie stron

-

Powtarzanie tego samego wzorca czasowego

Sygnały te są łatwe do wykrycia, gdy się powtarzają.

Zaufanie do sesji i pliki cookie

Niektóre systemy przypisują punkty zaufania na podstawie historii sesji. Na przykład:

-

Użytkownicy powracający z prawidłowymi plikami cookie napotykają mniej problemów

-

Nowe sesje są częściej testowane

Google reCAPTCHA v3 w dużym stopniu opiera się na tym modelu punktacji.

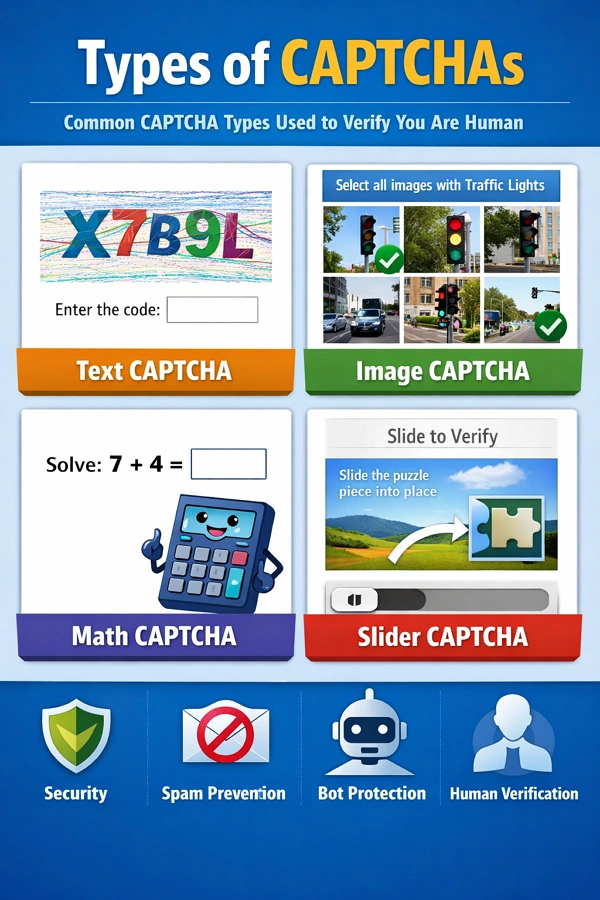

Rodzaje CAPTCHA, z którymi się spotkasz

Nie wszystkie systemy CAPTCHA działają tak samo. Niektóre strony internetowe stosują różne poziomy ochrony.

Typ CAPTCHA | Trudność | Notatki |

Oparte na tekście | Niski | Starsze systemy, łatwiejsze do rozwiązania |

Wybór obrazu | Średni | Często spotykane w reCAPTCHA |

Pole wyboru (v2) | Średni | Często wspierane głębszymi kontrolami |

Niewidzialny (v3) | Wysoki | Na podstawie oceny zachowania |

Interaktywne łamigłówki | Wysoki | Suwaki, akcje przeciągania itp. |

Znajomość typu problemu pozwala podjąć decyzję, czy go unikać, czy rozwiązać.

CAPTCHA oparta na tekście

Zniekształcone litery lub cyfry. Obecnie mniej powszechne, ale nadal stosowane na mniejszych stronach.

Rozpoznawanie obrazu CAPTCHA

Wybierz obrazy z sygnalizacją świetlną, samochodami lub przejściami dla pieszych. Powszechnie stosowane w reCAPTCHA.

Pole wyboru CAPTCHA (reCAPTCHA v2)

Proste pole wyboru „Nie jestem robotem”. Często wspierane przez bardziej szczegółowe kontrole.

Niewidoczna CAPTCHA (reCAPTCHA v3)

Brak widocznego wyzwania. Użytkownicy są oceniani po cichu na podstawie zachowania.

Interaktywna CAPTCHA

Obejmuje suwaki, łamigłówki i zadania typu „przeciągnij i upuść”. Typowe dla dostawców oprogramowania antybotowego, takich jak hCaptcha.

Czy można całkowicie uniknąć testu CAPTCHA podczas web scrapingu?

Krótko mówiąc, nie.

Nawet dobrze skonfigurowane systemy nadal od czasu do czasu napotykają CAPTCHA. Celem jest zmniejszenie częstotliwości jej występowania i utrzymanie sesji w użyciu przez dłuższy czas.

Stabilna konfiguracja spełnia trzy funkcje:

- Utrzymuje spójność tożsamości

- Unika podejrzanych skoków aktywności

- Z czasem buduje zaufanie do sesji

Sposoby unikania CAPTCHA podczas web scrapingu

Unikanie CAPTCHA to nie tylko pojedynczy trik. Chodzi o redukcję sygnałów ryzyka w całej konfiguracji. Poniższe metody koncentrują się na praktycznych zmianach, które sprawią, że Twój ruch będzie bardziej przypominał prawdziwych użytkowników.

1. Zbuduj spójną tożsamość (serwer proxy + odcisk palca + środowisko przeglądarki)

To jest fundament wszystkiego.

Sesja scrapowania powinna zachowywać się jak sesja prawdziwego użytkownika. Oznacza to:

- Jeden adres IP na sesję

- Jeden unikalny odcisk palca przeglądarki

- Jeden odizolowany profil przeglądarki

Jeśli te elementy nie są ze sobą zgodne, witryny internetowe mogą łatwo wykryć nieścisłości.

Korzystanie z przeglądarki z funkcją Anti-Detect pozwala zarządzać tym na dużą skalę. Zamiast ręcznego dostosowywania ustawień, każdy profil ma już spójną tożsamość.

2. Używaj wysokiej jakości serwerów proxy domowych lub mobilnych

Twój adres IP ma istotny wpływ na to, czy pojawi się CAPTCHA.

Oto krótkie porównanie różnych rodzajów serwerów proxy:

Typ serwera proxy | Ryzyko CAPTCHA | Notatki |

Centrum danych | Wysoki | Szybkie, ale często sygnalizowane |

Niski | Wygląda jak prawdziwi użytkownicy | |

Przenośny | Bardzo niski | Największe zaufanie, wyższy koszt |

Unikaj nieznanych, darmowych serwerów proxy. Często są one ponownie wykorzystywane i już zablokowane.

3. Rotacja adresów IP na podstawie sesji, a nie żądań

Losowa rotacja może powodować powstawanie nienaturalnych wzorów.

Lepsze podejście:

-

Zachowaj ten sam adres IP podczas sesji

-

Obróć tylko podczas rozpoczynania nowej sesji

-

Dopasuj lokalizację IP do ustawień przeglądarki

Dzięki temu zachowanie staje się spójne, a podejrzliwość maleje.

4. Utrzymywanie trwałych sesji (pliki cookie i pamięć masowa)

Do nowych sesji podchodzimy ostrożnie.

Aby budować zaufanie w czasie:

-

Zapisz pliki cookie po każdej sesji

-

Użyj ich ponownie po zwrocie

-

Unikaj zbyt częstego czyszczenia pamięci masowej

Sesja z historią jest mniej narażona na powtarzające się wyzwania.

5. Częstotliwość i czas żądań kontroli

Szybkość to powszechny atut. Zamiast wysyłać szybkie prośby:

-

Dodaj opóźnienia między akcjami

-

Rozłóż zadania w czasie

-

Unikaj gwałtownych wzrostów aktywności

Pomyśl o tym, jak porusza się prawdziwa osoba. Wzór rzadko jest jednolity.

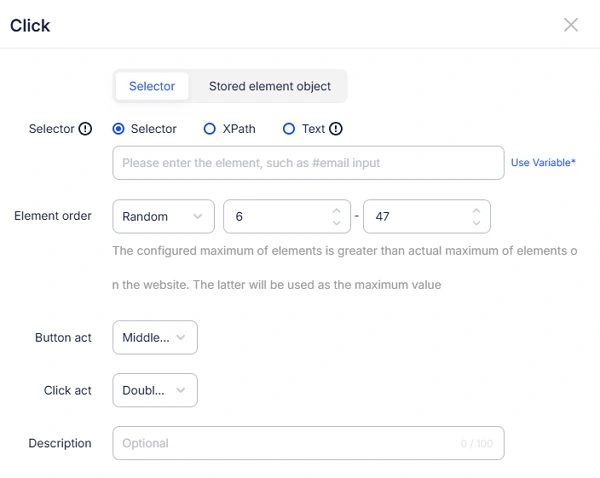

W procesie RPA AdsPower możesz ustawić pozycję, kolejność i czas działań elementów.

6. Symuluj rzeczywiste zachowania użytkowników

Zachowanie jest równie ważne, jak konfiguracja techniczna. Drobne zmiany pomagają:

-

Przewiń przed kliknięciem

-

Poruszaj się między stronami w sposób naturalny

-

Unikaj identycznych wzorców czasowych

Nawet podstawowa symulacja interakcji może obniżyć wskaźnik wykrywalności.

7. Unikaj słabego wykrywania przeglądarek bezgłowych

Przeglądarki bez interfejsu graficznego są przydatne, ale łatwo je rozpoznać, jeśli nie są modyfikowane.

Jeżeli z nich korzystasz, upewnij się, że:

-

Funkcje przeglądarki są w pełni włączone

-

Flagi automatyzacji są ukryte

-

Zachowanie renderowania wygląda normalnie

Jeśli korzystasz ze scrapowania bezobsługowego, stosuj konfiguracje stealth lub, jeśli to możliwe, przełącz się na pełne środowiska przeglądarki.

8. Strategicznie obchodź się z CAPTCHA (nie tylko jej unikaj)

Unikanie jest skuteczne w większości przypadków, ale nie zawsze.

W niektórych przypadkach rozwiązywanie testu CAPTCHA jest bardziej efektywne:

-

Korzystaj z usług rozwiązywania problemów opartych na człowieku, aby uzyskać dokładność

-

Użyj rozwiązań AI dla zwiększenia szybkości

-

Połącz oba, aby uzyskać równowagę

Dzięki temu masz pewność, że Twój tok pracy nie zostanie przerwany, gdy pojawi się CAPTCHA.

9. Unikaj ukrytych pułapek na boty

Wiele stron internetowych zawiera niewidzialne pułapki przeznaczone dla botów.

Przykłady obejmują:

-

Ukryte pola formularza

-

Elementy niewidoczne dla użytkowników

-

Kontrole wykrywania oparte na JavaScript

Aby zmniejszyć ryzyko:

-

Zawsze renderuj strony w całości

-

Współdziałaj tylko z widocznymi elementami

-

Sprawdź strukturę strony przed podjęciem działań

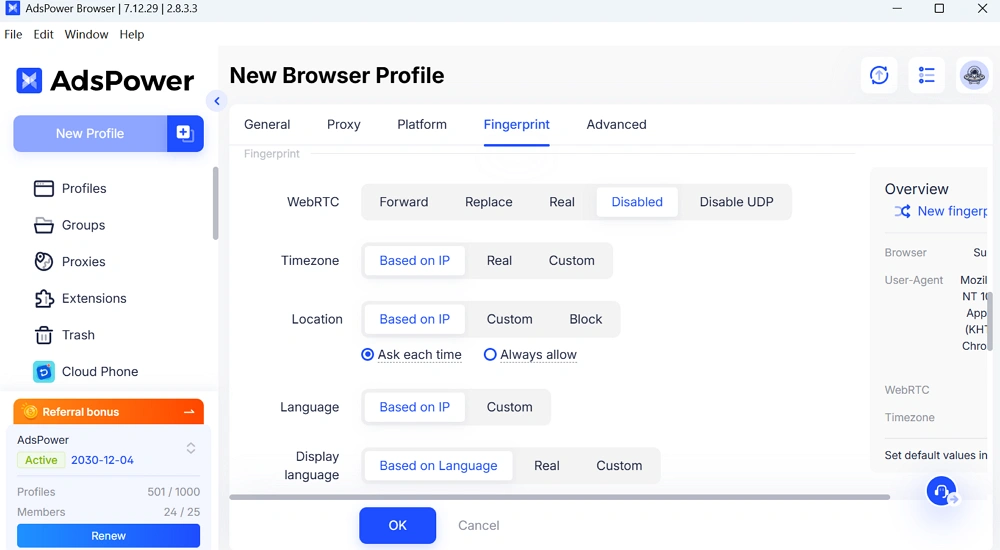

10. Dostosuj konfigurację do rzeczywistego kontekstu użytkownika

Jednym z częstych błędów są niedopasowane sygnały.

Na przykład:

-

Amerykański adres IP z azjatycką strefą czasową

-

Mobilny IP z odciskiem palca na komputerze stacjonarnym

-

Ustawienia językowe niezgodne z lokalizacją

Tego typu nieścisłości szybko budzą podejrzenia.

Upewnij się, że:

-

Lokalizacja IP

-

Strefa czasowa

-

Język

-

Typ urządzenia

wszystko układa się naturalnie.

Szybkie podsumowanie

Stabilna konfiguracja scrapowania zazwyczaj łączy w sobie:

Warstwa | Na czym się skupić |

Sieć | Czyste, zaufane adresy IP |

Środowisko | Unikalne odciski palców |

Zachowanie | Interakcja podobna do ludzkiej |

Sesja | Trwałe pliki cookie |

Gdy warstwy te współdziałają, CAPTCHA pojawia się znacznie rzadziej.

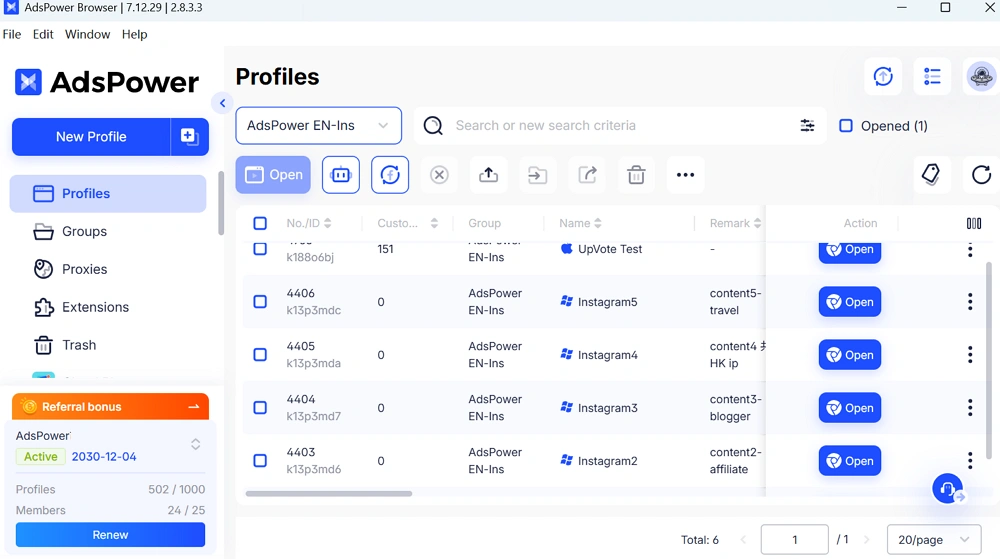

Jak AdsPower pomaga w rozwiązywaniu problemów CAPTCHA w web scrapingu

Gdy zarządzasz wieloma sesjami scrapowania, kontrola środowiska staje się głównym wyzwaniem. AdsPower został zaprojektowany właśnie z myślą o tym.

Niezależne odciski palców dla każdego profilu

Każdy profil przeglądarki w przeglądarce AdsPower ma swój własny odcisk palca.

Dzięki tym ustawieniom profilu:

- Sesje nie nakładają się

- Konta pozostają oddzielone

- Ryzyko wykrycia jest zmniejszone

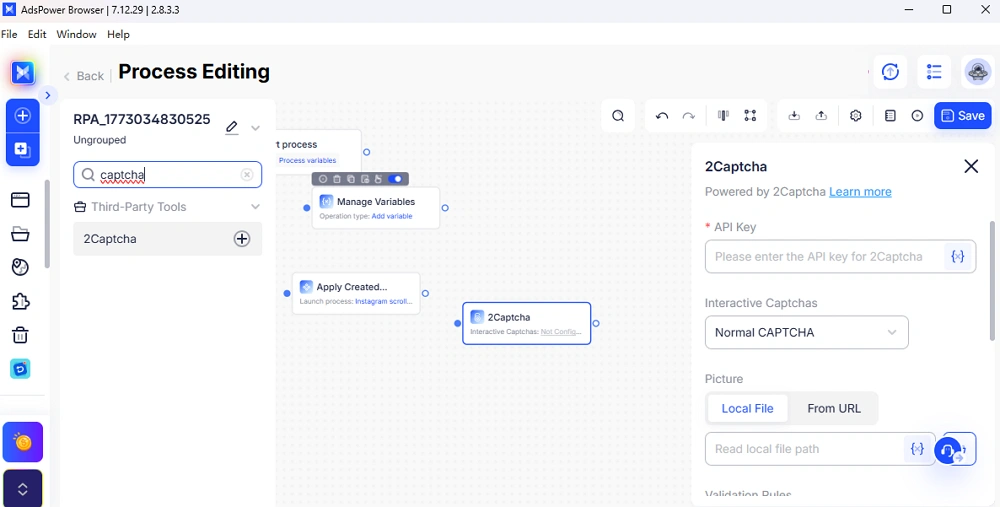

Automatyzacja RPA z integracją CAPTCHA

AdsPower zawiera funkcje RPA , które pomagają automatyzować przepływy pracy.

Możesz:

- Uruchom powtarzające się zadania

- Zintegruj zewnętrzne rozwiązania CAPTCHA

- Zachowaj spójność zachowania podczas sesji

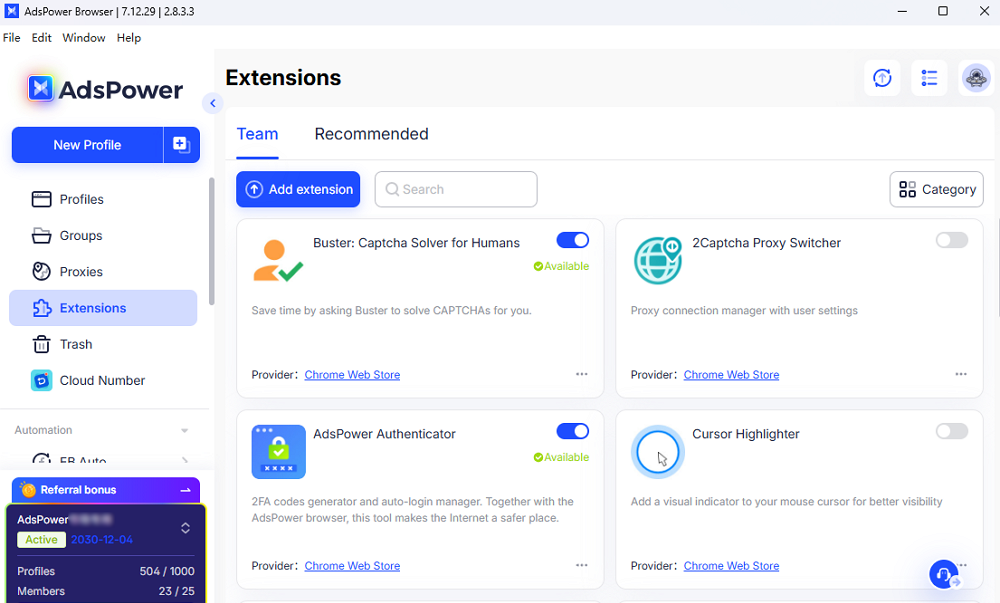

Wsparcie rozszerzeń dla rozwiązań CAPTCHA

AdsPower obsługuje rozszerzenia przeglądarki bezpośrednio.

Możesz zainstalować popularne rozszerzenia Google do rozwiązywania zadań CAPTCHA, aby zautomatyzować procesy.

Ułatwia to łączenie strategii unikania i rozwiązywania problemów.

👉 Możesz poznać możliwości AdsPower i sprawdzić, w jaki sposób izolowane profile przeglądarek poprawiają stabilność scrapowania.

Najczęściej zadawane pytania:

Jaki typ serwera proxy jest najlepszy do omijania CAPTCHA?

Serwery proxy dla użytkowników indywidualnych są najbardziej praktycznym wyborem w większości przypadków użycia. Oferują one większe zaufanie w porównaniu z adresami IP centrów danych. Serwery proxy mobilne mogą działać jeszcze lepiej, ale są droższe.

Czy headless scraping zawsze uruchamia CAPTCHA?

Nie zawsze, ale domyślne ustawienia często tak działają.

Przeglądarki bezgłowe mogą ujawniać sygnały, których nie dostrzegają zwykłe przeglądarki. Bez odpowiednich korekt, wykrycie następuje szybko.

Czy AdsPower może pomóc zmniejszyć częstotliwość występowania CAPTCHA?

Tak. AdsPower poprawia spójność środowiskową.

Dzięki odizolowanym odciskom palców i stabilnym sesjom Twoje zapytania wyglądają bardziej jak zapytania prawdziwych użytkowników. To zmniejsza częstotliwość pojawiania się CAPTCHA, szczególnie w przypadku konfiguracji z wieloma kontami.

Ostatnie myśli

Aby uniknąć CAPTCHA podczas scrapowania stron internetowych, skup się na spójności, a nie na skrótach.

Niezawodna konfiguracja łączy w sobie:

- Czyste adresy IP

- Unikalne środowiska przeglądarek

- Realistyczne wzorce interakcji

Jeśli zarządzasz wieloma kontami lub codziennie wykonujesz zadania scrapowania, korzystanie z kontrolowanego środowiska przeglądarki, np. AdsPower, może z czasem zwiększyć stabilność Twojego przepływu pracy.

👉 Zarejestruj się w AdsPower, aby utworzyć swój pierwszy profil i przetestować bezpieczniejszą konfigurację scrapowania.

Ludzie czytają także

- Czym jest numer telefonu w chmurze i jak go wybrać dla swojej firmy

Czym jest numer telefonu w chmurze i jak go wybrać dla swojej firmy

Dowiedz się, czym jest numer telefonu w chmurze, jak działa i jak wybrać odpowiednią usługę do weryfikacji, skalowania i operacji biznesowych.

- Karta SIM a numer wirtualny: Jaka jest różnica między kartą SIM a numerem wirtualnym?

Karta SIM a numer wirtualny: Jaka jest różnica między kartą SIM a numerem wirtualnym?

Porównaj kartę SIM z numerem wirtualnym, najważniejsze różnice, przypadki użycia oraz zalety i wady. Dowiedz się, która opcja odpowiada Twoim potrzebom w zakresie weryfikacji i prywatności.

- Czym jest przeglądarka agentowa? Definicja, sposób działania i przypadki użycia sztucznej inteligencji (przewodnik na rok 2026)

Czym jest przeglądarka agentowa? Definicja, sposób działania i przypadki użycia sztucznej inteligencji (przewodnik na rok 2026)

Dowiedz się, czym jest przeglądarka agentów, jak współpracuje z agentami AI i dlaczego jest ważna dla automatyzacji, zarządzania wieloma kontami i skalowalnych przepływów pracy.

- Jak korzystać z agenta OpenClaw AI do logowania się do kont Google za pomocą AdsPower

Jak korzystać z agenta OpenClaw AI do logowania się do kont Google za pomocą AdsPower

Dowiedz się, jak używać agenta OpenClaw AI z AdsPower do automatyzacji logowania do konta Google na serwerze za pomocą API i Puppeteer. Usprawni to przepływ pracy.

- Jak reklamy śledzą Cię w Internecie i co możesz zrobić, aby zachować prywatność w sieci

Jak reklamy śledzą Cię w Internecie i co możesz zrobić, aby zachować prywatność w sieci

Dowiedz się, w jaki sposób reklamy śledzą Cię w Internecie, poznaj remarketing behawioralny i chroń swoją prywatność dzięki AdsPower.