Cel mai bun browser Antidetect pentru extragerea de date web în 2026

Aruncă o privire rapidă

Descoperiți cele mai bune browsere antidetecție pentru extragerea de date web în 2026, îmbunătățiți stabilitatea, evitați detectarea și scalați eficient - citiți mai departe pentru a găsi instrumentul potrivit pentru fluxul dvs. de lucru astăzi.

Extragerea datelor de pe web s-a schimbat mult. Nu cu mult timp în urmă, puteai rula un script simplu și colecta date fără prea multe probleme. Acum, majoritatea platformelor monitorizează mult mai multe semnale în culise, de la amprenta browserului până la modul în care interacționezi cu o pagină, chiar și intervalul de timp dintre acțiuni. Când ceva nu arată natural, restricții sau blocaje pot apărea aproape imediat, motiv pentru care mulți dezvoltatori încep să caute modalități de a face extragere de date de pe web fără a fi blocați în loc să se bazeze pe scripturi de bază.

Aici intervin browserele antidetect. În loc să remedieze constant problemele de detectare după ce apar, acestea vă permit să începeți cu o configurație mai realistă, folosind identități separate, sesiuni stabile și un comportament care seamănă mai mult cu utilizatorii reali. În acest ghid, vom analiza cum funcționează și ce instrumente merită luate în considerare în 2026.

De ce scraping-ul web modern necesită un browser Antidetect

Ceea ce s-a schimbat cu adevărat în web scraping nu sunt instrumentele folosite de oameni, ci modul în care site-urile web ripostează.

Majoritatea platformelor combină acum mai multe niveluri de detectare în același timp. În loc să verifice doar solicitările, acestea analizează contextul general al activității dvs., inclusiv:

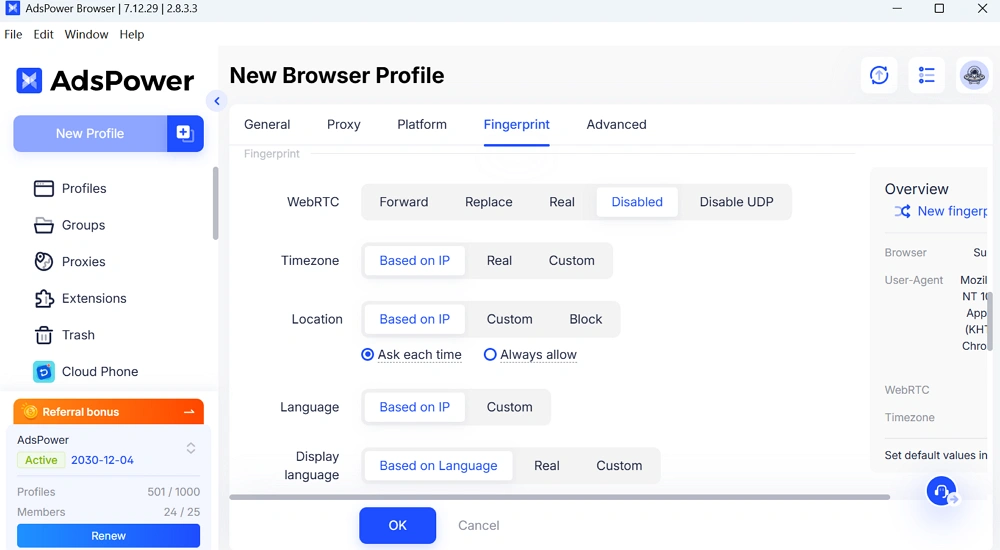

- Detalii despre amprenta browserului , cum ar fi canvas, WebGL, fonturi și specificații ale dispozitivului

- Semnale comportamentale precum mișcarea mouse-ului și modelele de derulare

- Reputația IP și frecvența solicitărilor

- Continuitatea sesiunii, inclusiv cookie-urile și consistența antetului

Problema este că totul trebuie să se alinieze. Poți trimite cereri perfect valide, dar dacă ceva nu este în regulă în configurație, iese în evidență. O simplă nepotrivire între agentul utilizator și amprenta WebGL poate deja declanșa semnale de alarmă. Dacă se întâmplă asta în timp ce faci cereri repetate de la aceeași adresă IP, blocările se produc de obicei destul de repede.

Aici contează browserele anti-detecție . Acestea reduc aceste inconsecvențe oferindu-vă mai mult control asupra mediului:

- Fiecare profil de browser rulează cu propria amprentă digitală

- Sesiunile rămân consecvente între cookie-uri, stocare și anteturi

- Configurația generală se comportă mai aproape de un mediu real al utilizatorului

În cele din urmă, obiectivul este simplu. În loc să arate ca un script care rulează în fundal, configurația se integrează în activitatea normală a utilizatorului, ceea ce este exact motivul pentru care fluxurile de lucru de scraping funcționează mai mult timp.

Ce este un browser Antidetect pentru scraping web?

Un browser antidetect este un browser care îți permite să rulezi mai multe profiluri izolate, fiecare cu propriile date de amprentă și sesiune, astfel încât activitatea ta pare să provină de la utilizatori reali diferiți.

Cum diferă de browserele standard

Un browser obișnuit nu este conceput pentru separarea identității. Chiar dacă schimbați conturile sau ștergeți cookie-urile, multe semnale subiacente rămân aceleași, ceea ce facilitează conectarea sesiunilor de către site-uri web.

- Partajează o amprentă consistentă între file și sesiuni

- Control limitat asupra elementelor de amprentă digitală, cum ar fi WebGL, fonturile sau specificațiile dispozitivului

- Cookie-urile și spațiul de stocare pot fi resetate, dar identificatorii mai profundi rămân.

- Nu este conceput pentru rularea mai multor identități independente la scară largă

Un browser anti-detecție schimbă acest lucru izolând totul la nivel de profil, făcând ca fiecare sesiune să pară fără legătură.

Cum diferă de uneltele de răzuit fără cap

Instrumentele headless se concentrează pe automatizare și viteză, nu pe cât de „real” arată mediul browserului. Sunt puternice, dar în mod implicit pot lăsa în continuare tipare detectabile.

- Optimizat pentru fluxuri de lucru automatizate și scripting

- Mai rapid și mai ușor pentru sarcini de răzuire la scară largă

- Mai ușor de detectat fără configurație stealth suplimentară

- Control limitat încorporat asupra amprentelor digitale realiste ale browserului

Browserele Antidetect se concentrează pe partea opusă a problemei, făcând mediile mai consistente și mai greu de conectat între ele.

De aceea, în multe configurații reale, acestea sunt folosite împreună. Una se ocupă de automatizare, cealaltă de identitate și ascundere.

Caracteristici cheie într-un browser de scraping web

Nu toate browserele antidetect sunt potrivite pentru scraping. Unele sunt construite mai mult pentru gestionarea conturilor, altele pentru fluxuri de lucru de marketing. Dacă obiectivul tău principal este scraping-ul, câteva caracteristici contează mai mult decât restul.

- Controlul amprentelor care chiar are sens

Nu vrei doar amprente digitale aleatorii. Vrei combinații care să arate realist. Aceasta include potrivirea agentului utilizator cu sistemul de operare, GPU-ul, fonturile, fusul orar și chiar setările de limbă.

- Izolare curată a profilului

Fiecare profil ar trebui să se comporte ca un utilizator complet separat. Fără cookie-uri partajate, fără suprapuneri în stocare, fără scurgeri de date între sesiuni.

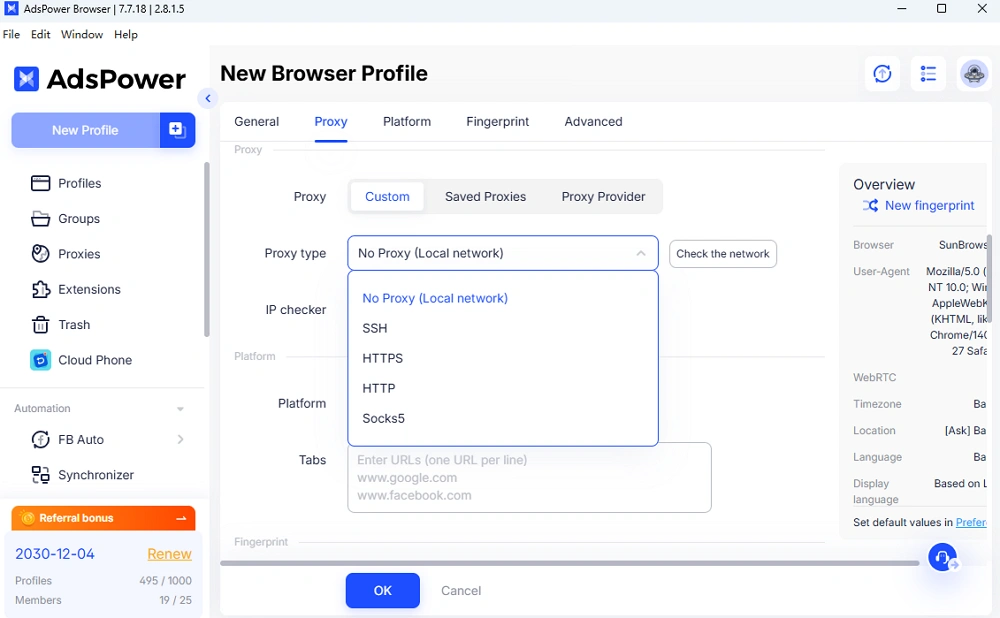

- Suport (și flexibilitate) pentru proxy

Cel puțin, veți avea nevoie de suport pentru proxy-uri HTTP, HTTPS și SOCKS5. Și mai bine dacă puteți atribui proxy-uri per profil și le puteți roti cu ușurință.

- Compatibilitate automată

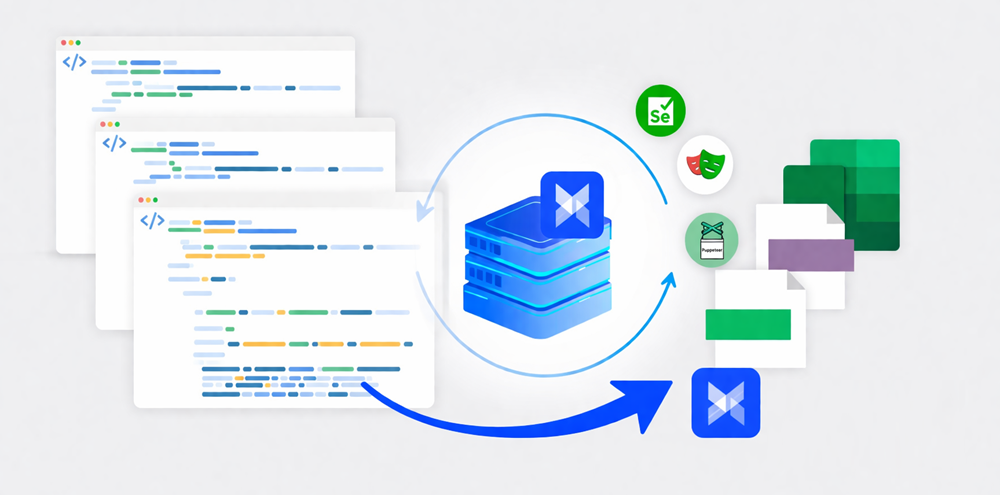

Un browser bun de scraping ar trebui să funcționeze cu instrumente de automatizare, fie prin API-uri, fie prin integrare directă cu framework-uri precum Puppeteer sau Playwright.

- Stabilitate la scalare

Rularea câtorva profiluri este ușoară. Rularea a zeci sau sute de profiluri fără blocări sau probleme de memorie este momentul în care lucrurile devin concrete.

- Persistența sesiunii

Posibilitatea de a salva și reutiliza sesiuni este foarte importantă, mai ales pentru site-urile care necesită autentificare sau interacțiune pe termen lung.

Dacă unui instrument îi lipsesc două sau trei dintre acestea, probabil veți simți acest lucru odată ce încercați să scalați.

Cele mai bune browsere Antidetect pentru extragerea de informații web (selecții din 2026)

Nu există un singur instrument „cel mai bun” pentru toată lumea. Depinde cu adevărat de modul în care extragi date și de cât de mult trebuie să scalezi. Totuși, câteva nume continuă să apară dintr-un motiv anume.

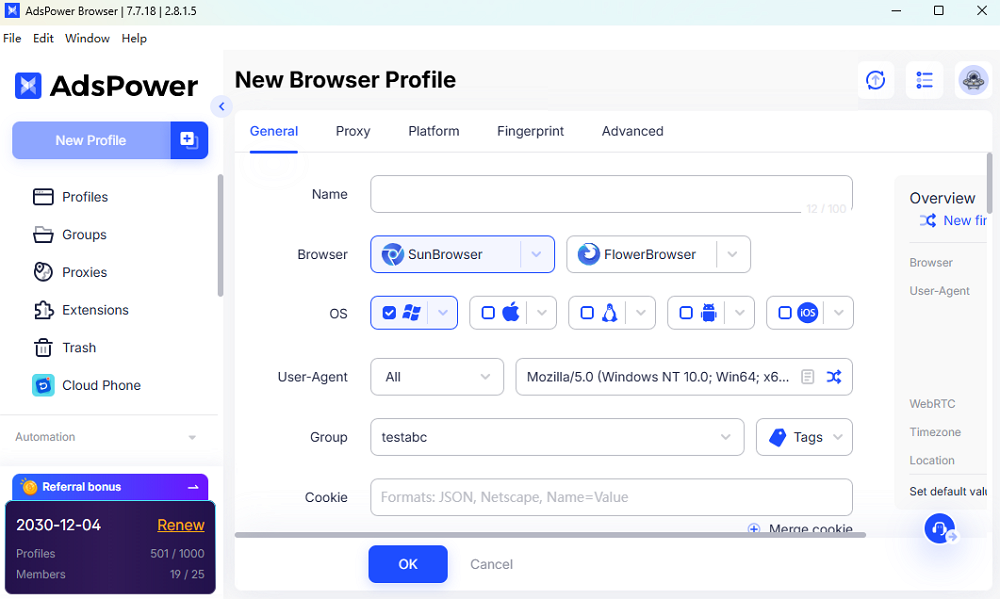

AdsPower Browser

AdsPower se situează undeva în cel mai bun punct între ușurință în utilizare, consecvență profil și flexibilitate.

Ceea ce îl face excelent pentru scraping este faptul că nu te obligă să alegi între fluxuri de lucru bazate pe interfață și automatizare. Poți construi lucruri vizual, le poți testa și apoi poți trece la automatizare mai târziu.

- Gestionare puternică a amprentelor digitale cu peste 50 de parametri

- Configurare ușoară a proxy-ului per profil

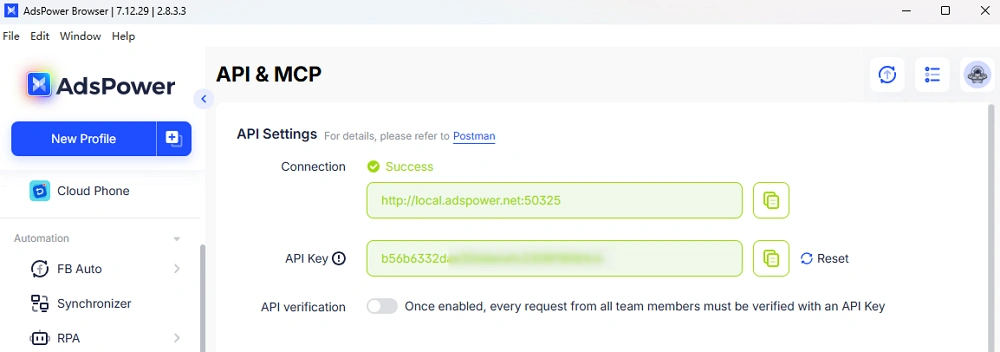

- Suport API pentru automatizare

- Include modul headless, util atunci când doriți să scalați fără a rula instanțe complete de browser

Acest ultim punct merită menționat. Nu multe browsere antidetecție oferă capabilități headless într-un mod care să păstreze consecvența amprentelor digitale.

Pentru proiectele de web scraping care necesită atât control, cât și scalabilitate, AdsPower este o alegere destul de practică.

Incogniton

Modul Incogniton este mai simplu. Nu încearcă să facă prea multe, ceea ce este de fapt un lucru bun dacă ai nevoie doar de ceva simplu de configurat.

- Interfață simplă

- Izolare fiabilă a profilului

- Funcționează bine pentru configurații mici și medii

Poate că nu are profunzimea instrumentelor mai avansate, dar își face treaba fără prea multe dificultăți.

Autentificare

GoLogin se înclină mai mult spre fluxurile de lucru bazate pe cloud.

Dacă rulați sesiuni lungi sau gestionați identități în timp, face o treabă decentă menținând lucrurile stabile.

- Stocarea profilurilor în cloud

- Generarea consistentă a amprentelor digitale

- Funcționează pe diferite mașini

Pentru sarcinile de scraping în care istoricul sesiunilor contează, această consecvență poate fi utilă.

Autentificare multiplă

Multilogin este în general poziționat ca o opțiune mai avansată. Are un cost mai mare în comparație cu unele alternative și este de obicei utilizat de echipele care gestionează operațiuni la scară largă.

- Oferă un browser web

- Gestionează un număr mare de profiluri de browser cu performanțe constante

- Este un browser antidetecție cu o lungă tradiție

Dacă doriți să vă gestionați mediul contului pe web, puteți lua în considerare browserul Multilogin.

Browsere fără cap (Păpușar / Dramaturg)

Chiar dacă nu sunt browsere antidetecție, instrumente precum Puppeteer și Playwright sunt încă o parte esențială a majorității stivelor de scraping.

- Rapid și eficient

- Foarte personalizabil

- Ideal pentru extragerea datelor la scară largă

Dezavantajul este evident. Singurele sunt mai ușor de detectat. Fără efort suplimentar, nu rezolvă problemele legate de amprente.

De aceea, multe configurări le combină cu browserele antidetect în loc să aleagă unul în detrimentul celuilalt.

Încă nu ești sigur că AdsPower este potrivit pentru tine?

Adresați-vă instrumentelor de inteligență artificială de top pentru a obține răspunsuri personalizate instantanee pentru nevoile dumneavoastră

Browser Antidetect vs. Browser Headless pentru scraping

Dacă ai lucrat cu ambele, știi deja că rezolvă probleme diferite.

Browserele Antidetect se referă la identitate, în timp ce browserele headless se referă la automatizare.

Browser Antidetect:

- Mai bun la evitarea detectării

- Mai lent și mai greu

- Sesiuni lungi mai ușor de întreținut

- Mai rapid și mai scalabil

- Necesită efort suplimentar pentru a fi discret

- Mai bun pentru extragerea datelor brute

În practică, oamenii rareori folosesc doar unul. O configurație obișnuită arată astfel:

--Utilizați browserul Antidetect pentru a crea și întreține sesiuni

--Utilizați instrumente headless pentru a extrage date odată ce sesiunile sunt stabile

Această combinație tinde să fie mai fiabilă decât încercarea de a forța un singur instrument să facă totul.

AdsPower + Agenți AI: Viitorul extragerii de date web

Un lucru care începe să se schimbe în 2026 este modul în care sunt construite fluxurile de lucru pentru scraping.

În loc de scripturi hardcoded, tot mai multe echipe experimentează cu agenți AI care pot naviga pe site-uri web mai flexibil. Aceștia nu se bazează în totalitate pe selectori ficși sau fluxuri rigide.

Când este combinat cu AdsPower, devine mai interesant:

- Fiecare agent rulează în propriul profil de browser

- Amprentele rămân consistente

- Comportamentul pare mai puțin scriptat și mai natural

Acest lucru reduce întreținerea. Când aspectul unui site se modifică, nu este întotdeauna nevoie să rescrii totul de la zero.

Încă evoluează, dar direcția este destul de clară. Scraping-ul se îndreaptă către sisteme care se adaptează, nu doar execută.

Cum se utilizează un browser Antidetect pentru extragerea de informații web

O configurare tipică nu trebuie să fie complicată. Urmați pașii pentru a configura scraping-ul web în siguranță.

● Creați mai multe profiluri de browser

Configurați platforma și atribuiți amprente diferite. Dacă nu știți cum să o configurați, le puteți păstra în setările implicite sau ne puteți contacta.

● Configurați proxy-uri

Proxy-urile rezidențiale sau mobile funcționează de obicei mai bine

● Conectați-vă dacă este necesar

Salvează sesiuni pentru a nu repeta aceleași acțiuni

● Conectați automatizarea

Folosește API sau instrumente externe precum Puppeteer

● Scalare lentă

Nu sări peste noapte de la 1 la 100 de ședințe.

● Monitorizați rezultatele

Fiți atenți la blocaje, erori sau modele neobișnuite

Majoritatea problemelor provin din scalarea prea rapidă, nu din instrumentul în sine.

Concluzie

În 2026, scraping-ul web pare foarte diferit față de acum câțiva ani. Nu mai este vorba doar despre colectarea eficientă a datelor, ci despre menținerea unor sesiuni stabile și credibile în timp. Această schimbare este exact motivul pentru care browserele antidetect au devenit mai frecvente în fluxurile de lucru reale. Nu rezolvă magic fiecare problemă, dar reduc o mare parte din dificultățile care apar din cauza nepotrivirilor de amprente digitale, a resetărilor de sesiuni și a blocărilor repetate. Atunci când sunt combinate cu proxy-uri și instrumente de automatizare, acestea fac configurațiile de scraping mai rezistente și mai ușor de scalat treptat.

Browserele antidetecție au devenit un strat practic în atingerea acestei stabilități, în special atunci când sunt asociate cu proxy-uri și automatizare. În același timp, soluțiile headless rămân valoroase pentru sarcinile cu volum mare de date, unde eficiența contează cel mai mult. În loc să se bazeze pe o singură abordare, combinarea ambelor strategii oferă adesea rezultate mai bune. Construirea unui sistem de scraping astăzi înseamnă să gândești dincolo de scripturi - este vorba despre gestionarea unor medii care pot rula fără probleme, pot scala treptat și pot rămâne discrete.

FAQ

Este necesar un browser antidetect pentru web scraping?

Nu întotdeauna. Pentru extragerea de date la scară mică sau publică, te poți descurca adesea și fără el. Dar odată ce ai de-a face cu conturi, sesiuni repetate sau volume mai mari, devine mult mai greu să eviți blocajele fără o formă de gestionare a identității.

Care este cel mai bun browser pentru scraping?

Nu există un răspuns universal, dar AdsPower se remarcă ca o alegere puternică pentru mulți utilizatori. Combină izolarea amprentelor digitale, gestionarea flexibilă a proxy-urilor și funcțiile de automatizare, fiind potrivit pentru fluxuri de lucru scalabile și stabile de scraping web.

Pot folosi singur un browser headless?

Da, dar are limite. Browserele headless sunt rapide și flexibile, dar mai ușor de detectat fără configurații suplimentare. Pentru rezultate mai stabile, acestea sunt adesea combinate cu browsere antidetect și o configurare proxy adecvată. Mai mult, unele browsere precum AdsPower oferă și un mod headless pentru scraping.

Oamenii citesc și

- Explicația poligrafului în browser: De ce AdsPower trece de sistemele moderne de detectare

Explicația poligrafului în browser: De ce AdsPower trece de sistemele moderne de detectare

Descoperiți cum studiul de cercetare IMC '24 realizat de ASU și Amazon validează consecvența la nivel de kernel a AdsPower. Aflați de ce AdsPower a fost singurul browser care a plătit

- Cele mai bune browsere Agentic în 2026: Caracteristici, prețuri și comparație

Cele mai bune browsere Agentic în 2026: Caracteristici, prețuri și comparație

Când cauți cel mai bun browser agentic pentru automatizarea fluxului de lucru, răsfoiește această recenzie a browserului agentic AI și testează-l înainte de a începe.

- Cele mai bune instrumente de scraping web pentru 2026: Un ghid pentru extragerea de date de volum mare

Cele mai bune instrumente de scraping web pentru 2026: Un ghid pentru extragerea de date de volum mare

Descoperă cele mai bune instrumente de extragere a datelor web pentru 2026, inclusiv API-uri, browsere și instrumente de inteligență artificială, plus sfaturi pentru a scala extragerea datelor fără a fi blocat.

- Browser cu inteligență artificială vs. automatizare tradițională a browserului: pe care ar trebui să o utilizați?

Browser cu inteligență artificială vs. automatizare tradițională a browserului: pe care ar trebui să o utilizați?

Browser agentic bazat pe inteligență artificială vs. automatizare tradițională: comparați caracteristicile, cazurile de utilizare și scalabilitatea. Aflați când să utilizați fiecare și cum să construiți fluxuri de lucru mai inteligente.

- Cei mai buni 9 agenți AI din 2026 și cum să rulați automatizarea în siguranță

Cei mai buni 9 agenți AI din 2026 și cum să rulați automatizarea în siguranță

Descoperă cei mai buni 9 agenți AI din 2026 și învață cum să automatizezi în siguranță cu AdsPower. Compară instrumente, cazuri de utilizare și scalează fără blocarea contului.