เครื่องมือ Web Scraping ที่ดีที่สุดปี 2026: คู่มือสำหรับการดึงข้อมูลปริมาณมหาศาล

ลองดูอย่างรวดเร็ว

การขยายสเกล Web Scraping มักเจอปัญหาการบล็อก, CAPTCHA และความไม่เสถียร ความสำเร็จต้องอาศัยการจัดการลายนิ้วมือ เซสชัน และอินฟราสตรัคเจอร์โดยผสมผสานเครื่องมือที่เหมาะสม เพื่อดึงข้อมูลอย่างแนบเนียน ติดตามเราเพื่อเริ่มต้นเลย!

หากคุณเคยดึงข้อมูล (Scrape) แค่ไม่กี่หน้าเว็บ มันอาจดูเหมือนง่ายมาก เขียนสคริปต์ง่ายๆ ใส่ Proxy เข้าไป ข้อมูลก็ไหลมาโดยไม่มีอุปสรรคอะไร สำหรับงานเล็กๆ ทุกอย่างมักจะราบรื่นจนรู้สึกว่าไม่ต้องออกแรงเลย แต่ความรู้สึกควบคุมได้แบบนั้นจะอยู่ไม่นาน เมื่อคุณเริ่มเพิ่มสเกลให้ใหญ่ขึ้น

ทันทีที่คุณเริ่มทำ Scraping ในสเกลที่ใหญ่ขึ้น ทุกอย่างจะคาดเดาได้ยากขึ้น คำขอ (Requests) จะเริ่มโดนบล็อก เซสชันหลุดกลางคัน และวิธีหลีกเลี่ยง CAPTCHA ในการทำ Web Scraping จะกลายเป็นปัญหาใหญ่ ไม่ใช่เรื่องเล็กๆ อีกต่อไป สิ่งที่เคยใช้งานได้ดีในการดึงข้อมูลจำนวนน้อยจะเริ่มช้าลงหรือพังไปเลย เมื่อถึงจุดนั้น การทำ Scraping จะไม่ใช่แค่การดึงโค้ด HTML อีกต่อไป แต่เป็นการจัดการตัวตน จัดการหน้าเว็บแบบไดนามิก และรักษาระบบของคุณให้เสถียรภายใต้แรงกดดันอย่างต่อเนื่อง คู่มือนี้จะเน้นไปที่วิธีที่ใช้งานได้จริงในสถานการณ์ดังกล่าว และไขข้อข้องใจว่าทำไมระบบจำนวนมากถึงพังก่อนจะไปถึงระดับนั้น

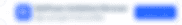

ทำไมเครื่องมือ Web Scraping ส่วนใหญ่ถึงล้มเหลวในสเกลใหญ่

ความเข้าใจผิดที่ใหญ่ที่สุดในการทำ Web Scraping คือการคิดว่าความสำเร็จในสเกลเล็กจะแปลว่าใช้งานในสเกลใหญ่ได้ ซึ่งมันไม่ใช่เลย

นี่คือจุดที่ระบบมักจะพัง:

- การบล็อก IP เกิดขึ้นอย่างรวดเร็ว

แค่ไม่กี่คำขอต่อนาที? ไม่มีปัญหา แต่ถ้าเป็นหลักพันต่อชั่วโมง? คุณจะโดนแบนอย่างรวดเร็ว

- การตรวจจับลายนิ้วมือ (Fingerprint) ไปไกลกว่าแค่ IP

เว็บไซต์สมัยใหม่ไม่ได้ติดตามแค่ IP ของคุณ แต่ยังวิเคราะห์ลายนิ้วมือของเบราว์เซอร์ พฤติกรรมการใช้งาน และความสม่ำเสมอของเซสชัน

- เนื้อหาแบบไดนามิกทำให้ทุกอย่างซับซ้อนขึ้น

เว็บไซต์ที่ใช้ JavaScript หนักๆ จำเป็นต้องมีการเรนเดอร์เบราว์เซอร์เต็มรูปแบบ การใช้แค่ HTTP Request แบบธรรมดาไม่เพียงพออีกต่อไป

- CAPTCHA ขัดขวางกระบวนการทำงาน

ในสเกลที่ใหญ่ การเจอ CAPTCHA ไม่ใช่เรื่องที่นานๆ เกิดที แต่มันจะโผล่มาตลอดเวลา

- การบำรุงรักษากลายเป็นงานประจำ

การเปลี่ยนแปลงเลย์เอาต์เว็บ, การอัปเดตระบบป้องกันบอท และข้อจำกัดในการส่งคำขอ บังคับให้คุณต้องปรับแต่งโค้ดอยู่เสมอ

สรุปสั้นๆ คือ การทำ Scraping ในสเกลใหญ่ไม่ใช่แค่ปัญหาเรื่องการเขียนโค้ด แต่มันคือปัญหาเรื่องโครงสร้างพื้นฐานและการพรางตัว

ประเภทของเครื่องมือ Web Scraping

การเลือกเครื่องมือที่เหมาะสมขึ้นอยู่กับทักษะทางเทคนิค ปริมาณข้อมูลที่คุณต้องการ และความทนทานต่อการบำรุงรักษาระบบ เรามาแบ่งประเภทหลักๆ กัน

1. เฟรมเวิร์กที่ใช้การเขียนโค้ด (Code-Based Frameworks)

นี่คือเส้นทางสาย DIY อย่างแท้จริง หากคุณเคยสร้าง Scraper จากศูนย์ นี่คือจุดที่คุณน่าจะเริ่มต้น มันให้คุณควบคุมได้ทั้งหมด แต่ก็หมายความว่าคุณต้องรับผิดชอบทุกอย่างเองด้วย

เหมาะสำหรับ:

- นักพัฒนาที่ต้องการควบคุมทุกรายละเอียด

- โปรเจ็กต์ที่ไม่สามารถใช้เครื่องมือสำเร็จรูปได้

- ลอจิกการ Scraping ที่ซับซ้อน

ข้อดี:

- ปรับแต่งได้แทบทุกอย่าง

- เชื่อมต่อกับระบบของคุณเองได้ง่าย

- ควบคุมวิธีการรวบรวมและประมวลผลข้อมูลได้เต็มที่

ข้อเสีย:

- แน่นอนว่าต้องเขียนโค้ดเป็น

- การดูแลรักษาระบบอาจวุ่นวายเมื่อเวลาผ่านไป

- คุณอาจต้องใช้เครื่องมือเสริมสำหรับ Proxy, CAPTCHA ฯลฯ

2. Scraper แบบไม่ใช้โค้ด / แบบเน้นภาพ (No-Code / Visual Scrapers - เหมาะกับมือใหม่)

เครื่องมือกลุ่มนี้เน้นเรื่องความรวดเร็วและความเรียบง่าย คุณไม่ต้องเขียนโค้ด แค่คลิกเลือกสิ่งที่คุณต้องการดึงข้อมูล

เหมาะสำหรับ:

- คนที่ไม่มีพื้นฐานด้านเทคนิค

- งาน Scraping เล็กๆ หรืองานที่ต้องการความรวดเร็ว

- การทดสอบไอเดียอย่างรวดเร็ว

ข้อดี:

- เรียนรู้การใช้งานได้ง่าย

- เริ่มต้นใช้งานได้รวดเร็ว

- ไม่ต้องเขียนโค้ด

ข้อเสีย:

- ไม่ค่อยยืดหยุ่น

- พังง่ายเมื่อเจอเว็บไซต์ที่ซับซ้อนหรือเป็นแบบไดนามิก

- ขยายสเกลได้ยาก

3. Scraping APIs (เหมาะสำหรับการขยายสเกลโดยไม่ต้องดูแลระบบเยอะ)

Scraping API จะจัดการงานหนักๆ แทนคุณ คุณแค่ส่งคำขอ และพวกเขาก็จะจัดการเรื่อง Proxy, การลองใหม่ (Retries) และบางครั้งรวมถึงการเรนเดอร์เบื้องหลังด้วย

เหมาะสำหรับ:

- ทีมที่ไม่อยากมานั่งดูแลโครงสร้างพื้นฐานเอง

- การ Scraping ปริมาณมหาศาล

- การปรับใช้ (Deployment) ที่รวดเร็วกว่า

ข้อดี:

- จัดการการสลับ IP ให้อัตโนมัติ

- มีระบบ Retry ให้ในตัว

- มักรองรับ Headless browsers

ข้อเสีย:

- ค่าใช้จ่ายอาจบานปลายได้

- ควบคุมกระบวนการได้น้อยลง

- คุณต้องพึ่งพาบริการจากภายนอกตลอด

4. เครื่องมือ AI Web Scraping (เทรนด์ใหม่ที่กำลังมาแรง)

นี่คือแนวทางใหม่ แทนที่จะเขียน Selectors คุณแค่สั่งว่าคุณต้องการข้อมูลอะไร แล้วเครื่องมือจะพยายามหามาให้เอง

เหมาะสำหรับ:

- การทดลองอย่างรวดเร็ว

- เว็บไซต์ที่มีเลย์เอาต์รกๆ หรือเปลี่ยนบ่อย

- ประหยัดเวลาในการตั้งค่า

ข้อดี:

- ปรับตัวได้เมื่อโครงสร้างหน้าเว็บเปลี่ยน

- ลดการปรับแต่งด้วยมือ

- เริ่มต้นได้เร็วกว่า

ข้อเสีย:

- ไม่ได้แม่นยำเสมอไป

- ยังอยู่ในช่วงพัฒนา

- อาจมีปัญหากับระบบป้องกันบอท (Anti-bot)

5. Scraping Browsers

นี่คือจุดที่ทุกอย่างเริ่มใกล้เคียง "โลกแห่งความเป็นจริง" แทนที่จะส่งแค่ Request เครื่องมือเหล่านี้จะพยายามทำตัวเหมือนผู้ใช้งานจริงๆ

พวกมันจะจัดการลายนิ้วมือ (Fingerprints), คุกกี้, เซสชัน และทุกอย่างที่เบราว์เซอร์ปกติพึงมี

เหมาะสำหรับ:

- หลีกเลี่ยงการถูกตรวจจับ

- การรันหลายบัญชีพร้อมกัน

- การดึงข้อมูลจากแพลตฟอร์มที่มีการป้องกันแน่นหนา

ข้อดี:

- มีพฤติกรรมคล้ายผู้ใช้งานจริงมากขึ้น

- รักษาเซสชันให้สม่ำเสมอ

- ช่วยลดโอกาสการถูกบล็อกและถูกแบน

ข้อเสีย:

- ใช้เวลาในการตั้งค่าให้สมบูรณ์

- มักต้องใช้ร่วมกับเครื่องมืออื่นๆ

เครื่องมือ Web Scraping ที่ดีที่สุดที่คุณควรใช้

ไม่ใช่เครื่องมือ Scraping ทุกตัวที่จะทำงานได้ดีเมื่อคุณเริ่มดึงข้อมูลในปริมาณมากๆ บางตัวดูดีบนหน้ากระดาษแต่พอเจอของจริงก็พัง เครื่องมือด้านล่างนี้คือตัวเลือกที่หลายคนใช้งานจริงเมื่อต้องรันระบบอย่างต่อเนื่องและในสเกลใหญ่

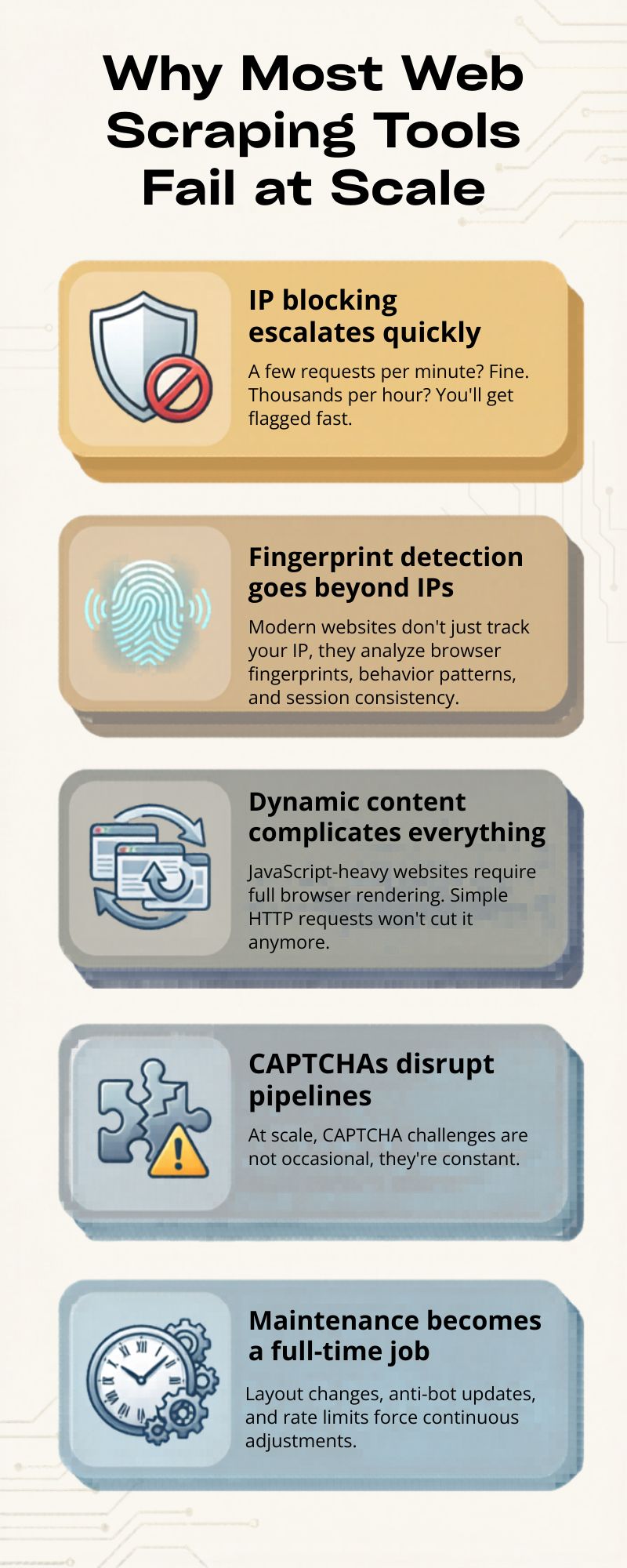

1. AdsPower

เมื่อคุณต้องทำ Scraping บนแพลตฟอร์มที่มีระบบป้องกันบอทที่แข็งแกร่ง เครื่องมืออย่าง AdsPower แทบจะเป็นสิ่งที่ขาดไม่ได้

มันไม่ใช่แค่เบราว์เซอร์ธรรมดาๆ แต่มันถูกสร้างมาเพื่อจำลองสภาพแวดล้อมของผู้ใช้จริง ซึ่งสร้างความแตกต่างอย่างมากเมื่อคุณพยายามหลบหลีกการตรวจจับ

สิ่งสำคัญที่ควรรู้:

- แต่ละโปรไฟล์จะมีลายนิ้วมือ (Fingerprint) แยกกันโดยเฉพาะ

- โปรไฟล์ต่างๆ จะมีพฤติกรรมเหมือนอุปกรณ์จริงที่แยกกัน

- รองรับ RPA สำหรับการทำงานอัตโนมัติ (Automating workflows)

- สามารถรวมระบบแก้ CAPTCHA ได้

- รักษาความเสถียรของเซสชันด้วยคุกกี้และ Local storage

ที่ปริมาณการดึงข้อมูลสูงๆ วิธีนี้มักจะทำงานได้ดีกว่าการแค่เพิ่มความเร็วในการส่ง Request คุณไม่ได้ฝืนดันระบบเข้าไป แต่คุณกำลังกลมกลืนไปกับมัน สำหรับอีคอมเมิร์ซ โซเชียลมีเดีย หรือมาร์เก็ตเพลส วิธีนี้มักจะหมายถึงการถูกแบนที่น้อยลงและระบบล่มน้อยลง

2. Scrapingdog

Scrapingdog ทำให้ทุกอย่างเรียบง่าย และนั่นคือเหตุผลที่บางทีมชอบมัน

จุดเด่น:

- จัดการ Proxy และเรนเดอร์เบื้องหลังให้

- ทำงานได้เสถียรสำหรับการดึงข้อมูลที่มีโครงสร้างชัดเจน (Structured data)

- API เรียบง่ายและตรงไปตรงมา

ถ้าคุณไม่อยากวุ่นวายกับการตั้งค่าโครงสร้างพื้นฐาน และต้องการแค่เครื่องมือที่ใช้งานได้จริง นี่คือตัวเลือกที่สมเหตุสมผล

3. ScraperAPI

ScraperAPI จะเน้นไปที่ความเสถียรเหนือสิ่งอื่นใด

ฟีเจอร์หลัก:

- สลับ IP อัตโนมัติ

- มีระบบจัดการ CAPTCHA ในตัว

- ออกแบบมาเพื่อให้มีอัตราความสำเร็จสูงในสเกลใหญ่

เหมาะกับงาน Scraping ที่ต้องทำอย่างต่อเนื่อง และให้ความสำคัญกับความสม่ำเสมอมากกว่าการปรับแต่ง

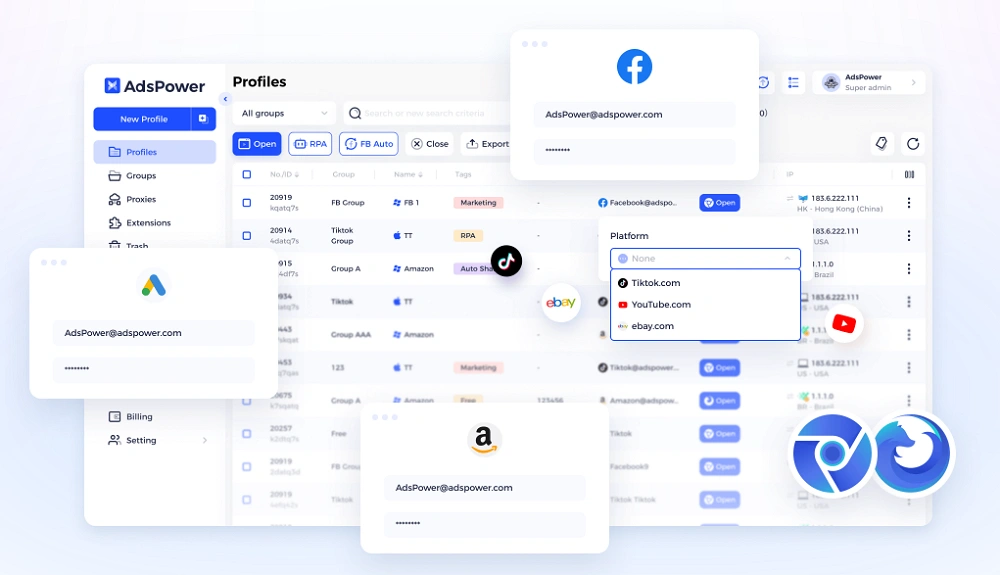

4. Bright Data

Bright Data จัดอยู่ในกลุ่มเครื่องมือระดับแอดวานซ์

สิ่งที่คุณจะได้รับ:

- เครือข่าย Proxy ขนาดใหญ่ (Residential, Mobile, Datacenter)

- ตัวเลือกการกำหนดเป้าหมายอย่างละเอียด

- บริการรวบรวมข้อมูลเพิ่มเติม

มันไม่ใช่เครื่องมือที่ตั้งค่าได้ง่ายที่สุด และราคาก็สะท้อนถึงสิ่งนั้น แต่สำหรับการดำเนินการขนาดใหญ่ ถือว่าครอบคลุมจนหาคู่แข่งยาก

5. Apify

Apify เป็นเครื่องมือที่คนมักจะเปลี่ยนมาใช้หลังจากลองตัวเลือกที่ง่ายกว่ามาแล้ว มันช่วยประหยัดเวลา แต่ก็ยังให้คุณปรับแต่งได้เมื่อจำเป็น

- มี "actors" สำเร็จรูปสำหรับงาน Scraping ทั่วไป

- ทำงานบนคลาวด์ทั้งหมด คุณจึงไม่ต้องจัดการเซิร์ฟเวอร์

- ขยายสเกลได้ง่ายเมื่อปริมาณงานเพิ่มขึ้น

- มี Ecosystem ที่ดีพร้อมเครื่องมือและเทมเพลตให้แชร์กัน

มันไม่ได้ซับซ้อนเกินไป แต่ก็ไม่ใช่แบบ Plug-and-Play ซะทีเดียว อยู่ตรงกลางพอดี ซึ่งตอบโจทย์หลายๆ ทีม

6. Playwright

Playwright ค่อนข้างจะออกแนวเครื่องมือสำหรับนักพัฒนาซอฟต์แวร์ ซึ่งมันก็เป็นแบบนั้นจริงๆ มันถูกใช้อย่างแพร่หลายเพราะทำงานได้เสถียรกับเว็บไซต์ยุคใหม่

- รองรับ Chromium, Firefox, และ WebKit

- จัดการหน้าเว็บแบบไดนามิกและ JavaScript หนักๆ ได้ดีมาก

- เสถียรพอสำหรับการทำ Automation ที่ใช้เวลานาน

- ยืดหยุ่นถ้าต้องการปรับแต่งพฤติกรรม

การตั้งค่า Scraping แบบ Custom ส่วนใหญ่มักจะใช้เครื่องมืออย่างนี้เป็นเบื้องหลัง

7. Octoparse

Octoparse มักจะเป็นตัวเลือกที่หลายคนลองเมื่อไม่อยากยุ่งกับโค้ดเลย

- อินเทอร์เฟซแบบภาพ เน้นการชี้และคลิก

- เริ่มงาน Scraping พื้นฐานได้อย่างรวดเร็ว

- เหมาะสำหรับโปรเจ็กต์เล็กๆ หรืองานที่ทำแค่ครั้งเดียว

- มีเทมเพลตสำหรับเว็บไซต์ยอดฮิต

มันสะดวกมากในช่วงเริ่มต้น แต่พอเรื่องเริ่มซับซ้อนขึ้นหรือปริมาณเยอะขึ้น มันอาจจะรู้สึกมีข้อจำกัด

ตารางเปรียบเทียบอย่างรวดเร็ว

มาถึงขั้นนี้ ชัดเจนแล้วว่าไม่มีเครื่องมือไหนที่ทำได้สมบูรณ์แบบทุกอย่าง บางตัวใช้ง่ายกว่า บางตัวให้ควบคุมได้มากกว่า และบางตัวก็สร้างมาเพื่อขยายสเกลโดยเฉพาะ

แทนที่จะคิดมาก การนำมาเทียบกันก็ช่วยได้เยอะ โดยเฉพาะเมื่อเปรียบเทียบเครื่องมืออย่าง เบราว์เซอร์ Anti-detect ที่ดีที่สุดสำหรับ Web Scraping ตารางด้านล่างให้ภาพรวมคร่าวๆ ว่าแต่ละเครื่องมือเหมาะกับส่วนไหนและมักจะถูกนำไปใช้ทำอะไร

|

เครื่องมือ |

ประเภท |

เหมาะสำหรับ |

จุดเด่น |

|

AdsPower |

Scraping Browser |

ป้องกันการถูกตรวจจับ & การขยายสเกล |

การแยกโปรไฟล์ลายนิ้วมือ (Fingerprint isolation) |

|

Scrapingdog |

API |

งาน Scraping ง่ายๆ ทั่วไป |

ใช้งานง่าย |

|

ScraperAPI |

API |

ระบบไปป์ไลน์ขนาดใหญ่ |

ความเสถียร |

|

Bright Data |

API / Proxy Network |

การ Scraping ระดับองค์กร (Enterprise) |

ความครอบคลุม |

|

Apify |

Platform |

Automation + Scraping |

ความยืดหยุ่น |

|

Playwright |

Framework |

โซลูชันแบบ Custom |

การควบคุมได้ดั่งใจ |

|

Octoparse |

No-code |

ผู้เริ่มต้นใหม่ |

ความเรียบง่าย |

ยังไม่แน่ใจว่า AdsPower เหมาะกับคุณหรือไม่?

สอบถามเครื่องมือ AI ชั้นนำ เพื่อรับคำตอบที่เหมาะกับความต้องการของคุณทันที

ข้อคิดทิ้งท้าย

มาถึงตอนนี้คงชัดเจนแล้วว่าการทำ Web Scraping ในปี 2026 ไม่ใช่แค่การหาเครื่องมือเดียวที่สมบูรณ์แบบแล้วจบ สิ่งที่ทำงานได้ดีในทางปฏิบัติคือการผสมผสานเครื่องมือหลายๆ ตัวเข้าด้วยกัน แต่ละตัวจัดการในส่วนที่ต่างกัน เลเยอร์หนึ่งจัดการ Automation, อีกส่วนจัดการ Proxy และ Requests, และอีกส่วนจัดการเซสชันกับตัวตน รูปแบบทั่วไปมักจะใช้ Playwright ในการคุมเบราว์เซอร์ ใช้ Scraping API อย่าง ScraperAPI หรือ Bright Data จัดการโครงสร้างพื้นฐาน และใช้เครื่องมืออย่าง AdsPower ในการจัดการ Fingerprint และคงสภาพเซสชันให้เสถียร เครื่องมือเหล่านี้ไม่ได้มาแทนที่กัน แต่มันทำงานร่วมกัน

ถ้ามีสิ่งหนึ่งที่ควรจำไว้ ก็คือการหลีกเลี่ยงการโดนตรวจจับนั้นสำคัญกว่าความเร็ว การส่ง Request เยอะๆ จะไม่มีประโยชน์เลยถ้าคุณโดนบล็อกไปกลางทาง ระบบที่ช้ากว่าแต่เสถียรกว่าจะให้ผลลัพธ์ที่ดีกว่าระบบที่รุกหนักแบบ Aggressive เสมอ เน้นไปที่ความสม่ำเสมอ แล้วการขยายสเกลจะง่ายขึ้นมากเมื่อเวลาผ่านไป

คำถามที่พบบ่อย (FAQs)

จะจัดการ CAPTCHA อย่างไรในกระบวนการ Scraping?

ในสเกลการดึงข้อมูลขนาดใหญ่ คุณหนี CAPTCHA ไม่พ้นแน่ๆ ดังนั้นเป้าหมายคือการบริหารจัดการมันมากกว่าที่จะกำจัดมันให้หมดไป ระบบส่วนใหญ่จะลดความถี่ในการเจอ CAPTCHA โดยการลดอัตราการส่ง Request, นำเซสชันกลับมาใช้ใหม่ และเลียนแบบพฤติกรรมผู้ใช้จริง นอกจากนั้น หลายๆ ทีมยังรวมบริการแก้ CAPTCHA เข้ามาเพื่อช่วยให้เวิร์กโฟลว์เดินต่อได้แบบไม่ต้องใช้คนมานั่งกดจริงๆ มันคือการผสมผสานเทคนิคระหว่าง Proxy, การจับจังหวะ (Timing), และการเลียนแบบพฤติกรรม เพื่อให้ทุกอย่างเสถียร

ทำไมถึงเจอ CAPTCHA บ่อยขึ้นเมื่อขยายสเกล?

เมื่อปริมาณการ Scraping เพิ่มขึ้น รูปแบบการทำงานของคุณจะถูกตรวจจับจากเว็บไซต์ได้ง่ายขึ้น การกระทำซ้ำๆ คำขอที่หน้าตาเหมือนกัน หรือจังหวะการกดที่ไม่เป็นธรรมชาติ ล้วนเป็นจุดสังเกต CAPTCHA ถูกใช้เพื่อตรวจสอบว่าทราฟฟิกนั้นมาจากคนจริงๆ หรือไม่ ยิ่งพฤติกรรมของคุณดูเหมือน "บอท" มากเท่าไหร่ มันก็จะยิ่งโผล่มาบ่อยขึ้นเท่านั้น การขยายสเกลจึงไม่ใช่แค่การส่ง Request ให้เยอะขึ้น แต่ต้องทำให้ Request เหล่านั้นคาดเดาได้ยากขึ้นและดูเหมือนผู้ใช้จริงๆ ให้มากที่สุด

ทำไมระบบ Scraping ของคุณถึงต้องมีการป้องกัน Fingerprint?

แค่มี Proxy อย่างเดียวไม่พออีกต่อไป เว็บไซต์สมัยนี้วิเคราะห์แม้กระทั่งลายนิ้วมือเบราว์เซอร์ (Browser fingerprints), การตั้งค่าอุปกรณ์ และพฤติกรรมผู้ใช้เพื่อหาตัวบอท หากไม่มีการป้องกันตรงจุดนี้ ต่อให้สลับ IP ไปเรื่อยๆ ก็ยังโดนจับได้ การสร้างสภาพแวดล้อมเบราว์เซอร์ที่แยกกันอย่างชัดเจนจะช่วยให้เครื่องมือป้องกัน Fingerprint ทำงานได้ดีและทำให้แต่ละเซสชันดูเนียนสมจริง สิ่งนี้ช่วยลดการบล็อกและทำให้งาน Scraping ไหลลื่นขึ้น โดยเฉพาะในการรันแบบสเกลใหญ่

คนยังอ่าน

- เจาะลึก Browser Polygraph: ทำไม AdsPower ถึงรอดพ้นระบบตรวจจับที่ล้ำสมัย

เจาะลึก Browser Polygraph: ทำไม AdsPower ถึงรอดพ้นระบบตรวจจับที่ล้ำสมัย

เผยผลงานวิจัย IMC '24 จาก ASU และ Amazon ที่รับรองความสอดคล้องระดับเคอร์เนลของ AdsPower เรียนรู้เหตุผลที่ทำให้ AdsPower เป็นเบราว์เซอร์เดียวที่ผ่านการทดสอบ "Polygraph"

- รวมสุดยอดเบราว์เซอร์ AI ทำงานอัตโนมัติ (Agentic Browser) ปี 2026: ฟีเจอร์ ราคา และการเปรียบเทียบ

รวมสุดยอดเบราว์เซอร์ AI ทำงานอัตโนมัติ (Agentic Browser) ปี 2026: ฟีเจอร์ ราคา และการเปรียบเทียบ

หากคุณกำลังมองหาเบราว์เซอร์ AI อัจฉริยะที่ดีที่สุดเพื่อเพิ่มประสิทธิภาพการทำงานอัตโนมัติ ลองอ่านรีวิวเปรียบเทียบนี้และเลือกทดสอบสิ่งที่ใช่ก่อนเริ่มใช้งานจริง

- เบราว์เซอร์ป้องกันการตรวจจับที่ดีที่สุดสำหรับการดึงข้อมูลจากเว็บไซต์ในปี 2026

เบราว์เซอร์ป้องกันการตรวจจับที่ดีที่สุดสำหรับการดึงข้อมูลจากเว็บไซต์ในปี 2026

ค้นหาโปรแกรมป้องกันการตรวจจับที่ดีที่สุดสำหรับการดึงข้อมูลจากเว็บไซต์ในปี 2026 เปรียบเทียบเครื่องมือชั้นนำ คุณสมบัติหลัก และเรียนรู้วิธีหลีกเลี่ยงการตรวจจับและขยายขอบเขตการดึงข้อมูลของคุณ

- AI Agentic Browser vs Traditional Browser Automation: เลือกใช้อะไรดี?

AI Agentic Browser vs Traditional Browser Automation: เลือกใช้อะไรดี?

เปรียบเทียบ AI agentic browser กับระบบอัตโนมัติแบบดั้งเดิม: ฟีเจอร์ กรณีการใช้งาน และความสามารถในการขยายขนาด เรียนรู้ว่าควรใช้แบบไหนและวิธีสร้างเวิร์กโฟลว์ที่ฉลาดขึ้น

- 9 อันดับ AI Agent ที่ดีที่สุดในปี 2026 & วิธีรัน Automation อย่างปลอดภัย

9 อันดับ AI Agent ที่ดีที่สุดในปี 2026 & วิธีรัน Automation อย่างปลอดภัย

ค้นพบ 9 สุดยอด AI Agent ในปี 2026 พร้อมเรียนรู้วิธีทำ Automation อย่างปลอดภัยด้วย AdsPower เปรียบเทียบเครื่องมือ การใช้งาน และสเกลงานโดยไม่โดนแบนบัญชี