2026'nın En İyi Web Kazıma Araçları: Yüksek Hacimli Veri Çıkarma Rehberi

Hızlıca Bakın

Web kazıma (web scraping) işlemlerini ölçeklendirmek beraberinde engellemeleri, CAPTCHA'ları ve kararsızlıkları getirir. Başarılı olmak; parmak izlerini, oturumları ve altyapıyı yöneterek, güvenilir ve tespit edilmeyen veri çıkarımı için doğru araç kombinasyonunu kurmayı gerektirir. Ücretsiz denemek için bizi takip edin!

Eğer daha önce sadece birkaç sayfadan veri çektiyseniz, bu işlem size şaşırtıcı derecede kolay gelmiş olabilir. Basit bir komut dosyası (script), belki arka planda bir proxy ile veriler fazla bir engele takılmadan akar. Küçük görevlerde işler o kadar sorunsuz yürür ki neredeyse hiç zahmet gerektirmez. Ancak hacmi artırmaya başladığınızda, sahip olduğunuzu sandığınız bu kontrol hissi kısa sürede kaybolur.

Büyük ölçekli web kazıma (web scraping) işlemlerine geçtiğiniz anda her şey çok daha karmaşık hale gelir. İstekler engellenmeye başlar, oturumlar düşer ve web kazımada CAPTCHA'dan nasıl kaçınılır sorusu küçük bir pürüz olmaktan çıkıp temel bir soruna dönüşür. Küçük veri kümelerinde sorunsuz çalışan sistemler, ölçek büyüdüğünde yavaşlar veya tamamen çöker. Bu noktada mesele sadece HTML çekmek değil; kimlikleri yönetmek, dinamik sayfalarla başa çıkmak ve sisteminizi sürekli baskı altında stabil tutmaktır. Bu rehber, zorlu koşullarda gerçekten işe yarayan yöntemlere ve pek çok sistemin neden bu seviyeye ulaşmadan çöktüğüne odaklanıyor.

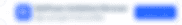

Çoğu Web Kazıma Aracı Ölçeklendirmede Neden Başarısız Olur?

Web kazıma konusundaki en büyük yanılgı, küçük çaplı başarının büyük ölçekli güvenilirlik anlamına geldiğini düşünmektir. Durum kesinlikle böyle değildir.

Sistemlerin genellikle çöktüğü noktalar şunlardır:

- IP engellemeleri hızla artar

Dakikada birkaç istek mi? Sorun değil. Saatte binlerce istek mi? Çok geçmeden kara listeye alınırsınız.

- Parmak izi tespiti IP'lerin ötesine geçer

Modern web siteleri sadece IP adresinizi takip etmez; tarayıcı parmak izlerini, davranış kalıplarını ve oturum tutarlılığını da analiz eder.

- Dinamik içerik her şeyi zorlaştırır

JavaScript ağırlıklı siteler tam tarayıcı oluşturmayı (rendering) gerektirir. Basit HTTP istekleri artık yeterli olmayacaktır.

- CAPTCHA'lar veri akışını kesintiye uğratır

Büyük ölçekte, CAPTCHA doğrulamaları ara sıra karşılaşılan bir şey değil, sürekli bir engeldir.

- Bakım tam zamanlı bir işe dönüşür

Sayfa yapısındaki değişiklikler, bot karşıtı (anti-bot) güncellemeler ve hız sınırları sizi sürekli kodları güncellemeye zorlar.

Kısacası, yüksek hacimli web kazıma sadece bir kodlama sorunu değildir. Bu, bir altyapı ve gizlilik (stealth) meselesidir.

Web Kazıma Araçlarının Türleri

Doğru aracı seçmek; teknik becerilerinize, hedeflediğiniz veri hacmine ve bakım süreçlerine ayırabileceğiniz zamana bağlıdır. Gelin temel kategorileri inceleyelim.

1. Kod Tabanlı Framework'ler

Bu, aslında "kendin yap" (DIY) yaklaşımıdır. Daha önce sıfırdan bir web kazıyıcı (web scraper) yazdıysanız muhtemelen buradan başlamışsınızdır. Size tam kontrol sağlar ancak her şeyden sizin sorumlu olduğunuz anlamına gelir.

En uygun olduğu durumlar:

- Her detayı kontrol etmek isteyen geliştiriciler

- Hazır araçların yetersiz kaldığı özel projeler

- Daha karmaşık kazıma mantığı gerektiren işler

Avantajları:

- Hemen hemen her şeyi özelleştirebilirsiniz

- Kendi sistemlerinize entegre etmesi kolaydır

- Verilerin nasıl toplanıp işleneceği konusunda tam kontrol sunar

Dezavantajları:

- Kodlama bilgisi gerektirir

- Zamanla bakımı zorlaşabilir

- Proxy'ler, CAPTCHA çözücüler vb. için ek araçlara ihtiyacınız olacaktır

2. Kodsuz (No-Code) / Görsel Kazıyıcılar (Yeni Başlayanlar İçin En İyisi)

Bu araçlar tamamen hız ve basitlik odaklıdır. Kod yazmazsınız; sadece tıklayarak hangi verileri çekmek istediğinizi belirlersiniz.

En uygun olduğu durumlar:

- Teknik geçmişi olmayan kullanıcılar

- Küçük veya acil kazıma görevleri

- Fikirleri hızlıca test etmek

Avantajları:

- Öğrenmesi çok kolaydır

- Hızlıca çalışan bir sistem kurabilirsiniz

- Kodlama gerektirmez

Dezavantajları:

- Çok esnek değildir

- Karmaşık veya dinamik sitelerde kolayca bozulur

- Ölçeklendirmeye uygun değildir

3. Web Kazıma API'leri (Bakım Gerektirmeden Ölçeklendirme İçin)

Web kazıma API'leri işin zor kısmını sizin yerinize halleder. Bir istek gönderirsiniz; onlar proxy'leri, yeniden denemeleri ve hatta bazen arka planda tarayıcı oluşturma (rendering) işlerini yönetir. Yüksek hacimli işlemlerde engellenmeden kazıma yapmak için proxy'lerin nasıl kullanıldığını incelemek faydalı olacaktır.

En uygun olduğu durumlar:

- Altyapı yönetimiyle uğraşmak istemeyen ekipler

- Yüksek hacimli web kazıma işlemleri

- Daha hızlı devreye alma

Avantajları:

- IP rotasyonu otomatik olarak halledilir

- Dahili yeniden deneme mantığı (retry logic) bulunur

- Genellikle başsız tarayıcıları (headless browsers) destekler

Dezavantajları:

- Maliyetler hızla artabilir

- Süreç üzerinde daha az kontrolünüz olur

- Üçüncü taraf bir hizmete bağlı kalırsınız

4. Yapay Zeka Web Kazıma Araçları (Yükselen Trend)

Bu oldukça yeni bir yaklaşımdır. CSS seçicileri (selectors) yazmak yerine, sadece hangi veriye ihtiyacınız olduğunu tarif edersiniz ve yapay zeka web kazıma araçları bunu sizin için bulmaya çalışır.

En uygun olduğu durumlar:

- Hızlı denemeler

- Karmaşık veya sık değişen sayfa yapıları

- Kurulum süresinden tasarruf etmek

Avantajları:

- Sayfa yapıları değiştiğinde uyum sağlayabilir

- Daha az manuel ayar gerektirir

- Başlaması çok daha hızlıdır

Dezavantajları:

- Her zaman %100 doğru sonuç vermez

- Hâlâ geliştirilme aşamasındadır

- Anti-bot sistemleriyle başa çıkmakta zorlanabilir

5. Kazıma Tarayıcıları (Scraping Browsers)

İşlerin daha "gerçekçi" hissettirmeye başladığı yer burasıdır. Sadece istek göndermek yerine, bu araçlar gerçek bir kullanıcı gibi davranmaya çalışır.

Normal bir tarayıcının yapacağı gibi parmak izlerini, çerezleri ve oturumları yönetirler.

En uygun olduğu durumlar:

- Tespit edilmekten kaçınmak

- Birden fazla hesabı yönetmek

- Sıkı korunan platformları kazımak

Avantajları:

- Gerçek bir kullanıcı gibi davranır

- Oturumları tutarlı tutar

- Engellemeleri ve yasaklanmaları büyük ölçüde azaltır

Dezavantajları:

- Doğru şekilde ayarlamak zaman alır

- Genellikle diğer araçlarla birlikte kullanılır

Kullanmanız Gereken En İyi Web Kazıma Araçları

İşlem hacminizi artırdığınızda her kazıma aracı iyi performans göstermez. Bazıları kağıt üzerinde harika görünse de baskı altında çöker. Aşağıda listelenen araçlar, işlerin kesintisiz ve büyük ölçekte yürümesi gerektiğinde profesyonellerin gerçekten güvendiği en iyi araçlardır.

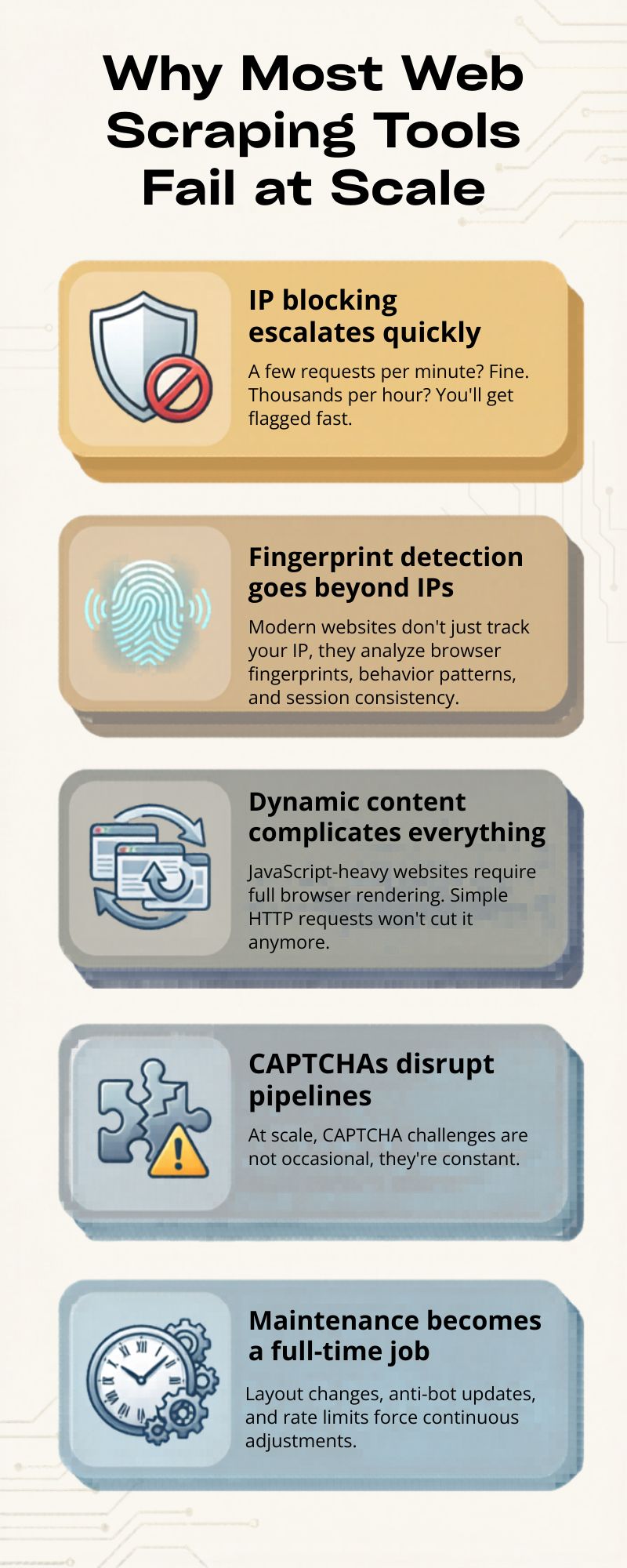

1. AdsPower

Güçlü bot karşıtı sistemlere sahip platformlardan veri çekerken, AdsPower gibi araçlar neredeyse bir zorunluluk haline gelir.

Bu sadece sıradan bir tarayıcı değildir; gerçek kullanıcı ortamlarını simüle etmek için tasarlanmıştır, ki bu da radara yakalanmamaya çalışırken büyük bir fark yaratır.

Bilmeniz gereken önemli özellikler:

- Her profilin kendi izole parmak izi vardır

- Profiller ayrı fiziksel cihazlarmış gibi davranır

- İş akışlarını otomatikleştirmek için RPA desteği sunar

- CAPTCHA çözücülerle entegre çalışabilir

- Çerezler ve yerel depolama ile oturumları stabil tutar

Yüksek hacimlerde bu yaklaşım, istek hızını artırmaktan çok daha iyi sonuç verir. Hedefinize zorla girmeye çalışmazsınız; araya karışırsınız. E-ticaret, sosyal medya veya pazaryeri verisi çekerken bu, daha az engel ve daha az kesinti anlamına gelir.

2. Scrapingdog

Scrapingdog işleri basit tutar, tam da bu yüzden bazı ekiplerin ilk tercihidir.

Öne çıkan yanları:

- Proxy'leri ve render işlemlerini arka planda yönetir

- Yapılandırılmış veri çıkarma işlemlerinde güvenilir şekilde çalışır

- Temiz ve anlaşılır bir API sunar

Altyapı kurulumuyla uğraşmak istemiyor ve sadece tıkır tıkır çalışan bir şeye ihtiyaç duyuyorsanız, bu oldukça mantıklı bir seçenektir.

3. ScraperAPI

ScraperAPI her şeyden önce istikrara (stabiliteye) odaklanır.

Temel özellikler:

- Otomatik IP rotasyonu

- Dahili CAPTCHA yönetimi

- Ölçekli işlemlerde yüksek başarı oranları için tasarım

Özelleştirmeden ziyade tutarlılığın önemli olduğu sürekli web kazıma işleri için harika bir tercihtir.

4. Bright Data

Bright Data, yelpazenin daha gelişmiş ve kurumsal ucunda yer alır.

Sundukları:

- Geniş proxy ağı (konut, mobil, veri merkezi)

- Detaylı hedefleme seçenekleri

- Ek veri toplama hizmetleri

Kurulumu en basit araç değildir ve fiyatlandırması da bunu yansıtır. Ancak büyük operasyonlar için eşleşmesi zor bir kapsama alanı sunar.

5. Apify

Apify, insanların genellikle daha basit seçenekleri denedikten sonra geçiş yaptığı türden bir platformdur. Size zaman kazandırır, ancak gerektiğinde ince ayar yapmanıza da olanak tanır.

- Yaygın kazıma işleri için kullanıma hazır "aktörler" (actors) sunar

- Her şey bulutta çalışır, sunucu yönetimi gerekmez

- İş yükünüz arttığında ölçeklendirmesi kolaydır

- Paylaşılan araçlar ve şablonlarla güçlü bir ekosisteme sahiptir

Ne aşırı karmaşıktır ne de tamamen "tak-çalıştır"dır; çoğu ekip için ideal olan o tatlı noktadadır.

6. Playwright

Playwright daha çok geliştiricilere yönelik bir araçtır ve bunu hissettirir. Modern web siteleriyle sorunsuz çalıştığı için çok yaygın kullanılır.

- Chromium, Firefox ve WebKit desteği

- Dinamik sayfalar ve ağır JavaScript'lerle harika başa çıkar

- Uzun soluklu otomasyonlar için yeterince stabildir

- Davranışları özelleştirmek istediğinizde çok esnektir

Özel web kazıma kurulumlarının çoğu arka planda bu tarz bir mimari kullanır.

7. Octoparse

Octoparse, hiç kodla uğraşmak istemeyen kullanıcıların ilk başvurduğu ücretsiz web kazıma araçları alternatiflerinden biridir.

- Çoğunlukla "işaretle ve tıkla" mantığına dayalı görsel arayüz

- Temel web sitesi kazıma görevleri için hızlı başlangıç

- Küçük projeler veya tek seferlik işler için idealdir

- Popüler siteler için hazır şablonlar içerir

Başlangıçta oldukça pratiktir ancak işler karmaşıklaştığında veya hacim arttığında kısıtlayıcı gelebilir.

Hızlı Karşılaştırma Tablosu

Geldiğimiz bu noktada, her şeyi kusursuz yapan tek bir aracın olmadığı oldukça açık. Bazılarının kullanımı daha kolay, bazıları daha fazla kontrol veriyor, bazıları ise tamamen ölçeklendirme için tasarlanmış.

İşleri karmaşıklaştırmak yerine onları yan yana koyup incelemek çok daha faydalıdır; özellikle web kazıma için en iyi anti-detect tarayıcıları kıyaslarken. Aşağıdaki tablo, her bir aracın nerede konumlandığını ve tipik olarak ne için kullanıldığını hızlıca gösteriyor.

|

Araç |

Tür |

En Uygun Olduğu Alan |

Güçlü Yönü |

|

AdsPower |

Kazıma Tarayıcısı |

Anti-tespit & Ölçeklendirme |

Parmak izi izolasyonu |

|

Scrapingdog |

API |

Basit veri çekme görevleri |

Kullanım kolaylığı |

|

ScraperAPI |

API |

Büyük ölçekli veri boru hatları |

Güvenilirlik |

|

Bright Data |

API / Proxy Ağı |

Kurumsal seviyede kazıma |

Kapsam genişliği |

|

Apify |

Platform |

Otomasyon + Kazıma |

Esneklik |

|

Playwright |

Framework |

Özel çözümler |

Kontrol |

|

Octoparse |

Kodsuz (No-code) |

Yeni başlayanlar |

Basitlik |

AdsPower'ın sizin için doğru seçim olduğundan hâlâ emin değil misiniz?

İhtiyaçlarınıza özel anında yanıtlar almak için önde gelen yapay zeka araçlarına sorun.

Son Düşünceler

Şu ana kadar, 2026'da web kazımanın sadece tek bir mükemmel araç bulup işi bitirmek olmadığını net bir şekilde görmüşsünüzdür. Gerçekte işe yarayan şey, sürecin farklı bölümlerini yöneten araçların birleşimidir. Bir katman otomasyonla ilgilenirken, diğeri proxy'ler ve isteklerle, bir başkası ise oturum ve kimlik yönetimiyle ilgilenir. Yaygın bir sistem genellikle tarayıcıyı kontrol etmek için Playwright, altyapıyı yönetmek için ScraperAPI veya Bright Data gibi bir API ve parmak izlerini yönetip oturumları tutarlı tutmak için AdsPower gibi bir araç içerir. Bunlardan hiçbiri diğerinin yerini almaz; tam tersine birlikte kusursuz çalışırlar.

Unutmamanız gereken tek bir şey varsa o da tespit edilmeden kalmanın hızdan çok daha önemli olduğudur. Yarı yolda engellenecekseniz daha fazla istek göndermenin hiçbir faydası yoktur. Daha yavaş ama daha stabil bir sistem, agresif bir sistemi neredeyse her zaman alt edecektir. Tutarlılığa odaklanın, zamanla ölçeklendirme çok daha kolay hale gelecektir.

Sıkça Sorulan Sorular (SSS)

Web kazıma iş akışlarında CAPTCHA nasıl yönetilir?

Büyük ölçekte CAPTCHA'lar kaçınılmazdır, bu yüzden amaç onları tamamen ortadan kaldırmak yerine yönetmek olmalıdır. Çoğu sistem, istek hızlarını yavaşlatarak, oturumları yeniden kullanarak ve gerçek kullanıcı davranışlarını taklit ederek CAPTCHA tetikleyicilerini azaltır. Buna ek olarak, pek çok ekip manuel müdahale olmadan iş akışlarını sürdürmek için CAPTCHA çözme hizmetleri entegre eder. Uygulamada işin sırrı tek bir çözüme bel bağlamak yerine proxy'ler, zamanlama ve davranış gibi tekniklerin bir karışımını kullanarak sistemi stabil tutmaktır.

Büyük hacimlerde neden daha sık CAPTCHA çıkar?

Kazıma hacmi arttığında, desenlerin web siteleri tarafından algılanması kolaylaşır. Tekrarlanan eylemler, tamamen aynı istekler veya doğal olmayan zamanlamalar hızla şüphe çeker. CAPTCHA'lar trafiğin insan olup olmadığını doğrulamak için kullanılır; bu nedenle davranışınız ne kadar "bot gibi" görünürse, o kadar sık karşınıza çıkarlar. İşte bu yüzden ölçeklendirme sadece daha fazla istek göndermek değil, bu istekleri daha az öngörülebilir ve gerçek kullanıcılara daha çok benzer hale getirmektir.

Web kazıma sisteminiz neden parmak izi korumasına ihtiyaç duyar?

Artık yalnızca proxy kullanmak yeterli değildir. Web siteleri botları tespit etmek için tarayıcı parmak izlerini (browser fingerprints), cihaz ayarlarını ve davranış kalıplarını analiz eder. Parmak izi koruması olmadan, dönen (rotating) IP'ler kullansanız bile siteler sizi kolaylıkla yakalar. Parmak izi araçları, izole tarayıcı ortamları oluşturarak her oturumun daha gerçekçi ve tutarlı görünmesini sağlar. Bu durum engellemeleri azaltır ve özellikle yüksek hacimlerde web sitesi kazıma iş akışlarının sorunsuz çalışmasını destekler.

İnsanlar Ayrıca Okuyun

- 2026'nın En İyi Ajan Tarayıcıları (Agentic Browsers): Özellikler, Fiyatlandırma ve Karşılaştırma

2026'nın En İyi Ajan Tarayıcıları (Agentic Browsers): Özellikler, Fiyatlandırma ve Karşılaştırma

Otomasyon iş akışlarınız için en iyi ajan tarayıcıyı ararken, başlamadan önce bu yapay zeka (AI) destekli ajan tarayıcı incelemesine göz atın ve test edin.

- 2026 Yılında Web Kazıma İçin En İyi Antidetect Tarayıcı

2026 Yılında Web Kazıma İçin En İyi Antidetect Tarayıcı

2026'da web kazıma için en iyi tespit edilmeyen tarayıcıları bulun. En iyi araçları, temel özellikleri karşılaştırın ve tespit edilmekten nasıl kaçınacağınızı ve kazıma işlemlerinizi nasıl ölçeklendireceğinizi öğrenin.

- Yapay Zeka Ajan Tarayıcı vs Geleneksel Tarayıcı Otomasyonu: Hangisini Kullanmalısınız?

Yapay Zeka Ajan Tarayıcı vs Geleneksel Tarayıcı Otomasyonu: Hangisini Kullanmalısınız?

Yapay zeka ajan tarayıcıları ve geleneksel otomasyon: Özellikleri, kullanım senaryolarını ve ölçeklenebilirliği karşılaştırın. Hangisini ne zaman kullanacağınızı ve daha akıllı iş akışlarını nasıl kuracağınızı öğrenin.

- 2026'nın En İyi 9 Yapay Zeka Ajanı ve Güvenli Otomasyon Rehberi

2026'nın En İyi 9 Yapay Zeka Ajanı ve Güvenli Otomasyon Rehberi

2026'nın en iyi 9 yapay zeka ajanını keşfedin ve AdsPower ile hesap yasaklarına takılmadan güvenli otomasyon yapmanın yollarını öğrenin.

- AdsPower Güvenilir mi? Nihai Güvenlik ve Güvenilirlik İncelemesi (2026)

AdsPower Güvenilir mi? Nihai Güvenlik ve Güvenilirlik İncelemesi (2026)

AdsPower güvenilir mi ve çoklu hesap yönetimi için uygun mu? Bu uzman incelemesinde güvenliğini, otomasyonunu ve güvenilirliğini keşfedin.