Meilleur navigateur antidétection pour le web scraping en 2026

Jetez un coup d'oeil rapide

Découvrez les meilleurs navigateurs antidétection pour le web scraping en 2026, améliorez la stabilité, évitez la détection et optimisez votre flux de travail — lisez la suite pour trouver l’outil idéal pour votre workflow dès aujourd’hui.

C’est là qu’interviennent les navigateurs antidétection. Au lieu de corriger constamment les problèmes de détection après leur apparition, ils vous permettent de démarrer avec une configuration plus réaliste, utilisant des identités distinctes, des sessions stables et un comportement plus proche de celui des utilisateurs réels. Dans ce guide, nous détaillerons leur fonctionnement et les outils qui méritent d’être pris en compte en 2026.

Pourquoi le web scraping moderne nécessite un navigateur antidétecteur

Ce qui a vraiment changé dans le domaine du web scraping, ce ne sont pas les outils utilisés, mais la façon dont les sites web réagissent.

La plupart des plateformes combinent désormais plusieurs niveaux de détection simultanément. Au lieu de se contenter de vérifier les requêtes, elles analysent le contexte global de votre activité, notamment :

- Informations sur l'empreinte du navigateur, telles que le canevas, WebGL, les polices et les spécifications de l'appareil

- Signaux comportementaux tels que les mouvements de la souris et les schémas de défilement

- Réputation de l'adresse IP et fréquence des requêtes

- Continuité de session, y compris les cookies et la cohérence des en-têtes

Le problème, c'est que tout doit être parfaitement synchronisé. Vous pouvez envoyer des requêtes parfaitement valides, mais si quelque chose cloche dans votre configuration, cela se remarque. Une simple incohérence entre votre agent utilisateur et votre empreinte WebGL peut déjà déclencher des alertes. Si cela se produit lors de requêtes répétées depuis la même adresse IP, les blocages sont généralement très rapides.

C’est là que les navigateurs anti-détection font la différence. Ils réduisent ces incohérences en vous offrant un meilleur contrôle de votre environnement :

- Chaque profil de navigateur fonctionne avec sa propre empreinte digitale.

- Les sessions restent cohérentes entre les cookies, le stockage et les en-têtes.

- La configuration globale se comporte davantage comme un environnement utilisateur réel.

Au final, l'objectif est simple : au lieu de ressembler à un script s'exécutant en arrière-plan, votre configuration se fond dans l'activité normale d'un utilisateur, ce qui permet précisément d'assurer la continuité des processus de web scraping sur le long terme.

Qu'est-ce qu'un navigateur antidétecteur pour le web scraping ?

Un navigateur antidétection est un navigateur qui vous permet d'exécuter plusieurs profils isolés, chacun avec sa propre empreinte digitale et ses données de session, de sorte que votre activité semble provenir de différents utilisateurs réels.

En quoi diffère-t-il des navigateurs standards ?

Un navigateur classique n'est pas conçu pour la séparation des identités. Même si vous changez de compte ou effacez les cookies, de nombreux signaux sous-jacents restent inchangés, ce qui facilite la connexion des sessions par les sites web.

- Partage une empreinte digitale cohérente entre les onglets et les sessions

- Contrôle limité sur les éléments d'empreinte digitale tels que WebGL, les polices ou les spécifications du périphérique

- Les cookies et le stockage peuvent être réinitialisés, mais les identifiants plus profonds demeurent.

- Non conçu pour gérer plusieurs identités indépendantes à grande échelle

Un navigateur anti-détection change cela en isolant tout au niveau du profil, donnant l'impression que chaque session est indépendante.

En quoi cela diffère-t-il des outils de raclage sans tête ?

Les outils headless privilégient l'automatisation et la rapidité, plutôt que la fidélité de l'environnement du navigateur. Ils sont puissants, mais par défaut, ils peuvent laisser des traces détectables.

- Optimisé pour les flux de travail automatisés et les scripts

- Plus rapide et plus léger pour les travaux de raclage à grande échelle

- Plus facile à détecter sans configuration furtive supplémentaire

- Contrôle intégré limité sur les empreintes digitales réalistes du navigateur

Les navigateurs antidétecteurs s'attaquent à l'autre aspect du problème, en rendant les environnements plus cohérents et plus difficiles à relier entre eux.

C'est pourquoi, dans de nombreuses configurations réelles, ils sont utilisés conjointement. L'un gère l'automatisation, l'autre l'identité et la discrétion.

Fonctionnalités clés d'un navigateur de web scraping

Tous les navigateurs antidétection ne sont pas adaptés au web scraping. Certains sont davantage conçus pour la gestion de comptes, d'autres pour les processus marketing. Si votre objectif principal est le web scraping, certaines fonctionnalités sont plus importantes que d'autres.

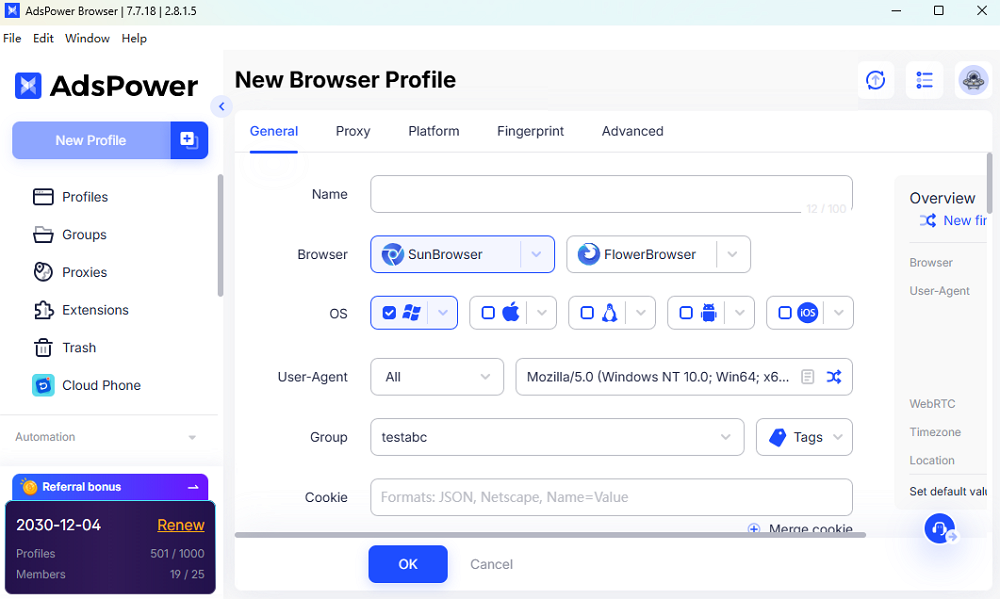

- Un système de contrôle par empreintes digitales qui a du sens.

Vous ne voulez pas de simples empreintes digitales aléatoires. Vous voulez des combinaisons réalistes. Cela implique de faire correspondre l'agent utilisateur avec le système d'exploitation, le GPU, les polices, le fuseau horaire et même les paramètres de langue.

- Isolation du profil propre

Chaque profil doit se comporter comme un utilisateur totalement distinct. Aucun cookie partagé, aucun chevauchement de stockage, aucune fuite de données entre les sessions.

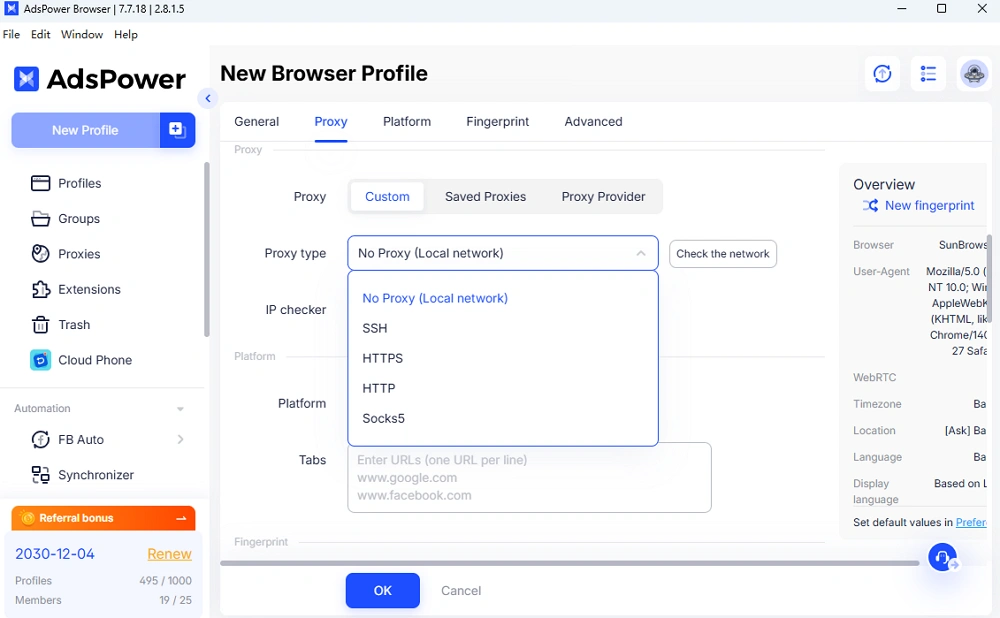

- Prise en charge des proxys (et flexibilité)

Vous aurez au minimum besoin de la prise en charge des proxys HTTP, HTTPS et SOCKS5. Idéalement, vous devriez pouvoir attribuer des proxys par profil et les faire tourner facilement.

- Compatibilité avec l'automatisation

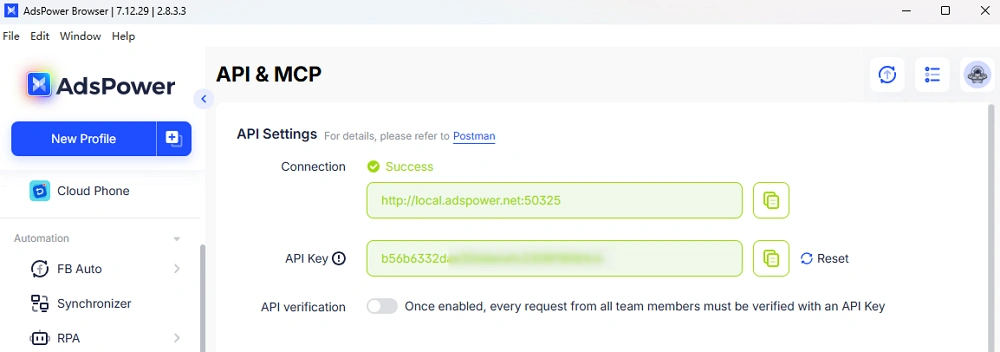

Un bon navigateur de scraping doit fonctionner avec des outils d'automatisation, soit via des API, soit par intégration directe avec des frameworks comme Puppeteer ou Playwright.

- Stabilité lors de la mise à l'échelle

Gérer quelques profils, c'est facile. Mais en gérer des dizaines, voire des centaines, sans plantages ni problèmes de mémoire, c'est là que les choses se compliquent.

- persistance de session

La possibilité de sauvegarder et de réutiliser les sessions est très importante, notamment pour les sites qui nécessitent une connexion ou une interaction à long terme.

Si un outil ne possède pas deux ou trois de ces éléments, vous le ressentirez probablement une fois que vous tenterez de l'utiliser à plus grande échelle.

Meilleurs navigateurs antidétection pour le web scraping (Sélection 2026)

Il n'existe pas d'outil « idéal » qui convienne à tous. Tout dépend de votre méthode d'extraction de données et de vos besoins en termes de volume. Cependant, certains noms reviennent régulièrement, et ce n'est pas sans raison.

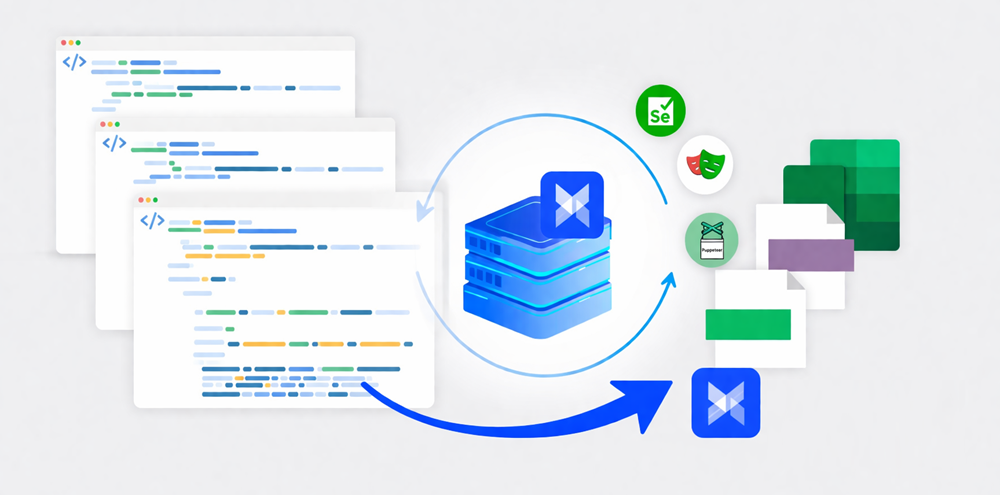

Navigateur AdsPower

AdsPower se situe dans la meilleure fourchette en termes de facilité d'utilisation, de cohérence des profils et de flexibilité.

Ce qui le rend idéal pour le web scraping, c'est qu'il ne vous oblige pas à choisir entre les flux de travail basés sur une interface utilisateur et l'automatisation. Vous pouvez concevoir visuellement, tester, puis passer à l'automatisation ultérieurement.

- Gestion robuste des empreintes digitales avec plus de 50 paramètres

- Configuration facile du proxy par profil

- Prise en charge des API pour l'automatisation

- Inclut le mode sans interface graphique, utile pour la mise à l'échelle sans exécuter d'instances de navigateur complètes.

Ce dernier point mérite d'être souligné. Peu de navigateurs antidétection offrent des fonctionnalités sans interface graphique tout en préservant la cohérence de l'empreinte numérique.

Pour les projets de web scraping qui nécessitent à la fois contrôle et évolutivité, AdsPower est un choix plutôt pratique.

Incogniton

Incogniton est plus simple. Il ne cherche pas à en faire trop, ce qui est un avantage si vous avez juste besoin de quelque chose de facile à configurer.

- Interface simple

- Isolation fiable des profils

- Convient parfaitement aux configurations de petite et moyenne taille.

Il n'a peut-être pas la même profondeur que des outils plus avancés, mais il fait le travail sans trop de difficultés.

Se connecter

GoLogin privilégie les flux de travail basés sur le cloud.

Si vous exécutez des sessions longues ou gérez des identités sur la durée, il assure une stabilité satisfaisante.

- stockage de profils dans le cloud

- Génération d'empreintes digitales cohérente

- Fonctionne sur différentes machines

Pour les tâches de récupération de données où l'historique des sessions est important, cette cohérence peut s'avérer utile.

Connexion multiple

L'authentification multiple est généralement considérée comme une option plus avancée. Son coût est plus élevé que celui de certaines alternatives et elle est généralement utilisée par les équipes gérant des opérations de grande envergure.

- Offre un navigateur web

- Gère un grand nombre de profils de navigateurs avec des performances constantes.

- Il s'agit d'un navigateur antidétecteur établi de longue date

Si vous souhaitez gérer votre environnement de compte sur le web, vous pourriez envisager le navigateur Multilogin.

Navigateurs sans interface graphique (Marionnettiste / Dramaturge)

Même s'il ne s'agit pas de navigateurs antidétection, des outils comme Puppeteer et Playwright restent un élément essentiel de la plupart des configurations de web scraping.

- Rapide et efficace

- Hautement personnalisable

- Idéal pour l'extraction de données à grande échelle

L'inconvénient est évident : prises isolément, elles sont plus faciles à détecter. Sans traitement supplémentaire, elles ne résolvent pas les problèmes liés aux empreintes digitales.

C’est pourquoi de nombreuses configurations les combinent avec des navigateurs antidétecteurs au lieu d’en choisir un plutôt que l’autre.

Vous n'êtes toujours pas sûr qu'AdsPower soit fait pour vous ?

Demandez aux meilleurs outils d'IA pour obtenir des réponses personnalisées instantanées à vos besoins.

Navigateur Antidetect vs navigateur sans interface graphique pour le scraping

Si vous avez déjà travaillé avec les deux, vous savez qu'ils résolvent des problèmes différents.

Les navigateurs antidétecteurs sont axés sur l'identité, tandis que les navigateurs sans interface graphique sont axés sur l'automatisation.

Navigateur Antidetect :

- Meilleur pour éviter d'être détecté

- Plus lent et plus lourd

- Il est plus facile de maintenir de longues sessions.

Navigateur sans interface graphique :

- Plus rapide et plus évolutif

- Nécessite un travail supplémentaire pour la discrétion

- Meilleur pour l'extraction de données brutes

En pratique, on utilise rarement un seul appareil. Une configuration courante ressemble à ceci :

--Utilisez le navigateur antidétecteur pour créer et maintenir des sessions

Utilisez des outils sans interface graphique pour extraire les données une fois les sessions stabilisées.

Cette combinaison s'avère généralement plus fiable que de tenter de faire faire tout un outil à un seul.

AdsPower + Agents IA : L’avenir du web scraping

Une chose qui commence à changer en 2026, c'est la façon dont les flux de travail de récupération de données sont construits.

Au lieu de scripts rigides, de plus en plus d'équipes expérimentent des agents d'IA capables de naviguer sur les sites web avec plus de souplesse. Ils ne dépendent plus uniquement de sélecteurs fixes ni de flux rigides.

Combiné à AdsPower, cela devient plus intéressant :

- Chaque agent s'exécute dans son propre profil de navigateur.

- Les empreintes digitales restent constantes

- Le comportement paraît moins artificiel et plus naturel.

Cela réduit la maintenance. Lorsqu'une modification de la structure d'un site est apportée, il n'est pas toujours nécessaire de tout réécrire.

Le secteur est encore en pleine évolution, mais la tendance est assez claire : le web scraping évolue vers des systèmes adaptatifs, et non plus seulement exécutants.

Comment utiliser un navigateur antidétecteur pour le web scraping

Une configuration classique n'a pas besoin d'être compliquée. Suivez les étapes pour configurer un système de web scraping sécurisé.

● Créer plusieurs profils de navigateur

Configurez la plateforme et attribuez-lui différentes empreintes digitales. Si vous ne savez pas comment procéder, vous pouvez conserver les paramètres par défaut ou nous contacter.

● Configurer des proxys

Les proxys résidentiels ou mobiles fonctionnent généralement mieux.

● Connectez-vous si nécessaire

Enregistrez vos sessions pour éviter de répéter les mêmes actions.

● Connecter l'automatisation

Utilisez une API ou des outils externes comme Puppeteer.

● Augmentez progressivement la taille

Ne passez pas de 1 à 100 séances du jour au lendemain.

● Suivre les résultats

Soyez attentif aux blocages, aux erreurs ou aux schémas inhabituels.

La plupart des problèmes proviennent d'une mise à l'échelle trop rapide, et non de l'outil lui-même.

Conclusion

Le web scraping en 2026 est radicalement différent d'il y a quelques années. Il ne s'agit plus seulement de collecter des données efficacement, mais aussi de maintenir des sessions stables et fiables dans le temps. C'est précisément pour cette raison que les navigateurs antidétection sont devenus plus courants dans les flux de travail réels. Ils ne résolvent pas miraculeusement tous les problèmes, mais ils réduisent considérablement les frictions liées aux incohérences d'empreintes digitales, aux réinitialisations de session et aux blocages répétés. Associés à des proxys et à des outils d'automatisation, ils rendent les configurations de scraping plus robustes et facilitent leur mise à l'échelle progressive.

Les navigateurs antidétecteurs sont devenus un outil pratique pour garantir cette stabilité, notamment lorsqu'ils sont associés à des proxys et à l'automatisation. Parallèlement, les solutions headless restent précieuses pour les tâches à haut volume où l'efficacité est primordiale. Plutôt que de s'appuyer sur une seule approche, combiner les deux stratégies donne souvent de meilleurs résultats. Concevoir un système de scraping aujourd'hui, c'est aller au-delà des simples scripts : il s'agit de gérer des environnements capables de fonctionner de manière fluide, d'évoluer progressivement et de rester discrets.

FAQ

Un navigateur antidétection est-il nécessaire pour le web scraping ?

Pas toujours. Pour l'extraction de données à petite échelle ou publiques, on peut souvent s'en passer. Mais dès qu'il s'agit de comptes, de sessions répétées ou de volumes plus importants, il devient beaucoup plus difficile d'éviter les blocages sans une forme de gestion des identités.

Quel est le meilleur navigateur pour le scraping ?

Il n'existe pas de solution universelle, mais AdsPower se distingue comme un excellent choix pour de nombreux utilisateurs. Combinant isolation des empreintes digitales, gestion flexible des proxys et fonctionnalités d'automatisation, il est parfaitement adapté aux flux de travail de web scraping évolutifs et stables.

Puis-je utiliser un navigateur sans interface graphique seul ?

Oui, mais cela a ses limites. Les navigateurs sans interface graphique sont rapides et flexibles, mais plus faciles à détecter sans configuration supplémentaire. Pour des résultats plus stables, on les combine souvent avec des navigateurs antidétection et une configuration de proxy appropriée. De plus, certains navigateurs, comme AdsPower, proposent également un mode sans interface graphique pour le web scraping.

Les gens lisent aussi

- Explication du polygraphe du navigateur : pourquoi AdsPower passe les systèmes de détection modernes

Explication du polygraphe du navigateur : pourquoi AdsPower passe les systèmes de détection modernes

Découvrez comment l'étude IMC '24 menée par ASU et Amazon confirme la cohérence d'AdsPower au niveau du noyau. Apprenez pourquoi AdsPower était le seul navigateur à…

- Meilleurs navigateurs Agentic en 2026 : fonctionnalités, prix et comparaison

Meilleurs navigateurs Agentic en 2026 : fonctionnalités, prix et comparaison

Lorsque vous recherchez le meilleur navigateur agentique pour l'automatisation des flux de travail, consultez cet avis sur les navigateurs IA agentiques et testez-les avant de commencer.

- Les meilleurs outils de web scraping pour 2026 : un guide pour l’extraction de données à grande échelle

Les meilleurs outils de web scraping pour 2026 : un guide pour l’extraction de données à grande échelle

Découvrez les meilleurs outils de web scraping pour 2026, y compris les API, les navigateurs et les outils d'IA, ainsi que des conseils pour étendre l'extraction de données sans être bloqué.

- Navigateur IA ou automatisation de navigateur traditionnelle : lequel choisir ?

Navigateur IA ou automatisation de navigateur traditionnelle : lequel choisir ?

Navigateur automatisé IA vs automatisation traditionnelle : comparez les fonctionnalités, les cas d’utilisation et l’évolutivité. Découvrez quand utiliser l’un ou l’autre et comment créer des flux de travail plus intelligents.

- Les 9 meilleurs agents d'IA en 2026 et comment automatiser vos processus en toute sécurité

Les 9 meilleurs agents d'IA en 2026 et comment automatiser vos processus en toute sécurité

Découvrez les 9 meilleurs agents IA de 2026 et apprenez à automatiser vos campagnes en toute sécurité avec AdsPower. Comparez les outils, les cas d'utilisation et développez votre activité sans risque de suspension de compte.