Les meilleurs outils de web scraping pour 2026 : un guide pour l’extraction de données à grande échelle

Jetez un coup d'oeil rapide

L'extraction de données web à grande échelle peut entraîner des blocages, des CAPTCHA et une instabilité. Pour réussir, il est essentiel de gérer les empreintes numériques, les sessions et l'infrastructure à l'aide d'une combinaison d'outils adaptés, afin de garantir une extraction de données fiable et indétectable. Suivez-nous pour essayer !

Si vous n'avez extrait des données que de quelques pages auparavant, cela peut paraître étonnamment facile. Un simple script, éventuellement un proxy, et les données arrivent sans trop de difficultés. Pour les petites tâches, tout se déroule généralement assez bien pour que cela semble presque naturel. Mais cette impression de contrôle disparaît dès que l'on traite des volumes plus importants.

Dès qu'on passe au web scraping à grande échelle, tout devient moins prévisible. Les requêtes sont bloquées, les sessions ne tiennent pas et la gestion des CAPTCHA devient rapidement un enjeu crucial. Ce qui fonctionnait bien avec de petits lots commence à ralentir, voire à dysfonctionner complètement. À ce stade, le web scraping ne se limite plus à l'extraction de code HTML ; il s'agit de gérer les identités, les pages dynamiques et de maintenir la stabilité du système sous forte charge. Ce guide explique ce qui résiste réellement dans ces conditions et pourquoi tant de configurations échouent avant d'atteindre ce niveau.

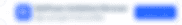

Pourquoi la plupart des outils de web scraping échouent à grande échelle

La plus grande erreur en matière de web scraping est de croire que le succès à petite échelle garantit la fiabilité à grande échelle. Ce n'est pas le cas.

Voici où les choses se cassent généralement :

- Le blocage des adresses IP s'intensifie rapidement

Quelques requêtes par minute ? Pas de problème. Des milliers par heure ? Vous serez rapidement repéré.

- La détection d'empreintes digitales ne se limite pas aux adresses IP.

Les sites web modernes ne se contentent pas de suivre votre adresse IP, ils analysent également les empreintes digitales de votre navigateur, vos habitudes de navigation et la cohérence de votre session.

- Le contenu dynamique complique tout.

Les sites web utilisant beaucoup de JavaScript nécessitent un rendu complet par le navigateur. Les simples requêtes HTTP ne suffisent plus.

- Les CAPTCHA perturbent les processus.

À grande échelle, les défis CAPTCHA ne sont pas occasionnels, ils sont constants.

- La maintenance devient un emploi à temps plein

Les modifications de mise en page, les mises à jour anti-bots et les limitations de débit imposent des ajustements constants.

En résumé, le web scraping à grande échelle n'est pas qu'un problème de programmation. C'est un problème d'infrastructure et de dissimulation.

Types d'outils de web scraping

Le choix de l'outil adapté dépend de vos compétences techniques, des volumes de production requis et de votre tolérance à la maintenance. Examinons les principales catégories.

1. Cadres basés sur le code

C'est en gros la voie du « fait maison ». Si vous avez déjà construit un grattoir de A à Z, c'est probablement par là que vous avez commencé. Cela vous donne un contrôle total, mais signifie aussi que vous êtes responsable de tout.

Idéal pour :

- Les développeurs qui veulent contrôler chaque détail

- Des projets qui ne correspondent pas aux outils prêts à l'emploi

- Logique de récupération plus complexe

Avantages :

- Vous pouvez personnaliser à peu près tout.

- Facile à intégrer à vos propres systèmes

- Contrôle total sur la manière dont les données sont collectées et traitées

Inconvénients :

- Nécessite du codage (évidemment).

- L'entretien peut devenir compliqué avec le temps.

- Vous aurez probablement besoin d'outils supplémentaires pour les proxys, les CAPTCHA, etc.

2. Scrapers sans code / visuels (Idéal pour les débutants)

Ces outils privilégient la rapidité et la simplicité. Nul besoin d'écrire de code : il suffit de cliquer et de définir les données à extraire.

Idéal pour :

- Les personnes sans formation technique

- tâches de scraping petites ou rapides

- Tester rapidement les idées

Avantages :

- Facile à ramasser

- Rapide à faire fonctionner quelque chose

- Aucun codage nécessaire

Inconvénients :

- Peu flexible

- Se casse facilement sur les sites complexes ou dynamiques

- Ne s'adapte pas bien à grande échelle

3. Utilisation des API de scraping (Idéal pour une mise à l'échelle sans maintenance)

Les API de web scraping prennent en charge la majeure partie du travail complexe. Vous envoyez une requête, et elles gèrent les proxys, les nouvelles tentatives et parfois même le rendu en arrière-plan. Pour comprendre comment cela fonctionne concrètement, notamment à grande échelle, il est judicieux d'étudier comment utiliser des proxys pour le web scraping sans risquer d'être bloqué.

Idéal pour :

- Les équipes qui ne souhaitent pas gérer l'infrastructure

- Décapage à haut volume

- Déploiement plus rapide

Avantages :

- La rotation des adresses IP est gérée automatiquement.

- Logique de nouvelle tentative intégrée

- Souvent compatible avec les navigateurs sans interface graphique

Inconvénients :

- Les coûts peuvent s'accumuler.

- Moins de contrôle sur le processus

- Vous êtes lié à un service tiers

4. Outils d'extraction de données Web par IA (Tendance émergente)

Il s'agit d'une approche plus récente. Au lieu d'écrire des sélecteurs, vous décrivez simplement les données dont vous avez besoin, et l'outil tente de les déterminer.

Idéal pour :

- Expériences rapides

- Agencements désordonnés ou changeant fréquemment

- Gain de temps lors de la configuration

Avantages :

- Peut s'adapter aux changements de structure des pages

- Moins de réglages manuels

- Démarrage plus rapide

Inconvénients :

- Pas toujours précis

- En constante évolution

- Peut rencontrer des difficultés avec les systèmes anti-robots

5. Extraction de données des navigateurs

C’est là que les choses commencent à paraître plus « concrètes ». Au lieu de simplement envoyer des requêtes, ces outils tentent de se comporter comme de véritables utilisateurs.

Ils gèrent les empreintes digitales, les cookies, les sessions, bref, tout ce qu'un navigateur normal gère.

Idéal pour :

- Éviter d'être détecté

- Gestion de plusieurs comptes

- Extraction de données de plateformes protégées

Avantages :

- Se comporte davantage comme un véritable utilisateur

- Assure la cohérence des séances

- Contribue à réduire les blocages et les bannissements

Inconvénients :

- Il faut du temps pour bien le configurer

- Généralement utilisé avec d'autres outils

Les meilleurs outils de web scraping à utiliser

Tous les outils de scraping ne sont pas performants lorsqu'on traite des volumes importants. Certains semblent prometteurs sur le papier, mais s'avèrent inefficaces sous pression. Ceux présentés ci-dessous sont des outils fiables, utilisés pour des opérations continues et à grande échelle.

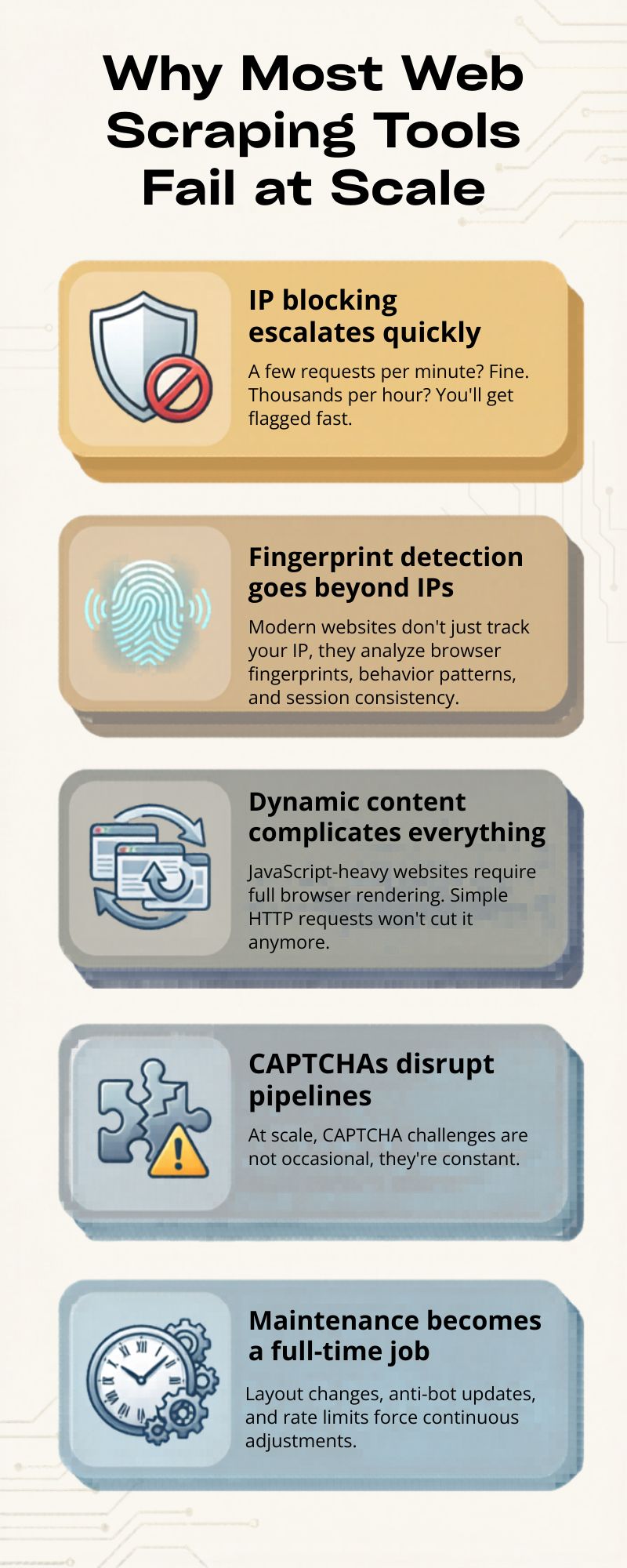

1. AdsPower

Lorsque vous collectez des données sur des plateformes dotées de systèmes anti-bots performants, des outils comme AdsPower deviennent quasiment indispensables.

Ce n'est pas un simple navigateur au sens habituel du terme ; il est conçu pour simuler de véritables environnements utilisateurs, ce qui fait une grande différence lorsqu'on essaie de passer inaperçu.

Points clés à retenir :

- Chaque profil possède sa propre empreinte digitale isolée

- Les profils se comportent comme des périphériques physiques distincts.

- Prend en charge l'automatisation robotisée des processus (RPA) pour l'automatisation des flux de travail.

- Peut intégrer des solveurs CAPTCHA

- Assure la stabilité des sessions grâce aux cookies et au stockage local.

À des volumes de données plus importants, cette approche s'avère généralement plus efficace qu'une simple augmentation de la vitesse des requêtes. Il ne s'agit pas de forcer le passage, mais de s'intégrer discrètement. Pour l'extraction de données en e-commerce, sur les réseaux sociaux ou les places de marché, cela se traduit souvent par moins de bannissements et une interruption de service réduite.

2. Chien grattant

Scrapingdog mise sur la simplicité, et c'est précisément pour cette raison que certaines équipes le préfèrent.

Ses points forts :

- Gère les proxys et le rendu en arrière-plan.

- Fonctionne de manière fiable pour l'extraction de données structurées

- API propre et simple

Si vous ne souhaitez pas vous occuper de la mise en place de l'infrastructure et que vous avez simplement besoin de quelque chose qui fonctionne, c'est une option raisonnable.

3. API Scraper

ScraperAPI privilégie avant tout la stabilité.

Caractéristiques principales :

- Rotation automatique de l'IP

- Gestion intégrée des CAPTCHA

- Conçu pour des taux de réussite élevés à grande échelle

Il convient parfaitement aux tâches de web scraping continues où la cohérence prime sur la personnalisation.

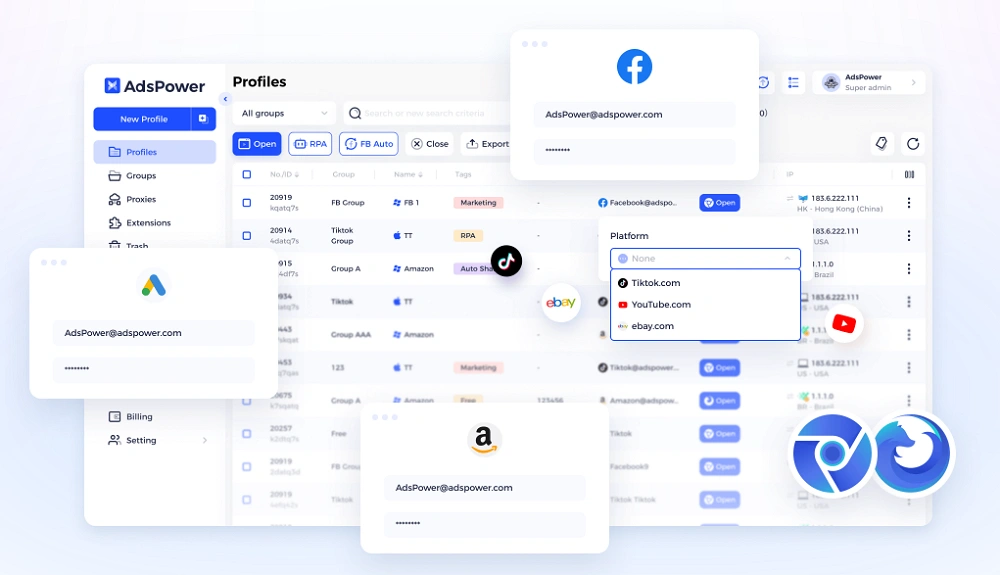

4. Données brillantes

Bright Data se situe dans la partie la plus avancée du spectre.

Ce que vous obtenez :

- Vaste réseau de proxys (résidentiel, mobile, centre de données)

- Options de ciblage précis

- Services de collecte de données supplémentaires

Sa mise en place n'est pas des plus simples, et son prix en témoigne. Mais pour les grandes structures, il offre un niveau de couverture difficilement égalable.

5. Apify

Apify est le genre d'outil vers lequel on se tourne souvent après avoir essayé des solutions plus simples. Il permet de gagner du temps tout en offrant la possibilité d'effectuer des réglages précis au besoin.

- Il dispose d'« acteurs » prêts à l'emploi pour les tâches de scraping courantes.

- Tout fonctionne dans le cloud, vous n'avez donc pas à gérer de serveurs.

- Facile à adapter à l'augmentation de votre charge de travail

- Un écosystème correct avec des outils et des modèles partagés.

Ce n'est pas excessivement complexe, mais ce n'est pas non plus totalement prêt à l'emploi ; c'est un juste milieu qui convient bien à de nombreuses équipes.

6. Dramaturge

Playwright est avant tout un outil de développement, et cela se voit. Il est largement utilisé car il fonctionne de manière fiable avec les sites web modernes.

- Compatible avec Chromium, Firefox et WebKit

- Gère très bien les pages dynamiques et le JavaScript lourd.

- Suffisamment stable pour une automatisation de longue durée

- Flexible si vous devez personnaliser le comportement

La plupart des systèmes de raclage personnalisés finissent par utiliser quelque chose comme ça sous le capot.

7. Octoparse

Octoparse est généralement le premier réflexe des personnes qui ne souhaitent absolument pas manipuler de code.

- Interface visuelle, principalement de type pointer-cliquer

- Prise en main rapide des tâches de base en matière de scraping

- Idéal pour les petits projets ou les travaux ponctuels

- Comprend des modèles pour les sites courants

C'est pratique au début, mais dès que les choses se complexifient ou que le volume augmente, cela peut devenir limitant.

Tableau comparatif rapide

À ce stade, il est clair qu'aucun outil n'est parfait en tout. Certains sont plus faciles à utiliser, d'autres offrent plus de contrôle, et d'autres encore sont conçus spécifiquement pour la mise à l'échelle.

Plutôt que de trop réfléchir, il est utile de les comparer côte à côte, notamment lorsqu'on compare des outils comme le meilleur navigateur anti-détection pour le web scraping . Le tableau ci-dessous donne un aperçu rapide de la place de chacun et de son utilisation typique.

Outil | Taper | Idéal pour | Force |

AdsPower | Navigateur de scraping | Antidétection et mise à l'échelle | Isolation des empreintes digitales |

Chien racleur | API | tâches de scraping simples | Facilité d'utilisation |

API Scraper | API | pipelines à grande échelle | Fiabilité |

Données claires | Réseau API/Proxy | Exploitation de données d'entreprise | Couverture |

Apify | Plate-forme | Automatisation et extraction de données | Flexibilité |

Dramaturge | Cadre | Solutions personnalisées | Contrôle |

Octoparse | Sans code | Débutants | Simplicité |

Réflexions finales

Il est désormais évident qu'en 2026, le web scraping ne se résume pas à trouver l'outil parfait et à s'en contenter. En pratique, la solution efficace repose sur une combinaison d'outils, chacun prenant en charge une étape différente du processus. Une couche peut gérer l'automatisation, une autre les proxys et les requêtes, et une autre encore la gestion des sessions et des identités. Une configuration courante comprend généralement un outil comme Playwright pour contrôler le navigateur, une API de scraping telle que ScraperAPI ou Bright Data pour gérer l'infrastructure, et un outil comme AdsPower pour gérer les empreintes numériques et assurer la cohérence des sessions. Aucun de ces outils ne remplace les autres ; ils fonctionnent de concert.

S'il y a une chose à retenir, c'est que la discrétion prime sur la vitesse. Envoyer plus de requêtes est inutile si vous êtes bloqué en cours de route. Un système plus lent mais plus stable sera presque toujours plus performant qu'un système agressif. Privilégiez la constance, et la mise à l'échelle deviendra beaucoup plus simple avec le temps.

FAQ

Comment gérer les CAPTCHA dans les flux de travail de web scraping ?

À grande échelle, les CAPTCHA sont inévitables ; l’objectif est donc de les gérer plutôt que de les éliminer. La plupart des configurations réduisent leur fréquence en ralentissant le rythme des requêtes, en réutilisant les sessions et en imitant le comportement réel des utilisateurs. De plus, de nombreuses équipes intègrent des services de résolution de CAPTCHA pour assurer la continuité des flux de travail sans intervention manuelle. En pratique, c’est une combinaison de techniques (proxies, gestion du temps et analyse comportementale) qui permet de garantir la stabilité, plutôt que de s’appuyer sur une solution unique.

Pourquoi le CAPTCHA apparaît-il plus fréquemment à grande échelle ?

Lorsque le volume de données collectées augmente, les sites web repèrent plus facilement les schémas suspects. Les actions répétées, les requêtes identiques ou un timing inhabituel peuvent rapidement alerter les autorités. Les CAPTCHA servent à vérifier si le trafic provient de personnes réelles ; par conséquent, plus votre comportement ressemble à celui d'un robot, plus ils apparaîtront fréquemment. C'est pourquoi la mise à l'échelle ne consiste pas seulement à envoyer plus de requêtes, mais aussi à rendre ces requêtes moins prévisibles et plus naturelles.

Pourquoi votre pile de scraping a-t-elle besoin d'une protection contre les empreintes digitales ?

Les proxys ne suffisent plus. Les sites web analysent désormais l'empreinte numérique du navigateur , les paramètres de l'appareil et les comportements des utilisateurs pour détecter les bots. Sans protection par empreinte numérique, même une adresse IP changeante peut être repérée. En créant des environnements de navigation isolés, les outils d'analyse d'empreinte numérique rendent chaque session plus réaliste et cohérente. Cela contribue à réduire les blocages et à fluidifier les processus de web scraping, notamment en cas de volumes importants.

Les gens lisent aussi

- Explication du polygraphe du navigateur : pourquoi AdsPower passe les systèmes de détection modernes

Explication du polygraphe du navigateur : pourquoi AdsPower passe les systèmes de détection modernes

Découvrez comment l'étude IMC '24 menée par ASU et Amazon confirme la cohérence d'AdsPower au niveau du noyau. Apprenez pourquoi AdsPower était le seul navigateur à…

- Meilleurs navigateurs Agentic en 2026 : fonctionnalités, prix et comparaison

Meilleurs navigateurs Agentic en 2026 : fonctionnalités, prix et comparaison

Lorsque vous recherchez le meilleur navigateur agentique pour l'automatisation des flux de travail, consultez cet avis sur les navigateurs IA agentiques et testez-les avant de commencer.

- Meilleur navigateur antidétection pour le web scraping en 2026

Meilleur navigateur antidétection pour le web scraping en 2026

Trouvez les meilleurs navigateurs antidétection pour le web scraping en 2026. Comparez les meilleurs outils, leurs fonctionnalités clés et apprenez à éviter la détection et à optimiser votre scraping.

- Navigateur IA ou automatisation de navigateur traditionnelle : lequel choisir ?

Navigateur IA ou automatisation de navigateur traditionnelle : lequel choisir ?

Navigateur automatisé IA vs automatisation traditionnelle : comparez les fonctionnalités, les cas d’utilisation et l’évolutivité. Découvrez quand utiliser l’un ou l’autre et comment créer des flux de travail plus intelligents.

- Les 9 meilleurs agents d'IA en 2026 et comment automatiser vos processus en toute sécurité

Les 9 meilleurs agents d'IA en 2026 et comment automatiser vos processus en toute sécurité

Découvrez les 9 meilleurs agents IA de 2026 et apprenez à automatiser vos campagnes en toute sécurité avec AdsPower. Comparez les outils, les cas d'utilisation et développez votre activité sans risque de suspension de compte.