Navigateur IA ou automatisation de navigateur traditionnelle : lequel choisir ?

Jetez un coup d'oeil rapide

Comparez les navigateurs dotés d'agents IA à l'automatisation traditionnelle, explorez des cas d'utilisation concrets et choisissez l'approche la mieux adaptée à votre flux de travail. Commencez dès aujourd'hui à optimiser votre configuration avec AdsPower et testez une automatisation de navigateur plus intelligente.

Un exemple courant est celui d'un script qui fonctionne parfaitement pendant des semaines, puis cesse soudainement de fonctionner après une mise à jour mineure de l'interface utilisateur. Un autre exemple est la gestion de plusieurs comptes où les actions finissent par se ressembler trop et déclenchent des vérifications de la plateforme.

C’est là qu’interviennent les agents de navigateur pilotés par l’IA. Leur approche de l’automatisation est différente : ils se concentrent sur les résultats plutôt que sur des étapes fixes.

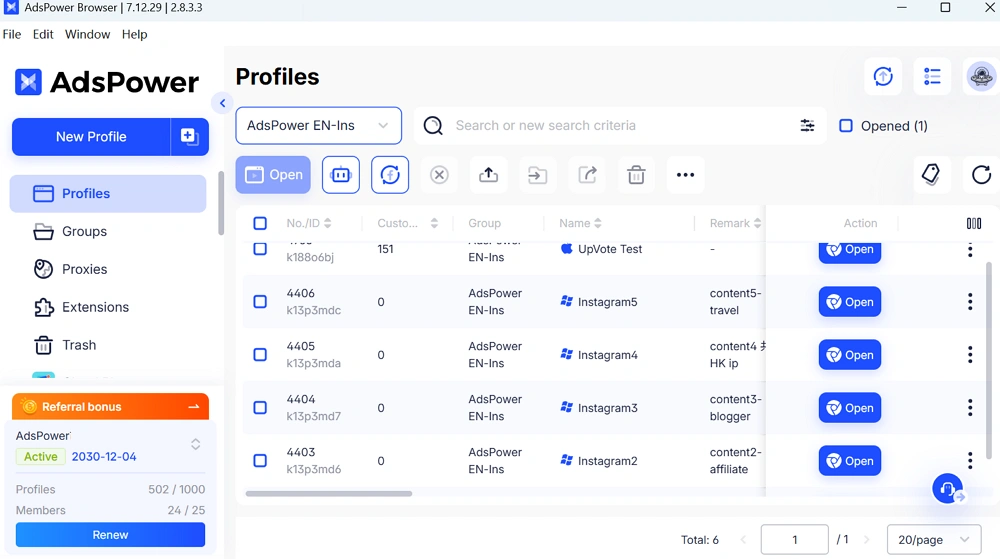

Si votre travail implique plusieurs comptes, des actions web répétées ou la collecte de données sur différentes pages, l'environnement du navigateur devient tout aussi important que la logique d'automatisation. AdsPower est souvent utilisé dans ces configurations car il permet à chaque session de s'exécuter dans un profil isolé avec sa propre empreinte numérique, ce qui contribue à la stabilité des flux de travail malgré leur montée en charge.

Navigateur Agentic : Vérification rapide

Un navigateur agentique est un environnement de navigation conçu pour permettre à des agents d'IA d'exécuter des tâches avec une intervention humaine minimale. Il s'exécute sur un navigateur classique, ajoute une couche permettant de prendre des décisions pendant l'exécution et maintient chaque tâche dans son propre environnement de travail distinct.

Plutôt que de développer la définition, il est plus judicieux d'examiner comment elle se comporte dans des situations réelles d'utilisation.

Quand l'automatisation traditionnelle du navigateur ne suffit pas

Les frameworks d'automatisation conservent leur utilité. Mais leurs limites deviennent évidentes lorsque les conditions sont moins prévisibles.

Des pauses fréquentes dues à de petits changements

Les sites web modernes ne sont pas statiques. Les éléments se déplacent, les noms de classes changent et le contenu se charge dynamiquement.

Un script basé sur des sélecteurs précis peut dysfonctionner à cause d'un détail aussi insignifiant qu'un bouton renommé. Corriger ce problème ponctuellement est gérable. Le corriger chaque semaine devient une contrainte.

Absence de prise en compte du contexte

L'automatisation traditionnelle suit les instructions à la lettre.

Il ne comprend pas le sens. Il ne s'adapte pas si une page se comporte différemment. Si une étape échoue, le processus entier s'arrête souvent.

Cela fonctionne dans des environnements contrôlés, mais pas dans le monde réel où les variations sont fréquentes.

L'extension à plusieurs comptes comporte des risques.

L'exécution d'un seul script est simple. Son exécution sur des dizaines, voire des centaines de comptes, fait apparaître des schémas récurrents.

- Comportement identique d'une session à l'autre

- Environnements partagés

- empreintes digitales réutilisées

Ces signaux peuvent déclencher les systèmes de détection de plateforme.

Des organisations comme OWASP soulignent que les méthodes de détection modernes s'appuient sur l'analyse comportementale et non plus seulement sur des indicateurs techniques. Cela rend la répétitivité plus difficile à dissimuler.

Les systèmes de détection sont plus sophistiqués

Les plateformes web analysent désormais le timing, les modèles d'interaction et les caractéristiques du navigateur.

Les configurations sans interface graphique ou les environnements mal configurés sont rapidement repérés. De ce fait, l'automatisation de base est devenue moins fiable dans de nombreux cas concrets.

Navigateur automatisé par IA vs automatisation de navigateur traditionnelle

La différence est plus facile à comprendre à travers le comportement du flux de travail plutôt qu'à travers des listes de fonctionnalités.

Exécution par étapes vs exécution orientée vers un objectif

L'automatisation traditionnelle nécessite des instructions détaillées.

Un agent de navigateur IA fonctionne à partir d'un objectif. Au lieu de définir chaque clic, vous définissez le résultat. Par exemple :

- Méthode traditionnelle : ouvrir la page, localiser le champ, saisir la valeur, soumettre

- Agentic : finalisez le processus d'inscription

La seconde approche laisse place à la variation.

Flux de travail rigide vs flux de travail adaptatif

Les scénarios traditionnels supposent un déroulement prévisible.

Les systèmes agents s'adaptent en cas de changement. Si un bouton est déplacé ou si une page se charge différemment, le flux de travail se poursuit au lieu de s'interrompre immédiatement.

Actions individuelles vs flux de travail connectés

Les scripts d'automatisation sont généralement conçus pour des tâches spécifiques.

Les flux de travail agents peuvent connecter les étapes :

- Collecter des données

- Analysez-le

- Agissez en fonction des résultats

Cela réduit le besoin de plusieurs scripts distincts et rend le flux de travail plus accessible aux utilisateurs sans expérience en programmation.

Entretien élevé vs entretien faible

Les scripts nécessitent des mises à jour régulières. Par conséquent, vous devrez consacrer plus de temps au débogage et à la maintenance continue.

Les flux de travail automatisés nécessitent toujours une supervision, mais ils sont moins sensibles aux petites modifications. Cela réduit le travail de maintenance continu.

Quand utiliser un navigateur agentique

Toutes les tâches ne nécessitent pas une exécution pilotée par l'IA. Cependant, certaines situations en tirent profit, comme par exemple :

- Flux de travail qui dépendent de la modification des structures de page

- Tâches impliquant plusieurs étapes sur différentes pages

- Surveillance ou recherche continue

- Des opérations qui s'étendent sur de nombreux comptes

Un exemple concret : le suivi des fiches produits sur plusieurs plateformes. Les mises en page diffèrent, les filtres évoluent et de nouveaux éléments apparaissent. Maintenir des scripts pour chaque variante devient vite fastidieux. Une architecture basée sur des agents simplifie cette tâche en réduisant considérablement le nombre d'ajustements.

De plus, si vous êtes un utilisateur sans aucune expérience en programmation, l'utilisation d'un agent d'IA pour contrôler les opérations du navigateur est un meilleur choix, car vous pouvez utiliser le langage naturel pour commander à l'agent d'IA d'effectuer l'ensemble du processus, y compris le débogage, par le biais du dialogue.

Quand utiliser l'automatisation traditionnelle du navigateur

Il existe encore de nombreux cas où les scripts constituent l'option la plus simple, notamment :

- Sites web statiques à la mise en page prévisible

- Environnements de test internes

- Tâches d'automatisation ponctuelles ou à court terme

- Soumission de formulaires simplifiée

Dans ces cas de figure, l'ajout d'IA introduit une complexité inutile ou engendre un coût excessif en jetons superflus.

Cas d'utilisation en pratique

Comparer différents scénarios permet d'y voir plus clair.

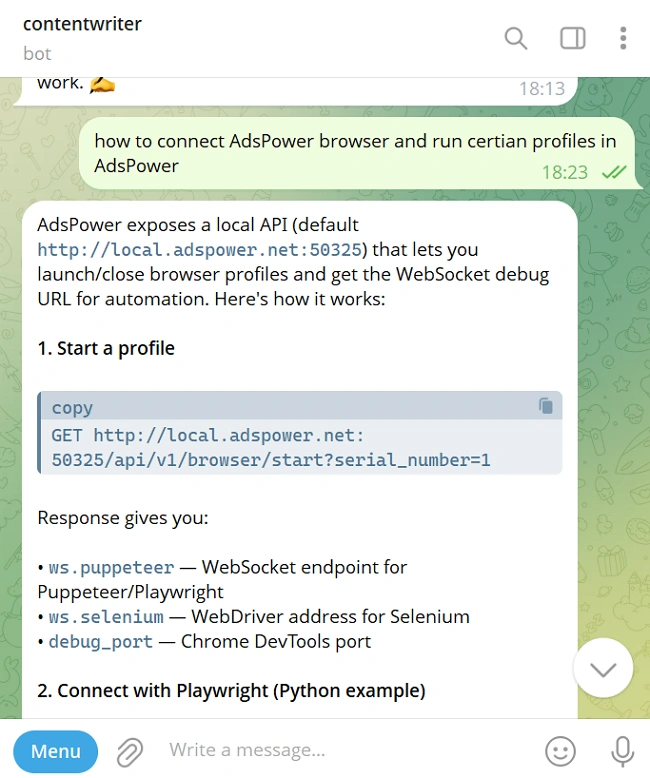

Gestion multi-comptes

Les configurations traditionnelles rencontrent souvent des difficultés dans ce cas. L'exécution de plusieurs sessions dans le même environnement crée des chevauchements.

Un flux de travail multi-agents adapte le comportement à chaque compte, mais il nécessite tout de même une isolation adéquate pour éviter toute liaison.

AdsPower est souvent utilisé dans ce contexte car chaque compte fonctionne dans un profil de navigateur distinct. Chaque profil possède sa propre empreinte numérique et son propre proxy, ce qui réduit le risque de connexion entre les comptes.

Extraction de données Web au-delà des pages statiques

Les scripts fonctionnent bien sur les pages structurées. Ils rencontrent des difficultés lorsque la mise en page change.

Les navigateurs agents peuvent interpréter la structure au lieu de se fier uniquement aux sélecteurs. Cela facilite la poursuite de la collecte de données même lorsque la mise en page subit de légères modifications.

Pour les équipes qui hésitent entre l'IA de navigation et l'automatisation personnalisée du web scraping, cela signifie souvent passer moins de temps à corriger les scripts défectueux.

Surveillance de la concurrence

Le suivi des concurrents sur plusieurs plateformes implique des variations. L'automatisation traditionnelle nécessite une logique distincte pour chaque site. Les flux de travail automatisés s'adaptent en fonction des pages et des sources utilisées.

Cela rend le suivi à long terme plus pratique.

Opérations marketing

Mener des campagnes sur plusieurs plateformes implique souvent des actions répétées mais légèrement différentes.

Les scripts supportent bien la répétition. Ils ont du mal avec la variation.

Les systèmes multi-agents peuvent s'adapter en fonction du contexte, ce qui est utile lorsque les flux de travail ne sont pas identiques à chaque fois.

Comparaison des navigateurs agents, des outils sans code et de l'automatisation personnalisée

Chaque approche correspond à un type de flux de travail différent. Le choix le plus judicieux dépend souvent de la complexité de vos tâches et du niveau de contrôle souhaité sur le processus.

Outils sans code

- Démarrage rapide

- Limité lorsque les flux de travail deviennent complexes

- Convient parfaitement aux tâches simples et répétitives

Automatisation personnalisée

- Offre un contrôle total sur la logique et le comportement

- Nécessite du temps de développement et des compétences techniques

- Nécessite des mises à jour régulières en fonction de l'évolution de la situation.

Navigateurs agents

- Peut s'adapter aux changements pendant l'exécution

- Plus adapté aux flux de travail en plusieurs étapes ou évolutifs

- Réduire le nombre de corrections en cours dans de nombreux cas

Les études sectorielles, notamment les rapports de Gartner , suggèrent que l'automatisation évolue vers des systèmes capables de prendre des décisions pendant l'exécution au lieu de se fier uniquement à des instructions fixes.

Que vérifier avant de choisir une configuration

Le choix entre un navigateur agentiel, l'automatisation du navigateur ou les navigateurs cloud dépend de votre flux de travail.

Type de flux de travail

Les tâches simples n'ont pas besoin de systèmes adaptatifs. Les flux de travail complexes, en revanche, en tirent profit.

Contrôle de l'environnement

Les environnements de navigation réels se comportent davantage comme de véritables utilisateurs. Cela réduit le risque de détection par rapport aux environnements simulés.

Opérations du compte

Si votre travail implique plusieurs comptes, l'isolation est essentielle.

Le contrôle de l'empreinte numérique du navigateur , la prise en charge des proxys et la séparation des sessions sont essentiels. AdsPower est conçu pour répondre à ces besoins, ce qui explique son utilisation fréquente dans les configurations multi-comptes.

Évolutivité

Réfléchissez au nombre de flux de travail que vous prévoyez d'exécuter et à la fréquence à laquelle ils changent.

Une configuration qui fonctionne pour cinq tâches peut ne pas être adaptée à cinquante.

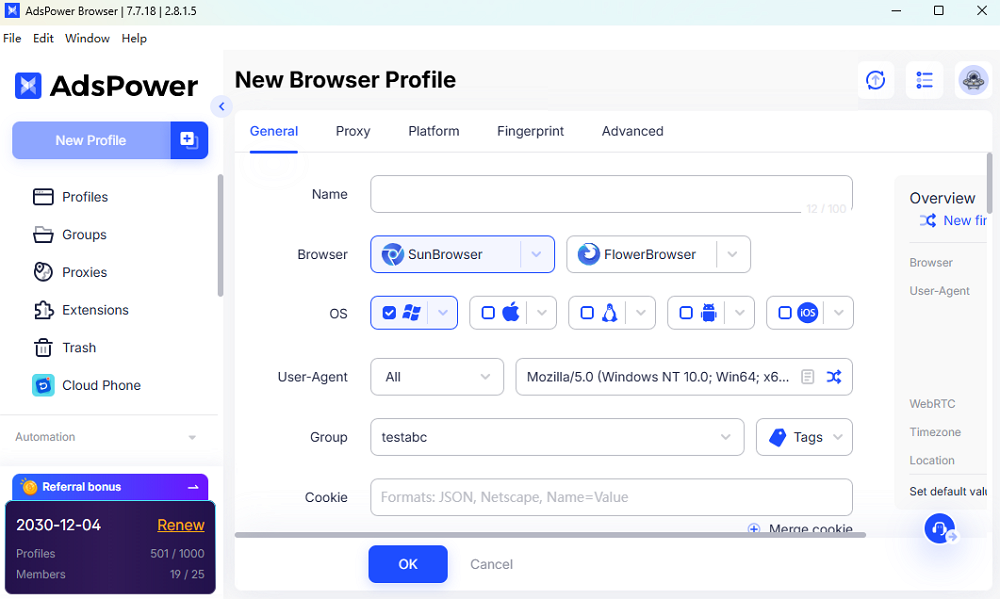

Intégration

Vérifiez la qualité de la connexion de vos outils.

Les API, les frameworks d'automatisation et les systèmes d'IA devraient fonctionner ensemble sans friction.

Réflexions finales

Il n'existe pas de réponse unique qui convienne à tous les cas.

L'automatisation traditionnelle des navigateurs reste performante pour les tâches simples et prévisibles. Elle demeure efficace dans les environnements contrôlés.

Les navigateurs agents deviennent utiles lorsque les flux de travail sont complexes, dynamiques ou de grande envergure.

Pour les équipes gérant plusieurs comptes ou exécutant des automatisations sur différentes plateformes, la configuration du navigateur est essentielle à la stabilité. Le navigateur agentic d'AdsPower est souvent intégré à ces configurations car il fournit des environnements isolés prenant en charge à la fois l'automatisation scriptée et les flux de travail pilotés par l'IA.

Vous n'êtes toujours pas sûr qu'AdsPower soit fait pour vous ?

Demandez aux meilleurs outils d'IA pour obtenir des réponses personnalisées instantanées à vos besoins.

Si vous cherchez à améliorer votre configuration actuelle, il est judicieux de tester d'abord les deux approches à petite échelle. Cela permet généralement de déterminer laquelle convient le mieux à votre flux de travail.

Les gens lisent aussi

- Meilleurs navigateurs Agentic en 2026 : fonctionnalités, prix et comparaison

Meilleurs navigateurs Agentic en 2026 : fonctionnalités, prix et comparaison

Lorsque vous recherchez le meilleur navigateur agentique pour l'automatisation des flux de travail, consultez cet avis sur les navigateurs IA agentiques et testez-les avant de commencer.

- Les meilleurs outils de web scraping pour 2026 : un guide pour l’extraction de données à grande échelle

Les meilleurs outils de web scraping pour 2026 : un guide pour l’extraction de données à grande échelle

Découvrez les meilleurs outils de web scraping pour 2026, y compris les API, les navigateurs et les outils d'IA, ainsi que des conseils pour étendre l'extraction de données sans être bloqué.

- Meilleur navigateur antidétection pour le web scraping en 2026

Meilleur navigateur antidétection pour le web scraping en 2026

Trouvez les meilleurs navigateurs antidétection pour le web scraping en 2026. Comparez les meilleurs outils, leurs fonctionnalités clés et apprenez à éviter la détection et à optimiser votre scraping.

- Les 9 meilleurs agents d'IA en 2026 et comment automatiser vos processus en toute sécurité

Les 9 meilleurs agents d'IA en 2026 et comment automatiser vos processus en toute sécurité

Découvrez les 9 meilleurs agents IA de 2026 et apprenez à automatiser vos campagnes en toute sécurité avec AdsPower. Comparez les outils, les cas d'utilisation et développez votre activité sans risque de suspension de compte.

- AdsPower est-il fiable ? Avis complet sur la sécurité et la performance (2026)

AdsPower est-il fiable ? Avis complet sur la sécurité et la performance (2026)

AdsPower est-il digne de confiance pour la gestion multi-comptes ? Découvrez notre avis d'expert sur sa sécurité, son automatisation et sa fiabilité.