【2026年最新】Webスクレイピングツールおすすめ7選:大量データ抽出を成功させる完全ガイド

ちょっと見てみる

大規模スクレイピングではブロックやCAPTCHA、システムの不安定化が課題となります。成功には、適切なツールの組み合わせによるフィンガープリント管理と安定したインフラ構築が不可欠です。本ガイドを参考に、最適な抽出環境を構築しましょう。

数ページ程度のスクレイピングなら、驚くほど簡単に思えるかもしれません。簡単なスクリプトを書き、プロキシを通すだけで、データはスムーズに取得できます。しかし、その手軽さは規模を拡大しようとした瞬間に失われます。リクエスト数が増えるにつれ、それまでの手法は通用しなくなるのです。

スクレイピングの規模を拡大しようとすると、途端に予測不能な事態が増えてきます。リクエストが拒否され、セッションが維持できなくなり、WebスクレイピングでのCAPTCHA回避方法が単なる懸念事項から、直面せざるを得ない大きな課題へと変わります。小規模なバッチ処理では問題なかったものが、大量処理になった瞬間に低速化したり、完全に停止したりするのです。この段階になると、スクレイピングは単なるHTMLの取得ではなく、デジタルアイデンティティの管理、動的なページの処理、そして負荷のかかる状況下でシステムを安定させる「インフラ構築」の戦いになります。本ガイドでは、大規模な運用に耐えうる手法と、なぜ多くの環境がそのレベルに達する前に挫折してしまうのかを解説します。

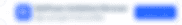

Webスクレイピングツールが大規模運用で失敗する主な理由

Webスクレイピングにおける最大の誤解は、「小規模で成功した手法は、大規模でも通用する」と思い込んでしまうことです。実際には、そうはいきません。

一般的に、以下のポイントでシステムが破綻します。

- IPブロックが急増する

1分間に数リクエストなら問題ありませんが、1時間に数千件となれば、すぐにフラグが立てられます。

- IP以外でのブラウザ指紋(フィンガープリント)検知

現代のウェブサイトはIPアドレスだけでなく、ブラウザのフィンガープリント、行動パターン、セッションの一貫性を分析しています。

- 動的コンテンツによる複雑化

JavaScriptを多用したサイトでは、完全なブラウザレンダリングが必要です。単純なHTTPリクエストだけでは太刀打ちできません。

- CAPTCHAがパイプラインを止める

大規模な運用では、CAPTCHAは「たまに発生するもの」ではなく、「常に立ちはだかる壁」になります。

- メンテナンスが本業になってしまう

サイト構造の変更、アンチボットの更新、レート制限への対応など、絶え間ない調整が求められます。

つまり、大規模なスクレイピングはもはやコーディングの問題ではなく、インフラとステルス性の問題なのです。

Webスクレイピングツールの種類

適切なツールの選択は、技術力、必要なデータ量、そしてメンテナンスにどれだけ手間をかけられるかによって決まります。主なカテゴリを見ていきましょう。

1. コードベースのフレームワーク

いわゆる自作(DIY)の道です。ゼロからスクレイパーを構築したことがあるなら、ここがスタート地点でしょう。完全な自由度がありますが、すべてを自分で管理する必要があります。

最適:

- 細部まで制御したいエンジニア

- 既存のツールでは対応できない特殊なプロジェクト

- 複雑なスクレイピングロジックが必要な場合

メリット:

- ほぼすべての要素をカスタマイズ可能

- 自社システムへの統合が容易

- データ収集と処理の全工程をコントロールできる

デメリット:

- コーディングスキルが必須

- 長期的にはメンテナンスが煩雑になる

- プロキシやCAPTCHA対策に別途ツールが必要になることが多い

2. ノーコード / ビジュアルスクレイパー(初心者向け)

スピードとシンプルさを重視したツールです。コードを書く代わりに、画面上をクリックして抽出したいデータを指定します。

最適:

- 非エンジニアの方

- 小規模または一時的なスクレイピングタスク

- アイデアの素早い検証

メリット:

- 学習コストが低い

- 短時間で結果が得られる

- プログラミング不要

デメリット:

- 柔軟性に欠ける

- 複雑または動的なサイトでは動作が不安定になりやすい

- 大規模な拡張には不向き

3. スクレイピングAPI(メンテナンス不要で大規模化に最適)

面倒な作業の大部分を代行してくれます。リクエストを送るだけで、背後でプロキシの切り替えやリトライ、時にはレンダリングまで処理します。特にブロックされずにプロキシを活用する方法を知るには、非常に有効な選択肢です。

最適:

- インフラ管理に時間をかけたくないチーム

- 大量のデータを取得する必要がある場合

- スピーディな導入を優先する場合

メリット:

- IPローテーションが自動化されている

- リトライ機能が組み込まれている

- ヘッドレスブラウザをサポートしていることが多い

デメリット:

- コストが積み重なりやすい

- プロセス全体の制御性は低くなる

- サードパーティのサービスに依存する

4. AIスクレイピングツール(注目のトレンド)

比較的新しいアプローチです。セレクターを手動で指定する代わりに、必要なデータを指示するだけで、AIが構造を解析してデータを抽出します。

最適:

- 迅速な実験的プロジェクト

- 構造が乱雑、または頻繁に変更されるサイト

- セットアップ時間を短縮したい場合

メリット:

- ページ構造の変化に適応できる可能性がある

- 手動の微調整が少なくて済む

- 開始までのハードルが低い

デメリット:

- 精度が100%ではない場合がある

- まだ発展途上の技術

- 高度なアンチボットシステムには苦戦することも

5. スクレイピングブラウザ

より「リアル」な運用を可能にするツールです。単にリクエストを送るだけでなく、実際のユーザーとして振る舞います。フィンガープリント、Cookie、セッションなど、通常のブラウザが行うすべての処理を管理します。

最適:

- 検知を極限まで回避したい場合

- 複数のアカウントを並行運用する場合

- 保護されたプラットフォームのスクレイピング

メリット:

- 本物の人間のような挙動をシミュレート

- セッションの一貫性を維持

- ブロックやBANのリスクを大幅に軽減

デメリット:

- 適切なセットアップに多少の知識が必要

- 通常、他のツールと組み合わせて使用される

今すぐ使うべき厳選Webスクレイピングツール

すべてのツールが大規模運用に耐えられるわけではありません。カタログスペックは良くても、実運用で破綻するものは多いです。以下に挙げるのは、安定性とスケーラビリティにおいて現場で信頼されているツールです。

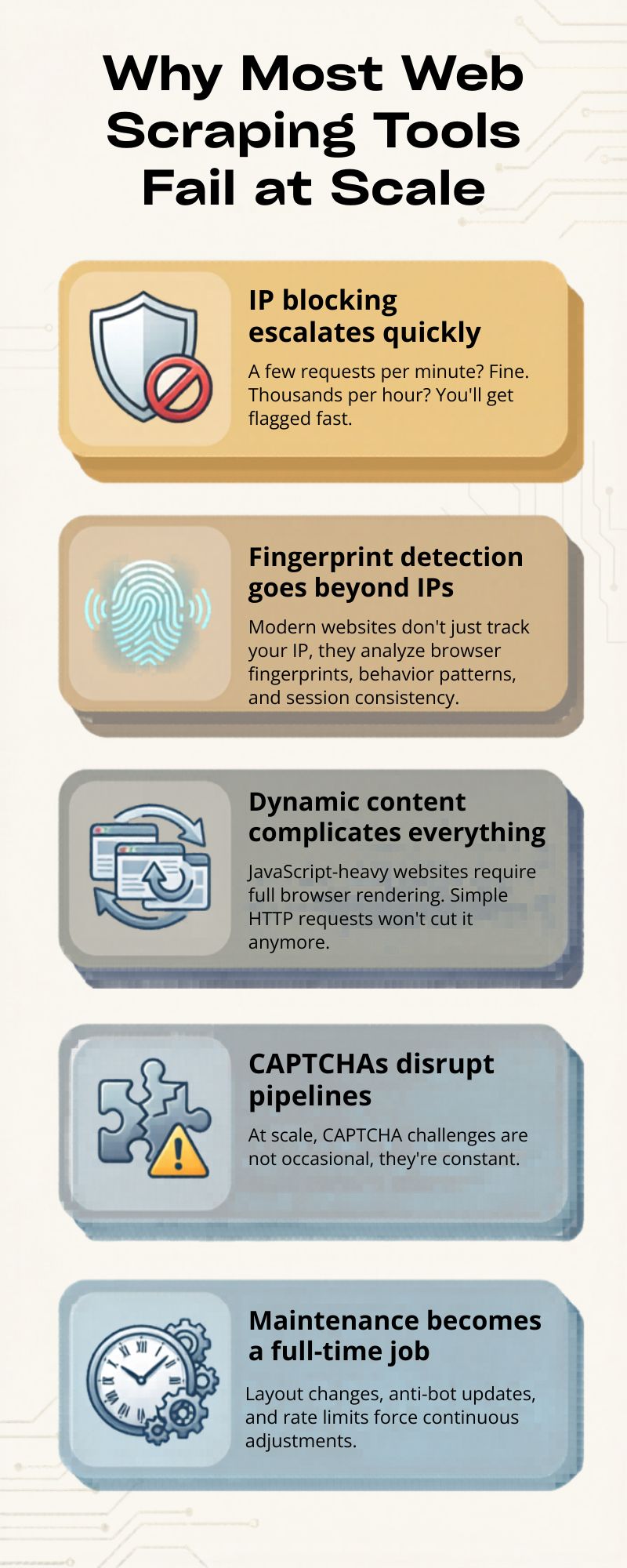

1. AdsPower

強固なアンチボットシステムを備えたプラットフォームをスクレイピングする場合、AdsPowerのようなツールはほぼ不可欠です。単なるブラウザではなく、実際のユーザー環境を高度にシミュレートするように設計されており、検知を回避する上で決定的な違いを生みます。

主な特徴:

- 各プロフィールに完全に隔離されたブラウザ指紋(フィンガープリント)を提供

- プロフィールごとに独立した物理デバイスとして動作

- RPAによるワークフローの自動化をサポート

- CAPTCHA解決ツールの統合が可能

- Cookieとローカルストレージによりセッションを安定維持

大量のデータを扱う場合、単純にリクエスト速度を上げるよりも、この「環境の隔離と擬態」のアプローチの方が効果的です。ECサイト、SNS、マーケットプレイスのスクレイピングにおいて、BANやダウンタイムを劇的に減らすことができます。

2. Scrapingdog

Scrapingdogは非常にシンプルで、手軽さを求めるチームに選ばれています。

優れた点:

- プロキシ管理とレンダリングをバックグラウンドで処理

- 構造化データの抽出において高い信頼性

- クリーンで分かりやすいAPI

インフラのセットアップに時間をかけず、「とにかく動くもの」が必要な場合には妥当な選択肢です。

3. ScraperAPI

ScraperAPIは何よりも「安定性」に特化したサービスです。

主な機能:

- 自動IPローテーション

- CAPTCHAの自動処理機能

- 大規模環境での高い成功率を目指した設計

カスタマイズ性よりも、継続的なスクレイピング業務における一貫性を重視する場合に適しています。

4. Bright Data

Bright Dataは、業界でも最も高度な部類に入るソリューションです。

提供内容:

- 膨大なプロキシネットワーク(レジデンシャル、モバイル、データセンター)

- 非常に細かなターゲティングオプション

- 付加的なデータ収集サービス

セットアップは決して簡単ではなく、価格もそれなりですが、エンタープライズ規模の運用において、これに匹敵するカバー範囲を持つツールは他にありません。

5. Apify

Apifyは、シンプルなツールからステップアップする際に選ばれることが多いプラットフォームです。手間を省きつつ、必要に応じて細かな調整も可能です。

- 一般的なサイト向けの「アクター(実行プログラム)」が用意されている

- クラウド上で動作するため、自社サーバーの管理が不要

- 負荷の増加に合わせて容易にスケール可能

- ツールやテンプレートの共有エコシステムが充実

複雑すぎず、かといって単純すぎない「ちょうどいい」立ち位置が、多くのチームに支持されています。

6. Playwright

Playwrightは開発者向けのツールであり、その分、非常に強力です。現代的な複雑なウェブサイトに対しても確実に動作するため、広く利用されています。

- Chromium、Firefox、WebKitをサポート

- JavaScriptを多用した動的ページの処理に非常に強い

- 長時間の自動化タスクでも安定動作

- 挙動を細かくカスタマイズできる柔軟性

独自のスクレイピング環境を構築する場合、その「核」としてPlaywrightが採用されることがよくあります。

7. Octoparse

Octoparseは、コードを一切書かずにスクレイピングをしたい場合に真っ先に検討されるツールです。

- ポイント&クリックの直感的なビジュアルインターフェース

- 基本的なスクレイピングならすぐに開始可能

- 小規模プロジェクトや単発のタスクに最適

- 有名サイト向けのテンプレートが豊富

導入初期は非常に便利ですが、要件が複雑になったり、データ量が膨大になったりすると、制限を感じる場面も出てくるでしょう。

主要ツール比較表

ここまで見てきた通り、一種類のツールですべてを完璧にこなせるものは存在しません。使いやすさを重視するか、自由度を重視するか、あるいはスケーラビリティを重視するかで選択肢が変わります。

悩む前に、主要なツールを比較してみましょう。特にアンチディテクトブラウザとしての側面を比較することで、各ツールの適性が見えてきます。

|

ツール名 |

タイプ |

最適用途 |

主な強み |

|

AdsPower |

スクレイピングブラウザ |

検知回避・アカウント管理 |

ブラウザ指紋の隔離 |

|

Scrapingdog |

API |

シンプルな抽出タスク |

使いやすさ |

|

ScraperAPI |

API |

大規模パイプライン |

安定性 |

|

Bright Data |

API / プロキシネットワーク |

エンタープライズ用途 |

圧倒的なカバー範囲 |

|

Apify |

プラットフォーム |

自動化 + スクレイピング |

柔軟性 |

|

Playwright |

フレームワーク |

独自ソリューション構築 |

制御の細かさ |

|

Octoparse |

ノーコード |

初心者・非エンジニア |

手軽さ |

AdsPowerが自分に合っているかまだ迷っていますか?

最新のAIツールに聞いて、あなたにぴったりの回答を今すぐ手に入れましょう

まとめ

2026年現在、Webスクレイピングを成功させる鍵は「唯一の完璧なツール」を見つけることではありません。実際には、プロセスの各段階に応じて最適なツールを組み合わせることが重要です。例えば、Playwrightでブラウザを操作し、ScraperAPIやBright Dataでインフラを支え、AdsPowerでフィンガープリントを管理してセッションの一貫性を保つ、といった連携が主流です。これらは競合するのではなく、補完し合う関係にあります。

最も重要なのは、スピードよりも「検知されないこと」です。リクエストをいくら速めても、途中でブロックされては意味がありません。低速であっても安定したシステムの方が、長期的には優れたパフォーマンスを発揮します。安定性を重視することで、自ずとスケールアップも容易になるはずです。

よくある質問(FAQ)

スクレイピング中のCAPTCHAにはどう対処すべきですか?

大規模な運用ではCAPTCHAをゼロにすることは不可能なので、「管理」することを目指します。リクエスト間隔を調整し、セッションを再利用し、本物の人間のような挙動を模倣することで、CAPTCHAの発生頻度を抑えます。その上で、自動ワークフローを止めないためにCAPTCHA解決サービスを統合するのが一般的です。プロキシ、タイミング、行動パターンの組み合わせが安定運用の鍵となります。

なぜ大規模になるとCAPTCHAが頻繁に現れるのですか?

スクレイピングの量が増えると、サイト側が機械的なパターンを検知しやすくなるからです。同じようなリクエストが不自然な間隔で繰り返されると、サイトは「人間かボットか」を確認するためにCAPTCHAを提示します。スケールアップとは単にリクエストを増やすことではなく、それらをいかに「予測不能」で「人間らしい」ものに見せるかの工夫が必要です。

スクレイピングになぜブラウザ指紋(フィンガープリント)保護が必要なのですか?

もはやプロキシだけでは不十分だからです。ウェブサイトはブラウザ指紋やデバイス設定、行動ログを分析してボットを見つけ出します。指紋保護がないと、たとえIPを変えても同一のボットだと見破られてしまいます。隔離されたブラウザ環境を作成することで、各セッションの信頼性を高め、大量のスクレイピングでも安定してデータを取得し続けることが可能になります。

他にも読む記事

- ブラウザポリグラフの解説:AdsPowerが最新の検出システムを通過できる理由

ブラウザポリグラフの解説:AdsPowerが最新の検出システムを通過できる理由

ASUとAmazonによるIMC '24研究調査がAdsPowerのカーネルレベルの一貫性をどのように検証しているかをご覧ください。AdsPowerが唯一、

- 2026年版 おすすめAIエージェント型ブラウザ:機能、料金、比較

2026年版 おすすめAIエージェント型ブラウザ:機能、料金、比較

自動化ワークフローに最適なAIエージェント型ブラウザをお探しですか?このレビュー記事で各社を比較し、本格的な導入前にテストしてみましょう。

- 2026年版:ウェブスクレイピング向けおすすめアンチデテクトブラウザ

2026年版:ウェブスクレイピング向けおすすめアンチデテクトブラウザ

2026年最新のウェブスクレイピングに最適なアンチデテクトブラウザを見つけましょう。主要ツールの機能比較から、ブロックを回避して安全にスクレイピングを拡張する方法まで詳しく解説します。

- AIエージェント型ブラウザと従来型ブラウザ自動化:どちらを使うべきか?

AIエージェント型ブラウザと従来型ブラウザ自動化:どちらを使うべきか?

AIエージェント型ブラウザと従来型自動化:機能、ユースケース、拡張性を比較。それぞれの最適な使用方法と、よりスマートなワークフローの構築方法を学びましょう。

- 2026年に注目すべきAIエージェント9選と、自動化を安全に実行する方法

2026年に注目すべきAIエージェント9選と、自動化を安全に実行する方法

2026年における最高のAIエージェント9選を発見し、AdsPowerで安全に自動化する方法を学びましょう。ツールやユースケースを比較し、アカウント停止のリスクなく規模を拡大できます。